Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Error de Especificación - Econometria II

Cargado por

Haruka Kumagai100%(1)100% encontró este documento útil (1 voto)

36 vistas5 páginasDerechos de autor

© © All Rights Reserved

Formatos disponibles

DOCX, PDF, TXT o lea en línea desde Scribd

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

© All Rights Reserved

Formatos disponibles

Descargue como DOCX, PDF, TXT o lea en línea desde Scribd

100%(1)100% encontró este documento útil (1 voto)

36 vistas5 páginasError de Especificación - Econometria II

Cargado por

Haruka KumagaiCopyright:

© All Rights Reserved

Formatos disponibles

Descargue como DOCX, PDF, TXT o lea en línea desde Scribd

Está en la página 1de 5

Error de Especificación 23/10

1. ¿Qué hacer para encontrar el modelo “correcto”? En otras palabras,

¿cuáles son los criterios para elegir un modelo a partir del análisis

empírico?

Modelo correcto: los estimadores deben ser estadísticamente significativos. El caso de

determinación múltiple y el corregido o ajustado debe ser elevado. Coeficiente de

determinación corregido o ajustado, es ajustar por los grados de libertad.

A medida que se incluyen mayor cantidad de VE, el coeficiente de determinación

múltiple tiende a aumentar. Nos fijamos en el coeficiente de determinación múltiple

corregido, por los grados de libertad entonces establece el ajuste exacto en que las VE

explican a la V dependiente

2. ¿Qué tipos de errores de especificación de modelos son más comunes en la

práctica?

- Omisión de una VE importante

- Inclusión de una variable irrelevante

Omisión de una variable relevante (subajuste de un modelo).

Suponga que el verdadero modelo es

Yi = β1 + β2X2i + β3X3i + ui (13.3.1)

pero, por alguna razón ajustamos el siguiente modelo:

Yi = α1 + α2X2i + vi (13.3.2)

Las consecuencias de omitir X3 son las siguientes:

a) Si la variable excluida, u omitida, X3 está correlacionada con la variable

incluida X2, es decir, r23, el coeficiente de correlación entre las dos variables es

diferente de cero, αˆ 1 y αˆ 2 son sesgados e inconsistentes. Es decir, E(αˆ 1) no

es igual a β1 y E(αˆ 2) no es igual a β2, y el sesgo no desaparece conforme

aumenta el tamaño de la muestra.

b) Aunque X2 y X3 no estén correlacionados, αˆ 1 es sesgado, pese a que αˆ 2 sea

ahora insesgado.

c) La varianza de la perturbación σ2 está incorrectamente estimada.

d) La varianza medida convencionalmente de αˆ2 ( = σ2/∑ x 22 i) es un estimador

sesgado de la varianza del verdadero estimador β2.

e) En consecuencia, es probable que el intervalo de confianza usual y los

procedimientos de pruebas de hipótesis conduzcan a conclusiones equivocadas

sobre la significancia estadística de los parámetros estimados.

f) Otra consecuencia es que los pronósticos basados en el modelo incorrecto y los

intervalos (de confianza) del pronóstico no son confiables.

Inclusión de una variable irrelevante (sobreajuste de un modelo)

Ahora supongamos que

Yi = β1 + β2X2i + ui (13.3.6)

es verdadero, pero especificamos el siguiente modelo:

Yi = α1 + α2X2i + α3X3i + vi (13.3.7)

y cometemos así el error de especificación al incluir una variable innecesaria en el

modelo.

Las consecuencias de este error de especificación son las siguientes:

a) Todos los estimadores de MCO de los parámetros del modelo “incorrecto” son

insesgados y consistentes, es decir, E(α1) = β1, E(αˆ 2) = β2 y E(αˆ 3) = β3 = 0.

b) La varianza del error σ2 está correctamente estimada.

c) Los procedimientos usuales de intervalos de confianza y de pruebas de hipótesis

conservan su validez.

d) Sin embargo, las α estimadas por lo general serán ineficientes, es decir, sus

varianzas generalmente serán más grandes que las de las βˆ del verdadero

modelo.

Detección de variables innecesarias (sobreajuste de un modelo)

Una forma sencilla de averiguarlo es probar la significancia del βk estimado

mediante la prueba t usual: t = βˆ k/ee (βˆ k).

Surge la duda cuando la probabilidad sea mayor al 5%, por ejemplo; si nos da un

estimador que no es estadísticamente significativa en forma individual y el resto si, y un

R2 muy elevado y una significancia global en caso de la probabilidad del test f sea

menor al 5%, entonces decimos que el modelo es bueno pero un estimador está siendo

ruido, el problema puede ser que a lo mejor es una variable innecesaria, de esa manera

se detecta.

Cuando nos encontramos que solamente hay un caso donde hay un estimador en el

cual su probabilidad sea mayor al 5%, entonces quiere decir que esa VE está teniendo

problemas, a esto se llama Minería de datos: significa ir probando cada uno de los

estimadores a ver cuál puede ser el posible variable innecesario.

Pruebas para variables omitidas y forma funcional incorrecta

Examen de los residuos

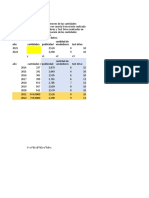

Para ilustrar lo anterior, reconsidere la función cúbica del costo total de producción

analizada en el capítulo 7. Suponga que la verdadera función del costo total se describe

de la siguiente manera, donde Y = costo total y X = producción:

Yi = β1 + β2Xi + β3X2 i + β4X3 i + ui (13.4.4)

pero un investigador ajusta la siguiente función cuadrática:

Yi = α1 + α2Xi + α3X2 i + u2i (13.4.5)

y otro investigador ajusta la siguiente función lineal:

Yi = λ1 + λ2Xi + u3i (13.4.6)

A través de los gráficos podemos detectar el error de especificación

Otra manera de poder detectar es a través de los valores de ն, tiene un valor

demasiado elevado, lineal y cuadrática. En cubica ya reduce.

Otra manera es a través de Durbin:

Es un estadístico cuyo valor esta entre el 0 y el 4, cuanto más cercano al 0 significa

que existe autocorrelacion positiva y cuanto más cercano al 4 existe auocorrelacion

negativa. Y cuanto más cercano alrededor del 2 significa que existe la autocorrelacion.

Prueba RESET de Ramsey

Ramsey propuso una prueba general de errores de especificación conocida como

RESET (prueba del error de especificación en regresión).

Errores de medición

Errores de medición en la variable dependiente Y

Ejemplo:

Y∗ = i gasto de consumo permanente

Xi = ingreso actual

ui = término de perturbación estocástico

Si yo quiero medir correctamente la variable dependiente necesito el gasto de

consumo actual, porque mi VE me dice que el ingreso es actual.

¿Cuál es la consecuencia?

Aunque los errores de medición en la variable dependiente aún producen

estimaciones insesgadas de los parámetros y de sus varianzas, las varianzas estimadas

ahora son más grandes que cuando no existen tales errores de medición.

Consecuencia de variables dependientes mal medidas

Cuando trabajamos con variable dependientes que están mal medidas, los

estimadores continúan siendo insesgados pero sus varianza tienden a ser más grandes, al

ser la varianza más grande el error estándar va a ser más grande.

Errores de medición en la variable explicativa X

Suponga ahora que, en lugar de (13.5.1), tenemos el siguiente modelo:

Yi = α + βX∗ i + ui (13.5.6)

donde Yi = gasto de consumo actual

X∗ = i ingreso permanente

ui = término de perturbación (error ecuacional)

Consecuencia de variables explicativas mal medidas (problema grave)

Si se viola este supuesto, puede demostrarse que los estimadores de MCO no

solamente están sesgados, sino que son también inconsistentes, es decir, permanecen

sesgados aunque el tamaño de la muestra, n, aumente indefinidamente.

También podría gustarte

- OptimizaciondeoperacionesDocumento86 páginasOptimizaciondeoperacionesDannyMárquezAún no hay calificaciones

- Regresion Simple y MultipleDocumento14 páginasRegresion Simple y MultipleWagnerYoplacTraucoAún no hay calificaciones

- Ejemplo Programacion No Linal Sin Restriciones Con Varias Variable Metodo Ascenso AceleradoDocumento8 páginasEjemplo Programacion No Linal Sin Restriciones Con Varias Variable Metodo Ascenso AceleradonerdopAún no hay calificaciones

- Análisis de la evolución del precio de la vivienda en EspañaDocumento42 páginasAnálisis de la evolución del precio de la vivienda en EspañaAnonymous 4lpqd6uGLmAún no hay calificaciones

- Silabo Estadítica Aplicada FIIS UNACDocumento7 páginasSilabo Estadítica Aplicada FIIS UNACJesus Huamani SalazarAún no hay calificaciones

- Teoria de ProduccionDocumento2 páginasTeoria de ProduccionEduBarrosAún no hay calificaciones

- Guia de LaboratorioDocumento3 páginasGuia de LaboratorioNemuel LopezAún no hay calificaciones

- ChallengerDocumento15 páginasChallengerCaballero Alférez Roy TorresAún no hay calificaciones

- Modelos Regresión Lineal para Predecir El Precio de ViviendasDocumento41 páginasModelos Regresión Lineal para Predecir El Precio de ViviendasJuan PerezAún no hay calificaciones

- Ajuste curvasDocumento9 páginasAjuste curvasJhon YajaAún no hay calificaciones

- 03 ProbabilidadDocumento19 páginas03 ProbabilidadVillacis IsraelAún no hay calificaciones

- Métodos numéricos para derivación e integraciónDocumento5 páginasMétodos numéricos para derivación e integraciónkevin trujilloAún no hay calificaciones

- Metodod Numericos Ejercicio ResueltoDocumento117 páginasMetodod Numericos Ejercicio ResueltoeduardoAún no hay calificaciones

- Análisis Numérico A) Determine La Cantidad de Términos de La Serie de Taylor NecesariosDocumento3 páginasAnálisis Numérico A) Determine La Cantidad de Términos de La Serie de Taylor Necesariosphoenix eastwoodAún no hay calificaciones

- Modelos de programación linealDocumento40 páginasModelos de programación linealDianaLaura0% (1)

- Ejercicios - CALCULO DIFRENCIALDocumento7 páginasEjercicios - CALCULO DIFRENCIALBio InstrumentalAún no hay calificaciones

- Pregunta 4Documento4 páginasPregunta 4AdanMedinaAún no hay calificaciones

- Practica Nro 1 Pronosticos para Los ProyectosDocumento22 páginasPractica Nro 1 Pronosticos para Los ProyectosHugo PinoAún no hay calificaciones

- Análisis y Diseño OODocumento77 páginasAnálisis y Diseño OOiwanapapu100% (9)

- Simulación - Ejercicios - Capitulo - 5 - y - 6Documento45 páginasSimulación - Ejercicios - Capitulo - 5 - y - 6Maximo Cosme MalasquezAún no hay calificaciones

- Ejercicios de EconometriaDocumento24 páginasEjercicios de EconometriaSara BautistaAún no hay calificaciones

- Teoria de La Decision ML IO2 IINDocumento32 páginasTeoria de La Decision ML IO2 IINLuis Alberto Cañete BaezAún no hay calificaciones

- Radu2 Cartel HillDocumento93 páginasRadu2 Cartel HillLaz Mig0% (1)

- Cartas de Control para AtributosDocumento4 páginasCartas de Control para AtributosJavier MTzAún no hay calificaciones

- RegresionDocumento13 páginasRegresionpervack100% (1)

- Actividad 2 Ejercicios de AutómatasDocumento9 páginasActividad 2 Ejercicios de AutómatasGus VazquezAún no hay calificaciones

- Introducción a las Cadenas de MarkovDocumento11 páginasIntroducción a las Cadenas de MarkovEdson Mota AguileraAún no hay calificaciones

- Matematica Aplicada A La Economia PDFDocumento20 páginasMatematica Aplicada A La Economia PDFGregort KloyAún no hay calificaciones

- Taller #4 Solucion Profe PDFDocumento22 páginasTaller #4 Solucion Profe PDFwilkinso alvarez anaya100% (1)

- DESARROLLO - Practica Regulacion 2023Documento12 páginasDESARROLLO - Practica Regulacion 2023Iraida Canchari Mendoza100% (1)

- PreviaDocumento10 páginasPreviaJohn Jairo Goyeneche TrianaAún no hay calificaciones

- Evaluacionn Sumativa 2Documento7 páginasEvaluacionn Sumativa 2Andres SanchezAún no hay calificaciones

- Cadenas de MarkovDocumento39 páginasCadenas de MarkovJulia Grece CoronadoAún no hay calificaciones

- Clase10 181030022717Documento38 páginasClase10 181030022717SERGIO REQUENAAún no hay calificaciones

- LISTA DE EJERCICIOS No 2 DE ÁLGEBRA IIDocumento4 páginasLISTA DE EJERCICIOS No 2 DE ÁLGEBRA IIEber Choque100% (1)

- ActividadesDocumento11 páginasActividadesAlondra GuzmánAún no hay calificaciones

- Análisis de AutocorrelaciónDocumento27 páginasAnálisis de Autocorrelaciónapi-3735749100% (3)

- Solucionario de La Practica Calificada II Estadistica BayesianaDocumento5 páginasSolucionario de La Practica Calificada II Estadistica BayesianaAngie CAún no hay calificaciones

- Inteligencia Artificial Adaptativa en Videojuegos Con Procesos EstocásticosDocumento45 páginasInteligencia Artificial Adaptativa en Videojuegos Con Procesos EstocásticosErwin Montes100% (1)

- Cadenas de Markov: Teoría, propiedades y aplicacionesDocumento18 páginasCadenas de Markov: Teoría, propiedades y aplicacionesLeslie Lima PalaciosAún no hay calificaciones

- El Método Simplex Es Un Procedimiento Iterativo Que Permite Mejorar La Solución de La Función Objetivo en Cada PasoDocumento12 páginasEl Método Simplex Es Un Procedimiento Iterativo Que Permite Mejorar La Solución de La Función Objetivo en Cada PasoGilmer Aquino CalderonAún no hay calificaciones

- Variable AleatoriaDocumento143 páginasVariable AleatoriaSergio Vázquez Razo0% (1)

- TP 310 2019-1Documento5 páginasTP 310 2019-1Vipul ShahAún no hay calificaciones

- DualidadDocumento8 páginasDualidadLucasAddurAún no hay calificaciones

- Ejercicios PDFDocumento3 páginasEjercicios PDFp3p17oAún no hay calificaciones

- Dirigida 2021 2Documento2 páginasDirigida 2021 2Michell Karen Matias TelloAún no hay calificaciones

- METODO SIMPLEX REVISADODocumento2 páginasMETODO SIMPLEX REVISADOJeanette R Ibanez ChAún no hay calificaciones

- Informe Planta de VelocidadDocumento8 páginasInforme Planta de VelocidadIsabel ArguelloAún no hay calificaciones

- AP5WN Producto5Documento9 páginasAP5WN Producto5VioLeta RebouLenAún no hay calificaciones

- Estadística Inferencial Ii FormularioDocumento12 páginasEstadística Inferencial Ii FormularioNoraAún no hay calificaciones

- Programación LinealDocumento14 páginasProgramación LinealRaúl VelasquezAún no hay calificaciones

- TI1201 - U1 - M3 Patrón de Desarrollo ECBDocumento10 páginasTI1201 - U1 - M3 Patrón de Desarrollo ECBcompletoAún no hay calificaciones

- Apuntes Metodos Numericos Sistema de Ecuaciones LinealesDocumento85 páginasApuntes Metodos Numericos Sistema de Ecuaciones LinealesMiguel Angel Castañeda SamanamúAún no hay calificaciones

- Taller 1 UdeM 2020-1Documento6 páginasTaller 1 UdeM 2020-1Avan Cardona Monrroy100% (2)

- EjerciciosDocumento2 páginasEjerciciosRodolfo Orantes Orellana0% (2)

- Econometria 20042023Documento23 páginasEconometria 20042023Hugo Alexander Azuero VasquezAún no hay calificaciones

- Trabajo Que Se Enviara A Mari PazDocumento22 páginasTrabajo Que Se Enviara A Mari Pazdulce garciaAún no hay calificaciones

- Capítulo 9 WooldridgeDocumento5 páginasCapítulo 9 WooldridgeCamila Cuello S100% (1)

- Ejercicios de EconometríaDocumento11 páginasEjercicios de EconometríaMaykell MarencoAún no hay calificaciones

- Consecuencias exceso-omisión variablesDocumento4 páginasConsecuencias exceso-omisión variablesManuel Alejandro Flores CruzAún no hay calificaciones

- Guía Decisiones en Condiciones de RiesgoDocumento4 páginasGuía Decisiones en Condiciones de RiesgoHaruka KumagaiAún no hay calificaciones

- Respuestas Curvas de UtilidadDocumento2 páginasRespuestas Curvas de UtilidadHaruka KumagaiAún no hay calificaciones

- Respuestas Decisiones Bajo RiesgoDocumento3 páginasRespuestas Decisiones Bajo RiesgoHaruka KumagaiAún no hay calificaciones

- Guía Curvas de UtilidadDocumento3 páginasGuía Curvas de UtilidadHaruka KumagaiAún no hay calificaciones

- Teoría - Análisis Bajo Incertidumbre - Taha 9a. Ed.Documento5 páginasTeoría - Análisis Bajo Incertidumbre - Taha 9a. Ed.Haruka KumagaiAún no hay calificaciones

- Creditos Su ImportanciaDocumento4 páginasCreditos Su ImportanciaHaruka KumagaiAún no hay calificaciones

- Grafico Punto de EquilibrioDocumento2 páginasGrafico Punto de EquilibrioHaruka KumagaiAún no hay calificaciones

- TAREA #6 REPASO - Auditoria de EmpresasDocumento7 páginasTAREA #6 REPASO - Auditoria de EmpresasHaruka KumagaiAún no hay calificaciones

- Punto de Indiferencia para El Criterio de HurwiczDocumento1 páginaPunto de Indiferencia para El Criterio de HurwiczHaruka KumagaiAún no hay calificaciones

- Economia 4Documento6 páginasEconomia 40431920004 OLGA LUCIA MARTINEZ HOYOS ESTUDIANTE ACTIVOAún no hay calificaciones

- Mercado de Capitales - Trabajo 1Documento5 páginasMercado de Capitales - Trabajo 1Haruka KumagaiAún no hay calificaciones

- Mercado de Capiltales - Trabajo 3Documento4 páginasMercado de Capiltales - Trabajo 3Haruka KumagaiAún no hay calificaciones

- Finanzas PúblicasDocumento11 páginasFinanzas PúblicasHaruka KumagaiAún no hay calificaciones

- Auditoria de Empresas - Unidad IDocumento5 páginasAuditoria de Empresas - Unidad IHaruka KumagaiAún no hay calificaciones

- Administración de La Producción y La Calidad - Tarea 2Documento9 páginasAdministración de La Producción y La Calidad - Tarea 2Haruka KumagaiAún no hay calificaciones

- Economia 4Documento6 páginasEconomia 40431920004 OLGA LUCIA MARTINEZ HOYOS ESTUDIANTE ACTIVOAún no hay calificaciones

- Universidad Nacional de ItapúaDocumento23 páginasUniversidad Nacional de ItapúaHaruka KumagaiAún no hay calificaciones

- Trabajo Contabilidad de CostosDocumento27 páginasTrabajo Contabilidad de CostosHaruka KumagaiAún no hay calificaciones

- Resumen de Finanzas FinalDocumento3 páginasResumen de Finanzas FinalHaruka KumagaiAún no hay calificaciones

- Universidad Nacional de ItapúaDocumento23 páginasUniversidad Nacional de ItapúaHaruka KumagaiAún no hay calificaciones

- Batalla de PeleliuDocumento10 páginasBatalla de PeleliuHaruka KumagaiAún no hay calificaciones

- Estimaciones - EjerciciosDocumento33 páginasEstimaciones - EjerciciosHaruka KumagaiAún no hay calificaciones

- Comple Ji DadDocumento9 páginasComple Ji DadHaruka KumagaiAún no hay calificaciones

- Resolución Evaluación de Inversiones Ejercicio 1 - ProfeDocumento7 páginasResolución Evaluación de Inversiones Ejercicio 1 - ProfeHaruka KumagaiAún no hay calificaciones

- La importancia del marketing en la empresa y su relación con el entornoDocumento192 páginasLa importancia del marketing en la empresa y su relación con el entornoHaruka KumagaiAún no hay calificaciones

- Presentacion, Contabilidad de CostosDocumento13 páginasPresentacion, Contabilidad de CostosHaruka KumagaiAún no hay calificaciones

- Segundo Parcial - Econometria IIDocumento4 páginasSegundo Parcial - Econometria IIHaruka KumagaiAún no hay calificaciones

- Estimaciones - EjerciciosDocumento33 páginasEstimaciones - EjerciciosHaruka KumagaiAún no hay calificaciones

- Primera Oportunidad - Eval. de Inversiones - Margarita KumagaiDocumento13 páginasPrimera Oportunidad - Eval. de Inversiones - Margarita KumagaiHaruka KumagaiAún no hay calificaciones

- Error de Especificación - Econometria IIDocumento5 páginasError de Especificación - Econometria IIHaruka Kumagai100% (1)

- Ejercicio 3 PDFDocumento7 páginasEjercicio 3 PDFBRUNING CRISTIANAún no hay calificaciones

- Actividad 13 ADocumento14 páginasActividad 13 AMaii MendiiölaAún no hay calificaciones

- Repaso examen final EAN: Intervalos confianza, pruebas hipótesis y chi cuadradoDocumento5 páginasRepaso examen final EAN: Intervalos confianza, pruebas hipótesis y chi cuadradovictor huamanAún no hay calificaciones

- DescriptivaDocumento115 páginasDescriptivaFrancisco Gallardo PizarroAún no hay calificaciones

- Practica Primer Parcial II 2018 Converted 1Documento8 páginasPractica Primer Parcial II 2018 Converted 1yamilAún no hay calificaciones

- Quiz 1 - Semana 3 - CB - Segundo Bloque-Estadistica II - (Grupo2)Documento7 páginasQuiz 1 - Semana 3 - CB - Segundo Bloque-Estadistica II - (Grupo2)maria paula rojasAún no hay calificaciones

- Trabajo FinalDocumento8 páginasTrabajo FinalMichael Masís MontenegroAún no hay calificaciones

- Intervalos de ConfianzaDocumento2 páginasIntervalos de ConfianzaProf. Pedro Nava AlmarzaAún no hay calificaciones

- Ejercicios para ResolverDocumento2 páginasEjercicios para ResolverJulian Felipe Castro GuzmanAún no hay calificaciones

- S10.s1 - Teoría y Práctica PDFDocumento4 páginasS10.s1 - Teoría y Práctica PDFAydee Mamani AquepuchoAún no hay calificaciones

- Taller 4Documento11 páginasTaller 4Karlos Estévez100% (1)

- Semana 07 - PrácticaDocumento5 páginasSemana 07 - PrácticaErick Angel MPAún no hay calificaciones

- Coeficiente de variaciónDocumento22 páginasCoeficiente de variaciónRoy Rojas AmarilloAún no hay calificaciones

- Diseño de experimentos estadísticos para procesos químicosDocumento22 páginasDiseño de experimentos estadísticos para procesos químicosJC PachecoAún no hay calificaciones

- Muestreo EstratificadoDocumento2 páginasMuestreo EstratificadoIrma Rosa SmithAún no hay calificaciones

- Correlacion y Regresión LinealDocumento65 páginasCorrelacion y Regresión LinealLuisa Fernanda Román RuizAún no hay calificaciones

- Examen 2 Ismael LemaDocumento6 páginasExamen 2 Ismael LemaGilson Emilio MonserrateAún no hay calificaciones

- Trabajo 4 Laboratorio Estadística Descriptiva UnadDocumento10 páginasTrabajo 4 Laboratorio Estadística Descriptiva UnadAngela Lopez0% (1)

- Dbca MinitabDocumento5 páginasDbca MinitabPedrito TzaquimbioAún no hay calificaciones

- Protocolo Spss para Comparación de Medias (Paramétrica)Documento1 páginaProtocolo Spss para Comparación de Medias (Paramétrica)TonyBañuelosAún no hay calificaciones

- Primera Práctica DirigidaDocumento10 páginasPrimera Práctica DirigidaGustavo QInocenteAún no hay calificaciones

- Muestreo: conceptos clave, tipos y cálculo del tamaño de la muestraDocumento53 páginasMuestreo: conceptos clave, tipos y cálculo del tamaño de la muestraLuis Criollo100% (3)

- Resumen - Diseños Muestrales en La InvestigacionDocumento2 páginasResumen - Diseños Muestrales en La InvestigacionWilliamGayonaGalindoAún no hay calificaciones

- Actividad 2 Nicolas SuarezDocumento2 páginasActividad 2 Nicolas Suarezjuan sebastian hernandez pulidoAún no hay calificaciones

- Formulario Basico de EstadisticaDocumento4 páginasFormulario Basico de EstadisticaAlexisAún no hay calificaciones

- Estadistica 2 - Ejercicios Capitulo 4Documento14 páginasEstadistica 2 - Ejercicios Capitulo 4Karen FloresAún no hay calificaciones

- Guía 2Documento12 páginasGuía 2Douglas José MartíAún no hay calificaciones

- Formulario de probabilidad y estadísticaDocumento3 páginasFormulario de probabilidad y estadísticaAndre RomoAún no hay calificaciones

- MultiDocumento13 páginasMultiGuillermo VasquezAún no hay calificaciones

- Autoevaluacion 2 ParcialDocumento2 páginasAutoevaluacion 2 ParcialLeo CuadradoAún no hay calificaciones

- La Biblia de las Matemáticas RápidasDe EverandLa Biblia de las Matemáticas RápidasCalificación: 4.5 de 5 estrellas4.5/5 (19)

- Enseñar Matemática hoy: Miradas, sentidos y desafíosDe EverandEnseñar Matemática hoy: Miradas, sentidos y desafíosCalificación: 5 de 5 estrellas5/5 (1)

- Mentalidades matemáticas: Cómo liberar el potencial de los estudiantes mediante las matemáticas creativas, mensajes inspiradores y una enseñanza innovadoraDe EverandMentalidades matemáticas: Cómo liberar el potencial de los estudiantes mediante las matemáticas creativas, mensajes inspiradores y una enseñanza innovadoraCalificación: 4.5 de 5 estrellas4.5/5 (5)

- Curso rápido sobre magia del caos. El hobby oculto de ricos y famosos.De EverandCurso rápido sobre magia del caos. El hobby oculto de ricos y famosos.Calificación: 5 de 5 estrellas5/5 (42)

- Introducción a la Estadística BayesianaDe EverandIntroducción a la Estadística BayesianaCalificación: 5 de 5 estrellas5/5 (2)

- Metodología de la investigación científicaDe EverandMetodología de la investigación científicaCalificación: 3.5 de 5 estrellas3.5/5 (7)

- Sesgos Cognitivos: Una Fascinante Mirada dentro de la Psicología Humana y los Métodos para Evitar la Disonancia Cognitiva, Mejorar sus Habilidades para Resolver Problemas y Tomar Mejores DecisionesDe EverandSesgos Cognitivos: Una Fascinante Mirada dentro de la Psicología Humana y los Métodos para Evitar la Disonancia Cognitiva, Mejorar sus Habilidades para Resolver Problemas y Tomar Mejores DecisionesCalificación: 4.5 de 5 estrellas4.5/5 (13)

- Estadística básica: Introducción a la estadística con RDe EverandEstadística básica: Introducción a la estadística con RCalificación: 5 de 5 estrellas5/5 (8)

- La Teoría de Conjuntos y los Fundamentos de las MatemáticasDe EverandLa Teoría de Conjuntos y los Fundamentos de las MatemáticasCalificación: 5 de 5 estrellas5/5 (1)

- Nuevo manual de Reflexología: El método más completo y actual sobre las técnicas, la práctica y la teoría de la ciencia reflexológicaDe EverandNuevo manual de Reflexología: El método más completo y actual sobre las técnicas, la práctica y la teoría de la ciencia reflexológicaCalificación: 4.5 de 5 estrellas4.5/5 (16)

- Didáctica de la matemática en la escuela primariaDe EverandDidáctica de la matemática en la escuela primariaCalificación: 2.5 de 5 estrellas2.5/5 (3)

- Mi proyecto escolar Matemáticas Lúdicas: Adaptaciones curriculares para preescolar, primaria y secundariaDe EverandMi proyecto escolar Matemáticas Lúdicas: Adaptaciones curriculares para preescolar, primaria y secundariaCalificación: 5 de 5 estrellas5/5 (5)

- Inteligencia artificial: Lo que usted necesita saber sobre el aprendizaje automático, robótica, aprendizaje profundo, Internet de las cosas, redes neuronales, y nuestro futuroDe EverandInteligencia artificial: Lo que usted necesita saber sobre el aprendizaje automático, robótica, aprendizaje profundo, Internet de las cosas, redes neuronales, y nuestro futuroCalificación: 4 de 5 estrellas4/5 (1)

- Control de calidad. Un enfoque integral y estadísticoDe EverandControl de calidad. Un enfoque integral y estadísticoCalificación: 5 de 5 estrellas5/5 (8)

- Introducción a las ecuaciones de la física matemáticaDe EverandIntroducción a las ecuaciones de la física matemáticaCalificación: 5 de 5 estrellas5/5 (4)

- Psicoterapia psicoanalítica: Investigación, evaluación y práctica clínicaDe EverandPsicoterapia psicoanalítica: Investigación, evaluación y práctica clínicaAún no hay calificaciones

- Qué es (y qué no es) la estadística: Usos y abusos de una disciplina clave en la vida de los países y las personasDe EverandQué es (y qué no es) la estadística: Usos y abusos de una disciplina clave en la vida de los países y las personasCalificación: 4.5 de 5 estrellas4.5/5 (3)

- Econometría: modelos econométricos y series temporales. Tomo 2: Con los paquetes micro-TSP y TSPDe EverandEconometría: modelos econométricos y series temporales. Tomo 2: Con los paquetes micro-TSP y TSPAún no hay calificaciones

- Cuántica: Qué significa la teoría de la ciencia más extrañaDe EverandCuántica: Qué significa la teoría de la ciencia más extrañaCalificación: 1 de 5 estrellas1/5 (1)

- Métodos cuantitativos 4a Ed. Herramientas para la investigación en saludDe EverandMétodos cuantitativos 4a Ed. Herramientas para la investigación en saludCalificación: 4 de 5 estrellas4/5 (1)

- Probabilidad y estadística: un enfoque teórico-prácticoDe EverandProbabilidad y estadística: un enfoque teórico-prácticoCalificación: 4 de 5 estrellas4/5 (40)

- Modelización matemática en el aula: Posibilidades y necesidadesDe EverandModelización matemática en el aula: Posibilidades y necesidadesCalificación: 5 de 5 estrellas5/5 (1)

- El ADN espiritual: Método de iluminación espiritualDe EverandEl ADN espiritual: Método de iluminación espiritualCalificación: 4.5 de 5 estrellas4.5/5 (16)

- Introducción a la estadística matemáticaDe EverandIntroducción a la estadística matemáticaCalificación: 5 de 5 estrellas5/5 (2)