Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Modelo Cinemático para Data Sensor Fusion

Cargado por

Oscar Montañez0 calificaciones0% encontró este documento útil (0 votos)

8 vistas1 páginaTítulo original

Modelo Cinemático Para Data Sensor Fusion

Derechos de autor

© © All Rights Reserved

Formatos disponibles

PDF, TXT o lea en línea desde Scribd

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

© All Rights Reserved

Formatos disponibles

Descargue como PDF, TXT o lea en línea desde Scribd

0 calificaciones0% encontró este documento útil (0 votos)

8 vistas1 páginaModelo Cinemático para Data Sensor Fusion

Cargado por

Oscar MontañezCopyright:

© All Rights Reserved

Formatos disponibles

Descargue como PDF, TXT o lea en línea desde Scribd

Está en la página 1de 1

MODELO CINEMÁTICO PARA DATA SENSOR FUSION

EN VEHÍCULO VOLADOR NO TRIPULADO

Oscar Javier Montañez Sogamoso

GINTEL

oscarjavier.montanez@uptc.edu.co

Resumen

Los sistemas de navegación autónoma actuales, exigen en su

correcto funcionar la implementación de conjuntos de sensores

que permitan medir una misma variables a partir de fenómenos

físicos a menudo diferentes. Brindando una segunda perspectiva

al controlador-pc cerebro del sistema autónomo[1-2]. Esta

implementación de conjunto de sensores hace uso de diferentes

técnicas: estadística[3], de lógica difusa y para el caso de este

trabajo el filtro Kalman Extendido (Extended Kalman Filter,

EKF)[4]. Esta último, parte del modelado cinemático en el que la

fusión de sensores tiene lugar y a partir de ahí lograr una efectiva

fusión de datos, filtrados contra las posibles incertidumbres en

mediciones realizadas por los sensores al sistema medido[5].

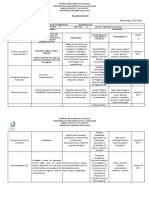

Fig. 1. Revisión de Estado del Arte

Formulación del problema

Examinar la posibilidad de generar un filtro Kalman para la

fusión de sensores LiDAR y RADAR en un vehículo volador no

tripulado omnidireccional, a partir de los trabajos previos Resultados

realizados por autores con respecto a la navegación autónoma de Las ecuaciones obtenidas corresponden a:

vehículos automotores.

Objetivos

General Generar un modelo para la fusión de datos de sensores

haciendo uso de un EKF para un Sensor LiDAR y un radar.

Específicos:

• Identificar trabajos previos realizados por diferentes autores en

el tema de EKF para ser implementados en un vehículo

volador omnidireccional.

• Generar un modelo cinemático para la fusión de sensores.

• Garantizar un bajo uso de CPU para eficiencia energética.

• Plantear escenarios de simulación para evaluar el desempeño del

modelo propuesto.

Metodología Bibliografía

El proceso de investigación tiene su inicio con la revisión de [1] T. Kim, J. Lee and T. Park, "Fusing Lidar, Radar, and Camera Using Extended Kalman Filter for

Estimating the Forward Position of Vehicles," 2019 IEEE International Conference on Cybernetics

trabajos previos: artículos, tesis y libros sobre el tema en busca and Intelligent Systems (CIS) and IEEE Conference on Robotics, Automation and Mechatronics

de modelos allegados al objetivo de esta investigación. Teniendo (RAM), 2019, pp. 374-379, doi: 10.1109/CIS-RAM47153.2019.9095859

[2] Y. Wang, D. Liu and E. Matson, "Accurate Perception for Autonomous Driving: Application of

en cuenta factores como: Kalman Filter for Sensor Fusion," 2020 IEEE Sensors Applications Symposium (SAS), 2020, pp. 1-

6, doi: 10.1109/SAS48726.2020.9220083.

- ¿Cuáles son los métodos para fusión de datos de sensores más [3] J. Han, J. Kim and N. Son, "Persistent automatic tracking of multiple surface vessels by fusing

usados por los diferentes autores? radar and lidar," OCEANS 2017 - Aberdeen, 2017, pp. 1-5, doi: 10.1109/OCEANSE.2017.8084714.

[4] B. Kim, K. Yi, H. Yoo, H. Chong and B. Ko, "An IMM/EKF Approach for Enhanced

-¿Cuáles son los modelos cinemáticos mas convenientes para el Multitarget State Estimation for Application to Integrated Risk Management System," in IEEE

modelado del sistema teniendo en cuenta qué se hará uso de un Transactions on Vehicular Technology, vol. 64, no. 3, pp. 876-889, March 2015, doi:

10.1109/TVT.2014.2329497.

sensor LiDAR y un RADAR? [5] H. Lee, H. Chae, K Yi, “A geometric Model based 2D LiDAR/Radar Sensor Fusion Tracking

Surronounding Vehicles” 2019 International Federation of Automatic Control hosting by Elseiver

(IFAC), 2019, pp 131-135, doi: 10.1016/j.ifacol.2019.08.060.

Centro de Gestión de

Investigación y Extensión de la

Facultad Seccional Sogamoso

También podría gustarte

- Modal identification using smart mobile sensing unitsDe EverandModal identification using smart mobile sensing unitsAún no hay calificaciones

- Procesamiento de ImágenesDocumento7 páginasProcesamiento de ImágenesPe ErickAún no hay calificaciones

- Chen 2021Documento13 páginasChen 2021Edwin GordonAún no hay calificaciones

- CONIITEC 2016 Paper CDocumento7 páginasCONIITEC 2016 Paper CLeonidas Zapata OlivaresAún no hay calificaciones

- CONIITEC - 2016 - Paper - Reconocimiento de Imagenes Visual StudioDocumento7 páginasCONIITEC - 2016 - Paper - Reconocimiento de Imagenes Visual Studiocesar fernando muro velasquezAún no hay calificaciones

- Cosimir Robotica AndreaDocumento2 páginasCosimir Robotica AndreaPablo Alfonso Gonzalez Gomez100% (1)

- Desarrollo de Una Aplicación Móvil Utilizando El Framework MEAN Stack e IONIC Un Estudio de Caso en Una Compañíade TransporteDocumento6 páginasDesarrollo de Una Aplicación Móvil Utilizando El Framework MEAN Stack e IONIC Un Estudio de Caso en Una Compañíade TransporteJonahAún no hay calificaciones

- Aplicaciones para Redes VanetDocumento23 páginasAplicaciones para Redes VanetDiego IdkAún no hay calificaciones

- Tipos de Sensores Que Se Utilizan en La Auto Localización de Robots MóvilesDocumento4 páginasTipos de Sensores Que Se Utilizan en La Auto Localización de Robots MóvilesedwinAún no hay calificaciones

- Articulo Cientifico - Borrador - Sistema de Control para EstacionamientosDocumento2 páginasArticulo Cientifico - Borrador - Sistema de Control para EstacionamientosAriel José SerrutAún no hay calificaciones

- Articulo IEEE Analisis de VariablesDocumento5 páginasArticulo IEEE Analisis de Variablesdavid munozAún no hay calificaciones

- Diseño de Un Brazo Robotico de Configuracion CilindricaDocumento33 páginasDiseño de Un Brazo Robotico de Configuracion CilindricaMayc HerreraAún no hay calificaciones

- Un Enfoque de Aprendizaje Profundo para La Estimación de Segmentos de Movimiento para TuberíasDocumento8 páginasUn Enfoque de Aprendizaje Profundo para La Estimación de Segmentos de Movimiento para TuberíasJose Carlos Carpio RodriguezAún no hay calificaciones

- AscensorDocumento14 páginasAscensorSneyder ZabalaAún no hay calificaciones

- tesis- sensores inerciales en conducción autónomaDocumento9 páginastesis- sensores inerciales en conducción autónomaToño MtzAún no hay calificaciones

- Software PVSize Desempeno en SimulacionDocumento6 páginasSoftware PVSize Desempeno en Simulacionjuanjo.cort84Aún no hay calificaciones

- Análisis de Elementos Finitos Aplicado Trabajo Mario, Jorge e IsaacDocumento23 páginasAnálisis de Elementos Finitos Aplicado Trabajo Mario, Jorge e IsaacIsaac Tapias CerroAún no hay calificaciones

- Tesis Edwin Laniado JacomeDocumento230 páginasTesis Edwin Laniado JacomeJesus Ticona TiconaAún no hay calificaciones

- 673571177008 Satelital.pdfDocumento37 páginas673571177008 Satelital.pdfGianPierre Veliendres RojasAún no hay calificaciones

- Proyecto de Una Robotica MovilDocumento13 páginasProyecto de Una Robotica Moviljesus de la cruzAún no hay calificaciones

- Diseño de un guante de datos con sensores de flexibilidad y acelerómetroDocumento7 páginasDiseño de un guante de datos con sensores de flexibilidad y acelerómetroEduardo ReyesAún no hay calificaciones

- Telemetria en Tiempo Real ArquitecturaDocumento9 páginasTelemetria en Tiempo Real Arquitecturafrank marcosAún no hay calificaciones

- DDP en vehículos eléctricos para mejorar baterías, conducción y seguridad vialDocumento8 páginasDDP en vehículos eléctricos para mejorar baterías, conducción y seguridad vialMARIA ISABEL RAMOS TOCORAAún no hay calificaciones

- Deteccion de Peatones en La Noche Usando Faster RDocumento10 páginasDeteccion de Peatones en La Noche Usando Faster RJorge ArribasAún no hay calificaciones

- VehÍculo Aéreo para La Adquisicion y TransmisiÓnDocumento1 páginaVehÍculo Aéreo para La Adquisicion y TransmisiÓnfredy málagaAún no hay calificaciones

- Universidad Nacional de IngenieríaDocumento40 páginasUniversidad Nacional de IngenieríaLuis Huarcaya TorresAún no hay calificaciones

- Marco TeoricoDocumento24 páginasMarco TeoricobelkisbastidasAún no hay calificaciones

- Proyecto de InvestigacionDocumento7 páginasProyecto de InvestigacionSEBASTIAN DAVID FERNANDEZ VERTELAún no hay calificaciones

- Alcance de La Investigación Cualitativa Redaccion AcademicaDocumento2 páginasAlcance de La Investigación Cualitativa Redaccion AcademicaPaul MIERAún no hay calificaciones

- SesionesDocumento54 páginasSesionesJota JotaAún no hay calificaciones

- MODELO Y SIMULACION DINAMICA DE UNA BANDA TRANSPORTADORA - En.esDocumento3 páginasMODELO Y SIMULACION DINAMICA DE UNA BANDA TRANSPORTADORA - En.esJacko CardenasAún no hay calificaciones

- MecatroniaDocumento9 páginasMecatroniaJorge Alberto Velazquez CortesAún no hay calificaciones

- Plataforma StewartDocumento12 páginasPlataforma StewartJoseph Jason Gomez QuispeAún no hay calificaciones

- Simulación MEMS acelerómetro superficieDocumento5 páginasSimulación MEMS acelerómetro superficieCARLOS SEBASTIAN BLAS PERALTAAún no hay calificaciones

- Ensamble y Simulación Selladora de BolsasDocumento7 páginasEnsamble y Simulación Selladora de BolsasLeonardo JaramilloAún no hay calificaciones

- Articulo SimulacionDocumento4 páginasArticulo SimulacionR Soledad SolAún no hay calificaciones

- Tarea 03Documento5 páginasTarea 03Aaron Bautista CastañedaAún no hay calificaciones

- 2022 Ramajo Ballester Alvaro Reidentificacion de Vehiculos Mediante Tecnicas de Deep LearningDocumento9 páginas2022 Ramajo Ballester Alvaro Reidentificacion de Vehiculos Mediante Tecnicas de Deep LearningManuel EliasAún no hay calificaciones

- InformeDocumento11 páginasInformeEdinson Balcazar RivasAún no hay calificaciones

- Diagnosis Electronica Del AutomovilDocumento357 páginasDiagnosis Electronica Del AutomovilMiguel Camacho89% (28)

- Informe Proyecto Integrador 2020Documento8 páginasInforme Proyecto Integrador 2020Diego RoaAún no hay calificaciones

- Pasado y Presente en El Diagnóstico de Los Motores en Los Talleres de Servicio Automotor. Del Vacuómetro A Los Sistemas Basados en La NubeDocumento19 páginasPasado y Presente en El Diagnóstico de Los Motores en Los Talleres de Servicio Automotor. Del Vacuómetro A Los Sistemas Basados en La Nubecaimcaife2023Aún no hay calificaciones

- 8.resumenejecutivo - Equipo de Bajo Costo 19dic18 - Tono2018Documento5 páginas8.resumenejecutivo - Equipo de Bajo Costo 19dic18 - Tono2018sopasguillermo1Aún no hay calificaciones

- Deteccion de SismosDocumento50 páginasDeteccion de SismosJunior Orosco CasasAún no hay calificaciones

- Pyd Segunda PresentacionDocumento23 páginasPyd Segunda PresentacionLIZARDO TOMAS TAVARA VASQUEZAún no hay calificaciones

- IA PapperDocumento4 páginasIA PapperyamilexAún no hay calificaciones

- Sistema de alerta GPS para accidentes de motocicletasDocumento7 páginasSistema de alerta GPS para accidentes de motocicletasalfonsoAún no hay calificaciones

- Formato Articulo Extenso - TanqueDeGuerraDocumento2 páginasFormato Articulo Extenso - TanqueDeGuerraUlises Román MurilloAún no hay calificaciones

- Diagnosis Electrónica Del AutomotorDocumento357 páginasDiagnosis Electrónica Del Automotorperrokin30100% (4)

- Administración de redes LAN. Ejercicios prácticos con GNS3De EverandAdministración de redes LAN. Ejercicios prácticos con GNS3Aún no hay calificaciones

- Modelado y simulación de redes. Aplicación de QoS con opnet modelerDe EverandModelado y simulación de redes. Aplicación de QoS con opnet modelerAún no hay calificaciones

- La investigación en ingeniería: Análisis y solución de casos desde el aulaDe EverandLa investigación en ingeniería: Análisis y solución de casos desde el aulaCalificación: 4 de 5 estrellas4/5 (2)

- Activación de un Laboratorio de Telecomunicaciones: Telecomunicaciones y Electrónica, #1De EverandActivación de un Laboratorio de Telecomunicaciones: Telecomunicaciones y Electrónica, #1Aún no hay calificaciones

- Manual de implementación de herramientas digitales para el desarrollo sostenibleDe EverandManual de implementación de herramientas digitales para el desarrollo sostenibleCalificación: 5 de 5 estrellas5/5 (1)

- Desarrollo del proyecto de la red telemática. IFCT0410De EverandDesarrollo del proyecto de la red telemática. IFCT0410Aún no hay calificaciones

- Control de movimiento en manufactura. Automatización CNC fundamentos de diseño y modelamiento experimentalDe EverandControl de movimiento en manufactura. Automatización CNC fundamentos de diseño y modelamiento experimentalCalificación: 5 de 5 estrellas5/5 (4)

- Guía práctica de Kubernetes: Proyectos para crear aplicaciones de éxito con KubernetesDe EverandGuía práctica de Kubernetes: Proyectos para crear aplicaciones de éxito con KubernetesAún no hay calificaciones

- Implementación SGSI 40Documento52 páginasImplementación SGSI 40Jhon Henry Velarde VidalAún no hay calificaciones

- N° de Orden 1Documento38 páginasN° de Orden 1daas estudio creativoAún no hay calificaciones

- Reinstalar GrubDocumento9 páginasReinstalar GrubPablo Pereda GonzalesAún no hay calificaciones

- Flujo Proctor Modificado UY S - 17 - 89Documento1 páginaFlujo Proctor Modificado UY S - 17 - 89jmario85Aún no hay calificaciones

- Laboratorio 03-2021Documento2 páginasLaboratorio 03-2021Leiner Amilcar Rios VictorioAún no hay calificaciones

- Manual de Control de Calidad, Secciòn 4Documento2 páginasManual de Control de Calidad, Secciòn 4dany leonardoAún no hay calificaciones

- Fundamentos de la hidráulica: principios, componentes y aplicacionesDocumento100 páginasFundamentos de la hidráulica: principios, componentes y aplicacionesAlexis PerezAún no hay calificaciones

- Smart Home BenefitsDocumento3 páginasSmart Home BenefitsRafael CamargoAún no hay calificaciones

- Vitcria - Ferreira Hashiras - Shinobu - Kocho - PortDocumento25 páginasVitcria - Ferreira Hashiras - Shinobu - Kocho - PortMarisaSonneAún no hay calificaciones

- Sesion 4 - Conociendo Los Comandos en LinuxDocumento4 páginasSesion 4 - Conociendo Los Comandos en Linuxmanuel altamiranoAún no hay calificaciones

- Guia Planeacion 1Documento30 páginasGuia Planeacion 1Stella AyalaAún no hay calificaciones

- Caracteristicas de AccessDocumento5 páginasCaracteristicas de AccesschifiroAún no hay calificaciones

- Diseño de Plan General de BloqueDocumento2 páginasDiseño de Plan General de BloqueOsmar SalesAún no hay calificaciones

- Autoevaluación 2 - Gestion de Mantenimiento (44625)Documento5 páginasAutoevaluación 2 - Gestion de Mantenimiento (44625)Susanasmm SusanasmmAún no hay calificaciones

- Puentes - Uni Clase 1bDocumento239 páginasPuentes - Uni Clase 1bMila 13Aún no hay calificaciones

- Algoritmo de Cuadrados MediosDocumento11 páginasAlgoritmo de Cuadrados Mediosgloria casillaAún no hay calificaciones

- PR-PRO-06 - V01 - Reparacion de Obras de Arte y DrenajeDocumento7 páginasPR-PRO-06 - V01 - Reparacion de Obras de Arte y DrenajeCarlosVincedChirinosAún no hay calificaciones

- Sistema de Ecuaciones LinealesDocumento6 páginasSistema de Ecuaciones LinealesSERG100% (1)

- Brushless - Flujo AxialDocumento4 páginasBrushless - Flujo AxialPatricio VallejosAún no hay calificaciones

- Planificación matemáticas aplicando TICsDocumento2 páginasPlanificación matemáticas aplicando TICselias rodriguezAún no hay calificaciones

- Proyecto FinalDocumento1 páginaProyecto FinalMARTIN QUIMBAY JESSICA ALEJANDRAAún no hay calificaciones

- Final Práctico CCNA1Documento7 páginasFinal Práctico CCNA1cristian zuletaAún no hay calificaciones

- Validación instrumentos investigación UMSADocumento22 páginasValidación instrumentos investigación UMSADaniel Campuzano BolañosAún no hay calificaciones

- Punto 2 Carta Inicio ActividadesDocumento1 páginaPunto 2 Carta Inicio ActividadesjvilloutaAún no hay calificaciones

- S3 IM2 Presentación de ClaseDocumento21 páginasS3 IM2 Presentación de ClasePablo sandovalAún no hay calificaciones

- Informe 9 - Metodologia SemDocumento3 páginasInforme 9 - Metodologia SemGonzalo ReyesAún no hay calificaciones

- Torre Galería FloridaDocumento2 páginasTorre Galería FloridaLiseth ArroyaveAún no hay calificaciones

- ComputadoraDocumento10 páginasComputadoraJack BlackssAún no hay calificaciones

- Catalogo Sistema de Electrobarras ZucchiniDocumento166 páginasCatalogo Sistema de Electrobarras ZucchiniWALTERAún no hay calificaciones

- Cot-000223-1.0 Plat-18-Hp-RcgDocumento3 páginasCot-000223-1.0 Plat-18-Hp-RcgDaniel CoronadoAún no hay calificaciones