Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Semana 09 Investigacion de Operaciones

Cargado por

Ana Hernandez0 calificaciones0% encontró este documento útil (0 votos)

4 vistas3 páginasTítulo original

SEMANA 09 INVESTIGACION DE OPERACIONES

Derechos de autor

© © All Rights Reserved

Formatos disponibles

PDF, TXT o lea en línea desde Scribd

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

© All Rights Reserved

Formatos disponibles

Descargue como PDF, TXT o lea en línea desde Scribd

0 calificaciones0% encontró este documento útil (0 votos)

4 vistas3 páginasSemana 09 Investigacion de Operaciones

Cargado por

Ana HernandezCopyright:

© All Rights Reserved

Formatos disponibles

Descargue como PDF, TXT o lea en línea desde Scribd

Está en la página 1de 3

Campus San Nicolas

Alumna: Ana Teresa Cano Hernandez

Maestro: Valeria Spront

Materia: Investigacion de Operaciones

Matricula: 211043641

Grado: 7 LC

Salinas Victoria, N.L

18-oct-2023

Análisis de Markov.

¿Qué es una cadena de Markov?

Una cadena de Markov es un proceso estocástico especial. El objetivo es dar

probabilidades de sucesos futuros al aplicar esta cadena. Esta cadena de Markov

está definida de tal manera que, incluso conociendo sólo una parte de la historia

pasada, la previsión de un acontecimiento futuro es tan buena como si se

conociera toda la historia pasada de un proceso.

Las cadenas de Markov pueden distinguirse según distintos órdenes. Así, una

cadena de Markov de primer orden se define de tal manera que el estado futuro de

un proceso sólo está condicionado por el estado actual y no está influido por los

estados pasados. La formulación matemática puede requerir únicamente la noción

de una distribución discreta y una probabilidad condicional en el caso de un

conjunto finito de estados y los conceptos de una filtración y una expectativa

condicional en el caso de tiempo continuo.

Las cadenas de Markov pueden utilizarse de forma excelente para modelar

cambios de estado aleatorios en un sistema, si hay motivos para suponer que los

cambios de estado sólo se influyen mutuamente durante periodos de tiempo

limitados o que incluso carecen de memoria.

Existen cadenas de Markov finitas discretas y cadenas de Markov infinitas

discretas.

¿Para qué sirven las cadenas de Markov?

Las cadenas de Markov son modelos sencillos y descriptivos para representar

matemáticamente con precisión procesos del mundo real. Por ejemplo, dadas

unas probabilidades conocidas y supuestamente constantes, es posible predecir el

estado probable de un sistema para cualquier futuro. Las cadenas de Markov son

la base de los procesos estocásticos, que, por un lado, pueden basarse en la

aleatoriedad sin memoria y, por otro, pueden ser posibles con transiciones de

estado a probabilidades dadas en cada caso. Las cadenas de Markov pueden

modelar redes de Petri estocásticas generales y clasificaciones basadas en

recomendaciones subjetivas.

¿Cuáles son los ámbitos de aplicación?

Las cadenas de Markov se utilizan, por ejemplo, en los filtros de spam, que son

mucho más eficaces que los filtros bayesianos. Los procesos de colas y las

distribuciones de probabilidad de objetos en sistemas en movimiento también

pueden calcularse muy fácilmente. Además, es posible crear una clasificación

objetiva para todo el sistema a partir de muchas recomendaciones subjetivas.

El PageRank de Google también se basa en cadenas de Markov. Las aplicaciones

clásicas son las colas y los tipos de cambio. El comportamiento de una presa

también puede modelizarse con ayuda de una cadena de Markov. También es

posible modelizar un sistema de control de velocidad para vehículos de motor.

También es posible la evaluación analítica de algoritmos de movilidad, como el

paseo aleatorio.

La dinámica de poblaciones también puede modelizarse para predecir el

crecimiento de la población humana o animal. También puede modelizarse el

movimiento molecular browniano. La programación estadística y la simulación de

distribuciones de equilibrio con el software "Statistik Software R" son

especialmente relevantes.

También podría gustarte

- Tarea 6 F.C I.O PDFDocumento4 páginasTarea 6 F.C I.O PDFAngie MosqueraAún no hay calificaciones

- Cadenas de MarkovDocumento7 páginasCadenas de Markovtadeanguiano086Aún no hay calificaciones

- La Cadena de MarkovDocumento4 páginasLa Cadena de MarkovCabal Geovanny JosuaAún no hay calificaciones

- Cadenas de Markov: Trabajo de Investigación Unidad 4 Que PresentaDocumento19 páginasCadenas de Markov: Trabajo de Investigación Unidad 4 Que PresentaPEDRO ZEPEDA SANCHEZ100% (1)

- InvestigacionOperacionesII - Tarea #7 Cadenas de MarkovDocumento3 páginasInvestigacionOperacionesII - Tarea #7 Cadenas de Markovl22210839Aún no hay calificaciones

- Investigación de Operaciones II U4Documento19 páginasInvestigación de Operaciones II U4Karla Avila100% (1)

- Cadena de MarkovDocumento5 páginasCadena de MarkovSergio Ochoa100% (1)

- Tarea 6 F.C I.O PDFDocumento6 páginasTarea 6 F.C I.O PDFAngie MosqueraAún no hay calificaciones

- Cadenas Markov PDFDocumento8 páginasCadenas Markov PDFAnonymous gR34gQAún no hay calificaciones

- Investigación OperativaDocumento32 páginasInvestigación OperativaMarcos Bartra PerezAún no hay calificaciones

- TREVIÑO LOPEZ Cadenas de MarkovDocumento15 páginasTREVIÑO LOPEZ Cadenas de Markovmaxibrooks144Aún no hay calificaciones

- ResumenProcesosMarkovianos AlissonMurilloDocumento4 páginasResumenProcesosMarkovianos AlissonMurilloalissonAún no hay calificaciones

- Introducción A Las Cadenas de MarkovDocumento2 páginasIntroducción A Las Cadenas de MarkovCarlosCarrilloAún no hay calificaciones

- Cadenas de Markov - U4 - SSANCHEZ LOPEZ KATHERYNE XIMENAADocumento23 páginasCadenas de Markov - U4 - SSANCHEZ LOPEZ KATHERYNE XIMENAA21460327Aún no hay calificaciones

- Unidad No 3 Ensayo 122021Documento20 páginasUnidad No 3 Ensayo 122021IVANNA MERAZAún no hay calificaciones

- Resumen Procesos MarkovianosDocumento4 páginasResumen Procesos MarkovianosalissonAún no hay calificaciones

- Cadenas de MarkovDocumento4 páginasCadenas de MarkovAna SantanaAún no hay calificaciones

- Cadena de MarkovDocumento7 páginasCadena de MarkovCarlos ZFAún no hay calificaciones

- Actividad 1 T4 Cuadro Sinoptico PDFDocumento5 páginasActividad 1 T4 Cuadro Sinoptico PDFFrancisco GalvanAún no hay calificaciones

- Cadenas de MarkovDocumento13 páginasCadenas de MarkovKimberly Ariana Castillo LovatonAún no hay calificaciones

- Cadenas de MarkovDocumento9 páginasCadenas de MarkovMauricioAún no hay calificaciones

- Cadenasdemarkov Unidad 4Documento8 páginasCadenasdemarkov Unidad 4feliizzAún no hay calificaciones

- Investigacion Proceso MarkovianoDocumento6 páginasInvestigacion Proceso MarkovianoGracely MaldonadoAún no hay calificaciones

- Operacion 3Documento5 páginasOperacion 3Ambar RodriguezAún no hay calificaciones

- Cadena de Markov. Grupo 3Documento26 páginasCadena de Markov. Grupo 3Aldair Vega AlbanAún no hay calificaciones

- Cadenas de Markov.Documento8 páginasCadenas de Markov.Luis Luna RamírezAún no hay calificaciones

- Cadenas de Markov - Io IiDocumento5 páginasCadenas de Markov - Io IiDamian KuAún no hay calificaciones

- UNIDAD2 KarenFRANCODocumento3 páginasUNIDAD2 KarenFRANCOpekdoraAún no hay calificaciones

- Introducción A Las Cadenas o Procesos de MarkovDocumento2 páginasIntroducción A Las Cadenas o Procesos de MarkovCarlosCarrilloAún no hay calificaciones

- Cadena Da MarkovDocumento12 páginasCadena Da MarkovAnna Lizeth AlmendarezAún no hay calificaciones

- Modelo de MarkovDocumento105 páginasModelo de MarkovEliezer VerasAún no hay calificaciones

- Cadena de MarkovDocumento4 páginasCadena de MarkovGesse SteinerAún no hay calificaciones

- Cadenas 1Documento89 páginasCadenas 1Cinthia PecinaAún no hay calificaciones

- Qué EsDocumento96 páginasQué EsFelix Americo QuispeAún no hay calificaciones

- Cadenas de Markov.Documento10 páginasCadenas de Markov.Luis Luna RamírezAún no hay calificaciones

- Analisis de MarkovDocumento18 páginasAnalisis de MarkovMilthon Loza ChambillaAún no hay calificaciones

- Cadenas de Markov - AdrianaPonce PDFDocumento13 páginasCadenas de Markov - AdrianaPonce PDFBeatriz PonceAún no hay calificaciones

- Investigacion Segundo ParcialDocumento10 páginasInvestigacion Segundo ParcialcindyAún no hay calificaciones

- R 66900Documento30 páginasR 66900as_oleo_mys_ca100% (1)

- Tema Nº3 - Cadenas de Eventos - Analisis de MarkovDocumento59 páginasTema Nº3 - Cadenas de Eventos - Analisis de MarkovKarina Belizario100% (1)

- Cadenas de MarkovDocumento9 páginasCadenas de MarkovDANITZA KATHERINE JUANEZAún no hay calificaciones

- Unidad.-Iv - Cadenas de MarkovDocumento2 páginasUnidad.-Iv - Cadenas de MarkovEduardo Hdz Hdz0% (1)

- Investigacion de Operaciones Unidad 4Documento21 páginasInvestigacion de Operaciones Unidad 4Victor CastilloAún no hay calificaciones

- Articulo OperacionesDocumento9 páginasArticulo OperacionesDanielaAndreaRoldanAún no hay calificaciones

- Inestigacion Cadenas de MarkovDocumento10 páginasInestigacion Cadenas de MarkovPaco Castillo100% (2)

- Cadenas de Markov.Documento8 páginasCadenas de Markov.Luis Luna RamírezAún no hay calificaciones

- Cadenas de MarkovDocumento5 páginasCadenas de MarkovMICHEL VALERIA BURGOS TORRESAún no hay calificaciones

- Cadenas de MarkovDocumento17 páginasCadenas de MarkovOskarSanchezAún no hay calificaciones

- Javier Nava 29574304 M - S - II A - 4Documento7 páginasJavier Nava 29574304 M - S - II A - 4Javier NavaAún no hay calificaciones

- Investigacion Cadenas de Markov.Documento10 páginasInvestigacion Cadenas de Markov.yoAún no hay calificaciones

- Cadenas de MarkovDocumento36 páginasCadenas de MarkovKeivis Jaramillo RamosAún no hay calificaciones

- Tarea 4.1 EnsayoDocumento12 páginasTarea 4.1 Ensayolupita sernaAún no hay calificaciones

- Cadenas de MarkovDocumento8 páginasCadenas de MarkovAnonymous gR34gQ50% (2)

- Cadenas de MarkovDocumento11 páginasCadenas de MarkovEdgar Castillo AmadoAún no hay calificaciones

- Cadenas Markov TerminadoDocumento58 páginasCadenas Markov TerminadoMarcelo SourAún no hay calificaciones

- Unidad 4Documento11 páginasUnidad 4Humberto Prestegui0% (3)

- Unidad 4Documento11 páginasUnidad 4Jovyt Lopez miguelAún no hay calificaciones

- Cadena de MarkovDocumento18 páginasCadena de MarkovnelmaryAún no hay calificaciones

- Álgebra abstracta aplicada en ingeniería: casos de aplicación en sistemas difusos tipo 1 y tipo 2De EverandÁlgebra abstracta aplicada en ingeniería: casos de aplicación en sistemas difusos tipo 1 y tipo 2Aún no hay calificaciones

- Semana 09 CostosDocumento3 páginasSemana 09 CostosAna HernandezAún no hay calificaciones

- Constancia de Asistencia. DefensorasDDHHPeriodistasDocumento1 páginaConstancia de Asistencia. DefensorasDDHHPeriodistasAna HernandezAún no hay calificaciones

- Semana 04 CntribucionesDocumento4 páginasSemana 04 CntribucionesAna HernandezAún no hay calificaciones

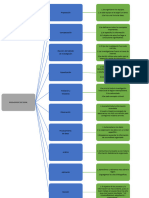

- Cuadro SinopticoDocumento1 páginaCuadro SinopticoAna HernandezAún no hay calificaciones

- Diapositivas Promotor Cultural 5to e #4Documento10 páginasDiapositivas Promotor Cultural 5to e #4Ana HernandezAún no hay calificaciones

- 7TACTFINALCONTADocumento8 páginas7TACTFINALCONTAAna HernandezAún no hay calificaciones

- Cultura GeneralDocumento2 páginasCultura GeneralAna HernandezAún no hay calificaciones

- Graficas de CarlosDocumento18 páginasGraficas de CarlosAna HernandezAún no hay calificaciones

- Mantenimiento Correctivo y PreventivoDocumento9 páginasMantenimiento Correctivo y PreventivoAna HernandezAún no hay calificaciones

- Semana 1 AuditoriaDocumento2 páginasSemana 1 AuditoriaAna HernandezAún no hay calificaciones

- Ejercicio de Cadenas de MarkovDocumento2 páginasEjercicio de Cadenas de MarkovDaved storiesAún no hay calificaciones

- Ejercicios de Cadenas de MarkovDocumento9 páginasEjercicios de Cadenas de MarkovVanne BadilloAún no hay calificaciones

- Cadenas de Markov 2 1 M14Documento69 páginasCadenas de Markov 2 1 M14EDWIN CASTROAún no hay calificaciones

- Procesos de Markov en La AdministraciónDocumento5 páginasProcesos de Markov en La AdministraciónpamelaAún no hay calificaciones

- Cadenas de Markov TrabajoDocumento23 páginasCadenas de Markov TrabajoKevo PachecoAún no hay calificaciones

- Cadenas de MarkovDocumento51 páginasCadenas de MarkovVirna JessicaAún no hay calificaciones

- 7016 MarkovDocumento14 páginas7016 MarkovAlejo JaraAún no hay calificaciones

- Proyecto II ALG LINEALDocumento18 páginasProyecto II ALG LINEALName is DaniAún no hay calificaciones

- Cadenas de Markov InvestigacionDocumento19 páginasCadenas de Markov InvestigacionedwinAún no hay calificaciones

- Unidad 6 Cadenas de Markov en Tiempo ContinuoDocumento23 páginasUnidad 6 Cadenas de Markov en Tiempo ContinuoBenjamin Zuñiga Carmona67% (3)

- Estados Recurrentes, Transitorios y Absorbentes - Parte 3Documento13 páginasEstados Recurrentes, Transitorios y Absorbentes - Parte 3MateGuatAún no hay calificaciones

- 2019 I CII2753 Modelos Estocasticos - Clase 2019-03-21 PDFDocumento14 páginas2019 I CII2753 Modelos Estocasticos - Clase 2019-03-21 PDFJavier RománAún no hay calificaciones

- Capítulo 5 - Sistemas de Espera - HandoutDocumento54 páginasCapítulo 5 - Sistemas de Espera - HandoutHarryKaneAún no hay calificaciones

- Cadenas de MarkovDocumento46 páginasCadenas de Markovwxv100% (1)

- Cadenas AbsorbentesDocumento15 páginasCadenas AbsorbentesSofia Navas50% (4)

- Tesis Apostador Vs CacinoDocumento58 páginasTesis Apostador Vs CacinoMarco AAún no hay calificaciones

- Tecnicas Cuantitativas para La Toma de DecisionesDocumento14 páginasTecnicas Cuantitativas para La Toma de DecisionesSamir Morales100% (1)

- SilaboPE 2021 2Documento4 páginasSilaboPE 2021 2Jhon Ortega GarciaAún no hay calificaciones

- Taller CMTD y CMTCDocumento4 páginasTaller CMTD y CMTCAlejandro Noguera BallenAún no hay calificaciones

- UNIDAD2 KarenFRANCODocumento3 páginasUNIDAD2 KarenFRANCOpekdoraAún no hay calificaciones

- Trabajo de HiguieneDocumento82 páginasTrabajo de HiguieneJosue TeodoroAún no hay calificaciones

- Guia de Nacimiento y Muerte y Colas (04!10!08)Documento25 páginasGuia de Nacimiento y Muerte y Colas (04!10!08)Agustin CesanAún no hay calificaciones

- 2 Cadenas de MarkovDocumento43 páginas2 Cadenas de MarkovgustavobenitesAún no hay calificaciones

- Trabajo 1 2 y 3er Parcial Analisis Cuantitativo Desicional VacafriaDocumento50 páginasTrabajo 1 2 y 3er Parcial Analisis Cuantitativo Desicional VacafriaLeslie VegaAún no hay calificaciones

- Resumen Matematica para EconomistasDocumento155 páginasResumen Matematica para EconomistasSantiago SeronelloAún no hay calificaciones

- Cadena de MarkovDocumento10 páginasCadena de MarkovAlexis Huaman VargasAún no hay calificaciones

- Software para La Investigación de OperacionesDocumento39 páginasSoftware para La Investigación de OperacionesLourdes Edith Bendezu Saravia50% (4)

- Procesos MarkovianosDocumento8 páginasProcesos MarkovianosArmando TrampaAún no hay calificaciones

- Programacion Estocastica 3er EncuentroDocumento26 páginasProgramacion Estocastica 3er EncuentroJulian ClavijoAún no hay calificaciones

- Antología Actividad 4Documento10 páginasAntología Actividad 4Antoniof GalavizAún no hay calificaciones