Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Guia N°4

Cargado por

Anonymous XqOKlgTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

Guia N°4

Cargado por

Anonymous XqOKlgCopyright:

Formatos disponibles

ESTADISTICA INFERENCIAL IND - 411

GUÍA N° 4

ESTIMACIÓN PUNTUAL

Proceso por el cual se realiza un análisis de la información para determinar un estimador

que permite representar o aproximar a un parámetro desconocido poblacional.

Estimador

Se llama estimador a cualquier función de n variables en la que, después de sustituir los

valores muéstrales, el resultado obtenido puede servir como sustituto del valor de un

parámetro poblacional. El estimador es una cantidad numérica calculada sobre una

muestra

Estimación

Valor numérico concreto que resulta de un estimador, cuando se calcula este sobre una

muestra.

Estimación Puntual

La estimación puntual del valor de un parámetro poblacional desconocido es un número

que se utiliza para aproximar al verdadero valor de dicho parámetro poblacional.

TIPO DE

FUNCIÓN MEDIA VARIANZA

FUNCIÓN

𝟏 𝟏

Exponencial 𝒇(𝒙, 𝝀) = 𝝀 ∗ 𝒆−𝝀𝒙 … … … … … … 𝒙 ≥ 𝟎 ̅=

𝑿 𝑽(𝑿) =

𝝀 𝝀𝟐

Exponencial 𝟏 −𝟏 𝒙

̅=𝝀

Negativa 𝒇(𝒙, 𝝀) = ∗ 𝒆 𝝀 ………………𝒙 ≥ 𝟎 𝑿 𝑽(𝑿) = 𝝀𝟐

𝝀

𝟏 (𝒙−𝝁)𝟐

−

Normal 𝒇(𝒙) = ∗𝒆 𝟐𝝈𝟐 ………− ∞ < 𝒙 < ∞ ̅=𝝁

𝑿 𝑽(𝑿) = 𝝈𝟐

√𝟐𝝅𝝈

𝒆−𝝀 ∗ 𝝀𝒙

Poisson 𝒇(𝒙, 𝝀) = ………………𝒙 ≥ 𝟎 ̅=𝝀

𝑿 𝑽(𝑿) = 𝝀

𝒙!

𝟏 𝒂+𝒃 (𝒃 − 𝒂)𝟐

Uniforme 𝒇(𝒙) = ………………𝒂 ≤ 𝒙 ≤ 𝒃 ̅=

𝑿 𝑽(𝑿) =

𝒃−𝒂 𝟐 𝟏𝟐

𝒏!

Binomial 𝒑(𝒙 = 𝒌) = 𝒑𝒌 𝒒𝒏−𝒌 ̅ = 𝒏𝒑

𝑿 𝑽(𝑿) = 𝒏𝒑𝒒

𝒌! (𝒏 − 𝒌)!

Verosimilitud de la Muestra

Univ. Liz Nohemi Serrano Yujra 1

ESTADISTICA INFERENCIAL IND - 411

Si 𝑋⃗ = (𝑋1 , 𝑋2 , 𝑋3 … … , 𝑋𝑛 ) es una muestra aleatoria de tamaño n, densidad o cuantía

conjunta de la muestra se denomina, verosimilitud de la muestra.

𝒏

⃗⃗⃗; 𝜽) = 𝑳(𝑿𝟏 , 𝑿𝟐 , 𝑿𝟑 … … … … , 𝑿𝒏 ; 𝜽) = ∏ 𝒇(𝑿𝒊 )

𝑳(𝑿

𝒊=𝟏

⃗⃗⃗; 𝜽) = 𝒇(𝑿𝟏 ; 𝜽)𝒇(𝑿𝟐 ; 𝜽)𝒇(𝑿𝟑 ; 𝜽) … … … … 𝒇(𝑿𝒏 ; 𝜽)

𝑳(𝑿

𝒏

⃗⃗⃗; 𝜽) = 𝑳(𝑿𝟏 , 𝑿𝟐 , 𝑿𝟑 … … … … , 𝑿𝒏 ; 𝜽) = ∏ 𝒑(𝑿𝒊 )

𝑳(𝑿

𝒊=𝟏

⃗⃗⃗; 𝜽) = 𝒑(𝑿𝟏 ; 𝜽)𝒑(𝑿𝟐 ; 𝜽)𝒑(𝑿𝟑 ; 𝜽) … … … … 𝒑(𝑿𝒏 ; 𝜽)

𝑳(𝑿

- Método de Máxima Verosimilitud

Consiste en seleccionar los valores que hacen máximo la función de verosimilitud para

identificarlos como estimadores de los parámetros.

En algunos casos se debe utilizar la función isomorfa que consiste en aplicar el operador

logarítmico neperiano (ln) a la función verosimilitud.

⃗⃗⃗; 𝜽𝟏 , 𝜽𝟐 , 𝜽𝟑 … … … … 𝜽𝒌 )

𝒎𝒂𝒙 𝑳(𝑿

𝑳∗ = 𝑭𝒖𝒏𝒄𝒊𝒐𝒏 𝑰𝒔𝒐𝒎𝒐𝒓𝒇𝒂 ⃗⃗⃗; 𝜽𝟏 , 𝜽𝟐 , 𝜽𝟑 … … … … 𝜽𝒌 )

𝒎𝒂𝒙 𝑳∗ (𝑿

⃗⃗⃗; 𝜽𝟏 , 𝜽𝟐 , 𝜽𝟑 … … … … 𝜽𝒌 )]

𝒎𝒂𝒙 𝒍𝒏[𝑳(𝑿

⃗⃗⃗; 𝜽𝟏 , 𝜽𝟐 , 𝜽𝟑 … … … … 𝜽𝒏 )

𝝏𝑳∗ (𝑿

=𝟎

𝝏𝜽𝟏

⃗⃗⃗; 𝜽𝟏 , 𝜽𝟐 , 𝜽𝟑 … … … … 𝜽𝒏 )

𝝏𝑳∗ (𝑿

=𝟎

𝝏𝜽𝟐

⃗⃗⃗; 𝜽𝟏 , 𝜽𝟐 , 𝜽𝟑 … … … … 𝜽𝒏 )

𝝏𝑳∗ (𝑿

=𝟎

𝝏𝜽𝒌

- Método de Momentos

Consiste en igualar los k primeros momentos ordinarios de la población con los k

primeros momentos ordinarios de la muestra.

Univ. Liz Nohemi Serrano Yujra 2

ESTADISTICA INFERENCIAL IND - 411

𝒎𝟏 = 𝑴𝟏 = 𝑬[𝑿𝟏 ]

𝒎𝟐 = 𝑴𝟐 = 𝑬[𝑿𝟐 ]

𝒎𝟑 = 𝑴𝟑 = 𝑬[𝑿𝟑 ]

………………………

𝒎𝒌 = 𝑴𝒌 = 𝑬[𝑿𝒌 ]

- Métodos de Bayes

Si al parámetro a estimar es 𝜃 con función de probabilidad 𝜑(𝜃); al emplear en lugar de

𝜃 su estimador 𝜃̂, se produce una perdida que se define por la función:

̂)

𝝅 = (𝜽; 𝜽

Riesgo ̂ ) = 𝑬[𝝅(𝜽; 𝜽

𝑹(𝜽; 𝜽 ̂ )]

Riesgo Medio ̂ ) = 𝑬[𝑹(𝜽; 𝜽

̅ (𝜽; 𝜽

𝑹 ̂ )] = 𝜷(𝜽

̂)

El valor de 𝜃̂ que hace mínimo la función anterior se denomina estimador de Bayes:

𝜽

̂ ) = ∫ 𝝅(𝜽; 𝜽

𝒎𝒊𝒏 𝜷(𝜽 ̂) 𝒉 ( ) 𝒅𝜽

𝑹𝜽 𝑿𝟏 , 𝑿𝟐 , 𝑿𝟑 , … … … … , 𝑿𝒏

Propiedades de los Estimadores

- Insesgamiento

̂ es insesgado si cumple

𝜽 ̂] = 𝜽

𝑬[𝜽

que:

De lo contrario es segado: ̂] − 𝜽

𝑺𝒆𝒔𝒈𝒐 = 𝑬[𝜽

̂ cumple:

𝜽 ̂] = 𝜽

𝐥𝐢𝐦 𝑬[𝜽

𝒏→∞

- Consistencia

Se dice que un estimador es consistente cuando a medida que crece el tamaño de la

muestra 𝑛 → ∞ el 𝜃̂ converge al 𝜃.

Para verificar la Consistencia en probabilidad se de cumplir:

̂ − 𝜽| > 𝒌) = 𝟎

𝐥𝐢𝐦 𝒑(|𝜽 ̂ − 𝜽| ≤ 𝒌) = 𝟏

𝐥𝐢𝐦 𝒑(|𝜽

𝒏→∞ 𝒏→∞

Univ. Liz Nohemi Serrano Yujra 3

ESTADISTICA INFERENCIAL IND - 411

También se puede verificar el cumplimiento de la Consistencia si se supone

simultáneamente las siguientes condiciones:

i. ̂] = 𝜽

𝐥𝐢𝐦 𝑬[𝜽 ii. ̂] = 𝟎

𝐥𝐢𝐦 𝑽[𝜽

𝒏→∞ 𝒏→∞

- Suficiencia

Se dice que un estimador es suficiente si utiliza toda la información muestral.

Para verificar la suficiencia se debe factorizar la función de verosimilitud en dos

funciones no negativas de acuerdo a lo siguiente:

̂ , 𝜽)𝒉(𝑿𝟏 , 𝑿𝟐 , … … … … , 𝑿𝒏 )

⃗⃗⃗; 𝜽) = 𝑳(𝑿𝟏 , 𝑿𝟐 , 𝑿𝟑 … … … … , 𝑿𝒏 ; 𝜽) = 𝒈(𝜽

𝑳(𝑿

- Eficiencia

Se dice que un estimador es eficiente si se cumple con las siguientes condiciones:

i. Estimador Insesgado ̂] = 𝜽

𝑬[𝜽

ii. Estimador con varianza mínima ̂ ] = 𝒎í𝒏𝒊𝒎𝒂 = 𝑽[𝜽

𝑽[𝜽 ̂]

𝑪𝑪𝑹

- Desigualdad de Cramer - Rao

Proporciona una cota inferior para la varianza que garantiza que por debajo de su valor

no es posible encontrar otro valor.

[𝟏 + 𝒇´(𝑿; 𝜽)]𝟐

̂]

𝑽[𝜽 ≥

𝑪𝑪𝑹

𝝏 𝐥𝐧 𝒇(𝑿; 𝜽) 𝟐

𝒏𝑬 [ ]

𝝏𝜽

𝟏

̂]

𝑽[𝜽 ≥

*Estimador insesgado 𝑪𝑪𝑹

𝝏 𝐥𝐧 𝒇(𝑿; 𝜽) 𝟐

𝒏𝑬 [ ]

𝝏𝜽

EJERCICIOS

Univ. Liz Nohemi Serrano Yujra 4

ESTADISTICA INFERENCIAL IND - 411

1. Determinar el estimador de máxima verosimilitud del parámetro de la función

exponente inverso.

2. Sea (X1, X2,……….,Xn) una muestra aleatoria de una variable aleatoria X ~ B(1,p).

Si se eligen al azar n objetos de una línea de producción y cada uno se clasifica

como defectuoso (Xi=1). Entonces p=P (Xi=1), es decir la verdadera proporción

de objetos defectuosos en la producción total. Determinar la estimación de MV.

3. Una muestra de tamaño n1 procede de una población normal de media 1 y

varianza 1. Si se toma una segunda muestra n2 de una población normal de media

2 y varianza 2.

a. Cuál es el estimador de MVL de 𝛽̂ = 𝜇 ̂1 − 𝜇̂ 2

b. Suponiendo fijo el tamaño de n=n1+n2 de la muestra total, como debería

dividirse las n observaciones de ambas poblaciones para que fuese

mínima la varianza de 𝛽̂

EJERCICIO DE CLASE

1. Determinar el estimador de MVL de la función exponencial, además demuestre

las 4 propiedades que debe cumplir.

PRACTICA N°1

1. Sea (X1, X2, ………, Xn) una muestra aleatoria de una población que tiene

media μ y varianza 𝜎 2

Considere los siguientes estimadores de μ

𝑋1 + 𝑋2 + ⋯ . +𝑥7

𝜇̂ 1 =

7

2𝑋1 − 𝑋6 + 𝑋4

𝜇̂ 2 =

2

a. ¿Alguno de los estimadores es insesgado?

b. ¿Cuál estimador es el “mejor”?

c. ¿En qué sentido es mejor?

2. Determine la estimación por máxima verosimilitud y por momentos para la

función:

𝑓(𝑋: 𝜃) = (𝜃 + 1)𝑋 𝜃 0≤𝑋≤1

Univ. Liz Nohemi Serrano Yujra 5

También podría gustarte

- La experiencia de la arquitectura en el proyecto y el objetoDe EverandLa experiencia de la arquitectura en el proyecto y el objetoAún no hay calificaciones

- Hoja de FórmulasDocumento6 páginasHoja de FórmulasZoe Adela BritosAún no hay calificaciones

- Parte IV. D.PoissonDocumento9 páginasParte IV. D.Poissonpaulina_ortega02Aún no hay calificaciones

- DiodoRectificadorDocumento7 páginasDiodoRectificadorBRANDONAún no hay calificaciones

- Diferencia de medias con ICDocumento8 páginasDiferencia de medias con ICAxcel Chilingano RojasAún no hay calificaciones

- Hoja de Formulas Curso de Estadistica 2Documento4 páginasHoja de Formulas Curso de Estadistica 2Elieth Alvarez UlateAún no hay calificaciones

- Formulas de Colas Iop215 Ci 2020Documento3 páginasFormulas de Colas Iop215 Ci 2020Walter GarcíaAún no hay calificaciones

- Formulario - 2023 - Evaluación Continua 2 - UCSURDocumento5 páginasFormulario - 2023 - Evaluación Continua 2 - UCSURrafaellasaireAún no hay calificaciones

- CII Formulario 23Documento2 páginasCII Formulario 23TlacuaCCHe 617Aún no hay calificaciones

- Ecuaciones FormulasDocumento7 páginasEcuaciones FormulaslfpuertoroAún no hay calificaciones

- Regla de Simpson (3) 8Documento10 páginasRegla de Simpson (3) 8ERIK YORDAN FLORES SALINASAún no hay calificaciones

- Definición de Integral SpivakDocumento15 páginasDefinición de Integral SpivakLaura Maryem Morales NuñezAún no hay calificaciones

- Derivadas de funciones compuestasDocumento19 páginasDerivadas de funciones compuestasMarvin Tobar0% (1)

- Resumen de Teoria de ErroresDocumento2 páginasResumen de Teoria de Erroresjesús danielAún no hay calificaciones

- Formulario 1Documento1 páginaFormulario 1carol choquecallataAún no hay calificaciones

- Formulario de CalculoDocumento5 páginasFormulario de CalculoKytzia SalazarAún no hay calificaciones

- MAEDocumento7 páginasMAESomaly Ariana Pachacama GrandaAún no hay calificaciones

- Tema 4 Leccion 2 PDFDocumento27 páginasTema 4 Leccion 2 PDFCarlos LeonAún no hay calificaciones

- Ejercicios de Grafica PDocumento9 páginasEjercicios de Grafica PJonathan BarretoAún no hay calificaciones

- 3 30CoopEstadisticaDocumento2 páginas3 30CoopEstadisticaDavid Salamanca50% (4)

- Ejercicio Variables - Luis Enrique Vazquez OlivaresDocumento9 páginasEjercicio Variables - Luis Enrique Vazquez OlivaresANONIMUSS KILLERAún no hay calificaciones

- S013.s3 REPASO PC2-2Documento17 páginasS013.s3 REPASO PC2-2Xiomara CMAún no hay calificaciones

- 8.5 Derivadas TrigonométricasDocumento5 páginas8.5 Derivadas TrigonométricasCecilia AbascalAún no hay calificaciones

- Mest1 U2 A4 Rooh PDFDocumento20 páginasMest1 U2 A4 Rooh PDFAsherBenAvrahamAún no hay calificaciones

- 1er Parcial - SolucionesDocumento9 páginas1er Parcial - SolucionesLaura ForeroAún no hay calificaciones

- Introducción a la óptica ondasDocumento22 páginasIntroducción a la óptica ondasJosé Antonio Soto GiménezAún no hay calificaciones

- Fórmulas de DerivaciónDocumento1 páginaFórmulas de DerivaciónPaola DomínguezAún no hay calificaciones

- ONDAS ELECTROMAGNÉTICAS 6aDocumento8 páginasONDAS ELECTROMAGNÉTICAS 6aluis centeno fawcettAún no hay calificaciones

- ADA02 EcuacionesDiferencialesDocumento27 páginasADA02 EcuacionesDiferencialesSofia SanchezAún no hay calificaciones

- FORMULARIODocumento1 páginaFORMULARIOmayte.medinaAún no hay calificaciones

- Formulario de ReactoresDocumento1 páginaFormulario de ReactoresDanaAún no hay calificaciones

- Unidad 6 - Inferencia Estadística - PARTE ADocumento9 páginasUnidad 6 - Inferencia Estadística - PARTE ACamila AsselAún no hay calificaciones

- Pauta Guia 3 INFERENCIA II Evaluación Asintótica de Test de HipótesisDocumento6 páginasPauta Guia 3 INFERENCIA II Evaluación Asintótica de Test de HipótesisSofía Cano MellafeAún no hay calificaciones

- Formulario Autorizado Reactores 1Documento2 páginasFormulario Autorizado Reactores 1Arantxa RoblesAún no hay calificaciones

- Bloque 4 - FormularioDocumento2 páginasBloque 4 - Formulariosagrario floresAún no hay calificaciones

- Practica 3 DeterminantesDocumento2 páginasPractica 3 DeterminantesYerko Vargas BaltazarAún no hay calificaciones

- Sesion N1 y N2Documento19 páginasSesion N1 y N2Lev LandauAún no hay calificaciones

- Resolución de Mis EjerciciosDocumento10 páginasResolución de Mis Ejerciciosdiego fajardoAún no hay calificaciones

- Fase 3 - Tecnicas de PronosticoDocumento15 páginasFase 3 - Tecnicas de PronosticoLucyMar PerezAún no hay calificaciones

- Taller Poisson e HipergeométricaDocumento4 páginasTaller Poisson e HipergeométricaCRISTIAN MIGUEL GONZALEZ BURBANOAún no hay calificaciones

- DOC-20240227-WA0007.Documento3 páginasDOC-20240227-WA0007.carlosjmendezg22Aún no hay calificaciones

- Torsión y Esfuerzo Cortante TorsionalDocumento18 páginasTorsión y Esfuerzo Cortante TorsionalAlex FabianAún no hay calificaciones

- PiterDocumento5 páginasPiterDanielAlexanderChaparroAún no hay calificaciones

- Unidad 1 - E1-Formulario Estadistica Descriptiva V3Documento1 páginaUnidad 1 - E1-Formulario Estadistica Descriptiva V3Emily SaToAún no hay calificaciones

- Ejercicios Desarrollados - EstimaciónDocumento6 páginasEjercicios Desarrollados - EstimaciónCLOTILDE LUCERITO YBARHUEN TELLEZAún no hay calificaciones

- Formulario para PC1Documento1 páginaFormulario para PC1Juan Bardo Manuel Taipe CalienesAún no hay calificaciones

- Media o Valor Esperado de Una Variable AleatoriaDocumento13 páginasMedia o Valor Esperado de Una Variable AleatoriaerykfloresAún no hay calificaciones

- Unidad 1 - E1-Formulario Estadistica Descriptiva V2Documento1 páginaUnidad 1 - E1-Formulario Estadistica Descriptiva V2Luis Arturo mpAún no hay calificaciones

- Ecuaciones de Maxwell - 2Documento8 páginasEcuaciones de Maxwell - 2luis centeno fawcettAún no hay calificaciones

- PC12Documento2 páginasPC12Navarro ChavaAún no hay calificaciones

- FORMULARIO ANALISIS II - CorregidoDocumento6 páginasFORMULARIO ANALISIS II - CorregidoArnoldo SetriniAún no hay calificaciones

- Actividad8 - EDO's LinealesDocumento5 páginasActividad8 - EDO's Linealeshugo garciaAún no hay calificaciones

- Guia 2: Ejercicios de RepasoDocumento13 páginasGuia 2: Ejercicios de RepasoAriana GrandeAún no hay calificaciones

- Grupo 1 - Correción - Exámen Primer CicloDocumento5 páginasGrupo 1 - Correción - Exámen Primer CicloJesus Alessandro VeraAún no hay calificaciones

- Formulario Segundo ParcialDocumento3 páginasFormulario Segundo ParcialDaniela Alcalá FloresAún no hay calificaciones

- 8.2 Derivada X Formulas (2da Parte)Documento10 páginas8.2 Derivada X Formulas (2da Parte)Cecilia AbascalAún no hay calificaciones

- s10.s1 Integrales Indefinidas TeoriaDocumento8 páginass10.s1 Integrales Indefinidas TeoriaEdithh XpAún no hay calificaciones

- Formulario de IdentidadesDocumento1 páginaFormulario de IdentidadesSaenz Leo MarianaAún no hay calificaciones

- Variables aleatorias multidimensionales y distribuciones conjuntasDocumento4 páginasVariables aleatorias multidimensionales y distribuciones conjuntasLiz Serrano YujraAún no hay calificaciones

- Guia 2 06-09-2020 BDocumento3 páginasGuia 2 06-09-2020 BAnonymous XqOKlgAún no hay calificaciones

- Guia 6 Modulos de Una Construccion IndustrialDocumento7 páginasGuia 6 Modulos de Una Construccion IndustrialEmerson Wilgen Apaza LopezAún no hay calificaciones

- Humidificación adiabáticaDocumento6 páginasHumidificación adiabáticaAnonymous XqOKlgAún no hay calificaciones

- Guia 4 Precio Unitario y Estructura TradicionalDocumento4 páginasGuia 4 Precio Unitario y Estructura TradicionalEmerson Wilgen Apaza LopezAún no hay calificaciones

- GUIA 2 Op1Documento4 páginasGUIA 2 Op1Roger ApazaAún no hay calificaciones

- Clases 04 - 01 - 2021Documento31 páginasClases 04 - 01 - 2021Anonymous XqOKlgAún no hay calificaciones

- Guia-Cuestionario ELT322 LAB01Documento2 páginasGuia-Cuestionario ELT322 LAB01Anonymous XqOKlgAún no hay calificaciones

- Formulario Probabilidad Total y BayesDocumento2 páginasFormulario Probabilidad Total y BayesAnonymous XqOKlgAún no hay calificaciones

- Sep RiograndeDocumento7 páginasSep RiograndebrionyleslyAún no hay calificaciones

- GUIA 1 (Op1)Documento2 páginasGUIA 1 (Op1)Roger ApazaAún no hay calificaciones

- Produc 4 ExfinalDocumento11 páginasProduc 4 ExfinalAnonymous XqOKlgAún no hay calificaciones

- Practica Nº4Documento2 páginasPractica Nº4Anonymous XqOKlg100% (1)

- Practi 07Documento14 páginasPracti 07Isela Zecua AlejoAún no hay calificaciones

- Integración numérica métodosDocumento23 páginasIntegración numérica métodosAbraham Aguilar Martínez0% (1)

- Concentrado de Tabla de ConversionesDocumento5 páginasConcentrado de Tabla de ConversionesGustavo ValenciaAún no hay calificaciones

- Sep RiograndeDocumento7 páginasSep RiograndebrionyleslyAún no hay calificaciones

- TFG - Fco José Calvo GanforninaDocumento66 páginasTFG - Fco José Calvo GanforninaCristian AvilaAún no hay calificaciones

- Gas 1 Practica de CromatografiaDocumento11 páginasGas 1 Practica de CromatografiaAnonymous XqOKlgAún no hay calificaciones

- Stress Cage Argentina Espanol 2006Documento19 páginasStress Cage Argentina Espanol 2006Anonymous XqOKlgAún no hay calificaciones

- Stress Cage Argentina Espanol 2006Documento19 páginasStress Cage Argentina Espanol 2006Anonymous XqOKlgAún no hay calificaciones

- Simulacion de Procesos Etanol A Partir de Caña y MaízDocumento6 páginasSimulacion de Procesos Etanol A Partir de Caña y MaízEdier Briceño AranguriAún no hay calificaciones

- DESHIDRATACION No Convencional PDFDocumento80 páginasDESHIDRATACION No Convencional PDFErick Jhonhatan Limon0% (1)

- Aplicación SAGD crudo pesadoDocumento11 páginasAplicación SAGD crudo pesadoRuben Chirinos OlivaresAún no hay calificaciones

- Tesis Completa PDFDocumento215 páginasTesis Completa PDFAnonymous XqOKlgAún no hay calificaciones

- Instalación de Una Planta de MetanolDocumento115 páginasInstalación de Una Planta de MetanolAnonymous XqOKlgAún no hay calificaciones

- PerforacionesDocumento77 páginasPerforacionesJose Luis SosaAún no hay calificaciones

- Apuntes Del Van PDFDocumento90 páginasApuntes Del Van PDFRamos Yovera Jimmy OrlandoAún no hay calificaciones

- Reporte Estadistico Ref Gualberto Villaroel PDFDocumento3 páginasReporte Estadistico Ref Gualberto Villaroel PDFAnonymous XqOKlg100% (1)

- Marco Teórico 2023Documento17 páginasMarco Teórico 2023Camila DíazAún no hay calificaciones

- Tarea 1 Ninive ReinelDocumento12 páginasTarea 1 Ninive Reinelninive reinelAún no hay calificaciones

- Tarea 9.1 Implementación de Acciones GerencialesDocumento6 páginasTarea 9.1 Implementación de Acciones GerencialesDuniaAún no hay calificaciones

- Mezcladora de goma XK-450: instrucciones de uso y mantenimientoDocumento15 páginasMezcladora de goma XK-450: instrucciones de uso y mantenimientoLucy SánchezAún no hay calificaciones

- Guia - Mayo - Comprension L - SextoDocumento2 páginasGuia - Mayo - Comprension L - SextoJackeline Figueroa BoadaAún no hay calificaciones

- Rebelión en La GranjaDocumento3 páginasRebelión en La GranjaCarlos RomeroAún no hay calificaciones

- Programaci N LinealDocumento8 páginasProgramaci N Linealwilfer8212Aún no hay calificaciones

- Microbiología de infecciones endodónticas: principales bacteriasDocumento5 páginasMicrobiología de infecciones endodónticas: principales bacteriasGrace SalasAún no hay calificaciones

- Ciencias Naturales PreguntasDocumento16 páginasCiencias Naturales Preguntasviviana vanegasAún no hay calificaciones

- Análisis Del Pensamiento ComplejoDocumento9 páginasAnálisis Del Pensamiento ComplejoMargaret BaronAún no hay calificaciones

- Mamut Matematicas Examen Final Grado 6 Removed RemovedDocumento4 páginasMamut Matematicas Examen Final Grado 6 Removed Removedfredy lopezAún no hay calificaciones

- Calidad de VidaDocumento3 páginasCalidad de VidaLeonar Jesus Piamo VeraAún no hay calificaciones

- Caso 3 - Grupo 8Documento6 páginasCaso 3 - Grupo 8Alice GuevaraAún no hay calificaciones

- Planificación microcurricular ECADocumento118 páginasPlanificación microcurricular ECAPatricia EspinalAún no hay calificaciones

- Clase 6 - La Economia Como Ciencia SocialDocumento19 páginasClase 6 - La Economia Como Ciencia SocialMenfis Alexander Rojas EspinozaAún no hay calificaciones

- Contexto Socio Economico de Mexico U1 A1Documento2 páginasContexto Socio Economico de Mexico U1 A1AlbertoAún no hay calificaciones

- Resumen 2 (Por Estudiante) - Psicología Del Lenguaje y Del Desarrollo UNRDocumento9 páginasResumen 2 (Por Estudiante) - Psicología Del Lenguaje y Del Desarrollo UNRMaría Juliana GarcíaAún no hay calificaciones

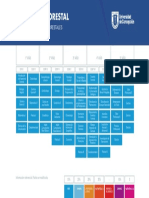

- Malla Ingenieria ForestalDocumento1 páginaMalla Ingenieria Forestaldiegoaf07Aún no hay calificaciones

- Anamnesis NeuropsicologiaDocumento15 páginasAnamnesis NeuropsicologiaCactuss MarinoAún no hay calificaciones

- Fundamento - 08 - Velasco Gabriela - S6P2Documento1 páginaFundamento - 08 - Velasco Gabriela - S6P2Nathaly VelascoAún no hay calificaciones

- Trabajo Practico EvaluativoDocumento2 páginasTrabajo Practico Evaluativocandela rodriguez gherbazAún no hay calificaciones

- Determinación humedad alimentosDocumento3 páginasDeterminación humedad alimentosAmy SeverinoAún no hay calificaciones

- C.n.m.V02-SoftGroupDocumento4 páginasC.n.m.V02-SoftGroupRita M BDAún no hay calificaciones

- Casos Comunes en El Trabajo Donde Identificamos Los Riesgos OcupacionalesDocumento1 páginaCasos Comunes en El Trabajo Donde Identificamos Los Riesgos OcupacionalesJack CortezAún no hay calificaciones

- Practica 5 Nematodos-1 PDFDocumento7 páginasPractica 5 Nematodos-1 PDFLITNI MADAI GARCIA RIZOAún no hay calificaciones

- M1 Introducción EstadisticaDocumento8 páginasM1 Introducción EstadisticaMarlene Espinoza C.Aún no hay calificaciones

- Universidad Complutense de Madrid: Facultad de Geografía E Historia Departamento de Geografía HumanaDocumento680 páginasUniversidad Complutense de Madrid: Facultad de Geografía E Historia Departamento de Geografía Humanaicarpi57Aún no hay calificaciones

- Informe de Prácticas Pre ProfesionalesDocumento32 páginasInforme de Prácticas Pre ProfesionalesCristian Alfaro TrejoAún no hay calificaciones

- Informe AcademicoDocumento23 páginasInforme AcademicoMichelle MendozaAún no hay calificaciones

- INFORME Laboratorio de Operaciones UnitariasDocumento48 páginasINFORME Laboratorio de Operaciones UnitariasIgnacioHandyMoralesAún no hay calificaciones