Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Regresion Lineal Multiple 3 PDF

Cargado por

Jorge Matheus RomeroTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

Regresion Lineal Multiple 3 PDF

Cargado por

Jorge Matheus RomeroCopyright:

Formatos disponibles

Regresin lineal mltiple

J. M. Rojo Abun

Instituto de Economa y Geografa

Madrid, II-2007

Jos Manuel Rojo 1

ndice

I. INTRODUCCIN .................................................................................................. 2

II. EL MODELO DE REGRESIN LINEAL MLTIPLE........................................ 5

III. HIPTESIS............................................................................................................. 6

IV. ESTIMACIN DE LOS PARMETROS POR MNIMOS CUADRADOS........ 7

V. VARIANZA RESIDUAL ..................................................................................... 11

VI. CONTRASTE DE REGRESIN ......................................................................... 13

VII. COEFICIENTE DE DETERMINACIN R2 ....................................................... 16

VIII. DIAGNOSIS Y VALIDACIN DE UN MODELO DE REGRESIN LINEAL

MLTIPLE ........................................................................................................... 17

VIII.1. Multicolinealidad .................................................................................................. 17

VIII.2. Anlisis de residuos .............................................................................................. 18

VIII.3. Valores de influencia (leverage) ........................................................................... 20

VIII.4. Contrastando las hiptesis bsicas ........................................................................ 21

VIII.5. Homocedasticidad ................................................................................................. 22

VIII.6. Errores que deben de evitarse ............................................................................... 23

IX. SELECCIN DE LAS VARIABLES REGRESORAS ....................................... 24

X. EJEMPLO 1 .......................................................................................................... 25

Jos Manuel Rojo 1

I. Introduccin

En el capitulo anterior se ha estudiado el modelo de regresin lineal simple,

donde se analizaba la influencia de una variable explicativa X en los valores que toma

otra variable denominada dependiente (Y).

En la regresin lineal mltiple vamos a utilizar ms de una variable explicativa;

esto nos va a ofrecer la ventaja de utilizar ms informacin en la construccin del

modelo y, consecuentemente, realizar estimaciones ms precisas.

Al tener ms de una variable explicativa (no se debe de emplear el trmino

independiente) surgirn algunas diferencias con el modelo de regresin lineal simple.

Una cuestin de gran inters ser responder a la siguiente pregunta: de un vasto

conjunto de variables explicativas: x1, x2, , xk, cules son las que ms influyen en

la variable dependiente Y.

En definitiva, y al igual que en regresin lineal simple, vamos a considerar que

los valores de la variable dependiente Y han sido generados por una combinacin lineal

de los valores de una o ms variables explicativas y un trmino aleatorio:

y = b0 + b1 x1 + b2 x2 + ... + bk xk + u

Los coeficientes son elegidos de forma que la suma de cuadrados entre los

valores observados y los pronosticados sea mnima, es decir, que se va a minimizar la

varianza residual.

Esta ecuacin recibe el nombre de hiperplano, pues cuando tenemos dos

variables explicativas, en vez de recta de regresin tenemos un plano:

Jos Manuel Rojo 2

A

Linear Regression

e + 1,41 * a_espald

A

A

A A A

A

A

A

A A A

A A

A

A

A

AA

A A

A

A

A

A

Con tres variables explicativas tendramos un espacio de tres dimensiones, y as

sucesivamente.

Vamos a ir introduciendo los elementos de este anlisis a travs de un

sencillo ejemplo.

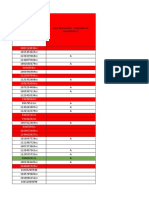

Consideramos una muestra de personas como la que sigue a continuacin:

Registr

sexo estatura l_roxto pie l_brazo a_espald d_crneo peso

o

X1 X6 X2 X3 X4 X5 Y

1 mujer 158 39 36 68 43 55 43

2 mujer 152 38 34 66 40 55 45

3 mujer 168 43 39 72.5 41 54.5 48

4 mujer 159 40 36 68.5 42 57 49

5 mujer 158 41 36 68.5 44 57 50

6 mujer 164 40 36 71 44.5 54 51

7 mujer 156 41 36 67 36 56 52

8 mujer 167 44 37 73 41.5 58 52

En base a estos datos, vamos a construir un modelo para predecir el peso de una

persona (Y). Esto equivale a estudiar la relacin existente entre este conjunto de

variables x1 ,..., x5 y la variable peso (Y).

Jos Manuel Rojo 3

En primer lugar tenemos que la variable dependiente es el peso; y las variables

que vamos a utilizar para predecir el peso reciben el nombre de variables independientes

o explicativas.

En la prctica deberemos de elegir cuidadosamente qu variables vamos a

considerar como explicativas. Algunos criterios que deben de cumplir sern los

siguientes:

Tener sentido numrico.

No deber de haber variables repetidas o redundantes

Las variables introducidas en el modelo debern de tener una cierta

justificacin terica.

La relacin entre variables explicativas en el modelo y casos debe de ser

como mnimo de 1 a 10.

La relacin de las variables explicativas con la variable dependiente debe de

ser lineal, es decir, proporcional.

Jos Manuel Rojo 4

II. El Modelo de regresin lineal mltiple

El modelo de regresin lineal mltiple es idntico al modelo de regresin lineal

simple, con la nica diferencia de que aparecen ms variables explicativas:

Modelo de regresin simple:

y = b0 + b1 x + u

Modelo de regresin mltiple:

y = b0 + b1 x1 + b2 x2 + b3 x3 + ... + bk xk + u

Siguiendo con nuestro ejemplo, si consideramos el peso como variable

dependiente y como posibles variables explicativas:

estatura

pie

l_brazo

a_espald

d_craneo

El modelo que deseamos construir es:

peso = b0 + b1 estatura + b2 pie + b3 l _ brazo + b4 a _ espald + b5 d _ craneo

Al igual que en regresin lineal simple, los coeficientes b van a indicar el

incremento en el peso por el incremento unitario de la correspondiente variable

explicativa. Por lo tanto, estos coeficientes van a tener las correspondientes unidades de

medida.

Jos Manuel Rojo 5

III. Hiptesis

Para realizar un anlisis de regresin lineal mltiple se hacen las siguientes

consideraciones sobre los datos:

a) Linealidad: los valores de la variable dependiente estn generados por el

siguiente modelo lineal:

Y = X * B +U

b) Homocedasticidad: todas las perturbaciones tienen las misma varianza:

V (ui ) = 2

c) Independencia: las perturbaciones aleatorias son independientes entre s:

E (ui u j ) = 0, i j

d) Normalidad: la distribucin de la perturbacin aleatoria tiene distribucin

normal:

U N (0, 2 )

e) Las variables explicativas Xk se obtienen sin errores de medida.

Si admitimos que los datos presentan estas hiptesis entonces el teorema de

Gauss-Markov establece que el mtodo de estimacin de mnimos cuadrados va a

producir estimadores ptimos, en el sentido que los parmetros estimados van a estar

centrados y van a ser de mnima varianza.

Jos Manuel Rojo 6

IV. Estimacin de los parmetros por mnimos cuadrados

Vamos a calcular un hiperplano de regresin de forma que se minimice la

varianza residual:

Min ( y j y j ) 2

Donde:

y j = b0 + b1 * x1,1 + b2 * x2, j + ...bk * xk , j

Utilizando notacin matricial:

u1 y1 y1

u y y

2 2 2

u = . = . = y y

. .

un yn y n

Jos Manuel Rojo 7

Y teniendo en cuenta la definicin de y :

u1 y1 b0 b1 * x1,1 b2 * x2,1 b3 * x3,1 ... bk * xk ,1

u y b b * x b * x b * x ... b * x

2 2 0 1 1, 2 2 2, 2 3 3, 2 k k ,2

u= . = . = y y

. .

u n yn b0 b1 * x1,n b2 * x2,n b3 * x3,n ... bk * xk ,n

Por lo tanto:

y1 1 x1,1 . . xk ,1 b0

y 1 x . . xk , 2 b1

2 1, 2

u = . * . = y X *b

. .

yn 1 x1,n xk ,n bk

Por lo tanto la varianza residual se puede expresar de la siguiente forma:

n * 2 = u * u = ( y X * b) * ( y X * b)

Es decir:

(b) = ( y j y j ) 2 = u * u

Por tanto, la varianza residual es una funcin del vector de parmetros b y la

condicin para que tenga un mnimo ser:

(b)

=0

b

Jos Manuel Rojo 8

Antes de derivar vamos a simplificar la expresin de la varianza residual:

n * 2 = u * u = ( y x * b ) * ( y x * b ) = y * y y * x * b b * x * y + b * x * x * b

Por lo tanto:

(b) = ( y j y j ) 2 = u * u = y * y y * x * b b * x * y + b * x * x * b

(b ) ( y X * b ) * ( y X * b )

= = 2 * X * Y + 2 * X * X * B

b b

Igualando a cero y despejando:

X *Y = X * X * B

y si X * X es matriz no singular y por lo tanto tiene inversa, tenemos:

X *Y = X * X * B

Multiplicando por ( X * X ) 1

( X * X ) 1 X * Y = ( X * X ) 1 X * X * B

( X * X ) 1 X * Y = I * B

B = ( X * X ) 1 * X * Y

sta es la expresin del estimador de parmetros B .

Jos Manuel Rojo 9

Adems

X *Y = X * X * B

X *Y X * X * B = 0

X * (Y X * B ) = 0

X *U = 0

Es decir, los residuos obtenidos del modelo estimado por mnimos cuadrados no

van a estar correlacionados con las variables explicativas.

Nota

Es importante observar que si las variables explicativas X estn muy

correlacionadas entre si, la matriz ( X * X ) va a tener el determinante con valor cero o

muy cercano a cero.

Si hay al menos una variable que puede ser expresada como combinacin lineal

del resto (ingresos mensuales, ingresos anuales) el determinante de esta matriz es cero y

dicha matriz ser singular y por lo tanto no tendr inversa.

Si no hay variables que sean combinacin lineal de las dems, pero estn

fuertemente correlacionadas, el determinante no ser cero pero tendr un valor muy

prximo a cero; este caso va a producir una inestabilidad en la solucin del estimador,

en general, se va a producir un aumento en su varianza.

En estos casos se impone la utilizacin de un mtodo de seleccin de variables

explicativas.

A los problemas provocados por la fuerte correlacin entre las variables

explicativas se les llama multicolinealidad.

Jos Manuel Rojo 10

V. Varianza residual

Al igual que en el caso de regresin lineal simple, vamos a descomponer la

variabilidad de la variable dependiente Y en dos componentes o fuentes de variabilidad:

una componente va a representar la variabilidad explicada por el modelo de regresin y

la otra componente va a representar la variabilidad no explicada por el modelo y, por

tanto, atribuida a factores aleatorios.

Consideramos la variabilidad de la variable dependiente como:

n * 2 = ( yi Y ) 2

Es decir, la variabilidad de Y es la suma cuadrtica de los valores que toma la

variable respecto a la media de la variable.

Sumando y restando el valor pronosticado por el modelo de regresin obtenemos

la siguiente expresin:

( y y ) = ( y) y ) + ( y y) )

i

2

i

2

i i

2

Es decir, que la suma de cuadrados de la variable Y respecto a su media se puede

descomponer en trminos de la varianza residual. De esta expresin se deduce que la

distancia de Y a su media se descompone como la distancia de Y a su estimacin ms la

distancia de su estimacin a la media.

Teniendo en cuenta que el ltimo trmino representa la varianza no explicada,

tenemos:

VT = VE + VNE

Jos Manuel Rojo 11

Grficamente es fcil ver la relacin:

Dividiendo la variabilidad total entre sus grados de libertad obtenemos la

varianza de la variable dependiente Y :

VT

SY2 =

n 1

Dividiendo la variabilidad no explicada entre sus grados de libertad obtenemos

la varianza residual de la variable dependiente Y :

VNE

S R2 =

n (k + 1)

Tabla resumen

Suma de cuadrados Grados de libertad

( y y)

VT

VT

2

n-1 SY2 =

n 1

VE ( y y )

2

k-1

)

( y y)

VNE

VNE

2

n-k-1 S R2 =

n k 1

Jos Manuel Rojo 12

VI. Contraste de regresin

Como estamos sacando conclusiones de una muestra de un conjunto mucho ms

amplio de datos, a veces este conjunto ser infinito, es obvio que distintas muestras van

a dar distintos valores de los parmetros.

Un caso de especial inters es asignar una medida de probabilidad a la siguiente

afirmacin o hiptesis:

H 0 b1 = b2 = ... = bk = 0

La afirmacin contraria sera:

H 1 b j 0

Nota

La hiptesis nula es que todos los coeficientes menos b0 son nulos y la hiptesis

alternativa o complementaria es que existe al menos uno que es distinto de 0, puede

haber varios que sean nulos, pero al menos existe uno distinto de cero.

Se denomina contraste de regresin al estudio de la posibilidad de que el modelo

de regresin sea nulo, es decir, los valores de las variables explicativas X no van a

influir en la variable Peso.

Jos Manuel Rojo 13

Construccin del contraste

Si los residuos siguen una distribucin normal y b1 = b2 = ... = bk = 0 , tenemos

que:

VT

n21

2

VE

12

2

VNE

n2 ( k +1)

2

Por tanto:

VE

1 VE

= F1, n ( k +1)

VNE S R2

n (k + 1)

Es decir, el cociente entre la varianza explicada y la varianza no explicada ser

aproximadamente 1. Adems, al seguir una distribucin F, podemos asignar una

medida de probabilidad (p-value) a la hiptesis de que la varianza explicada es igual a la

varianza no explicada.

En caso contrario la varianza no explicada ser muy inferior a la varianza

explicada y, por lo tanto, este cociente tendr un valor muy superior a 1.

Nota

En general si el p-value es menor de 0.05 se acepta que el modelo de regresin

es significativo; en caso contrario no podemos hablar de regresin, pues el modelo sera

nulo.

Jos Manuel Rojo 14

Si aceptamos que el modelo de regresin es significativo, es habitual mostrar el

p-value; por ejemplo:

Encontramos que este modelo de regresin es estadsticamente significativo con un

p-value de 0.0003

Jos Manuel Rojo 15

VII. Coeficiente de determinacin R2

Vamos a construir un coeficiente (estadstico) que mida la bondad del ajuste del

modelo. Si bien la varianza residual ( S R2 ) nos indica cmo estn de cerca las

estimaciones respecto de los puntos, esta varianza est influida por la varianza de la

variable dependiente, la cual, a su vez, est influida por su unidad de medida. Por lo

tanto, una medida adecuada es la proporcin de la varianza explicada (VE) entre la

varianza total (VT); de este modo, definimos el coeficiente de determinacin R 2 :

VE VT VNE VNE

R2 = = = 1

VT VT VT

Por ser cociente de sumas de cuadrados, este coeficiente ser siempre positivo.

Si todos los puntos estn sobre la recta de regresin, la varianza no explicada

ser 0, y por lo tanto:

VE 0

R2 = = 1 =1

VT VT

Este coeficiente es muy importante pues determina qu porcentaje (en tantos por

uno) de la varianza de la variable dependiente es explicado por el modelo de regresin.

En general, se pueden clasificar los valores de R 2 de la siguiente manera:

Menor de 0.3 0.3 a 0.4 0.4 a 0.5 0.5 a 0.85 Mayor de 0.85

Muy malo Malo Regular Bueno Sospechoso

Adems, a diferencia de la varianza residual, este coeficiente es adimensional;

esto quiere decir que no est afectado por transformaciones lineales de las variables; por

ello, si cambiamos las unidades de medida, el coeficiente de determinacin permanecer

invariante.

Jos Manuel Rojo 16

VIII. Diagnosis y validacin de un modelo de regresin lineal mltiple

VIII.1. Multicolinealidad

Si las variables explicativas se pueden expresar como una combinacin lineal:

1 x1 + 2 x2 + ... + k xk + 0 = 0

Se dice que tenemos un problema de multicolinealidad.

En general, este problema va a afectar incrementando la varianza de los

estimadores.

Este problema se detecta fcilmente:

Solicitando el determinante de la matriz de varianzas-covarianzas, que estar

cercano a cero.

Calculando el cociente entre el primer y ltimo autovalor de la matriz de

varianzas-covarianzas que ser mayor de 50.

Calculando para cada variable el coeficiente de determinacin ( R 2 ) de dicha

variable con el resto.

La solucin es eliminar del modelo aquellas variables explicativas que dependen

unas de otras. En general, los mtodos de seleccin de variables solucionan

automticamente este problema.

ANOVAb

Sum of

Model Squares df Mean Square F Sig.

1 Regression 3485,401 6 580,900 14,986 ,000a

Residual 775,265 20 38,763

Total 4260,667 26

a. Predictors: (Constant), l_roxto Longitud de rodilla a tobillo, d_crneo, a_espald, l_

brazo, pie, estatura

b. Dependent Variable: peso

Jos Manuel Rojo 17

Coefficientsa

Unstandardized Standardized

Coefficients Coefficients Collinearity Statistics

Model B Std. Error Beta t Sig. Tolerance VIF

1 (Constant) -133,261 43,985 -3,030 ,007

estatura -,354 ,445 -,283 -,796 ,435 ,072 13,882

pie 2,187 1,248 ,489 1,752 ,095 ,117 8,574

l_brazo ,821 ,621 ,317 1,323 ,201 ,159 6,307

a_espald 1,067 ,660 ,335 1,616 ,122 ,212 4,724

d_crneo 1,093 ,922 ,157 1,186 ,250 ,517 1,933

l_roxto Longitud

-,003 ,841 -,001 -,004 ,997 ,212 4,724

de rodilla a tobillo

a. Dependent Variable: peso

En esta tabla se muestra el valor de los estimadores del hiperplano de regresin.

La columna denominada tolerancia es:

1 R2

Donde la variable correspondiente entra como variable dependiente y el resto de

las variables explicativas actan como regresoras.

A la vista de estos resultados, la variable estatura esta provocando problemas de

multicolinealidad.

Es interesante observar que si bien el contraste de regresin es significativo,

ninguna de las variables explicativas lo es.

VIII.2. Anlisis de residuos

Definimos como residuo del i-esimo caso a:

ui = yi yi

Los residuos son variables aleatorias que siguen (?) una distribucin normal.

Los residuos tienen unidades de medida y, por tanto no se puede determinar si es grande

o pequeo a simple vista.

Jos Manuel Rojo 18

Para solventar este problema se define el residuo estandarizado como:

ui 1

Zui = *

SR 1 hii

Se considera que un residuo tiene un valor alto, y por lo tanto puede influir

negativamente en el anlisis, si su residuo estandarizado es mayor de 3 en valor

absoluto.

Zui 3

Para evitar la dependencia entre numerador y denominador de la expresin

anterior, tambin se utilizan los residuos estudentizados.

ui 1

SZui = *

S (i ) R 1 hii

Donde S (i ) R es la varianza residual calculada sin considerar el i-esimo caso.

El anlisis descriptivo y el histograma de los residuos nos indicarn si existen

casos que no se adapten bien al modelo lineal.

Residuals Statisticsa

Minimum Maximum Mean Std. Deviation N

Predicted Value 23,9527 138,1509 71,2963 25,44848 27

Residual -31,69022 117,84905 ,00000 29,60339 27

Std. Predicted Value -1,860 2,627 ,000 1,000 27

Std. Residual -,939 3,492 ,000 ,877 27

a. Dependent Variable: peso

Jos Manuel Rojo 19

Podemos observar que hay un caso que tiene un residuo anormal, pues su valor

tipificado es 3.49.

VIII.3. Valores de influencia (leverage)

Se considera que una observacin es influyente a priori si su inclusin en el

anlisis modifica sustancialmente el sentido del mismo.

Una observacin puede ser influyente si es un outlayer respecto a alguna de las

variables explicativas:

Jos Manuel Rojo 20

Para detectar estos problemas se utiliza la medida de Leverage:

1 ( x x )2

l (i ) = (1 + i 2 )

n sx

Este estadstico mide la distancia de un punto a la media de la distribucin.

Valores cercanos a 2/n indican casos que pueden influir negativamente en la

estimacin del modelo introduciendo un fuerte sesgo en el valor de los estimadores.

VIII.4. Contrastando las hiptesis bsicas

Normalidad de los residuos.

Para verificar esta hiptesis se suele utilizar el histograma de los residuos y en

caso necesario el test de Kolgomorov Smirnov.

One-Sample Kolmogorov-Smirnov Test

ZRE_1

Standardized

Residual

N 27

Normal Parameters a,b Mean ,0000000

Std. Deviation ,87705802

Most Extreme Absolute ,117

Differences Positive ,117

Negative -,105

Kolmogorov-Smirnov Z ,609

Asymp. Sig. (2-tailed) ,852

a. Test distribution is Normal.

b. Calculated from data.

En este caso no se detecta falta de normalidad, el pvalue del test KS es de 0.852,

por lo tanto se concluye que:

No se encuentran diferencias estadsticamente significativas para rechazar la hiptesis

de normalidad.

Jos Manuel Rojo 21

VIII.5. Homocedasticidad

La hiptesis de homocedasticidad establece que la variabilidad de los residuos es

independiente de las variables explicativas.

En general, la variabilidad de los residuos estar en funcin de las variables

explicativas, pero como las variables explicativas estn fuertemente correlacionadas con

la variable dependiente, bastara con examinar el grfico de valores pronosticados versus

residuos al cuadrado.

Este es un claro ejemplo de falta de homocedasticidad.

Existe una familia de transformaciones denominada Box-CCOS que se realizan

sobre la variable dependiente encaminadas a conseguir homocedasticidad. La

transformacin ms habitual para conseguir homocedasticidad es:

Y = log(Y )

En cualquier caso, es conveniente examinar detenidamente las implicaciones de

realizar este tipo de transformaciones, pues en muchas ocasiones es peor el remedio que

la enfermedad, ya que la variable dependiente puede llegar a perder el sentido.

Jos Manuel Rojo 22

VIII.6. Errores que deben de evitarse

Errores que son fciles pasar por alto al realizar un modelo de regresin lineal

mltiple son los siguientes:

No controlar el factor tamao.

Si hay un factor de ponderacin, no tenerlo en cuenta.

Al calcular los grados de libertad en los contrastes de hiptesis.

No incluir una variable relevante en el modelo.

Incluir una variable irrelevante.

Especificar una relacin lineal que no lo es.

Jos Manuel Rojo 23

IX. Seleccin de las variables regresoras

Los procedimientos para seleccionar las variables regresoras son los siguientes:

Eliminacin progresiva.

Introduccin progresiva.

Regresin paso a paso (Stepwise Regression).

Este ltimo mtodo es una combinacin de los procedimientos anteriores. Parte

del modelo sin ninguna variable regresora y en cada etapa se introduce la ms

significativa, pero en cada etapa examina si todas las variables introducidas en el

modelo deben de permanecer. Termina el algoritmo cuando ninguna variable entra o

sale del modelo.

Jos Manuel Rojo 24

X. Ejemplo 1

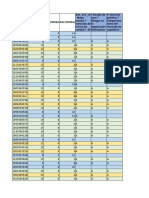

Statistics

l_roxto

Longitud

de rodilla

estatura peso pie l_brazo a_espald d_crneo a tobillo

N Valid 27 27 27 27 27 27 27

Missing 0 0 0 0 0 0 0

Mean 168,7963 63,8889 38,9815 73,4815 45,8519 57,2407 43,0926

Median 168,0000 65,0000 39,0000 73,0000 46,0000 57,0000 43,0000

Std. Deviation 10,22089 12,80124 2,86384 4,93707 4,02113 1,84167 3,15630

Skewness ,173 ,187 ,303 ,427 -,249 ,178 ,632

Std. Error of Skewness ,448 ,448 ,448 ,448 ,448 ,448 ,448

Kurtosis -1,016 -,658 -,855 -,605 ,075 -,740 1,044

Std. Error of Kurtosis ,872 ,872 ,872 ,872 ,872 ,872 ,872

Minimum 152,00 43,00 34,00 66,00 36,00 54,00 38,00

Maximum 189,00 91,00 45,00 83,00 53,00 61,00 52,00

Jos Manuel Rojo 25

Model Summaryb

Adjusted Std. Error of Durbin-

Model R R Square R Square the Estimate Watson

1 ,904a ,818 ,763 6,22602 2,274

a. Predictors: (Constant), l_roxto Longitud de rodilla a tobillo, d_crneo, a_

espald, l_brazo, pie, estatura

b. Dependent Variable: peso

ANOVAb

Sum of

Model Squares df Mean Square F Sig.

1 Regression 3485,401 6 580,900 14,986 ,000a

Residual 775,265 20 38,763

Total 4260,667 26

a. Predictors: (Constant), l_roxto Longitud de rodilla a tobillo, d_crneo, a_espald, l_

brazo, pie, estatura

b. Dependent Variable: peso

Jos Manuel Rojo 26

Coefficientsa

Unstandardized Standardized

Coefficients Coefficients Collinearity Statistics

Model B Std. Error Beta t Sig. Tolerance VIF

1 (Constant) -133,261 43,985 -3,030 ,007

estatura -,354 ,445 -,283 -,796 ,435 ,072 13,882

pie 2,187 1,248 ,489 1,752 ,095 ,117 8,574

l_brazo ,821 ,621 ,317 1,323 ,201 ,159 6,307

a_espald 1,067 ,660 ,335 1,616 ,122 ,212 4,724

d_crneo 1,093 ,922 ,157 1,186 ,250 ,517 1,933

l_roxto Longitud

-,003 ,841 -,001 -,004 ,997 ,212 4,724

de rodilla a tobillo

a. Dependent Variable: peso

Residuals Statisticsa

Minimum Maximum Mean Std. Deviation N

Predicted Value 44,1230 88,5975 63,8889 11,57816 27

Residual -8,21203 11,34415 ,00000 5,46058 27

Std. Predicted Value -1,707 2,134 ,000 1,000 27

Std. Residual -1,319 1,822 ,000 ,877 27

a. Dependent Variable: peso

Jos Manuel Rojo 27

El mismo anlisis pero utilizando un algoritmo de seleccin de variables.

Model Summaryc

Adjusted Std. Error of Durbin-

Model R R Square R Square the Estimate Watson

1 ,850a ,722 ,711 6,88269

2 ,891b ,794 ,777 6,05049 2,120

a. Predictors: (Constant), pie

b. Predictors: (Constant), pie, a_espald

c. Dependent Variable: peso

ANOVAc

Sum of

Model Squares df Mean Square F Sig.

1 Regression 3076,382 1 3076,382 64,942 ,000a

Residual 1184,285 25 47,371

Total 4260,667 26

2 Regression 3382,065 2 1691,032 46,192 ,000b

Residual 878,602 24 36,608

Total 4260,667 26

a. Predictors: (Constant), pie

b. Predictors: (Constant), pie, a_espald

c. Dependent Variable: peso

Coefficientsa

Unstandardized Standardized

Coefficients Coefficients Collinearity Statistics

Model B Std. Error Beta t Sig. Tolerance VIF

1 (Constant) -84,173 18,421 -4,569 ,000

pie 3,798 ,471 ,850 8,059 ,000 1,000 1,000

2 (Constant) -87,250 16,228 -5,376 ,000

pie 2,213 ,687 ,495 3,219 ,004 ,363 2,753

a_espald 1,415 ,490 ,444 2,890 ,008 ,363 2,753

a. Dependent Variable: peso

Jos Manuel Rojo 28

Collinearity Diagnosticsa

Condition Variance Proportions

Model Dimension Eigenvalue Index (Constant) pie a_espald

1 1 1,997 Residuals Statisticsa ,00

1,000 ,00

2 ,003

Minimum 27,778

Maximum Mean1,00 Std. Deviation

1,00 N

2 Predicted

1 Value 2,995

43,3520 1,000

87,3214 63,8889 ,00 ,00

11,40524 ,0027

2

Residual ,004

-10,25595 27,747

12,53056 ,00000,83 ,02

5,81312 ,2227

3

Std. Predicted Value ,001

-1,801 50,270

2,055 ,17

,000 ,98

1,000 ,7827

Std. Residual Variable: peso

a. Dependent -1,695 2,071 ,000 ,961 27

a. Dependent Variable: peso

Jos Manuel Rojo 29

Histogram

Dependent Variable: peso

6

Frequency

Mean = 1,99E-15

Std. Dev. = 0,961

0

Jos Manuel Rojo 30

Jos Manuel Rojo 31

También podría gustarte

- Accelerating global research insightsDocumento33 páginasAccelerating global research insightscamila arangoAún no hay calificaciones

- CRIMINOLOGIA1Documento7 páginasCRIMINOLOGIA1Daniel CastellanoAún no hay calificaciones

- Fases proyecto sistemas informaciónDocumento12 páginasFases proyecto sistemas informaciónCamilo enciso coAún no hay calificaciones

- Planillas de Limpiezas y DesinfeccionDocumento10 páginasPlanillas de Limpiezas y DesinfeccionEduard Piracoca LinaresAún no hay calificaciones

- Calificacionesn26nn18n08n22 236300119049927Documento10 páginasCalificacionesn26nn18n08n22 236300119049927Camilo enciso coAún no hay calificaciones

- Calificaciones 2282340 FASE PLANEACION APRENDICES 03-03-2022Documento64 páginasCalificaciones 2282340 FASE PLANEACION APRENDICES 03-03-2022Martin Hemirson Perez SanchezAún no hay calificaciones

- Matrices en GeoGebraDocumento1 páginaMatrices en GeoGebraClau Granados MoraAún no hay calificaciones

- RegNotas 03237330 20 B02023 B2 33982Documento6 páginasRegNotas 03237330 20 B02023 B2 33982carlos huariAún no hay calificaciones

- Ají de GallinaDocumento1 páginaAjí de GallinaFavio Gael GutiérrezAún no hay calificaciones

- RegNotas 05643440 20 B02022 B2 18777Documento6 páginasRegNotas 05643440 20 B02022 B2 18777Gilder Apaestegui CubasAún no hay calificaciones

- RegNotas 04937340 20 B02023 B2 65439Documento6 páginasRegNotas 04937340 20 B02023 B2 65439carlos huariAún no hay calificaciones

- RegNotas 06652730 20 F02023 B4 29241Documento6 páginasRegNotas 06652730 20 F02023 B4 29241florenciodionicioponceAún no hay calificaciones

- 012 Comprension LectoraDocumento66 páginas012 Comprension LectoraMRosa FdloAún no hay calificaciones

- Universidad de Los Llanos Escuela de Medicina Veterinaria Y Zootecnia Laboratorio Bioquimíca MetabólicaDocumento3 páginasUniversidad de Los Llanos Escuela de Medicina Veterinaria Y Zootecnia Laboratorio Bioquimíca MetabólicaNICOLE KATHERINE GARNICA PRADAAún no hay calificaciones

- Conejo EstudiandoDocumento2 páginasConejo EstudiandoTlacuache KunAún no hay calificaciones

- F-03 - Cafeterias ExistentesDocumento1 páginaF-03 - Cafeterias ExistentesSeremim Ltda.Aún no hay calificaciones

- Ultimo Plan de Mejoramiento NoviembreDocumento12 páginasUltimo Plan de Mejoramiento NoviembreKaroll Samuel Caro MorenoAún no hay calificaciones

- Química Orgánica Alcanos CicloalcanosDocumento30 páginasQuímica Orgánica Alcanos CicloalcanosFernando Ramirez MarquezAún no hay calificaciones

- Izs Izc IzfDocumento140 páginasIzs Izc IzfStace MacgiverAún no hay calificaciones

- RegNotas 06652730 20 F02023 B4 53096Documento6 páginasRegNotas 06652730 20 F02023 B4 53096florenciodionicioponceAún no hay calificaciones

- Evaluación Informática 4°Documento1 páginaEvaluación Informática 4°CLAUDIA CAROAún no hay calificaciones

- Mitocondrias FelicesDocumento189 páginasMitocondrias FelicesViviana VillagranAún no hay calificaciones

- Morbilidad y Mortalidad MaternaDocumento9 páginasMorbilidad y Mortalidad MaternaNatalia SolanoAún no hay calificaciones

- RegNotas 04937340 20 B02023 B2 80196Documento6 páginasRegNotas 04937340 20 B02023 B2 80196carlos huariAún no hay calificaciones

- Centrondencalificacionesnn2104746 255fcac781523d0Documento58 páginasCentrondencalificacionesnn2104746 255fcac781523d0michell adriana jimenezAún no hay calificaciones

- Gestión del conocimiento en equipos de trabajo colaborativoDocumento58 páginasGestión del conocimiento en equipos de trabajo colaborativomichell adriana jimenezAún no hay calificaciones

- I-Registro Auxiliar Primaria 2019Documento32 páginasI-Registro Auxiliar Primaria 2019dianaAún no hay calificaciones

- RegNotas 06652730 20 F02023 B4 55848Documento6 páginasRegNotas 06652730 20 F02023 B4 55848florenciodionicioponceAún no hay calificaciones

- Hoja de Respuestas 16PFDocumento1 páginaHoja de Respuestas 16PFfrancyAún no hay calificaciones

- 1° Medio Matemáticas Texto Estudiante Pág 156 163Documento8 páginas1° Medio Matemáticas Texto Estudiante Pág 156 163Orietta Andrea Riveros GonzálezAún no hay calificaciones

- RegistroAuxiliar. Matemática-PRIAMRIADocumento2 páginasRegistroAuxiliar. Matemática-PRIAMRIAHernan S. M.Aún no hay calificaciones

- Cópia de Relatorio de Líquido PenetranteDocumento24 páginasCópia de Relatorio de Líquido PenetranteMarcos AndréAún no hay calificaciones

- RegNotas 10951320 20 F02023 B1 46147Documento6 páginasRegNotas 10951320 20 F02023 B1 46147Alfredo SánchezAún no hay calificaciones

- Metodo Intuitivo AutomatizacionDocumento26 páginasMetodo Intuitivo AutomatizacionJESSEN MORENOAún no hay calificaciones

- RegNotas 06652730 20 F02023 B4 60263Documento6 páginasRegNotas 06652730 20 F02023 B4 60263florenciodionicioponceAún no hay calificaciones

- Frecuencias y GraficasDocumento42 páginasFrecuencias y GraficasClaudia CuetoAún no hay calificaciones

- RegNotas 06652730 20 F02023 B4 12189Documento6 páginasRegNotas 06652730 20 F02023 B4 12189florenciodionicioponceAún no hay calificaciones

- Sesion 07 - Correlacion y RegresionDocumento55 páginasSesion 07 - Correlacion y RegresionJorge Luis Gutierrez FiestasAún no hay calificaciones

- RegNotas 09288200 20 B02023 T1 20382Documento6 páginasRegNotas 09288200 20 B02023 T1 20382Eduardo Tapia CuelloAún no hay calificaciones

- Mejoramiento Animal Chacon GomezDocumento12 páginasMejoramiento Animal Chacon Gomezjhoan Ramiro Chacon GomezAún no hay calificaciones

- Santo Grial Mexico 1 WWWWWWWWDocumento72 páginasSanto Grial Mexico 1 WWWWWWWWByron Andres Castillo MendezAún no hay calificaciones

- RegNotas 10951320 20 F02023 B1 51251Documento7 páginasRegNotas 10951320 20 F02023 B1 51251Alfredo SánchezAún no hay calificaciones

- AA1nAA2nFICHAn77 855fab6a891545aDocumento6 páginasAA1nAA2nFICHAn77 855fab6a891545aJuan GuzmanAún no hay calificaciones

- Plano Barrio CrespoDocumento1 páginaPlano Barrio CrespoCarmen GarcíaAún no hay calificaciones

- Resultados de La Evaluación de Los AprendizajesDocumento3 páginasResultados de La Evaluación de Los AprendizajesYanetAún no hay calificaciones

- El Sistema Aduanero VenezolanoDocumento3 páginasEl Sistema Aduanero VenezolanoJAEAún no hay calificaciones

- RegNotas 06652730 20 F02023 B4 36226Documento6 páginasRegNotas 06652730 20 F02023 B4 36226florenciodionicioponceAún no hay calificaciones

- Calificaciones 28-05-2021Documento7 páginasCalificaciones 28-05-2021JUAN CAMILO CARDENAS URRIOLAAún no hay calificaciones

- Abex Catalogo 2014 - Digipubz FRENO O FRICIONES PDFDocumento28 páginasAbex Catalogo 2014 - Digipubz FRENO O FRICIONES PDFDenis HernandezAún no hay calificaciones

- Plano Detalle VentanasDocumento1 páginaPlano Detalle VentanasFredy OrtizAún no hay calificaciones

- Registro Auxiliar de Arte y Personal SocialDocumento43 páginasRegistro Auxiliar de Arte y Personal SocialFlor Jacqueline Mendoza OsorioAún no hay calificaciones

- Ejerciios Taller Analisis de Sistemas de PotenciaDocumento4 páginasEjerciios Taller Analisis de Sistemas de PotenciaYazmin Prada HernandezAún no hay calificaciones

- Cuaderno Letrilandia 2Documento73 páginasCuaderno Letrilandia 2Ángela0% (1)

- CUADERNO LETRILANDIA 2 Letras P L M SDocumento73 páginasCUADERNO LETRILANDIA 2 Letras P L M SMari Trolli Jiji100% (1)

- Croquis de Parcelas de CocoDocumento1 páginaCroquis de Parcelas de CocoAndrés Espinosa MarroquínAún no hay calificaciones

- Asistencia de SETIEMBRE Todo PersonalDocumento8 páginasAsistencia de SETIEMBRE Todo PersonalGuido Anibal Robles VivarAún no hay calificaciones

- RegNotas 17508760 20 F02023 B4 51065Documento6 páginasRegNotas 17508760 20 F02023 B4 51065Doris DiazAún no hay calificaciones

- Edo Del ArteDocumento2 páginasEdo Del ArteMay RezaAún no hay calificaciones

- SEMIOLOGÍADocumento20 páginasSEMIOLOGÍAMay RezaAún no hay calificaciones

- Lic Pedagogia InfantilDocumento1 páginaLic Pedagogia InfantilMay RezaAún no hay calificaciones

- BM Con RXN Quimica 2010Documento4 páginasBM Con RXN Quimica 2010May RezaAún no hay calificaciones

- Diagramas de Flujo y ProcesosDocumento17 páginasDiagramas de Flujo y ProcesosJuan Esteban Garcia100% (4)

- Grafica de Control X-RDocumento24 páginasGrafica de Control X-RViejes por el mundo jcAún no hay calificaciones

- Evaluacion Final - Escenario 8 - SEGUNDO BLOQUE-CIENCIAS BASICAS - VIRTUAL - ESTADÍSTICA 2 - (GRUPO B10)Documento10 páginasEvaluacion Final - Escenario 8 - SEGUNDO BLOQUE-CIENCIAS BASICAS - VIRTUAL - ESTADÍSTICA 2 - (GRUPO B10)Ana Maria CAún no hay calificaciones

- Análisis de regresión lineal entre variables meteorológicas y trazado de gráficos e isolineasDocumento13 páginasAnálisis de regresión lineal entre variables meteorológicas y trazado de gráficos e isolineasSaraMartinesAún no hay calificaciones

- Calculos-CUANTIFICACIÓN DE ENFERMEDADES EN PLANTASDocumento10 páginasCalculos-CUANTIFICACIÓN DE ENFERMEDADES EN PLANTASCRISTIAN DE LA TORRE BENDEZUAún no hay calificaciones

- Tesis: Ingeniero ForestalDocumento52 páginasTesis: Ingeniero ForestalcarlosromahnAún no hay calificaciones

- Práctica 05 - Regresión y Correlación Lineal - Grupo 04Documento14 páginasPráctica 05 - Regresión y Correlación Lineal - Grupo 04CRISTIAN MARINO CORONEL SERVANAún no hay calificaciones

- Examen Final - Semana 8 - CB - SEGUNDO BLOQUE-ESTADISTICA II - (GRUPO6)Documento12 páginasExamen Final - Semana 8 - CB - SEGUNDO BLOQUE-ESTADISTICA II - (GRUPO6)Juan Carlos Veloza HernandezAún no hay calificaciones

- Calculo Numérico: Ejercicios de Regresión y RaícesDocumento6 páginasCalculo Numérico: Ejercicios de Regresión y RaícessprekeosAún no hay calificaciones

- Tarea Econometria - FINALDocumento8 páginasTarea Econometria - FINALJose Fuentes QuinteroAún no hay calificaciones

- TEMA 3. EconometríaDocumento75 páginasTEMA 3. Econometríasandra gomezAún no hay calificaciones

- Ejercicios de Tercera UnidadDocumento53 páginasEjercicios de Tercera UnidadBertha Condori Jimenez100% (4)

- Taller DemandaDocumento13 páginasTaller DemandaValery QuirogaAún no hay calificaciones

- Coeficiente de Determinación Venta Café-Precio ChocolateDocumento4 páginasCoeficiente de Determinación Venta Café-Precio ChocolateAtilio Rodrìguez100% (1)

- Problemario A Resolve2rDocumento5 páginasProblemario A Resolve2rMariel ZxAún no hay calificaciones

- R. Múltiple Ejercicicio TutorialDocumento9 páginasR. Múltiple Ejercicicio TutorialMarco QuezadaAún no hay calificaciones

- 8.03.21 Apuntes de Clase Introduccion A La Econometria 1er Corte 2021 IDocumento18 páginas8.03.21 Apuntes de Clase Introduccion A La Econometria 1er Corte 2021 IMariana Gabriela Lozano SanchezAún no hay calificaciones

- Ejercicios de Correlación y RegresiónDocumento3 páginasEjercicios de Correlación y RegresiónMrlow GonzalesAún no hay calificaciones

- Probabilidad Unidad V - Regresión Lineal Simple y Correlación pt3Documento3 páginasProbabilidad Unidad V - Regresión Lineal Simple y Correlación pt3Juan Jose Ángel Gutiérrez100% (2)

- Demanda CigarrillosDocumento13 páginasDemanda CigarrillosJair Vega100% (3)

- T4 - Probabilidad-Y-EstadísticaDocumento9 páginasT4 - Probabilidad-Y-EstadísticaLiliana Maribel Carranza Castillo100% (1)

- Modulo de Regresion Exponencial, Logaritmica y CuadráticaDocumento27 páginasModulo de Regresion Exponencial, Logaritmica y Cuadráticagisellys urriolaAún no hay calificaciones

- CT Ejercicio 28Documento12 páginasCT Ejercicio 28maria guadalupeAún no hay calificaciones

- Econometría - Bondad de ajuste R2 y R2 ajustadoDocumento6 páginasEconometría - Bondad de ajuste R2 y R2 ajustadomelendezjmanuelAún no hay calificaciones

- GEOESTADISTICADocumento18 páginasGEOESTADISTICANoelAún no hay calificaciones

- Análisis de Datos de Mercado de VehículosDocumento10 páginasAnálisis de Datos de Mercado de VehículosKarol Villa MonsalveAún no hay calificaciones

- U1 Est Inferencial II IGE FcoDocumento14 páginasU1 Est Inferencial II IGE FcoHess GonzalezAún no hay calificaciones

- Wuolah Free P028Documento4 páginasWuolah Free P028Lorena IstrateAún no hay calificaciones

- Taller Modelos de Regresion SimpleDocumento4 páginasTaller Modelos de Regresion SimpleDaniela Guzman BejaranoAún no hay calificaciones

- Discusion de Wacc Osiptel y Telefonica PDFDocumento6 páginasDiscusion de Wacc Osiptel y Telefonica PDFhenry luis machacaAún no hay calificaciones

- Est Area Foliar Mango y Aguacate PDFDocumento6 páginasEst Area Foliar Mango y Aguacate PDFAndrés RengifoAún no hay calificaciones