Econometría – Centro de Estudios PEPE

TEMA 1: “NATURALEZA DE LA ECONOMETRÍA Y DE LOS

DATOS ECONOMÉTRICOS”

1. CONCEPTO DE MODELO ECONOMÉTRICO

La Econometría consiste en plantear modelos de probabilidad y métodos de inferencia para analizar

relaciones entre las variables, generalmente económicas. El objetivo de la Econometría es el análisis

causal que consiste en determinar qué variables explican a una variable de interés. Por ejemplo, si la

variable de interés son los salarios nos interesarán variables que lo causen como años de estudio, años

de experiencia laboral, sexo, etc

Un modelo es una representación simplificada de una determinada situación. Los modelos relacionan

variables, y si son económicas tendremos un modelo económico. Por ejemplo, el modelo económico de

Keynes plantea una relación lineal creciente entre el consumo y la renta dada por:

C 0 1Y

Sin embargo, el consumo dependerá de otras variables además de la renta como preferencias de los

consumidores, precio de los bienes…. El efecto de todas estas variables no incluídas lo recoge el término

de error ( u ) y al introducirlo tendremos un modelo econométrico, cuya ecuación será:

C 0 1Y u

donde C es el consumo (variable dependiente o binaria) e Y es la renta (variable explicativa o

independiente)

Distinguimos dos tipos de modelos econométricos, atendiendo al número de ecuaciones que contiene:

a) Modelos uniecuacionales: son aquellos que contienen una sola ecuación

b) Modelos multiecuacionales: son aquellos con más de una ecuación

Todo modelo econométrico está formado por los siguientes elementos:

1) VARIABLES:

A) Variables observables: son aquellas que se pueden medir y se clasifican en:

- Variables exógenas: son aquellas que influyen en la variable dependiente pero no a la

inversa. Se caracterizan por estar incorreladas con el término de error

- Variables endógenas: son aquellas que influyen en la variable dependiente y viceversa. Se

caracterizan por estar correlacionadas con el error

B) Variables no observables: son aquellas que no se pueden medir por estar contenidas en el

término de error.

2) PARÁMETROS: acompañan a las variables del modelo, por ejemplo, en este caso serían 0 y

1 y como siempre son constantes pero desconocidos. Por ello, tendremos que estimarlos a

partir de muestras aleatorias simples

3) DATOS: pueden ser de tres tipos:

a) Datos de sección cruzada: son conjuntos de observaciones de una o más variables medidas

en distintas unidades económicas en un periodo concreto. Por ejemplo, el peso de un

grupo de personas, salario de los trabajadores de una empresa…

1

�Econometría – Centro de Estudios PEPE

b) Datos de serie temporal: son conjuntos de observaciones de una o más variables medidas

en la misma unidad económica en periodos regulares (días, meses, años…). Por ejemplo, el

PIB trimestral, la tasa de paro mensual….

c) Datos de panel: son conjuntos de observaciones de una o más variables medidas en

distintas unidades económicas y en distintos periodos de tiempo. Por ejemplo, la

siniestralidad anual en las carreteras medida por Comunidades Autónomas en el periodo

2005-2019

2. PROPIEDADES DE ESPERANZAS, VARIANZAS Y COVARIANZAS DE V. ALEATORIAS

2.1 PROPIEDADES DE ESPERANZAS

- E ( K ) K K

- E ( K x) K E ( x) K

- E ( K x) K E ( x) K

- E ( x y ) E ( x) E ( y ) x, y v.a

2.2 PROPIEDADES DE LAS COVARIANZAS

Se define la covarianza poblacional como cov( x, y) E ( x E( x))( y E( y) E( xy) E( x) E( y)

- cov( x, K ) 0 K

- cov( x, x) Var ( x)

- cov( x, y) cov( y, x)

- cov(k1 x, k2 y) k1 k2 cov( y, x) k1 , k2

- cov( x y, z) cov( x, z ) cov( y, z )

2.3 PROPIEDADES DE LAS VARIANZAS

Se define la varianza poblacional como Var ( x) E x E ( X ) E ( x 2 ) E ( x)

2 2

- Var ( K ) 0 K

- Var ( K x) Var ( x) K

- Var ( K x) K Var ( x) K

2

- Var ( x y) Var ( x) Var ( y) 2cov( x, y) x, y v.a

- Var (ax by) Var (ax) Var (by) 2cov(ax, by) a Var ( x) b Var ( y ) 2a b cov( x, y )

2 2

x, y v.a , a, b

2

�Econometría – Centro de Estudios PEPE

3. CAUSALIDAD CETERIS PARIBUS Y ESPERANZA CONDICIONAL

Supongamos las variables “años de estudio” (X) y “salarios” (Y) y que queremos analizar el efecto causal

de los años de estudios sobre los salarios, manteniendo constantes variables que afectan al salario como

la experiencia laboral, horas trabajadas, sexo, etc. Esto se conoce como CAUSALIDAD CETERIS PARIBUS

Sin embargo, no siempre se cumple esta circunstancia, puesto que en este caso, un incremento en los

estudios puede provocar una incorporación más tardía al mercado laboral, reduciendo la experiencia, es

decir, no se cumpliría la causalidad ceteris paribus

Suponiendo que existiese causalidad ceteris paribus, se puede demostrar que la mejor predicción de Y

en función de X es la esperanza condicional E(Y/X). Se trata de una función de X y puede ser de dos

tipos:

- Lineal: E (Y / X ) 0 1 X

- No lineal: E (Y / X ) 0 1 X 2 X ,

2

E (Y / X ) e0 1 X

k

Y

Únicamente estudiaremos el caso de las variables discretas en el cual E (Y / X ) Y

j 1

j P j

X i

Y j P( X i , Y j )

donde P

Xi P( X i )

Por último, las propiedades de las esperanzas condicionadas son las siguientes:

- E(K / X ) K K

- E( f ( X ) / X ) f ( X ) donde f ( X ) es una función continua de X

- E(a bX cY / X ) E(a / X ) E(bX / X ) E(cY / X ) a bX c E(Y / X )

-

Ley de Esperanzas Iteradas: E (Y ) E E (Y / X )

3

�Econometría – Centro de Estudios PEPE

TEMA 2: EL MODELO DE REGRESIÓN SIMPLE

[Link]ÓN

Supongamos las variables X (tamaño medio de las clases en un determinado colegio) e Y (nota media de

los alumnos de un determinado colegio). Nuestro objetivo es verificar si existe relación lineal entre ellos,

y para ello planteamos el modelo de regresión simple cuya ecuación es la siguiente:

Yi 0 1 X i ui (1) i = 1,2….n

donde:

yi es la variable dependiente o respuesta, en este caso, las calificaciones medias del i-ésimo colegio

xi es la variable explicativa o independiente o regresor, en este caso, el tamaño medio de clase en el i-

ésimo colegio

β0 es la ordenada en el origen o intercepto; nos indica cuál es el valor medio de Y cuando X 1 es igual a

cero, a veces tiene interpretación significativa y otras carece de ella.

∆𝑌

β1 es la pendiente, es la variación de Y asociada a un cambio unitario en X debido a que 𝛽 1=

∆𝑋

ui es el término de error, que es una v.a. recoge a otros factores que además de X determinan el nivel de

la variable dependiente: suerte, calidad del profesorado, las características económicas del alumno,

errores de calificación… en caso de examinar la nota de un alumno a través del tamaño de la clase

[Link]ÓN DEL MODELO DE REGRESIÓN SIMPLE

Aplicando el método de Mínimos Cuadrados Ordinarios (MCO) obtenemos el siguiente modelo

estimado:

Yi ˆ0 ˆ1 X i uˆi (2) i = 1,2…..n

donde uˆ i es el residuo, es decir, la estimación del error

Alternativamente, se puede expresar el modelo estimado mediante la recta de regresión muestral:

Yˆi ˆ0 ˆ1 X i (3) i = 1,2…..n

Si comparamos las expresiones (2) y (3) concluímos que:

Yi Yˆi uˆi luego: uˆi Yi Yˆi

Por tanto, el residuo es la diferencia entre el valor real de Y ( Yi ) y el valor ajustado ( Yˆi )

El método de MCO se basa en minimizar la suma de cuadrados de los residuos, es decir:

n n n 2 n 2

SR SCR uˆí2 (Yi Yˆi )2 Yi ( ˆ0 ˆ1 X i ) Yi ˆ0 ˆ1 X i

i 1 i 1 i 1 i 1

1

�Econometría – Centro de Estudios PEPE

Planteamos la condición de primer orden (CPO) con los siguientes resultados:

n n n

𝜕 ∑i=1 û2i

= −2. ∑ ûi = 0 → ∑ ûi = 0 (I)

𝜕𝛽̂0 𝑆𝑥,𝑦 ∑𝑛𝑖=1(𝑋𝑖 − 𝑋̅)(𝑌𝑖 − 𝑌̅)

n

i=1 i=1

n 𝛽̂0 = 𝑌̅ − 𝛽̂1 𝑋̅ ; 𝛽̂1 = =

n

𝜕 ∑i=1 û2i 𝑆𝑋2 ∑𝑛𝑖=1(𝑋𝑖 − 𝑋̅ )2

= −2. ∑ 𝑢̂i . xi = 0 → ∑ 𝑢̂i . xi = 0 (II)

𝜕𝛽̂1 }

i=1 i=1

Interpretación de las expresiones (I) y (II)

- La ecuación (I) indica que si el modelo tiene intercepto o constante ( 0 ) la suma de sus

residuos será igual a cero

- La ecuación (II) indica que incorrelación entre la variable explicativa XI y los residuos ûi .

Además este resultado implica que ∑ni=1 𝑌̂i . ûi = 0

Además de la expresión del intercepto concluímos que 𝑌̅ = 𝛽̂0 + 𝛽̂1 𝑋̅, lo que implica que el punto de

coordenadas (𝑋̅, 𝑌̅) está siempre contenido en la recta de regresión

Por otro lado, las varianzas muestrales de los estimadores dependen de Var(u)= 𝜎 2 . Como los errores u,

son inobservables utilizaremos los valores estimados o residuos para buscar un estimador insesgado que

𝑛

∑𝑖=1 ̂𝑖2 𝑆𝐶𝑅

𝑢

llamamos varianza residual SR2= =𝑛−2

𝑛−2

Por último, para evaluar la bondad del ajuste se utilizan dos medidas:

2

1) Error estándar del error (SER): es la ráiz cuadrada de la varianza residual (SR ). Está medido en las

mismas unidades que Y y nos indica la desviación de las observaciones muestrales en torno a la

recta de regresión.

2

2) Coeficiente de determinación (R ): se interpreta como la proporción de la variación total de Y

explicada por el modelo. Está comprendido entre 0 y 1. Su expresión es la siguiente:

2

2 ∑ (𝑌̂𝑖 −𝑌̅ ) 𝑆𝐶𝐸 ∑ 𝜀̂𝑖2

R =∑𝑖 =

̅ )2 𝑆𝐶𝑇

= 1 − ∑ (𝑌𝑖 ̅ )2

= 1 − 𝑆𝐶𝑅/𝑆𝐶𝑇

𝑖(𝑌𝑖 −𝑌 𝑖 𝑖 −𝑌

Esta expresión es cierta siempre que el modelo tenga intercepto

Cuando es 0 el modelo explica el 0% de la variación total de Y, cuando es 1 el modelo explica el

100% de la variación de Y. También se puede interpretar como el cuadrado del coeficiente de

correlación muestral entre y e 𝑦̂.

3. SUPUESTOS DEL MODELO DE REGRESIÓN SIMPLE

El modelo de regresión se construye a partir de los siguientes supuestos:

1. Suponemos que la distribución del error ui condicionada a Xi tiene media igual a cero: es decir

E(ui/Xi)=0, para todo Xi. Este supuesto indica que ui es independiente en media de Xi . Este

supuesto implica que:

- E(ui)=0

- cov(h(xi),ui)=0, para toda función h(xi)

- E(Yi/Xi)= 0 1 X i

2

�Econometría – Centro de Estudios PEPE

2. (Xi, Yi), i=1,….,n son independientes e idénticamente distribuidas: Cuando una muestra es

seleccionada de manera aleatoria, la muestra tiene la misma distribución de probabilidad que

la población de referencia y, además, las observaciones son independientes.

3. Los datos atípicos elevados son improbables: es decir, las observaciones con valores de (Xi, Yi),

o de ambos que están muy lejos de los límites del rango habitual de los datos , son poco

probables. Los grandes atípicos pueden hacer que los resultados de la estimación MCO sean

engañosos. Este supuesto se precisa matemáticamente suponiendo que X1 e Y tienen

4

momentos de cuarto orden que son finitos y existen. 0< E(𝑋1𝑖 ) < ∞; . 0< E(𝑌𝑖4 ) < ∞

Además de esto supuestos básicos, más adelante efectuaremos el supuesto de Homocedasticidad

2

condicional, en el que suponemos que Var(ui/Xi)=σ ; E(ui /Xi)= ; lo que implica var(Yi/Xi)=

2 2

2

Una vez efectuados estos supuestos, los aplicaremos para demostrar las propiedades de los estimadores

MCO, y dependiendo del tamaño muestral distinguimos dos casos:

1) MUESTRAS FINITAS ( n 100 ): definimos las siguientes propiedades:

- Linealidad: significa que el estimador se puede expresar como una combinación lineal de las

observaciones de Y

- Insesgadez: significa que si para cada una de las infinitas muestras de que podemos disponer

del mismo tamaño, y utilizando el mismo modelo, obtenemos los infinitos posibles

estimadores, el promedio de todos los valores ajustados nos dará el parámetro poblacional.

Esto implica que ˆ0 yˆ1 son estimadores insesgados de 0 y 1 si E(ˆ0 / X i ) 0 y

E(ˆ1 / X i ) 1 . Para ello debe cumplirse que E(ui/Xi)=0 (supuesto 1)

2) MUESTRAS ASINTÓTICAS ( n 100 ):definimos las siguientes propiedades:

- Normalidad: indica que si n>100, entonces ˆ0 yˆ1 tendrán distribución Normal

- Consistencia: esta propiedad significa que a medida que la muestra se va haciendo cada vez

más grande los coeficientes ˆi se aproximan al parámetro poblacional i indefinidamente y

en el límite ambos coinciden lo que se expresa mediante p lim( ˆi ) i i=0,1

n

2

Además bajo homocedasticidad condicional (Var(ui/Xi)=σ ), la varianza asintótica de ˆ1 sería:

2

1 𝑣𝑎𝑟((𝑋𝑖 −𝜇𝑥 )𝑢𝑖 ) 𝑠𝑅

var(𝛽̂1 ) = ; en términos estimados: 𝜎̃𝛽̂21 = ∑𝑛 ̂

𝑛 𝑣𝑎𝑟(𝑋𝑖 )2 ̅ )2

𝑖=1(𝑋𝑖 −𝑋

[Link] EN EL MODELO DE REGRESIÓN SIMPLE

En el modelo de regresión simple pueden plantearse dos tipos de inferencia:

1) INTERVALOS DE CONFIANZA PARA LOS COEFICIENTES i : se construyen utilizando la siguiente

expresión:

ˆi L, ˆi L donde L Z / 2 ES (ˆi )

Si el intervalo no contiene al cero el coeficiente i será significativo

3

�Econometría – Centro de Estudios PEPE

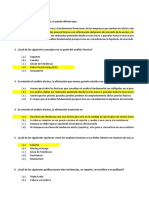

2) CONTRASTES INDIVIDUALES: pueden ser de dos tipos:

- Contrastes de significación: sirven para determinar si un coeficiente i es o no distinto de

cero. Sus hipótesis son:

H 0 : i 0

i=0,1

H1 : i 0

- Contrastes sobre valores de los coeficientes i : sirven para determinar si un coeficiente i

toma un determinado valor o rango de valores. Por ejemplo

H 0 : 1 1 H 0 : 0 0

H1 : 1 1 H1 : 0 0

Al plantear el contraste hay que tener en cuenta que en Ho sólo pueden aparecer los signos =,

o , el resto de signos aparecerá en H1

Todos estos contrastes se resuelven mediante estadísticos t del tipo:

ˆí i H 0

t N (0,1)

ES ( ˆí )