Documentos de Académico

Documentos de Profesional

Documentos de Cultura

PROBABILIDAD (4) Esperanza Matemática

Cargado por

Francisco EspinozaDerechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

PROBABILIDAD (4) Esperanza Matemática

Cargado por

Francisco EspinozaCopyright:

Formatos disponibles

PROBABILIDAD 4.

Esperanza Matemática

4. ESPERANZA MATEMÁTICA

EL VALOR ESPERADO DE UNA VARIABLE ALEATORIA

Definición Si x es una variable aleatoria discreta y f(x) es el valor de su distribución

de probabilidad, el valor esperado (esperanza matemática) de la variable

aleatoria x está dado por

𝐸(𝑥) = ∑∀𝑥 𝑥𝑓(𝑥) discreta

Así mismo, si x es una variable aleatoria continua y f(x) es el valor de su densidad

de probabilidad, entonces su valor esperado es

𝐸(𝑥) = ∫∀𝑥 𝑥𝑓(𝑥)𝑑𝑥 continua

EJEMPLO Ciertas mediciones codificadas del diámetro de avance de la cuerda

de un ajuste, tienen la densidad de probabilidad

𝟒

𝒇(𝒙) = , 𝟎<𝒙<𝟏

𝝅(𝟏 + 𝒙𝟐 )

Determinar el valor esperado de esta variable aleatoria.

Solución

1 1

4𝑥 4 𝑥

𝐸(𝑥) = ∫ 𝑥𝑓(𝑥)𝑑𝑥 = ∫ 2

𝑑𝑥 = ∫ 𝑑𝑥

𝜋(1 + 𝑥 ) 𝜋 (1 + 𝑥 2 )

∀𝑥 0 0

1

4 2𝑥 2 2 ln 2 ln 1 ln 4

= ∫ 2

𝑑𝑥 = ln|1 + 𝑥 2 |10 = − = ≈ 0.4413

2𝜋 𝜋(1 + 𝑥 ) 𝜋 𝜋 𝜋 𝜋

0

M.C. Azucena Ríos 56

PROBABILIDAD 4. Esperanza Matemática

EJEMPLO Determinar el valor esperado de la variable aleatoria x, que tiene la

distribución de probabilidad

|𝒙 − 𝟐|

𝒇(𝒙) = , 𝒙 = −𝟏, 𝟎, 𝟏, 𝟑

𝟕

Solución

𝐸(𝑥) = ∑ 𝑥𝑓(𝑥)

∀𝑥

|−1−2| 3 3 2 1 1

𝑓(−1) = =7 𝐸(𝑥) = (−1) (7) + (0) (7) + (1) (7) + (3) (7)

7

2 3 1 3

𝑓(0) = 7 𝐸(𝑥) = − (7) + (7) + (7)

1

𝑓(1) = 7 𝐸(𝑥) = 1/7

1

𝑓(3) = 7

PROPIEDADES DEL VALOR ESPERADO

1. ∑∀𝑥 𝑔(𝑥)𝑓(𝑥), 𝑠𝑖 𝑥 𝑒𝑠 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎

𝐸[𝑔(𝑥)] =

∫ 𝑔(𝑥)𝑓(𝑥)𝑑𝑥 , 𝑠𝑖 𝑥 𝑒𝑠 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎

∀𝑥

2. 𝐸(𝑎𝑥) = 𝑎 𝐸(𝑥), 𝑐𝑜𝑛 𝑎 = 𝑐𝑡𝑒.

3. 𝐸(𝑏) = 𝑏, 𝑐𝑜𝑛 𝑏 = 𝑐𝑡𝑒.

4. 𝐸(𝑎𝑥 + 𝑏) = 𝑎 𝐸(𝑥) + 𝑏

5. 𝐸(∑𝑛𝑖=1 𝑎𝑖 𝑥𝑖 ) = ∑𝑛𝑖=1 𝑎𝑖 𝐸(𝑥𝑖 )

6. 𝐸(∑𝑛𝑖=1 𝑎𝑖 𝑔𝑖 (𝑥)) = ∑𝑛𝑖=1 𝑎𝑖 𝐸(𝑔𝑖 (𝑥))

M.C. Azucena Ríos 57

PROBABILIDAD 4. Esperanza Matemática

EJEMPLOS

1) Si x es el número de puntos obtenidos con un dado equilibrado,

determinar el valor esperado de la variable aleatoria 𝒈(𝒙) = 𝟐𝒙𝟐 + 𝟏.

Solución

Si definiéramos el experimento como el lanzamiento del dado equilibrado,

entonces la variable aleatoria X mide el resultado del experimento, es decir,

los puntos obtenidos de modo que los posibles valores de la variable x serían

1, 2, …, 6.

Por otro lado, aunque no se proporciona la distribución de probabilidad, con

la información que se tiene, es fácil ver que se puede proponer la distribución:

1

𝑓(𝑥) = 𝑥 = 1, 2, … , 6

6

Ahora, usando las propiedades del valor esperado se tiene que:

𝐸(𝑔(𝑥)) = 𝐸(2𝑥 2 + 1) = 2𝐸(𝑥 2 ) + 1 =∗

Si se calcula por separado 𝐸(𝑥 2 ) se tiene que:

6 6

2) 2

1 1 2

1

𝐸(𝑥 = ∑ 𝑥 𝑓(𝑥) = ∑ 𝑥 = ∑ 𝑥 2 = (12 + 22 + ⋯ + 62 )

6 6 6

∀𝑥 𝑥=1 𝑥=1

1 1 91

= (1 + 4 + 9 + 16 + 25 + 36) = (91) =

6 6 6

Entonces

91 94

𝐸(𝑔(𝑥)) = 2 ( ) + 1 =

6 3

2) Si x tiene la densidad de probabilidad

𝒇(𝒙) = 𝒆−𝒙 , 𝒙>𝟎

𝟑𝒙

determinar el valor esperado de la variable aleatoria 𝒈(𝒙) = 𝒆 𝟒 .

Solución

3𝑥 3𝑥 +∞ 3𝑥 𝑏 −𝑥

𝐸(𝑔(𝑥)) = 𝐸 (𝑒 4 ) = ∫ 𝑒 4 𝑓(𝑥)𝑑𝑥 = ∫ 𝑒 4 𝑒 −𝑥 𝑑𝑥 = lim ∫ 𝑒 4 𝑑𝑥

∀𝑥 0 𝑏→+∞ 0

−𝑥 𝑏 −𝑏

= lim −4 𝑒 4 ] = lim −4 [𝑒 4 − 1] = −4[0 − 1] = 4

𝑏→+∞ 0 𝑏→+∞

M.C. Azucena Ríos 58

PROBABILIDAD 4. Esperanza Matemática

3) Si la densidad de probabilidad de x está dada por

𝒇(𝒙) = 𝟐(𝟏 − 𝒙), 𝟎<𝒙<𝟏

𝟐

demostrar que 𝑬(𝒙𝒓 ) = (𝒓+𝟏)(𝒓+𝟐) y utilizar este resultado para evaluar

𝑬[(𝟐𝒙 + 𝟏)𝟐 ].

Solución

1 1 1

𝑟) 𝑟 𝑟 𝑟+1

𝑥 𝑟+1 𝑥 𝑟+2

𝐸(𝑥 = ∫ 𝑥 2(1 − 𝑥)𝑑𝑥 = 2 ∫(𝑥 − 𝑥 )𝑑𝑥 = 2 [ − ]

𝑟+1 𝑟+2 0

0 0

𝑟+2−𝑟−1 2

= 2[ ]=

(𝑟 + 1)(𝑟 + 2) (𝑟 + 1)(𝑟 + 2)

2 2

→ 𝐸[(2𝑥 + 1)2 ] = 𝐸[4𝑥 2 + 4𝑥 + 1] = 4𝐸(𝑥 2 ) + 4𝐸(𝑥) + 1 = 4 [ ]+ 4[ ]+1

3(4) 2(3)

2 4 3 9

= + + = =3

3 3 3 3

TEOREMA Si X y Y son variables aleatorias discretas y 𝑓(𝑥, 𝑦) es el valor de su

distribución de probabilidad conjunta en (𝑥, 𝑦), el valor esperado de la variable

aleatoria 𝑔(𝑥, 𝑦) está dado por

𝐸[𝑔(𝑥, 𝑦)] = ∑ ∑ 𝑔(𝑥, 𝑦)𝑓(𝑥, 𝑦)

∀𝑥 ∀𝑦

Así mismo, si x y y son variables aleatorias continuas y 𝑓(𝑥, 𝑦) es el valor de su

densidad conjunta en (𝑥, 𝑦), el valor esperado de la variable aleatoria 𝑔(𝑥, 𝑦) esta

dado por

𝐸[𝑔(𝑥, 𝑦)] = ∫ ∫ 𝑔(𝑥, 𝑦)𝑓(𝑥, 𝑦)𝑑𝑥𝑑𝑦

∀𝑥 ∀𝑦

EJEMPLO Si la densidad conjunta de x y y está dada por

𝟐

𝒇(𝒙, 𝒚) = 𝟕 (𝒙 + 𝟐𝒚), 𝟎 < 𝒙 < 𝟏, 𝟏 < 𝒚 < 𝟐

𝒙

Obtener el valor esperado de 𝒈(𝒙, 𝒚) = 𝒚𝟑 .

M.C. Azucena Ríos 59

PROBABILIDAD 4. Esperanza Matemática

Solución

1 2

𝑥 𝑥 𝑥 2

𝐸(𝑔(𝑥, 𝑦)) = 𝐸 ( 3 ) = ∬ 3 𝑓(𝑥, 𝑦)𝑑𝑥𝑑𝑦 = ∫ ∫ 3 (𝑥 + 2𝑦) 𝑑𝑦 𝑑𝑥

𝑦 𝑦 𝑦 7

∀(𝑥,𝑦) 0 1

1 2 1 𝑦=2 1

2 𝑥 2 2𝑥 2 −𝑥 2 2𝑥 2 −𝑥 2 2𝑥 −𝑥 2

= ∫ ∫ ( 3 + 2 ) 𝑑𝑦 𝑑𝑥 = ∫ [ 2 − ] 𝑑𝑥 = ∫ [( − )−( − 2𝑥)] 𝑑𝑥

7 𝑦 𝑦 7 2𝑦 𝑦 𝑦=1 7 8 2 2

0 1 0 0

1 1

2 3 2 1 𝑥2 2 1 1 5

= ∫ ( 𝑥 2 + 𝑥) 𝑑𝑥 = [ 𝑥 3 + ] = [( + ) − (0)] =

7 8 7 8 2 0 7 8 2 28

0

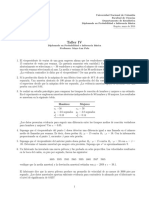

EJEMPLO La distribución de probabilidad conjunta de x, y y z está dada por

𝟏

𝒇(𝒙, 𝒚, 𝒛) = 𝟓𝟒 𝒙𝒚𝒛

x = 1, 2

y = 1, 2, 3

z = 1, 2

determinar el valor esperado de la variable aleatoria 𝒙 + 𝒚 + 𝒛

Solución

1 2

𝑓(1, 1, 1) = 54 𝑓(2, 1, 1) = 54

2 4

𝑓(1, 1, 2) = 54 𝑓(2, 1, 2) = 54

2 4

𝑓(1, 2, 1) = 54 𝑓(2, 2, 1) = 54

4 8

𝑓(1, 2, 2) = 54 𝑓(2, 2, 2) = 54

3 6

𝑓(1, 3, 1) = 54 𝑓(2, 3, 1) = 54

6 12

𝑓(1, 3, 2) = 54 𝑓(2, 3, 2) = 54

1

𝐸[(𝑥 + 𝑦 + 𝑧)] = ∑ ∑ ∑(𝑥 + 𝑦 + 𝑧)𝑓(𝑥, 𝑦, 𝑧) = ∑ ∑ ∑(𝑥 + 𝑦 + 𝑧) 𝑥𝑦𝑧

54

∀𝑥 ∀𝑦 ∀𝑧 ∀𝑥 ∀𝑦 ∀𝑧

1

= [(3)(1) + (4)(2) + (4)(2) + (5)(4) + (5)(3) + (6)(6) + (4)(2) + (5)(4)

54

+ (5)(4) + (6)(8) + (6)(6) + (7)(12)]

1 306 17

= [3 + 8 + 8 + 20 + 15 + 36 + 8 + 20 + 20 + 48 + 36 + 84] = =

54 54 3

M.C. Azucena Ríos 60

PROBABILIDAD 4. Esperanza Matemática

EJEMPLO La probabilidad de que el Sr. Juan Pérez venda parte de una

propiedad con ganancia de $3,000 es 3/20, la probabilidad de que su ganancia

sea de $1,500 es 7/20, la probabilidad de que quede “tablas” es 7/20 y la

probabilidad de que salga perdiendo $1,500 es 3/20. ¿Cuál es su ganancia

esperada?

Solución

x ganancia de la venta de la propiedad

X=3000, 1500, 0, -1500

3 7 7 3

𝐸(𝑥) = ∑ 𝑥𝑓(𝑥) = (3000) ( ) + (1500) ( ) + (0) ( ) + (−1500) ( )

20 20 20 20

∀𝑥

900 1050 450 1500

= + +0− = = 750

2 2 2 2

La ganancia esperada del Sr. Juan Pérez es $750

MOMENTOS

Definición Si se tiene que x es una variable aleatoria discreta, entonces a la

expresión dada por

𝜇𝑟´ = 𝐸(𝑥 𝑟 ) = ∑ 𝑥 𝑟 𝑓(𝑥) 𝑝𝑎𝑟𝑎 𝑥 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎

∀𝑥

se llama r-ésimo momento con respecto al origen.

Análogamente, si x es una variable aleatoria continua, entonces el r-ésimo momento

con respecto al origen (momento central), está dado por

𝜇𝑟´ = 𝐸(𝑥 𝑟 ) = ∫ 𝑥 𝑟 𝑓(𝑥)𝑑𝑥 𝑝𝑎𝑟𝑎 𝑥 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎

∀𝑥

Por otro lado, el r-ésimo momento con respecto a la media de una variable

aleatoria x, denotada por 𝜇𝑟 , esta dado por

∑∀𝑥(𝑥 − 𝜇)𝑟 𝑓(𝑥), 𝑠𝑖 𝑥 𝑒𝑠 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎

𝜇𝑟 = 𝐸[(𝑥 − 𝜇)𝑟 ] =

∫ (𝑥 − 𝜇)𝑟 𝑓(𝑥)𝑑𝑥 , 𝑠𝑖 𝑥 𝑒𝑠 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎

∀𝑥

M.C. Azucena Ríos 61

PROBABILIDAD 4. Esperanza Matemática

Del mismo modo, se pueden definir los r-ésimos momentos muestrales con

respecto al origen y con respecto a la media, de la siguiente manera

∑𝑛𝑖=1 𝑥𝑖𝑟

𝑚𝑟′ = → 𝑟 − é𝑠𝑖𝑚𝑜 𝑚𝑜𝑚𝑒𝑛𝑡𝑜 𝑚𝑢𝑒𝑠𝑡𝑟𝑎𝑙 𝑐𝑜𝑛 𝑟𝑒𝑠𝑝𝑒𝑐𝑡𝑜 𝑎𝑙 𝑜𝑟𝑖𝑔𝑒𝑛

𝑛

∑𝑛𝑖=1(𝑥𝑖 − 𝑥̅ )𝑟

𝑚𝑟 = 𝑟 − é𝑠𝑖𝑚𝑜 𝑚𝑜𝑚𝑒𝑛𝑡𝑜 𝑚𝑢𝑒𝑠𝑡𝑟𝑎𝑙 𝑐𝑜𝑛 𝑟𝑒𝑠𝑝𝑒𝑐𝑡𝑜 𝑎 𝑙𝑎 𝑚𝑒𝑑𝑖𝑎

𝑛

Observación:

𝜇1´ = 𝐸(𝑥) = 𝜇 𝑒𝑠 𝑙𝑎 𝑚𝑒𝑑𝑖𝑎 𝑑𝑒 𝑙𝑎 𝑣𝑎𝑟𝑖𝑎𝑏𝑙𝑒 𝑎𝑙𝑒𝑎𝑡𝑜𝑟𝑖𝑎 𝑥

𝜇2 = 𝑉(𝑥) = 𝐸[(𝑥 − 𝜇)2 ] = 𝜎 2 𝑒𝑠 𝑙𝑎 𝑣𝑎𝑟𝑖𝑎𝑛𝑧𝑎 𝑑𝑒 𝑙𝑎 𝑣𝑎𝑟𝑖𝑎𝑏𝑙𝑒 𝑎𝑙𝑒𝑎𝑡𝑜𝑟𝑖𝑎 𝑥

∑𝑛

𝑖=1 𝑥𝑖

𝑚1′ = = 𝑥̅ 𝑒𝑠 𝑙𝑎 𝑚𝑒𝑑𝑖𝑎 𝑚𝑢𝑒𝑠𝑡𝑟𝑎𝑙

𝑛

∑𝑛

𝑖=1(𝑥𝑖 −𝑥̅ )

2

𝑚2 = = 𝜎̂ 2 𝑒𝑠 𝑙𝑎 𝑣𝑎𝑟𝑖𝑎𝑛𝑧𝑎 𝑚𝑢𝑒𝑠𝑡𝑟𝑎𝑙

𝑛

TEOREMA Sea x una variable aleatoria con media 𝜇 = 𝐸(𝑥) entonces

𝑉(𝑥) = 𝐸(𝑥 2 ) − [𝐸(𝑥)]2

𝑉(𝑥) = 𝐸[(𝑥 − 𝜇)2 ] = 𝐸[𝑥 2 − 2𝜇𝑥 + 𝜇 2 ] = 𝐸(𝑥 2 ) − 2𝜇𝐸(𝑥) + 𝜇 2 = 𝐸(𝑥 2 ) − 2𝜇𝜇 + 𝜇 2

= 𝐸(𝑥 2 ) − 2𝜇 2 + 𝜇 2 = 𝐸(𝑥 2 ) − 𝜇 2 = 𝐸(𝑥 2 ) − [𝐸(𝑥)]2

EJEMPLO Dadas las mediciones de diámetros de una cuerda, con densidad

de probabilidad

𝟒

𝒇(𝒙) = 𝝅(𝟏+𝒙𝟐 ) 𝟎<𝒙<𝟏

Determinar la desviación estándar de la variable aleatoria x.

Solución

ln 4

𝜇 = 𝜇1´ = 𝐸(𝑥) = = 0.441

𝜋

M.C. Azucena Ríos 62

PROBABILIDAD 4. Esperanza Matemática

𝜇2´ = 𝐸(𝑥 2 ) = ∫ 𝑥 2 𝑓(𝑥)𝑑𝑥 =

∀𝑥

1 1

2

4 4 𝑥2

= ∫𝑥 𝑑𝑥 = ∫ 𝑑𝑥

𝜋(1 + 𝑥 2 ) 𝜋 (1 + 𝑥 2 )

0 0

1

4 1 4 −1 1

4 𝜋 4

= ∫ [1 − ] 𝑑𝑥 = [𝑥 − tan 𝑥] 0 = [1 − ] = −1

𝜋 (1 + 𝑥 2 ) 𝜋 𝜋 4 𝜋

0

≈ 0.2732

𝜎 2 = 𝑉(𝑥) = 𝐸(𝑥 2 ) − [𝐸(𝑥)]2 = (0.2732) − (0.441)2 = 0.079

𝜎 = √0.079 = 0.28

TEOREMA Si denotamos por 𝜎 2 a la varianza de la variable aleatoria X entonces

𝑽(𝒂𝑿 + 𝒃) = 𝒂𝟐 𝑽(𝑿)

𝐸(𝑎𝑥 + 𝑏) = 𝑎𝐸(𝑥) + 𝑏 = 𝑎𝜇 + 𝑏

𝑉(𝑎𝑥 + 𝑏) = 𝐸[(𝑎𝑥 + 𝑏) − (𝑎𝜇 + 𝑏)]2 = 𝐸[(𝑎𝑥 + 𝑏 − 𝑎𝜇 − 𝑏)2 ] = 𝐸[(𝑎𝑥 − 𝑎𝜇)2 ]

= 𝐸[𝑎2 (𝑥 − 𝜇)2 ] = 𝑎2 𝐸[(𝑥 − 𝜇)2 ] = 𝑎2 𝜎 2

Corolarios Propiedades de la varianza

1) 𝑉(𝑎𝑥) = 𝑎2 𝑉(𝑥)

2) 𝑉(𝑏) = 0

3) 𝑉[ ∑ 𝑥𝑖 ] ≠ ∑ 𝑉(𝑥𝑖 )

TEOREMA DE CHEBYSHEV

Si 𝜇 𝑦 𝜎 representan la media y la desviación estándar de la variable aleatoria X,

entonces, para una constante positiva k, se tiene que

1

𝑃(|𝑥 − 𝜇| ≤ 𝑘𝜎) > 1 −

𝑘2

M.C. Azucena Ríos 63

PROBABILIDAD 4. Esperanza Matemática

𝜇 − 𝑘𝜎 𝜇 𝜇 + 𝑘𝜎

EJEMPLO Si la densidad de probabilidad de la variable aleatoria x, está dado

por

𝒇(𝒙) = 𝟔𝟑𝟎𝒙𝟒 (𝟏 − 𝒙)𝟒 𝟎<𝒙<𝟏

Determinar la probabilidad de que x tome un valor contenido en dos

desviaciones estándar de la media y compárela con el límite inferior

proporcionado, por el teorema de Chebyshev.

Solución

1 1

𝜇 = 𝐸(𝑥) = ∫ 630𝑥 (1 − 𝑥) 𝑑𝑥 = 630 ∫ 𝑥 5 (1 − 4𝑥 + 6𝑥 2 − 4𝑥 3 + 𝑥 4 ) 𝑑𝑥

5 4

0 0

1

= 630 ∫(𝑥 5 − 4𝑥 6 + 6𝑥 7 − 4𝑥 8 + 𝑥 9 ) 𝑑𝑥

0

1

𝑥 6 4𝑥 7 3𝑥 8 4𝑥 9 𝑥10

= 630 [ − + − + ]

6 7 4 9 10 0

210 − 720 + 945 − 560 + 126 630 1

= 630 [ ]= =

2∗2∗3∗3∗5∗7 2∗2∗3∗3∗5∗7 2

1

𝐸(𝑥 2 ) = 630 ∫ 𝑥 6 (1 − 4𝑥 + 6𝑥 2 − 4𝑥 3 + 𝑥 4 ) 𝑑𝑥

0

1

= 630 ∫(𝑥 6 − 4𝑥 7 + 6𝑥 8 − 4𝑥 9 + 𝑥10 ) 𝑑𝑥

0

1

𝑥 7 𝑥 8 2𝑥 9 2𝑥10 𝑥11

= 630 [ − + − + ]

7 2 3 5 11 0

330 − 1155 + 1540 − 924 + 210 3

= 630 [ ]=

2 ∗ 3 ∗ 5 ∗ 7 ∗ 11 11

M.C. Azucena Ríos 64

PROBABILIDAD 4. Esperanza Matemática

3 1 12 − 11 1

𝜎 2 = 𝑉(𝑥) = 𝐸(𝑥 2 ) − [𝐸(𝑥)]2 = − = = → 𝜎 = 0.15

11 4 44 44

𝑃(|𝑥 − 𝜇| ≤ 2𝜎) = 𝑃(−2𝜎 ≤ 𝑥 − 𝜇 ≤ 2𝜎) = 𝑃(−2𝜎 + 𝜇 ≤ 𝑥 ≤ 2𝜎 + 𝜇)

1 1

= 𝑃 ( − 2(. 15) ≤ 𝑥 ≤ + 2(. 15)) = 𝑃(0.2 ≤ 𝑥 ≤ 0.8)

2 2

.8

= ∫ 630𝑥 4 (1 − 4𝑥 + 6𝑥 2 − 4𝑥 3 + 𝑥 4 )𝑑𝑥

.2

.8

= 630 ∫(𝑥 4 − 4𝑥 5 + 6𝑥 6 − 4𝑥 7 + 𝑥 8 ) 𝑑𝑥

.2

.8

𝑥 5 2𝑥 6 6𝑥 7 1𝑥 8 𝑥 9

= 630 [ − + − + ] = 630[1.56(10−3 ) − 3.12(10−5 )]

5 3 7 2 9 .2

= 630[1.53(10−3 )] = 0.963

Usando el teorema de Chebyshev

1 1

𝑃(|𝑥 − 𝜇| ≤ 2𝜎) > 1 − 22 = 1 − 4 = 0.75

La probabilidad es cuando menos 0.75

M.C. Azucena Ríos 65

PROBABILIDAD 4. Esperanza Matemática

FUNCIONES GENERATRICES DE MOMENTOS

Definición La función generatriz de momentos de la variable aleatoria X, está

dada por

∑∀𝑥 𝑒 𝑡𝑥 𝑓(𝑥), 𝑠𝑖 𝑥 𝑒𝑠 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎

𝑀𝑥(𝑡) = 𝐸(𝑒 𝑡𝑥 ) =

∫ 𝑒 𝑡𝑥 𝑓(𝑥)𝑑𝑥 , 𝑠𝑖 𝑥 𝑒𝑠 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎

∀𝑥

TEOREMA

𝑑 𝑟 𝑀𝑥(𝑡)

| = 𝜇𝑟´ → 𝑒𝑙 r-ésimo momento central

𝑑𝑡 𝑟 𝑡=0

= 𝐸(𝑥 𝑟 )

(𝑡𝑥)2 (𝑡𝑥)3 (𝑡𝑥)𝑟

Como 𝑒 𝑡𝑥 = 1 + 𝑡𝑥 + + + …+ +⋯

2! 3! 𝑟!

𝑡2𝑥2 𝑡3𝑥3 𝑡𝑟𝑥𝑟

= 1 + 𝑡𝑥 + + + …+ +⋯

2! 3! 𝑟!

𝑡2𝑥2 𝑡3𝑥3 𝑡𝑟𝑥𝑟

𝑀𝑥(𝑡) = 𝐸(𝑒 𝑡𝑥 ) = 𝐸 [1 + 𝑡𝑥 + + + …+ +⋯]

2! 3! 𝑟!

𝑡2 𝑡3 𝑡𝑟

= 𝐸(1) + 𝑡𝐸(𝑥) + 2! 𝐸(𝑥 2 ) + 3! 𝐸(𝑥 3 ) + ⋯ + 𝑟! 𝐸(𝑥 𝑟 ) + ⋯

𝑑 𝑀𝑥(𝑡) 𝑡2 𝑡 𝑟−1 𝑑𝑀𝑥(𝑡)

= 𝐸(𝑥) + 𝑡 𝐸(𝑥 2 ) + 2! 𝐸(𝑥 3 ) + ⋯ + (𝑟−1)! 𝐸(𝑥 𝑟 ) + ⋯ | = 𝐸(𝑥)

𝑑𝑡 𝑑𝑡 𝑡=0

𝑑2 𝑀𝑥(𝑡) 𝑡2 𝑡 𝑟−2 𝑑2 𝑀𝑥(𝑡)

= 𝐸(𝑥 2 ) + 𝑡 𝐸(𝑥 3 ) + 2! 𝐸(𝑥 3 ) … + (𝑟−2)! 𝐸(𝑥 𝑟 ) + ⋯ | = 𝐸(𝑥 2 )

𝑑𝑡 2 𝑑𝑡 2 𝑡=0

𝑑3 𝑀𝑥(𝑡) 𝑡2 𝑡 𝑟−3 𝑑3 𝑀𝑥(𝑡)

= 𝐸(𝑥 3 ) + 𝑡 𝐸(𝑥 4 ) + 2! 𝐸(𝑥 5 ) … + (𝑟−3)! 𝐸(𝑥 𝑟 ) + ⋯ | = 𝐸(𝑥 3 )

𝑑𝑡 3 𝑑𝑡 3 𝑡=0

Observamos entonces que el r-ésimo momento de la variable aleatoria x está

dado por

M.C. Azucena Ríos 66

PROBABILIDAD 4. Esperanza Matemática

𝑑𝑟 𝑀𝑥(𝑡)

| = 𝐸(𝑥 𝑟 )

𝑑𝑡 𝑟 𝑡=0

Donde:

𝐸(1) = 𝜇0´

𝐸(𝑥) = 𝜇1´

𝐸(𝑥 2 ) = 𝜇2´

𝐸(𝑥 3 ) = 𝜇3´

𝐸(𝑥 𝑟 ) = 𝜇𝑟´

PROPIEDADES DE LA FUNCIÓN GENERATRIZ DE MOMENTOS

Si a y b son constantes y 𝑀𝑥 (𝑡) es la generatriz de momentos de la variable

aleatoria x, entonces

1) 𝑴𝒙+𝒂 (𝒕) = 𝐸[𝑒 𝑡(𝑥+𝑎) ] = 𝐸[𝑒 𝑡𝑥+𝑡𝑎 ] = 𝐸[𝑒 𝑎𝑡 𝑒 𝑡𝑥 ] = 𝑒 𝑎𝑡 𝐸(𝑒 𝑡𝑥 ) = 𝒆𝒂𝒕 𝑴𝒙 (𝒕)

2) 𝑴𝒃𝒙 (𝒕) = 𝐸[𝑒 𝑡(𝑏𝑥) ] = 𝐸(𝑒 (𝑏𝑡)𝑥 ) = 𝑴𝒙 (𝒃𝒕)

𝑥+𝑎 𝑡 𝑎 𝑡 𝑎 𝑎 𝑡 𝒂

𝒕

3) 𝑴𝒙+𝒂 (𝒕) = 𝐸 [𝑒 𝑡( )

𝑏 ] = 𝐸 (𝑒 𝑏𝑥+𝑏𝑡 ) = 𝐸 [𝑒 𝑏𝑥 𝑒 𝑏𝑡 ] = 𝑒 𝑏𝑡 𝐸 [𝑒 (𝑏)𝑥 ] = 𝒆𝒃𝒕 𝑴𝒙 (𝒃)

𝒃

EJEMPLO Si X es una variable aleatoria discreta con distribución de

probabilidad dada por

𝟏 𝟑

𝒇(𝒙) = ( ), 𝒙 = 𝟎, 𝟏, 𝟐, 𝟑

𝟖 𝒙

Determinar la función generatriz de momentos y utilizarla para calcular

media y varianza.

Solución

3

𝑡𝑥 )

1 3 1 3 3 3 3

𝑀𝑥 (𝑡) = 𝐸(𝑒 = ∑ 𝑒 𝑓(𝑥) = ∑ 𝑒 𝑡𝑥 ( ) = [1 ( ) + 𝑒 𝑡 ( ) + 𝑒 2𝑡 ( ) + 𝑒 3𝑡 ( )]

𝑡𝑥

8 𝑥 8 0 1 2 3

∀𝑥 𝑥=0

1 3! 3! 3! 3! 1

= [ + 𝑒𝑡 + 𝑒 2𝑡 + 𝑒 3𝑡 ] = [1 + 3𝑒 𝑡 + 3𝑒 2𝑡 + 𝑒 3𝑡 ]

8 0! 3! 1! 2! 2! 1! 3! 0! 8

(1 + 𝑒 𝑡 )3

=

8

M.C. Azucena Ríos 67

PROBABILIDAD 4. Esperanza Matemática

𝑑𝑀(0) 3(1 + 𝑒 𝑡 )2 𝑡 12 3

𝐸(𝑥) = 𝜇1´ = 𝑀𝑥´ (0) = = 𝑒 | = =

𝑑𝑡 8 𝑡=0

8 2

3 3

𝐸(𝑥 2 ) = 𝜇2´ = 𝑀𝑥´´ (0) = [(1 + 𝑒 𝑡 )2 𝑒 𝑡 + 𝑒 𝑡 2(1 + 𝑒 𝑡 )𝑒 𝑡 ]𝑡=0 = (4 + 4) = 3

8 8

2)

3 2 9 3

𝑉(𝑥) = 𝐸(𝑥 − [𝐸(𝑥)]2 = 3−( ) = 3− =

2 4 4

Observación:

𝜇1´ = 𝜇

𝜇2´ = 𝑠𝑖𝑟𝑣𝑒 𝑝𝑎𝑟𝑎 𝑐𝑎𝑙𝑐𝑢𝑙𝑎𝑟 𝑙𝑎 𝑣𝑎𝑟𝑖𝑎𝑛𝑧𝑎

𝜇3´ = 𝑠𝑒𝑠𝑔𝑜

𝜇4´ = 𝑐𝑢𝑟𝑡𝑜𝑠𝑖𝑠

EJERCICIOS

1. Obtener 𝐸(𝑥) 𝑦 𝑉(𝑥) para una variable aleatoria con distribución

1

𝑓(𝑥) = , 𝑥 = −2, 2

2

2. Determinar 𝐸(𝑥) 𝑦 𝑉(𝑥) para una variable aleatoria de densidad

𝑥

𝑓(𝑥) = , 0<𝑥<2

2

3. Si la variable aleatoria x tiene media 𝜇 y varianza 𝜎 2 , demostrar que la

𝑥−𝜇

variable aleatoria 𝑧 = 𝜎 tiene 𝐸(𝑧) = 0 y 𝑉(𝑧) = 1.

Nota*. Proceso de Estandarización.

2

4. Dada la función generatriz de momentos 𝑀𝑥 (𝑡) = 𝑒 3𝑡+8𝑡 de la variable

aleatoria X, determina la función generatriz de momentos de la variable

𝑥−3

aleatoria 𝑧 = y usarla para obtener 𝐸(𝑧) y 𝑉(𝑧).

4

M.C. Azucena Ríos 68

PROBABILIDAD 4. Esperanza Matemática

MOMENTOS DE UN PRODUCTO

Definición El r-ésimo y s-ésimo momento producto con respecto al origen de

´

las variables aleatorias X y Y, representado por 𝜇𝑟,𝑠 , es el valor esperado de 𝑥 𝑟 𝑦 𝑠 ,

y se obtiene mediante

∑∀𝑥 ∑∀𝑦 𝑥 𝑟 𝑦 𝑠 𝑓(𝑥, 𝑦) , 𝑠𝑖 𝑥, 𝑦 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎𝑠

´

𝜇𝑟,𝑠 = 𝐸[𝑥 𝑟 𝑦 𝑠 ] =

∫ ∫ 𝑥 𝑟 𝑦 𝑠 𝑓(𝑥, 𝑦)𝑑𝑦𝑑𝑥 , 𝑠𝑖 𝑥, 𝑦 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎𝑠

∀𝑥 ∀𝑦

Definición El r-ésimo y s-ésimo momento producto con respecto a las medias

de las variables aleatorias X y Y, representado por 𝜇𝑟,𝑠 , es el valor esperado de

(𝑥 − 𝜇𝑥 )𝑟 (𝑦 − 𝜇𝑦 )𝑠 , y se obtiene por

∑∀𝑥 ∑∀𝑦(𝑥 − 𝜇𝑥 )𝑟 (𝑦 − 𝜇𝑦 )𝑠 𝑓(𝑥, 𝑦) , 𝑠𝑖 𝑥, 𝑦 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎𝑠

´

𝜇𝑟,𝑠 = 𝐸[(𝑥 − 𝜇𝑥 )𝑟 (𝑦 − 𝜇𝑦 )𝑠 ] =

∫ ∫ (𝑥 − 𝜇𝑥 )𝑟 (𝑦 − 𝜇𝑦 )𝑠 𝑓(𝑥, 𝑦)𝑑𝑦𝑑𝑥 , 𝑠𝑖 𝑥, 𝑦 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎𝑠

∀𝑥 ∀𝑦

Nota*.

´

𝜇1,0 = 𝜇𝑥

´

𝜇0,1 = 𝜇𝑦

𝜇2,0 = 𝑉(𝑥)

𝜇0,2 = 𝑉(𝑦)

𝜇1,1 = 𝐸[(𝑥 − 𝜇𝑥 )(𝑦 − 𝜇𝑦 )] = 𝐶𝑜𝑣(𝑥, 𝑦)

M.C. Azucena Ríos 69

PROBABILIDAD 4. Esperanza Matemática

Definición La covarianza entre las variables aleatorias X y Y mide la relación o

asociación entre los valores de X y Y. También denotada por 𝜎𝑥𝑦 .

𝐶𝑜𝑣(𝑥, 𝑦) = 𝐸[(𝑥 − 𝜇𝑥 )(𝑦 − 𝜇𝑦 )]

Observación:

Si X crece y Si X crece y

o viceversa

Y crece Y decrece

Cov(x, y) > 0 Cov(x, y) < 0

TEOREMA

𝐶𝑜𝑣(𝑥, 𝑦) = 𝐸(𝑥𝑦) − 𝐸(𝑥) 𝐸(𝑦)

EJEMPLO Determinar la covarianza de las dos variables aleatorias cuya

densidad conjunta está dada por:

𝒇(𝒙, 𝒚) = 𝟐, 𝒙 > 𝟎, 𝒚 > 𝟎, 𝒙 + 𝒚 < 𝟏

Solución

1 1−𝑦 1 1−𝑦 1

𝑥2

𝐸(𝑥𝑦) = ∫ ∫ 𝑥𝑦2𝑑𝑥𝑑𝑦 = 2 ∫ 𝑦 | 𝑑𝑦 = ∫ 𝑦 [(1 − 𝑦)2 ]𝑑𝑦

2 0

0 0 0 0

1 1 1

2

𝑦2 2 3 𝑦4

2 3

= ∫ 𝑦(1 − 2𝑦 + 𝑦 )𝑑𝑦 = ∫(𝑦 − 2𝑦 + 𝑦 )𝑑𝑦 = − 𝑦 + ⌋

2 3 4 0

0 0

1 2 1 6−8+3 1

= − + = =

2 3 4 12 12

1 1−𝑦 1 1 1

1−𝑦 −(1 − 𝑦)3 1

𝐸(𝑥) = ∫ ∫ 𝑥2𝑑𝑥𝑑𝑦 = ∫𝑥 2 |0 𝑑𝑦 = ∫ [(1 − 𝑦) 2 ]𝑑𝑦

= ⌋ =

3 0

3

0 0 0 0

M.C. Azucena Ríos 70

PROBABILIDAD 4. Esperanza Matemática

1 1−𝑦 1 1 1

1−𝑦

𝐸(𝑦) = ∫ ∫ 𝑦2𝑑𝑥𝑑𝑦 = ∫2𝑦𝑥|0 𝑑𝑦 = 2 ∫ 𝑦(1 − 𝑦)𝑑𝑦 = 2 ∫(𝑦 − 𝑦 2 )𝑑𝑦

0 0 0 0 0

2 3 1

𝑦 𝑦 2 1

= 2 [ − ]⌋ = 1 − =

2 3 0 3 3

1 1 1 1 1 3−4 1

𝑒𝑛𝑡𝑜𝑛𝑐𝑒𝑠 𝐶𝑜𝑣(𝑥, 𝑦) = 𝐸(𝑥𝑦) − 𝐸(𝑥)𝐸(𝑦) = − ∗ = − = =−

12 3 3 12 9 36 36

𝑂𝑏𝑠𝑒𝑟𝑣𝑎𝑚𝑜𝑠 𝑞𝑢𝑒 𝐶𝑜𝑣(𝑥, 𝑦) < 0

A medida que una variable aleatoria aumenta, la otra disminuye, es decir, si

están relacionadas.

TEOREMA Si X y Y son independientes, entonces 𝐸(𝑥𝑦) = 𝐸(𝑥)𝐸(𝑦) y

𝐶𝑜𝑣(𝑥, 𝑦) = 0.

Observación Si X y Y son independientes 𝐶𝑜𝑣(𝑥, 𝑦) = 0 pero no

necesariamente al revés.

TEOREMA En general, si se tienen X1, X2,…, Xn variables aleatorias

independientes, entonces

𝐸(𝑥1 𝑥2 … 𝑥𝑛 ) = 𝐸(𝑥1 )𝐸(𝑥2 ) … 𝐸(𝑥𝑛 )

Este teorema puede verse como que el esperado de un producto es el producto de

esperados, únicamente en el caso de variables aleatorias independientes.

MOMENTOS DE UNA COMBINACION LINEAL DE VARIABLES ALEATORIAS

TEOREMA Si X1, X2,…, Xn son variables aleatorias y la variable aleatoria Y está

definida como

𝑌 = 𝑎1 𝑋1 + 𝑎2 𝑋2 + ⋯ + 𝑎𝑛 𝑋𝑛 = ∑𝑛𝑖=1 𝑎𝑖 𝑋𝑖 → una combinación lineal de las x´s con 𝑎𝑖 = 𝑐𝑡𝑒

entonces

M.C. Azucena Ríos 71

PROBABILIDAD 4. Esperanza Matemática

𝐸(𝑌) = 𝐸(∑𝑛𝑖=1 𝑎𝑖 𝑋𝑖 ) = ∑𝑛𝑖=1 𝑎𝑖 𝐸(𝑋𝑖 ) y

𝑉(𝑌) = 𝑉(∑𝑛𝑖=1 𝑎𝑖 𝑋𝑖 ) = ∑𝑛𝑖=1 𝑎𝑖2 𝑉(𝑋𝑖 ) + 2 ∑ ∑𝑖<𝑗 𝑎𝑖 𝑎𝑗 𝑐𝑜𝑣(𝑋𝑖 , 𝑋𝑗 )

De donde, si las variables aleatorias X1, X2,…, Xn, son independientes, se tiene

que

𝑛

𝑉(𝑌) = ∑ 𝑎𝑖2 𝑉(𝑋𝑖 )

𝑖=1

PROPIEDADES DE LA VARIANZA

Del teorema que establece que 𝑉(𝑎𝑥 + 𝑏) = 𝑎2 𝑉(𝑥) se desprenden como colorarios

las siguientes propiedades:

1. 𝑉(𝑎𝑥) = 𝑎2 𝑉(𝑥), 𝑐𝑜𝑛 𝑎 = 𝑐𝑡𝑒.

2. 𝑉(𝑏) = 0, 𝑐𝑜𝑛 𝑏 = 𝑐𝑡𝑒.

3. 𝑉(∑𝑛𝑖=1 𝑎𝑖 𝑥𝑖 ) = ∑𝑛𝑖=1 𝑎𝑖2 𝑉(𝑥𝑖 ) + 2 ∑ ∑𝑖<𝑗 𝑎𝑖 𝑎𝑗 𝑐𝑜𝑣(𝑥𝑖 , 𝑥𝑗 )

4. 𝑉(∑𝑛𝑖=1 𝑎𝑖 𝑥𝑖 ) = ∑𝑛𝑖=1 𝑎𝑖2 𝑉(𝑥𝑖 ) 𝑠í 𝑦 𝑠ó𝑙𝑜 𝑠𝑖 𝑥1 , 𝑥2 , … , 𝑥𝑛 𝑠𝑜𝑛 𝑖𝑛𝑑𝑒𝑝𝑒𝑛𝑑𝑖𝑒𝑛𝑡𝑒𝑠

EJEMPLO Si las variables aleatorias X,Y y Z tienen medias 𝝁𝒙 = 𝟐, 𝝁𝒚 = −𝟑 ,

𝝁𝒛 = 𝟒 y varianzas 𝝈𝟐𝒙 = 𝟏, 𝝈𝟐𝒚 = 𝟓 𝒚 𝝈𝟐𝒛 = 𝟐 con 𝒄𝒐𝒗(𝒙, 𝒚) = −𝟐, 𝒄𝒐𝒗(𝒙, 𝒛) = −𝟏 𝒚

𝒄𝒐𝒗(𝒚, 𝒛) = 𝟏, determinar la media y varianza de la variable aleatoria 𝒘

definida por 𝒘 = 𝟑𝒙 − 𝒚 + 𝟐𝒛.

Solución

𝑥 → 𝜇𝑥 = 2, 𝜎𝑥2 = 1

𝑦 → 𝜇𝑦 = −3, 𝜎𝑦2 = 5

𝑧 → 𝜇𝑧 = 4, 𝜎𝑧2 = 2

𝑐𝑜𝑣(𝑥, 𝑦) = −2

𝑐𝑜𝑣(𝑥, 𝑧) = −1

𝑐𝑜𝑣(𝑦, 𝑧) = 1

𝐸(𝑤) = 𝐸(3𝑥 − 𝑦 + 2𝑧) = 3𝐸(𝑥) − 𝐸(𝑦) + 2𝐸(𝑧) = 3(2) − (−3) + 2(4) = 6 + 3 +

8=17

M.C. Azucena Ríos 72

PROBABILIDAD 4. Esperanza Matemática

𝑉(𝑤) = 𝑉(3𝑥 − 𝑦 + 2𝑧)

= 9𝑉(𝑥) + 𝑉(𝑦) + 4𝑉(𝑧) + 2[−3𝑐𝑜𝑣(𝑥, 𝑦) + 6𝑐𝑜𝑣(𝑥, 𝑧) − 2𝑐𝑜𝑣(𝑦, 𝑧)]

= 9(1) + 5 + 4(2) + 2[−3(−2) + 6(−1) − 2(1)]

= 9 + 5 + 8 + 2(6 − 6 − 2) = 22 − 4 = 18

ESPERANZAS CONDICIONALES

Definición Si 𝑥 es una variable aleatoria y 𝑓(𝑥/𝑦) es el valor de la distribución o

densidad condicional de 𝑥, dada Y= 𝑦, entonces, la esperanza condicional de 𝑥

dada Y= 𝑦 está dada por

∑ 𝑥𝑓(𝑥/𝑦) 𝑠𝑖 𝑠𝑜𝑛 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎𝑠

∀𝑥

𝜇𝑥/𝑦 = 𝐸(𝑥/𝑦) =

∫ 𝑥𝑓(𝑥/𝑦)𝑑𝑥 𝑠𝑖 𝑠𝑜𝑛 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎𝑠

{∀𝑥

y, la esperanza condicional de una 𝑔(𝑥) dada Y=y está dada por

∑ 𝑔(𝑥)𝑓(𝑥/ 𝑦) 𝑠𝑖 𝑥, 𝑦 𝑠𝑜𝑛 𝑑𝑖𝑠𝑐𝑟𝑒𝑡𝑎𝑠

∀𝑥

𝐸(𝑔(𝑥)|𝑦) =

∫ 𝑔(𝑥)𝑓(𝑥/ 𝑦)𝑑𝑥 𝑠𝑖 𝑥, 𝑦 𝑠𝑜𝑛 𝑐𝑜𝑛𝑡𝑖𝑛𝑢𝑎𝑠

{∀𝑥

Así mismo, de manera análoga, pueden definirse 𝐸(𝑦/𝑥) y 𝐸(𝑔(𝑦)/𝑥).

Se puede definir también la varianza condicional como

2

𝑉(x|y) = σ2(x|y) = E [((x − 𝜇(x|y) ) |y)] = E(x 2 |y) − [E(x|y)]2

EJEMPLO Si la función de densidad conjunta de dos variables aleatorias X y

Y está dada por

M.C. Azucena Ríos 73

PROBABILIDAD 4. Esperanza Matemática

𝟐

𝒇(𝒙, 𝒚) = (𝒙 + 𝟐𝒚), 𝟎 < 𝒙 < 𝟏, 𝟎<𝒚<𝟏

𝟑

Determinar la media y la varianza condicionales de X dado que Y=1/2.

Solución

Para calcular la media condicional, es decir, la esperanza condicional de x dado

1

y=2, se plantea como:

1 1

𝐸 (𝑥|𝑦 = 2) = ∫ 𝑥 𝑓 (𝑥|𝑦 = 2) 𝑑𝑥

∀𝑥

1

Sin embargo, notamos que se requiere la densidad condicional de x dado y= 2 y no

se tiene, pero se sabe que

𝑓(𝑥, 𝑦)

𝑓(𝑥|𝑦) =

𝑓(𝑦)

Y observamos que para poder encontrar esta condicional, necesitamos la densidad

marginal de y, que tampoco se tiene, pero se puede encontrar a partir de la conjunta

de la siguiente forma:

1 1

2 2 𝑥2 2 1 1 + 4𝑦

𝑓(𝑦) = ∫ (𝑥 + 2𝑦)𝑑𝑥 = [ + 2𝑥𝑦] = [ + 2𝑦] =

3 3 2 0

3 2 3

0

Con esta marginal, podemos encontrar la condicional general

2

𝑓(𝑥, 𝑦) 3 (𝑥 + 2𝑦) 2(𝑥 + 2𝑦)

𝑓(𝑥|𝑦) = = =

𝑓(𝑦) 1 1 + 4𝑦

(1 + 4𝑦)

3

1

A partir de la condicional general, evaluamos en y=2 para obtener la densidad

1

condicional de x dado y=2

1

2 (𝑥 + 2 (2))

1 2(𝑥 + 1) 2

𝑓 (𝑥|𝑦 = ) = = = (𝑥 + 1)

2 1 1+2 3

(1 + 4 (2))

M.C. Azucena Ríos 74

PROBABILIDAD 4. Esperanza Matemática

1

Una vez encontrada la densidad condicional de x dado y=2, ya se puede proceder

a calcular la esperanza condicional que nos interesa

1 1 1 1

1 1 2 2 2

2 𝑥3 𝑥2

𝐸 (𝑥|𝑦 = 2) = ∫ 𝑥 𝑓 (𝑥|𝑦 = 2) 𝑑𝑥 = ∫ 𝑥 (𝑥 + 1)𝑑𝑥 = ∫[𝑥 + 𝑥] 𝑑𝑥 = [ + ]

3 3 3 3 2 0

0 0 0

2 1 1 2 (2 + 3) 5

= [ + ]= =

3 3 2 3 6 9

Para calcular la varianza condicional, usaremos el teorema, por lo que se necesita

1 1 1

2 1 2

2 2 3 2]

2 𝑥4 𝑥3 2 3+4 7

𝐸 (𝑥 |𝑦 = 2) = ∫ 𝑥 (𝑥 + 1)𝑑𝑥 = ∫[𝑥 + 𝑥 𝑑𝑥 = [ + ] = [ ]=

3 3 3 4 3 0 3 12 18

0 0

Aplicando el teorema de la varianza, al concepto de varianza condicional, se tiene

que

1 1 2 7 25 13

σ2(x|y) = E (x 2 |y = 2) − [E (x|y = 2)] = − = = 0.08

18 81 162

EJERCICIOS

1. Considérese la densidad trivariada

𝑓(𝑥, 𝑦, 𝑧) = (𝑥 + 𝑦)𝑒 −𝑧 , 0 < 𝑥 < 1, 0 < 𝑦 < 1, 𝑧 > 0

Determinar 𝐶𝑜𝑣(𝑥, 𝑧)

2. Si las variables aleatorias independientes 𝑥, 𝑦 y 𝑧 tienen medias 4, 9, 3 y

varianzas 3, 7, 5, respectivamente, determinar la media y la varianza de

a) 𝑢 = 2𝑥 − 3𝑦 + 4𝑧

b) 𝑣 = 𝑥 + 2𝑦 − 𝑧

3. Dada la distribución de probabilidad conjunta

𝑥 = 1,2,3

𝑥𝑦𝑧

𝑓(𝑥, 𝑦, 𝑧) = 108, 𝑦 = 1,2,3

𝑧 = 1,2

M.C. Azucena Ríos 75

PROBABILIDAD 4. Esperanza Matemática

Obtener la esperanza condicional de la variable aleatoria 𝑔(𝑧) = 𝑧 2 , dadas

𝑥 = 1 𝑦 𝑦 = 2.

4. Si la función de densidad conjunta de 𝑥, 𝑦 está dada por

1

𝑓(𝑥, 𝑦) = 4 (2𝑥 + 𝑦), 0 < 𝑥 < 1, 0<𝑦<2

1

Determinar la media y la varianza condicionales de 𝑦 dado 𝑥 = 4.

M.C. Azucena Ríos 76

También podría gustarte

- Variable AleatoriaDocumento7 páginasVariable AleatoriaEmiruAún no hay calificaciones

- PROBABILIDAD (3) Distribuciones de ProbabilidadDocumento26 páginasPROBABILIDAD (3) Distribuciones de ProbabilidadSam Thorbjörn AndersonAún no hay calificaciones

- Edp - 2Documento31 páginasEdp - 2brunoAún no hay calificaciones

- Productividad: 10 problemas de cálculo y análisisDocumento5 páginasProductividad: 10 problemas de cálculo y análisisMichelleAún no hay calificaciones

- Sistemas de ecuaciones linealesDocumento45 páginasSistemas de ecuaciones linealesConrado Guirao100% (1)

- Unidad 4Documento8 páginasUnidad 4Alex GironAún no hay calificaciones

- Modelo de Prueba de DerivadasDocumento1 páginaModelo de Prueba de DerivadasYannitsaFernándezPiñaAún no hay calificaciones

- Funcion Discreta - SucesionesDocumento3 páginasFuncion Discreta - SucesionesGiuliano PertileAún no hay calificaciones

- Guia Variables AleatoriasDocumento13 páginasGuia Variables AleatoriasEnrique Villarroel Carvajal100% (1)

- Manual de Lingo 11.0Documento80 páginasManual de Lingo 11.0Pedro Alvaro Vilcapoma TorresAún no hay calificaciones

- Sumas de RiemannDocumento2 páginasSumas de RiemannGarcíaAbrahamAún no hay calificaciones

- Ejercicios de teoría de conjuntosDocumento10 páginasEjercicios de teoría de conjuntosgaguillo100% (1)

- Apuntes CombinatoriaDocumento13 páginasApuntes CombinatoriaAlfonso Fernández0% (1)

- Diagrama de ArbolDocumento5 páginasDiagrama de ArbolShante ThompsonAún no hay calificaciones

- Lamina-10 Ecuaciones y Sistema de Ecuaciones de Primer Grado (2016) - PRODocumento2 páginasLamina-10 Ecuaciones y Sistema de Ecuaciones de Primer Grado (2016) - PROSindy Aracely Severino DiazAún no hay calificaciones

- 3 Decisiones Sobre ProducciónDocumento3 páginas3 Decisiones Sobre ProducciónChristian Porras Arhuata100% (1)

- Estadistica BasicaDocumento6 páginasEstadistica BasicaDiana Miriam Escobedo IbarraAún no hay calificaciones

- Ecvv U2 Ea Gier TerminadoDocumento8 páginasEcvv U2 Ea Gier TerminadoGilberto EugenioAún no hay calificaciones

- LISTA DE EJERCICIOS No 2 DE ÁLGEBRA IIDocumento4 páginasLISTA DE EJERCICIOS No 2 DE ÁLGEBRA IIEber Choque100% (1)

- Métodos numéricos para derivación e integraciónDocumento5 páginasMétodos numéricos para derivación e integraciónkevin trujilloAún no hay calificaciones

- Ejercicios de Integrales Dobles en Coordenas PolaresDocumento2 páginasEjercicios de Integrales Dobles en Coordenas PolaresE Clinton LMAún no hay calificaciones

- Libro de Matematica Psu Mauro Quintana Ltda.Documento124 páginasLibro de Matematica Psu Mauro Quintana Ltda.Juan YanezAún no hay calificaciones

- Circunferencia: conceptos básicos, ángulos y proporcionalidadDocumento7 páginasCircunferencia: conceptos básicos, ángulos y proporcionalidadcacuto11Aún no hay calificaciones

- LogaritmosDocumento3 páginasLogaritmosJaime Antonio Cruz LiencuraAún no hay calificaciones

- Guía 1 Variables AleatoriasDocumento4 páginasGuía 1 Variables Aleatoriasdiego199321Aún no hay calificaciones

- Simulated Annealing para juego So Who's CountingDocumento4 páginasSimulated Annealing para juego So Who's CountingEsteban AlvarezAún no hay calificaciones

- Divide y vencerás: Multiplicación de enteros grandesDocumento83 páginasDivide y vencerás: Multiplicación de enteros grandesJhónatan CarranzaAún no hay calificaciones

- Unidad Imaginaria ACTIVIDADESDocumento32 páginasUnidad Imaginaria ACTIVIDADESjorge puyol100% (1)

- Programacion C++Documento40 páginasProgramacion C++admerbarriosurbinaAún no hay calificaciones

- Parcial 3 - 2020 Calculo DiferencialDocumento6 páginasParcial 3 - 2020 Calculo DiferencialDaniel Poveda PiedrahitaAún no hay calificaciones

- Tema Tablasygraficas 2 Páginas 2 11Documento10 páginasTema Tablasygraficas 2 Páginas 2 11algiAún no hay calificaciones

- Técnicas de conteo y probabilidad en transporteDocumento9 páginasTécnicas de conteo y probabilidad en transportePiiPe AldanaAún no hay calificaciones

- Problemas de Fundamentos de Probabilidad ResueltosDocumento13 páginasProblemas de Fundamentos de Probabilidad ResueltosLeonardo Martínez LaraAún no hay calificaciones

- MatricesDocumento69 páginasMatricesclaritae_svAún no hay calificaciones

- Actividad Uno Ecuacione DiferencilesDocumento1 páginaActividad Uno Ecuacione DiferencilesNini FernandezAún no hay calificaciones

- Cálculo de autovalores de matrices 3x3 mediante el polinomio característicoDocumento2 páginasCálculo de autovalores de matrices 3x3 mediante el polinomio característicoantonioAún no hay calificaciones

- Variable AleatoriaDocumento50 páginasVariable AleatoriaGuido Andres Alvarez100% (1)

- Análisis Del ErrorDocumento28 páginasAnálisis Del ErrorTephano El TucoAún no hay calificaciones

- Guia Estadistica ProbabilidadDocumento3 páginasGuia Estadistica ProbabilidadCee Tecnología Médica PucvAún no hay calificaciones

- Matemática IVDocumento94 páginasMatemática IVAlejandro ArellanoAún no hay calificaciones

- 111775436.trabajo Practico Funciones LinealesDocumento4 páginas111775436.trabajo Practico Funciones LinealesMarcelo Nicolas VegaAún no hay calificaciones

- Tarea 2 Arce CastañoDocumento7 páginasTarea 2 Arce CastañoJuan ArceAún no hay calificaciones

- Algoritmos de Optimización No LinealDocumento31 páginasAlgoritmos de Optimización No LinealJoel Larico AlvizAún no hay calificaciones

- Semana14 GDocumento25 páginasSemana14 GRAQUEL BRiGIDA PeREZ GUTIERREZAún no hay calificaciones

- Practica #2Documento2 páginasPractica #2Jordan NinaAún no hay calificaciones

- Modulo5. Fundamentos de GrafosDocumento52 páginasModulo5. Fundamentos de GrafosBernardino HeroAún no hay calificaciones

- 1 5 Intervalos Inecuaciones de Primer GradoDocumento14 páginas1 5 Intervalos Inecuaciones de Primer GradoGuillermo TorresAún no hay calificaciones

- Guia Compiladores ESCOMDocumento13 páginasGuia Compiladores ESCOMOmar Patron Padron100% (1)

- Funciones cuadráticas y ecuacionesDocumento2 páginasFunciones cuadráticas y ecuacionesPedro SebastianAún no hay calificaciones

- Funciones logarítmicas y sus característicasDocumento10 páginasFunciones logarítmicas y sus característicasEvelyn Duarte100% (1)

- Deflación polinominal: reducir el grado de una funciónDocumento2 páginasDeflación polinominal: reducir el grado de una funciónElvin RodríguezAún no hay calificaciones

- Guía N°2 2do Medio Racionalización PDFDocumento4 páginasGuía N°2 2do Medio Racionalización PDFELIAS DANIEL FIGUEROA QUIROZAún no hay calificaciones

- Vectores Y MatricesDocumento24 páginasVectores Y MatricesMarlene PalloAún no hay calificaciones

- PROBABILIDAD (4) Esperanza MatemáticaDocumento20 páginasPROBABILIDAD (4) Esperanza MatemáticaSam Thorbjörn AndersonAún no hay calificaciones

- Metodos de Gradiente para La Resolucion de Problemas No Lineales de Optimizacion1Documento16 páginasMetodos de Gradiente para La Resolucion de Problemas No Lineales de Optimizacion1Trampero L GRoseroAún no hay calificaciones

- Cálculo Semana 10Documento8 páginasCálculo Semana 10Juliana RodríguezAún no hay calificaciones

- Curso básico de teoría de númerosDe EverandCurso básico de teoría de númerosCalificación: 5 de 5 estrellas5/5 (2)

- Espinozagalindo Ev2.2Documento3 páginasEspinozagalindo Ev2.2Francisco EspinozaAún no hay calificaciones

- Análisis y Selección de Candidato para Un PuestoDocumento6 páginasAnálisis y Selección de Candidato para Un PuestoFrancisco EspinozaAún no hay calificaciones

- Lab RC - Caso Estudio 2Documento15 páginasLab RC - Caso Estudio 2Francisco EspinozaAún no hay calificaciones

- C LabRC - PIADocumento5 páginasC LabRC - PIAFrancisco EspinozaAún no hay calificaciones

- Cap.2 LCC - RCDocumento66 páginasCap.2 LCC - RCFrancisco EspinozaAún no hay calificaciones

- Tarea 2Documento7 páginasTarea 2Francisco EspinozaAún no hay calificaciones

- Evidencia 1Documento12 páginasEvidencia 1Francisco EspinozaAún no hay calificaciones

- Actividad SelectDocumento2 páginasActividad SelectFrancisco EspinozaAún no hay calificaciones

- Tarea 1Documento6 páginasTarea 1Francisco EspinozaAún no hay calificaciones

- SOLUCION DE CASOS 2 ProbabilidadDocumento2 páginasSOLUCION DE CASOS 2 ProbabilidadFrancisco EspinozaAún no hay calificaciones

- SOLUCION DE CASOS 4 Esperanza MatemáticaDocumento2 páginasSOLUCION DE CASOS 4 Esperanza MatemáticaFrancisco EspinozaAún no hay calificaciones

- Actividad 1Documento5 páginasActividad 1Francisco EspinozaAún no hay calificaciones

- SOLUCION DE CASOS 1 Tratamiento de DatosDocumento1 páginaSOLUCION DE CASOS 1 Tratamiento de DatosFrancisco EspinozaAún no hay calificaciones

- SOLUCION DE CASOS 3 Distribuciones de ProbabilidadDocumento3 páginasSOLUCION DE CASOS 3 Distribuciones de ProbabilidadFrancisco EspinozaAún no hay calificaciones

- Fdocuments - Co - Curso Wrac 1Documento36 páginasFdocuments - Co - Curso Wrac 1carlosAún no hay calificaciones

- Leche de almendras y frutilla saludableDocumento49 páginasLeche de almendras y frutilla saludableConsuelo Cabrera VallejosAún no hay calificaciones

- Procesos EstocásticosDocumento49 páginasProcesos EstocásticosSusana Maria Encina0% (1)

- Distribucio Hipergeométrica EstadisticaDocumento17 páginasDistribucio Hipergeométrica EstadisticaDulce ArismendyAún no hay calificaciones

- Elementos EstadísticaDocumento24 páginasElementos EstadísticaHillary Torres MoraAún no hay calificaciones

- GUIA N - 1 Probabilidades y Estadísticas - Capitulo 2Documento3 páginasGUIA N - 1 Probabilidades y Estadísticas - Capitulo 2Paulina MoragaAún no hay calificaciones

- ACT. 09 EJERCICIOS DE MEDIA POBLACIONAL Modificado PDFDocumento9 páginasACT. 09 EJERCICIOS DE MEDIA POBLACIONAL Modificado PDFEdgar Anaya LopezAún no hay calificaciones

- Ejercicios Repaso PEFDocumento7 páginasEjercicios Repaso PEFnikoAún no hay calificaciones

- Propiedad Reproductiva de La Distribución NormalDocumento8 páginasPropiedad Reproductiva de La Distribución NormalRyutarobot100% (1)

- S08 La Distribucion NormalDocumento61 páginasS08 La Distribucion NormalSaul Gonzales AlarconAún no hay calificaciones

- Actividad 5 El Juego y El AzarDocumento7 páginasActividad 5 El Juego y El AzarKaren CerqueraAún no hay calificaciones

- Diagrama de ArbolDocumento16 páginasDiagrama de ArbolRonier Grabiel Marchan Aponte100% (1)

- Prueba de Síntesis Datos Quinto BásicoDocumento2 páginasPrueba de Síntesis Datos Quinto BásicoAnonymous lSZUBys7uAún no hay calificaciones

- Ilovepdf MergedDocumento22 páginasIlovepdf MergedMariaAún no hay calificaciones

- Examen final - Semana 8Documento6 páginasExamen final - Semana 8PAOLA MEDINAAún no hay calificaciones

- Eventos IndependientesDocumento4 páginasEventos IndependientesJez HernandezAún no hay calificaciones

- Metodología de OrtodoxiaDocumento11 páginasMetodología de OrtodoxiaCarolina RoseteAún no hay calificaciones

- 800-16400-Dco-Gt-75-2015 Guia Arp 2015Documento169 páginas800-16400-Dco-Gt-75-2015 Guia Arp 2015juan perezAún no hay calificaciones

- Probabilidad e Inferencia Básica: Taller IV de Diplomado UNCDocumento2 páginasProbabilidad e Inferencia Básica: Taller IV de Diplomado UNCalvaro alfonsoAún no hay calificaciones

- Teorema de Bayes y MatrizDocumento5 páginasTeorema de Bayes y MatrizMichelle ZúñigaAún no hay calificaciones

- Trabajo Final Grupo 4Documento23 páginasTrabajo Final Grupo 4Alfredo Jose LimaAún no hay calificaciones

- Talleres MatematicasDocumento37 páginasTalleres MatematicasJuan100% (1)

- Taller I-Psicologà - ADocumento3 páginasTaller I-Psicologà - ALina RojasAún no hay calificaciones

- Soluciones Ejercicios UD 1Documento27 páginasSoluciones Ejercicios UD 1Jorge Sanz SanfructuosoAún no hay calificaciones

- Practica n06 Prueba de PreferenciaDocumento14 páginasPractica n06 Prueba de PreferenciaEstrella LoreñoAún no hay calificaciones

- 54 Doc Distribuciones de Probabilidad Casos PracticosDocumento5 páginas54 Doc Distribuciones de Probabilidad Casos Practicosjulisan_22Aún no hay calificaciones

- Modelos Markov trayectoria estudiantes UJATDocumento15 páginasModelos Markov trayectoria estudiantes UJATMarcelo GutierrezAún no hay calificaciones

- Istribuciones de Probabilidad Aplicado A Confiabilidad: Presentado Por: M.Sc. Ing. Dheybi Cervan Dcervanp@uni - PeDocumento66 páginasIstribuciones de Probabilidad Aplicado A Confiabilidad: Presentado Por: M.Sc. Ing. Dheybi Cervan Dcervanp@uni - PeDheybi CervanAún no hay calificaciones

- Ejercicios Referencia PERT CPM DesarrolloDocumento14 páginasEjercicios Referencia PERT CPM DesarrolloJoaquin Torres0% (1)