0% encontró este documento útil (0 votos)

110 vistas9 páginasAnálisis de Regresión y Correlación

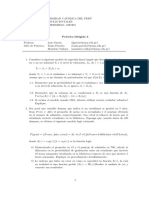

Este documento presenta el análisis de regresión lineal de un conjunto de datos con 11 observaciones de temperatura (X) y precio (Y). Se calculan las estadísticas descriptivas, el coeficiente de correlación de Pearson (r=-0.896) y los parámetros del modelo de regresión lineal (β0=58.48, β1=-0.15). El modelo es estadísticamente significativo (p<0.0001) y explica el 80% de la varianza de Y. Se construyen intervalos de confianza y predicción para probar la validez del

Cargado por

Diego AlejandroDerechos de autor

© © All Rights Reserved

Nos tomamos en serio los derechos de los contenidos. Si sospechas que se trata de tu contenido, reclámalo aquí.

Formatos disponibles

Descarga como DOCX, PDF, TXT o lee en línea desde Scribd

0% encontró este documento útil (0 votos)

110 vistas9 páginasAnálisis de Regresión y Correlación

Este documento presenta el análisis de regresión lineal de un conjunto de datos con 11 observaciones de temperatura (X) y precio (Y). Se calculan las estadísticas descriptivas, el coeficiente de correlación de Pearson (r=-0.896) y los parámetros del modelo de regresión lineal (β0=58.48, β1=-0.15). El modelo es estadísticamente significativo (p<0.0001) y explica el 80% de la varianza de Y. Se construyen intervalos de confianza y predicción para probar la validez del

Cargado por

Diego AlejandroDerechos de autor

© © All Rights Reserved

Nos tomamos en serio los derechos de los contenidos. Si sospechas que se trata de tu contenido, reclámalo aquí.

Formatos disponibles

Descarga como DOCX, PDF, TXT o lee en línea desde Scribd