Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Introducción A Las Redes Neuronales

Introducción A Las Redes Neuronales

Cargado por

Otaku ZoneTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

Introducción A Las Redes Neuronales

Introducción A Las Redes Neuronales

Cargado por

Otaku ZoneCopyright:

Formatos disponibles

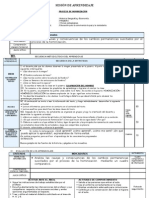

INTRODUCCIN A LAS

REDES NEURONALES

Definicin

Una red neuronal artificial es una herramienta diseada

para emular la forma en que el cerebro humano funciona.

Cmo funciona el cerebro humano ?

Cmo aprende el ser humano ?

Dnde se guarda el conocimiento ?

Por qu es tan eficiente el cerebro humano ?

Introduccin

El cerebro humano est compuesto por una gran cantidad

de elementos bsicos denominados neuronas

Bsicamente las neuronas

estn formadas por:

Un cuerpo central o

Ncleo

Un mecanismo de

conexin con otras

neuronas (sinapsis):

Axn y dendritas

Introduccin

Los estmulos recibidos en el cerebro son transmitidos

entre las neuronas mediante las conexiones sinpticas.

Cuando una neurona es estimulada libera una pequea

cantidad de un componente qumico (neurotransmisor).

Este viaja a travs del axn hasta llegar a las dendritas

de otras neuronas en las cuales el proceso se repite.

Este proceso sirve para incrementar o disminuir la

relacin entre las neuronas involucradas en el.

As, ante un determinado estmulo ciertas neuronas se

activan y otras se inhiben.

Introduccin

Emulando entonces el funcionamiento del cerebro

construiremos redes neuronales artificiales

interconectando elementos de procesamiento ms

bsicos como las neuronas.

Para entender las redes neuronales artificiales es

necesario entender y modelar las unidades ms bsicas

o neuronas artificiales.

Redes Neuronales Artificiales

Is a massive parallel distributed processor that has a

natural propensity for storing experimental knowledge and

making available for use (Haykin, 1994).

Cmo puede ser el cerebro tan eficiente ?

Por la enorme cantidad de neuronas (aprox. 100 billones)

y la manera en que estn interconectadas (aprox. 60

trillones de sinapsis).

Por la capacidad de organizarse, construir reglas y

aprender de la experiencia

Beneficios de usar RNA

Generalizacin: Capacidad para producir respuestas

razonables a estmulos no presentados durante su

entrenamiento.

Adaptabilidad: La red puede ser construida para adaptar

sus pesos sinpticos al medio ambiente (reentrenar).

Robusta: Por su carcter distributivo, una red maneja

muy bien daos a su estructura (ruido).

Complejidad: Puede capturar comportamiento complejo

que no es posible con mtodos tradicionales.

No-paramtrico: No hace suposiciones a priori.

El perceptrn

El Perceptrn

El perceptrn es la red neuronal ms simple que existe.

Cada Neurona precisa tantas entradas como la

dimensin del patrn de entrada.

La entrada neta se calcula como la suma ponderada de

todos los pesos.

Neurona de Una sola entrada

El Perceptrn

El perceptrn

El perceptrn

Los estmulos se consideran Vectores (

1

,

2

,

2,

)

Cuando se recibe el estmulo, cada entrada de

este es multiplicada por el correspondiente peso

sinptico de la dendrita que recibe dicho valor, y

luego cada uno de estos resultados se suman.

(Sencillo no?).

El perceptrn

A esto se le conoce como el net y est definido como:

=

1

1

+

2

2

+

+

Resumiendo

= +

El Perceptrn

El estmulo es procesado en el ncleo mediante la

operacin:

Donde es el parmetro o funcin de activacin.

b es un parmetro de sesgo mejor conocido como bias.

El Perceptrn

Funcin de Activacin

La funcin de activacin se utiliza para limitar el rango de

valores de la respuesta de la neurona.

Generalmente los rangos de valores se limitan a [0,1] o [-1,1],

sin embargo otros rangos son posibles de acuerdo a la

aplicacin o problema a resolver.

Existen diversas funciones de activacin y la decisin entre

una u otra depender nuevamente de la aplicacin o problema

a resolver.

Existen funciones de activacin comnmente utilizadas y con

las cuales se han obtenido resultados satisfactorios en

diversas aplicaciones.

Algunas funciones de Activacin

Limitador Fuerte(hardlim) o funcin escaln.

Modificacin a hardlim

Ambas son funciones agresivas, la modificacin se

realiza por que es posible que la funcin se indetermine

en 0.

Funciones de Activacin

Funcin de transferencia sigmoidal o sigmoide: Est

funcin toma los valores de entrada los cuales pueden

oscilar entre mas infinito y menos infinito y restringe la

salida a 0 y 1 de acuerdo a la siguiente expresion:

Acerca de los pesos

Recordemos que los pesos sinpticos sirven para

guardar el conocimiento adquirido.

En analoga con el funcionamiento del cerebro, los

valores de los pesos sinpticos se obtienen mediante un

proceso de aprendizaje.

Bsicamente existen 2 tipos de Aprendizaje:

Aprendizaje supervisado (Supervised learning)

Aprendizaje no supervisado (Non supervised learning)

Existen muchos algoritmos de entrenamiento, nuestros

entrenamientos de basaran en el :

Error correction learning o delta rule: es un aprendizaje

supervisado,en donde se usa el error obtenido en la

presentacin del estmulo para determinar el factor de

correccin de los pesos y del bias.

Error correction learning o delta rule

Se utiliza bajo un paradigma de entrenamiento

supervisado.La respuesta de la red neuronal se compara

con la respuesta deseada y el error cometido se utiliza

para modificar los pesos sinpticos.

=

=

Algunos autores proponen un parmetro como

factor de aprendizaje de error.

Qu tipos de problemas se pueden

resolver?

Aquellos problema que sean linealmente separables

(perceptrn simple).

Asociacin de patrones: escritura. La red es presentada

con muchos ejemplos de un patrn hasta guardar el

patrn, luego al ser presentado una versin con ruido

esta es capaz de reconocer el patrn.

Clasificacin: una la red es entrenada con ejemplos de

clasificacin conocida.

También podría gustarte

- Manual Operacion Case 621e PDFDocumento213 páginasManual Operacion Case 621e PDFRamon Arredondo100% (16)

- Solucionario Ficha 10Documento9 páginasSolucionario Ficha 10hectorAún no hay calificaciones

- Asignación 8. Investigación Sobre ProducciónDocumento3 páginasAsignación 8. Investigación Sobre ProducciónCarolinaPadilla0% (1)

- Amortiguador Trasero B7R MarcopoloDocumento3 páginasAmortiguador Trasero B7R Marcopolocarlos javierAún no hay calificaciones

- Microlite20 - Reglamento BásicoDocumento8 páginasMicrolite20 - Reglamento BásicoEmyFloridoAún no hay calificaciones

- 2012-Falla Local Debido A La Acción Del Viento de Una CubiertaDocumento18 páginas2012-Falla Local Debido A La Acción Del Viento de Una CubiertaCUAUHTEMOC RAFAEL HERNÁNDEZ SIBAJAAún no hay calificaciones

- Practica 3Documento4 páginasPractica 3Jhonatan CáceresAún no hay calificaciones

- Lagunas de EstabilizaciónDocumento25 páginasLagunas de EstabilizaciónAngelica RosaAún no hay calificaciones

- Anexo 66. Resultados Convocatoria 737 de 2015 de Colciencias 1Documento345 páginasAnexo 66. Resultados Convocatoria 737 de 2015 de Colciencias 1Cristian Ocampo TorresAún no hay calificaciones

- Informe Sistemas Integrados de GestionDocumento117 páginasInforme Sistemas Integrados de GestionGeraldine Pardo MariluzAún no hay calificaciones

- Activacion de Un Circuito de Doble EfectoDocumento8 páginasActivacion de Un Circuito de Doble EfectoAdrian Chacon MolinaAún no hay calificaciones

- Regulación de Vale PilotosDocumento14 páginasRegulación de Vale Pilotosdardo100% (1)

- Tecnica ABC o Analisis de ParetoDocumento10 páginasTecnica ABC o Analisis de ParetoGladis Esther Solano CotoAún no hay calificaciones

- CV - Delgado Aguirre Luis - 2018 PDFDocumento2 páginasCV - Delgado Aguirre Luis - 2018 PDFjeshua91545193Aún no hay calificaciones

- Llach - Dependencia, Procesos Sociales y Control Del Estado en La Década Del TreintaDocumento12 páginasLlach - Dependencia, Procesos Sociales y Control Del Estado en La Década Del TreintaJoshua RogersAún no hay calificaciones

- Pia Arqui - ReporteDocumento19 páginasPia Arqui - ReporteDavid AlvarezAún no hay calificaciones

- PLC PicDocumento7 páginasPLC Pictrix66Aún no hay calificaciones

- 0109 4026Documento42 páginas0109 4026jccuingenieroAún no hay calificaciones

- Anexo 20 Catálogo de Oferta Complementaria Del Sena PDFDocumento61 páginasAnexo 20 Catálogo de Oferta Complementaria Del Sena PDFcarooplAún no hay calificaciones

- Memoria Tijerales FinalDocumento84 páginasMemoria Tijerales FinalGabishh ZouisAún no hay calificaciones

- Diseño de Elementos Sometidos A Cargas AxialesDocumento15 páginasDiseño de Elementos Sometidos A Cargas AxialesRonald VasquezAún no hay calificaciones

- Colores Señales VerticalesDocumento1 páginaColores Señales VerticalesFlavio Calizaya mamaniAún no hay calificaciones

- Anexo 5 Rúbrica de Evaluación para El Proyecto DemostrativoDocumento6 páginasAnexo 5 Rúbrica de Evaluación para El Proyecto DemostrativoCinthya VerdezotoAún no hay calificaciones

- 0707 OpensatDocumento2 páginas0707 OpensatAlexander WieseAún no hay calificaciones

- Sesion 02Documento5 páginasSesion 02erjichaAún no hay calificaciones

- Manual de Fallas or BobcatDocumento391 páginasManual de Fallas or Bobcatljhon8344Aún no hay calificaciones

- Teléfono(s) : 6531323345Documento1 páginaTeléfono(s) : 6531323345Papeleria ReformaAún no hay calificaciones

- Temario SCA PDFDocumento23 páginasTemario SCA PDFGerardo Guzman CorreoAún no hay calificaciones

- JSA de SeguridadDocumento4 páginasJSA de SeguridadIvan VelazquezAún no hay calificaciones

- Laboratorio Plantas y Compensadores TodoDocumento9 páginasLaboratorio Plantas y Compensadores TodoChecho LopezAún no hay calificaciones