Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Red Neuronal Artificial

Cargado por

Roger Bendezu Cayllihua0 calificaciones0% encontró este documento útil (0 votos)

34 vistas6 páginasLas redes de neuronas artificiales son un paradigma de aprendizaje y procesamiento automático inspirado en la forma en que funciona el sistema nervioso de los animales. Se trata de un sistema de interconexión de neuronas que colaboran entre sí para producir un estímulo de salida.

Derechos de autor

© © All Rights Reserved

Formatos disponibles

PDF, TXT o lea en línea desde Scribd

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoLas redes de neuronas artificiales son un paradigma de aprendizaje y procesamiento automático inspirado en la forma en que funciona el sistema nervioso de los animales. Se trata de un sistema de interconexión de neuronas que colaboran entre sí para producir un estímulo de salida.

Copyright:

© All Rights Reserved

Formatos disponibles

Descargue como PDF, TXT o lea en línea desde Scribd

0 calificaciones0% encontró este documento útil (0 votos)

34 vistas6 páginasRed Neuronal Artificial

Cargado por

Roger Bendezu CayllihuaLas redes de neuronas artificiales son un paradigma de aprendizaje y procesamiento automático inspirado en la forma en que funciona el sistema nervioso de los animales. Se trata de un sistema de interconexión de neuronas que colaboran entre sí para producir un estímulo de salida.

Copyright:

© All Rights Reserved

Formatos disponibles

Descargue como PDF, TXT o lea en línea desde Scribd

Está en la página 1de 6

Red neuronal articial

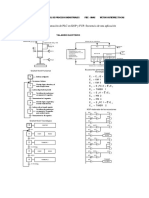

Red neuronal articial perceptrn multicapa con n neuronas de

entrada, m neuronas en su capa oculta y una neurona de escape.

Las redes de neuronas articiales (denominadas habi-

tualmente como RNA o en ingls como: ANN

[1]

) son

un paradigma de aprendizaje y procesamiento automtico

inspirado en la forma en que funciona el sistema nervio-

so de los animales. Se trata de un sistema de intercone-

xin de neuronas que colaboran entre s para producir un

estmulo de salida. En inteligencia articial es frecuente

referirse a ellas como redes de neuronas o redes neu-

ronales.

1 Historia

Los primeros modelos de redes neuronales datan de 1943

por los neurlogos McCulloch y Pitts. Aos ms tarde, en

1949, Donald Hebb desarroll sus ideas sobre el aprendi-

zaje neuronal, quedando reejado en la regla de Hebb.

En 1958, Rosemblatt desarroll el perceptrn simple, y

en 1960, Widrowy Ho desarrollaron el ADALINE, que

fue la primera aplicacin industrial real.

En los aos siguientes, se redujo la investigacin, debi-

do a la falta de modelos de aprendizaje y el estudio de

Minsky y Papert sobre las limitaciones del perceptrn.

Sin embargo, en los aos 80, volvieron a resurgir las RNA

gracias al desarrollo de la red de Hopeld, y en especial,

al algoritmo de aprendizaje de retropropagacin (Back-

Propagation) ideado por Rumelhart y McLellan en 1986

que fue aplicado en el desarrollo de los perceptrones mul-

ticapa.

[2]

2 Propiedades

Una red neuronal se compone de unidades llamadas neu-

ronas. Cada neurona recibe una serie de entradas a travs

Perceptrn con 2 entradas.

de interconexiones y emite una salida. Esta salida viene

dada por tres funciones:

1. Una funcin de propagacin (tambin conocida co-

mo funcin de excitacin), que por lo general consis-

te en el sumatorio de cada entrada multiplicada por

el peso de su interconexin (valor neto). Si el peso

es positivo, la conexin se denomina excitatoria; si

es negativo, se denomina inhibitoria.

2. Una funcin de activacin, que modica a la ante-

rior. Puede no existir, siendo en este caso la salida

la misma funcin de propagacin.

3. Una funcin de transferencia, que se aplica al va-

lor devuelto por la funcin de activacin. Se utiliza

para acotar la salida de la neurona y generalmente

viene dada por la interpretacin que queramos darle

a dichas salidas. Algunas de las ms utilizadas son la

funcin sigmoidea (para obtener valores en el inter-

valo [0,1]) y la tangente hiperblica (para obtener

valores en el intervalo [1,1]).

2.1 Diseo y programacin de una RNA

(red neuronal articial)

Con un paradigma convencional de programacin en

ingeniera del software, el objetivo del programador es

modelar matemticamente (con distintos grados de for-

malismo) el problema en cuestin y posteriormente for-

mular una solucin (programa) mediante un algoritmo

codicado que tenga una serie de propiedades que permi-

tan resolver dicho problema. En contraposicin, la apro-

ximacin basada en las RNA parte de un conjunto de da-

tos de entrada sucientemente signicativo y el objetivo

es conseguir que la red aprenda automticamente las pro-

piedades deseadas. En este sentido, el diseo de la red

tiene menos que ver con cuestiones como los ujos de

datos y la deteccin de condiciones, y ms que ver con

1

2 4 TIPOLOGA DE LAS RNA

cuestiones tales como la seleccin del modelo de red, la

de las variables a incorporar y el preprocesamiento de la

informacin que formar el conjunto de entrenamiento.

Asimismo, el proceso por el que los parmetros de la red

se adecuan a la resolucin de cada problema no se de-

nomina genricamente programacin sino que se suele

denominar entrenamiento neuronal.

Por ejemplo en una red que se va a aplicar al diagnstico

de imgenes mdicas; durante la fase de entrenamiento el

sistema recibe imgenes de tejidos que se sabe son can-

cergenos y tejidos que se sabe son sanos, as como las

respectivas clasicaciones de dichas imgenes. Si el en-

trenamiento es el adecuado, una vez concluido, el sistema

podr recibir imgenes de tejidos no clasicados y obte-

ner su clasicacin sano/no sano con un buen grado de

seguridad. Las variables de entrada pueden ser desde los

puntos individuales de cada imagen hasta un vector de

caractersticas de las mismas que se puedan incorporar al

sistema (por ejemplo, procedencia anatmica del tejido

de la imagen o la edad del paciente al que se le extrajo la

muestra).

2.2 Estructura

La mayora de los cientcos coinciden en que una RNA

es muy diferente en trminos de estructura de un cerebro

animal. Al igual que el cerebro, una RNA se compone de

un conjunto masivamente paralelo de unidades de proceso

muy simples y es en las conexiones entre estas unidades

donde reside la inteligencia de la red. Sin embargo, en

trminos de escala, un cerebro es muchsimo mayor que

cualquier RNA creada hasta la actualidad, y las neuronas

articiales tambin son ms simples que su contrapartida

animal.

Biolgicamente, un cerebro aprende mediante la reorga-

nizacin de las conexiones sinpticas entre las neuronas

que lo componen. De la misma manera, las RNA tienen

un gran nmero de procesadores virtuales interconecta-

dos que de forma simplicada simulan la funcionalidad

de las neuronas biolgicas. En esta simulacin, la reorga-

nizacin de las conexiones sinpticas biolgicas se mo-

dela mediante un mecanismo de pesos, que son ajustados

durante la fase de aprendizaje. En una RNA entrenada,

el conjunto de los pesos determina el conocimiento de esa

RNA y tiene la propiedad de resolver el problema para el

que la RNA ha sido entrenada.

Por otra parte, en una RNA, adems de los pesos y las co-

nexiones, cada neurona tiene asociada una funcin mate-

mtica denominada funcin de transferencia. Dicha fun-

cin genera la seal de salida de la neurona a partir de

las seales de entrada. La entrada de la funcin es la su-

ma de todas las seales de entrada por el peso asociado a

la conexin de entrada de la seal. Algunos ejemplos de

entradas son la funcin escaln de Heaviside, la lineal o

mixta, la sigmoide y la funcin gaussiana, recordando que

la funcin de transferencia es la relacin entre la seal de

salida y la entrada.

3 Ventajas

Las redes neuronales articiales (RNA) tienen muchas

ventajas debido a que estn basadas en la estructura del

sistema nervioso, principalmente el cerebro.

Aprendizaje: Las RNA tienen la habilidad de

aprender mediante una etapa que se llama etapa de

aprendizaje. Esta consiste en proporcionar a la RNA

datos como entrada a su vez que se le indica cul es

la salida (respuesta) esperada.

Auto organizacin: Una RNAcrea su propia repre-

sentacin de la informacin en su interior, quitndo-

le esta tarea al usuario.

Tolerancia a fallos: Debido a que una RNA alma-

cena la informacin de forma redundante, sta pue-

de seguir respondiendo de manera aceptable aun si

se daa parcialmente.

Flexibilidad: Una RNA puede manejar cambios no

importantes en la informacin de entrada, como se-

ales con ruido u otros cambios en la entrada (por

ejemplo si la informacin de entrada es la imagen

de un objeto, la respuesta correspondiente no sufre

cambios si la imagen cambia un poco su brillo o el

objeto cambia ligeramente).

Tiempo real: La estructura de una RNA es parale-

la, por lo cual si esto es implementado con compu-

tadoras o en dispositivos electrnicos especiales, se

pueden obtener respuestas en tiempo real.

4 Tipologa de las RNA

4.1 Modelos

Existe una serie de modelos que aparecen en la mayora

de estudios acadmicos y la bibliografa especializada.

Perceptrn

Adaline

Perceptrn multicapa

Memorias asociativas

Mquina de Boltzmann

Mquina de Cauchy

Propagacin hacia atrs (backpropagation)

Redes de Elman

4.4 Tipo de entrada 3

Redes de Hopeld

Red de contrapropagacin

Redes de neuronas de base radial

Redes de neuronas de aprendizaje competitivo

Mapas Autoorganizados (RNA) (Redes de Koho-

nen)

Crecimiento dinmico de clulas

Gas Neuronal Creciente

Redes ART (Adaptative Resonance Theory)

4.2 Topologa

Una primera clasicacin de las redes de neuronas arti-

ciales que se suele hacer es en funcin del patrn de co-

nexiones que presenta. As se denen tres tipos bsicos

de redes:

Dos tipos de redes de propagacin hacia delante

o acclicas en las que todas las seales van desde la

capa de entrada hacia la salida sin existir ciclos, ni

conexiones entre neuronas de la misma capa de red

neuronal y su clasicacin.

Monocapa. Ejemplos: perceptrn, Adaline.

Multicapa. Ejemplos: perceptrn multicapa.

Las redes recurrentes que presentan al menos

un ciclo cerrado de activacin neuronal. Ejemplos:

Elman, Hopeld, mquina de Boltzmann.

4.3 Aprendizaje

Una segunda clasicacin que se suele hacer es en fun-

cin del tipo de aprendizaje de que es capaz (si necesita

o no un conjunto de entrenamiento supervisado). Para ca-

da tipo de aprendizaje encontramos varios modelos pro-

puestos por diferentes autores:

Aprendizaje supervisado: necesitan un conjunto

de datos de entrada previamente clasicado o cuya

respuesta objetivo se conoce. Ejemplos de este tipo

de redes son: el perceptrn simple, la red Adaline,

el perceptrn multicapa, red backpropagation, y la

memoria asociativa bidireccional.

Aprendizaje no supervisado o autoorganizado:

no necesitan de tal conjunto previo. Ejemplos de es-

te tipo de redes son: las memorias asociativas, las

redes de Hopeld, la mquina de Boltzmann y la

mquina de Cauchy, las redes de aprendizaje com-

petitivo, las redes de Kohonen o mapas autoorgani-

zados y las redes de resonancia adaptativa (ART).

Redes hbridas: son un enfoque mixto en el que se

utiliza una funcin de mejora para facilitar la con-

vergencia. Un ejemplo de este ltimo tipo son las

redes de base radial.

Aprendizaje reforzado: se sita a medio camino

entre el supervisado y el autoorganizado.

4.4 Tipo de entrada

Finalmente tambin se pueden clasicar las RNAs segn

sean capaces de procesar informacin de distinto tipo en:

Redes analgicas: procesan datos de entrada con

valores continuos y, habitualmente, acotados. Ejem-

plos de este tipo de redes son: Hopeld, Kohonen y

las redes de aprendizaje competitivo.

Redes discretas: procesan datos de entrada de

naturaleza discreta; habitualmente valores lgicos

booleanos. Ejemplos de este segundo tipo de redes

son: las mquinas de Boltzmann y Cauchy, y la red

discreta de Hopeld.

5 Aplicaciones

Las caractersticas de las RNA las hacen bastante apro-

piadas para aplicaciones en las que no se dispone a priori

de un modelo identicable que pueda ser programado,

pero se dispone de un conjunto bsico de ejemplos de

entrada (previamente clasicados o no). Asimismo, son

altamente robustas tanto al ruido como a la disfuncin de

elementos concretos y son fcilmente paralelizables.

Esto incluye problemas de clasicacin y reconocimiento

de patrones de voz, imgenes, seales, etc. Asimismo se

han utilizado para encontrar patrones de fraude econ-

mico, hacer predicciones en el mercado nanciero, hacer

predicciones de tiempo atmosfrico, etc.

Tambin se pueden utilizar cuando no existen modelos

matemticos precisos o algoritmos con complejidad ra-

zonable, por ejemplo la red de Kohonen ha sido aplicada

con un xito ms que razonable al clsico problema del

viajante (un problema para el que no se conoce solucin

algortmica de complejidad polinmica).

Otro tipo especial de redes neuronales articiales se

ha aplicado en conjuncin con los algoritmos genticos

(AG) para crear controladores para robots. La discipli-

na que trata la evolucin de redes neuronales mediante

algoritmos genticos se denomina Robtica Evolutiva. En

este tipo de aplicacin el genoma del AG lo constituyen

los parmetros de la red (topologa, algoritmo de apren-

dizaje, funciones de activacin, etc.) y la adecuacin de

la red viene dada por la adecuacin del comportamiento

exhibido por el robot controlado (normalmente una simu-

lacin de dicho comportamiento).

4 9 ENLACES EXTERNOS

5.1 Ejemplos

5.1.1 Quake II Neuralbot

Un bot es un programa que simula a un jugador humano.

El Neuralbot es un bot para el juego Quake II que utiliza

una red neuronal articial para decidir su comportamien-

to y un algoritmo gentico para el aprendizaje. Es muy f-

cil probarlo para ver su evolucin. Ms informacin aqu

5.1.2 Clasicador No Sesgado de Protenas

Es un programa que combina diversas tcnicas compu-

tacionales con el objetivo de clasicar familias de

protenas. Un posible mtodo consiste en utilizar mtricas

adaptativas como por ejemplo: mapas autoorganizados y

algoritmos genticos.

El problema de clasicacin no sesgada basada en la ex-

presin de las protenas en Aminocidos puede reducirse,

conceptualmente, a lo siguiente:

La identicacin de grupos de protenas que com-

partan caractersticas comunes.

La determinacin de las razones estructurales por

las cuales las protenas en cuestin se agrupan de la

manera indicada.

Evitar la idea de establecer criterios de clasicacin

(sesgados) fundamentados en ideas preconcebidas

para lograr su clasicacin. En este sentido, hay dos

asuntos que considerar:

Cmo lograr la caracterizacin de las protenas

de manera no sesgada

Cmo lograr lo anterior sin apelar a medidas

de agrupamiento que, a su vez, impliquen al-

gn tipo de sesgo sobre dicho agrupamiento.

Las RNA han sido aplicadas a un nmero en aumento de

problemas en la vida real y de considerable complejidad,

donde su mayor ventaja es en la solucin de problemas

que son bastante complejos para la tecnologa actual, tra-

tndose de problemas que no tienen una solucin algort-

mica o cuya solucin algortmica es demasiado compleja

para ser encontrada.

En general, debido a que son parecidas a las del cerebro

humano, las RNA son bien nombradas ya que son buenas

para resolver problemas que el humano puede resolver

pero las computadoras no. Estos problemas incluyen el

reconocimiento de patrones y la prediccin del tiempo.

De cualquier forma, el humano tiene capacidad para el

reconocimiento de patrones, pero la capacidad de las re-

des neuronales no se ve afectada por la fatiga, condiciones

de trabajo, estado emocional, y compensaciones.

Se conocen cinco aplicaciones tecnolgicas extendidas:

1. Reconocimiento de textos manuscritos

2. Reconocimiento del habla

3. Simulacin de centrales de produccin de energa

4. Deteccin de explosivos

5. Identicacin de blancos de radares

6 Herramientas de software

Existen muchas herramientas de software que implemen-

tan redes neuronales articiales, tanto libres como comer-

ciales como, por ejemplo:

7 Vase tambin

Inteligencia articial

Dinmica de sistemas

Sistema complejo

Sistema dinmico

Robtica evolutiva

Conformacin de haces (beamforming)

Cerebro articial

8 Referencias

[1] Aunque en francs se utiliza el acrnimo ANN (de Ar-

ticial Neural Networks) para referirse a este campo de

la computacin en este artculo se utilizar su equivalente

castellano RNA.

[2] Redes de Neuronas Articiales, Redes de Neuronas Arti-

ciales, UC3M, RAI 2012.

9 Enlaces externos

Wikimedia Commons alberga contenido multi-

media sobre Red neuronal articialCommons.

Redes Neuronales Articiales - Implementacin con

C# (catellano)

Tutorial de la Universidad Politcnica de Madrid

(castellano)

Introduccin a las redes de neuronas articiales (cas-

tellano)

Artculos sobre redes neuronales articiales (ingls)

5

Sitio Web sobre redes neuronales articiales, ejem-

plos y aplicaciones (castellano)

Introduccin a las Redes Neuronales y sus Modelos

(castellano)

Sistema nervioso articial

Qu son las redes neuronales?(castellano)

6 10 TEXT AND IMAGE SOURCES, CONTRIBUTORS, AND LICENSES

10 Text and image sources, contributors, and licenses

10.1 Text

Red neuronal articial Fuente: http://es.wikipedia.org/wiki/Red_neuronal_artificial?oldid=77008635 Colaboradores: Joseaperez, Mo-

riel, Sauron, Nathan, Dodo, Yearofthedragon, Fortran, Ascnder, Sms, Rsg, Tostadora, Zorak, Tano4595, RGLago, Daniel G., Enric Naval,

Gengiskanhg, Cinabrium, Ecemaml, DamianFinol, Renabot, Petronas, JMPerez, Taichi, Emijrp, Rembiapo pohyiete (bot), Anrfernandez,

Alhen, Changcho, LuchoX, Yrbot, DerkeNuke, BOT-Superzerocool, Oscar ., Varano, Mortadelo2005, Icvav, GermanX, Lobillo, No s

qu nick poner, Claudiapat1, Maldoror, Alcojol, Lancaster, Paintman, Lionni, Tamorlan, CEM-bot, Pinar, Osepu, Rosarinagazo, Yo-

niG, Thijs!bot, Gngora, PabloGN, JAnDbot, Xavigivax, Juan renombrado, HiTe, Jorgenumata, NaBUru38, Humberto, Chabbot, Plux,

Cinevoro, Aibot, Technopat, Jose gueredo, Matdrodes, DJ Nietzsche, Muro Bot, Srbanana, Ensada, Cobalttempest, Beepath, Danypal-

ma1984, Manw, Chico512, Farisori, Danidvt, Nerika, BodhisattvaBot, UA31, AVBOT, Jorge.maturana, Trec, Saloca, Luckas-bot, Cayo-

Marcio, Gacpro, Finderlog, SuperBraulio13, Jkbw, Theboss edgar18, Ricardogpn, Botarel, Hprmedina, PatruBOT, Hombresigma, Hum-

befa, EmausBot, Alrik, Jcaraballo, WikitanvirBot, MerlIwBot, Pedromanuelbaeza, KLBot2, Ivanwalkesmc, Deu2000, Elvisor, JurgenNL,

Joma.huguet, Augt.pelle y Annimos: 163

10.2 Images

Archivo:Commons-logo.svg Fuente: http://upload.wikimedia.org/wikipedia/commons/4/4a/Commons-logo.svg Licencia: Public domain

Colaboradores: This version created by Pumbaa, using a proper partial circle and SVGgeometry features. (Former versions used to be slightly

warped.) Artista original: SVG version was created by User:Grunt and cleaned up by 3247, based on the earlier PNG version, created by

Reidab.

Archivo:Computer.Science.AI.Neuron.svg Fuente: http://upload.wikimedia.org/wikipedia/commons/f/f0/Computer.Science.AI.

Neuron.svg Licencia: CC-BY-SA-3.0 Colaboradores:

Artista original: User:Yearofthedragon

Archivo:RedNeuronalArtificial.png Fuente: http://upload.wikimedia.org/wikipedia/commons/6/64/RedNeuronalArtificial.png Licen-

cia: CC-BY-SA-3.0 Colaboradores: Originally from es.wikipedia; description page is/was here. Artista original: Original uploader was

Gengiskanhg at es.wikipedia

10.3 Content license

Creative Commons Attribution-Share Alike 3.0

También podría gustarte

- Manual para La Diagramación de ProcesosDocumento14 páginasManual para La Diagramación de ProcesosRoger Bendezu CayllihuaAún no hay calificaciones

- Leemos y Deducimos El Contenido Del Texto: ¿Cuáles Son Nuestros Derechos?Documento9 páginasLeemos y Deducimos El Contenido Del Texto: ¿Cuáles Son Nuestros Derechos?Roger Bendezu Cayllihua0% (1)

- SimiosDocumento3 páginasSimiosRoger Bendezu CayllihuaAún no hay calificaciones

- Kung LaoDocumento7 páginasKung LaoRoger Bendezu CayllihuaAún no hay calificaciones

- Mortal Kombat - ConquestDocumento20 páginasMortal Kombat - ConquestRoger Bendezu CayllihuaAún no hay calificaciones

- Ica CaracterizacionDocumento13 páginasIca CaracterizacionRoger Bendezu CayllihuaAún no hay calificaciones

- Ley 28858Documento3 páginasLey 28858Roger Bendezu CayllihuaAún no hay calificaciones

- Solucion Del Problema - RefineriasDocumento3 páginasSolucion Del Problema - RefineriasRoger Bendezu Cayllihua50% (2)

- 1ra Ley de La Termodinamica - Sistemas AbiertosDocumento10 páginas1ra Ley de La Termodinamica - Sistemas AbiertosEDGARDO MENDOZA ISUSQUIZAAún no hay calificaciones

- Enun y Sol Ext 2019-20Documento13 páginasEnun y Sol Ext 2019-20Alvaro MartiAún no hay calificaciones

- Emprendedores y EmpresasDocumento33 páginasEmprendedores y EmpresaszorleyAún no hay calificaciones

- Fundamentos Sobre Tenología de La Información para Las Ciencias Económicas (Primera Edición)Documento356 páginasFundamentos Sobre Tenología de La Información para Las Ciencias Económicas (Primera Edición)Sol SolAún no hay calificaciones

- Manufactura EsbeltaDocumento30 páginasManufactura EsbeltaRosalino Santiago Castillo100% (1)

- Unidad 03 Capacidad AproximadaDocumento33 páginasUnidad 03 Capacidad AproximadaBenjamin VasquezAún no hay calificaciones

- Tendencias Tgs KlirDocumento31 páginasTendencias Tgs KlirRicardo Pavez San Martin0% (1)

- 2Documento28 páginas2Edgard Larico InfaAún no hay calificaciones

- Enfoque Sistemico Fundamento PDFDocumento14 páginasEnfoque Sistemico Fundamento PDFjuanAún no hay calificaciones

- Madres SustitutasDocumento99 páginasMadres Sustitutasliliana zambrano narvaezAún no hay calificaciones

- Recom Comercial-1Documento10 páginasRecom Comercial-1MAURICIO ALEJANDRO CANDIA SALAZARAún no hay calificaciones

- Transferencia de Calor I - IC de Tubos ConcentricosDocumento11 páginasTransferencia de Calor I - IC de Tubos ConcentricosFabian CelisAún no hay calificaciones

- Informe Calor EspecificoDocumento5 páginasInforme Calor EspecificoMiguel López RestrepoAún no hay calificaciones

- Resumen Entropias Convencionales y Tercera LeyDocumento4 páginasResumen Entropias Convencionales y Tercera LeyAriana SosaAún no hay calificaciones

- EcosistemasDocumento11 páginasEcosistemasMonique Grc MngAún no hay calificaciones

- Programacion Controladores Logicos Capitulo 7Documento21 páginasProgramacion Controladores Logicos Capitulo 7Juan RobertoAún no hay calificaciones

- Ejercicios ResueltosDocumento19 páginasEjercicios ResueltosNazareno ZivelonghiAún no hay calificaciones

- Formulario TermodinámicaDocumento3 páginasFormulario TermodinámicaElizabeth CarbarinAún no hay calificaciones

- Actividad 1. Mapa MentalDocumento3 páginasActividad 1. Mapa MentalSamuel ValenzuelaAún no hay calificaciones

- Clausulas de La 1º A La 7º de 9001Documento45 páginasClausulas de La 1º A La 7º de 9001valentina silva garciaAún no hay calificaciones

- Evidencia AA2 EV01 Documento Conocer El Funcionamiento de Los Sistemas de Lazo Cerrado y Lazo AbiertoDocumento1 páginaEvidencia AA2 EV01 Documento Conocer El Funcionamiento de Los Sistemas de Lazo Cerrado y Lazo AbiertoJesus valencia vallejoAún no hay calificaciones

- Practica 7: Determinación de Coeficientes de Conductividad Térmica, de Conducción Natural y ForzadaDocumento19 páginasPractica 7: Determinación de Coeficientes de Conductividad Térmica, de Conducción Natural y ForzadaAngélica Ferreyra100% (1)

- Picado Ordoñez Johnny. Examen III PDFDocumento14 páginasPicado Ordoñez Johnny. Examen III PDFKripsy JandresAún no hay calificaciones

- Parcial Final Diego PrietoDocumento8 páginasParcial Final Diego PrietoDiegoLmtPrietoAún no hay calificaciones

- Automatizacion de ProcesosDocumento26 páginasAutomatizacion de Procesosmilner12Aún no hay calificaciones

- Sem 09 TermodinámicaDocumento35 páginasSem 09 TermodinámicaJhonatanRosalesVigil0% (1)

- 3 Medida Del Calor Latente de Fusión Del HieloDocumento10 páginas3 Medida Del Calor Latente de Fusión Del HieloNicole Machado TubiñezAún no hay calificaciones

- Controles de Lectura TMMDocumento2 páginasControles de Lectura TMMRenato Mauricio Choque MoranAún no hay calificaciones

- Calidad OperacionalDocumento3 páginasCalidad OperacionalZr BryAn PeñaAún no hay calificaciones

- Laboratorio6 - Diseño - Control PIDDocumento29 páginasLaboratorio6 - Diseño - Control PIDWilson MorochoAún no hay calificaciones