Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Monografia Minimos Cuadrados

Monografia Minimos Cuadrados

Cargado por

Luis QuintanaTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

Monografia Minimos Cuadrados

Monografia Minimos Cuadrados

Cargado por

Luis QuintanaCopyright:

Formatos disponibles

UNIVERSIDAD NACIONAL DEL CENTRO DEL PER

FACULTAD DE INGENIERIA QUMICA

DEPARTAMENTO ACADEMICO DE INGENIERIA

CATEDRATICO: Ing. JOSE POMALAYA VALDEZ

CATEDRA: CIENCIAS AMBIENTALES

ALUMNOS:

CONDOR VILLEGAS

BELTRAN ESTEBAN AMEUD

IZQUIERDO MENDOZA HELEN

MEZA RAMOS YOSELIN ROSSY

SEMESTRE: VII

HYO-2014

METODO DE LOS MINIMOS CUADRADOS

DEDICATORIA

El presente trabajo va dirigido a nuestros

padres por su esfuerzo y apoyo incondicional

y a nuestros maestros por brindarnos sus

conocimientos para nuestra formacin.

INTRODUCCIN

El mtodo de mnimos cuadrados tiene una larga historia que se remonta a los

principios del siglo XIX. En Junio de 1801, Zach, un astrnomo que Gauss

haba conocido dos aos antes, publicaba las posiciones orbitales del cuerpo

celeste Ceres, un nuevo pequeo planeta descubierto por el astrnomo

italiano G. Piazzi en ese mismo ao. Desafortunadamente, Piazzi slo haba

podido observar 9 grados de su rbita antes de que este cuerpo

desapareciese tras del sol. Zach public varias predicciones de su posicin

incluyendo una de Gauss que difera notablemente de las dems. Cuando

Ceres fue redescubierto por Zach en Diciembre de 1801 estaba casi

exactamente en donde Gauss haba predicho.

Aunque todava no haba revelado su mtodo, Gauss haba descubierto el

mtodo de mnimos cuadrados. En un trabajo brillante logr calcular la rbita

de Ceres a partir de un nmero reducido de observaciones, de hecho, el

mtodo de Gauss requiere slo un mnimo de 3 observaciones y todava es,

en esencia, el utilizado en la actualidad para calcular las rbitas.

MARCO TEORICO

METODO DE LOS MINIMOS CUADRADOS

Mnimos cuadrados es una tcnica de anlisis numrico enmarcada dentro de

la optimizacin matemtica, en la que, dados un conjunto de pares ordenados:

variable independiente, variable dependiente, y una familia de funciones, se

intenta encontrar la funcin continua, dentro de dicha familia, que mejor se

aproxime a los datos (un "mejor ajuste"), de acuerdo con el criterio de mnimo

error cuadrtico.

En su forma ms simple, intenta minimizar la suma de cuadrados de las

diferencias en las ordenadas (llamadas residuos) entre los puntos generados por

la funcin elegida y los correspondientes valores en los datos. Especficamente, se

llama mnimos cuadrados promedio(LMS) cuando el nmero de datos medidos es

1 y se usa el mtodo de descenso por gradiente para minimizar el residuo

cuadrado. Se puede demostrar que LMS minimiza el residuo cuadrado esperado,

con el mnimo de operaciones (por iteracin), pero requiere un gran nmero de

iteraciones para converger.

Desde un punto de vista estadstico, un requisito implcito para que funcione el

mtodo de mnimos cuadrados es que los errores de cada medida estn

distribuidos de forma aleatoria. El teorema de Gauss-Mrkov prueba que los

estimadores mnimos cuadrticos carecen de sesgo y que el muestreo de datos no

tiene que ajustarse, por ejemplo, a una distribucin normal.

Los modelos matemticos existentes en relacin con la estimacin de la poblacin

futura de una comunidad son muy numerosos y de complejidad muy variada. En

ellos se cuentan como datos las poblaciones actuales y pasadas y en ocasiones

otras variables tales como disponibilidad de suelo, posibilidades industriales,

situacin con respecto a las lneas de transporte, etc. En este apartado se

expondrn, tan slo, algunos de los ms simples y de ms frecuente aplicacin.

Para decidir cul de todos resulta ms adecuado al caso concreto que se est

estudiando es bsico el conocimiento de la ciudad y de sus afueras, su rea

comercial, el crecimiento de sus industrias y el estado de desarrollo de la comarca

circundante, por supuesto que los sucesos extraordinarios, como el imprevisto

desarrollo de una gran industria, trastornan todos los clculos sobre el futuro

crecimiento.

En otros casos resulta conveniente realizar un tanteo sobre el rea urbanizable

disponible o sobre la previsiblemente urbanizada, a este respecto se puede

estimar una densidad conociendo densidad actual, la dinmica de la zona aledaa

y considerando usos comerciales e industriales, segn la tipologa de la ciudad;

eso s, acordes con las normas urbansticas, planes de desarrollo, planes de

ordenamiento territorial, etc. Sin embargo, resulta ms difcil prever la tendencia al

incremento o a la disminucin de la densidad actual y as una zona residencial

actual puede transformarse en un futuro relativamente prximo en una zona

comercial o fabril.

As mismo deben considerarse las posibilidades de migracin hacia el lugar, las

actividades que representen la poblacin flotante y si existen etnias minoritarias,

se requiere de un estudio individual.

Los datos sobre la poblacin presente y pasada pueden obtenerse de diversas

fuentes la ms importante es sin duda el censo que se realiza cada cierto tiempo,

en aos intermedios el censo suele actualizarse simplemente atendiendo al

movimiento demogrfico y de defunciones, aunque esto depende de cada

municipio, por lo que en municipios de apreciable dinmica migratoria son poco

fiables. En estos aos intermedios puede obtenerse informacin por varios

mtodos, tales como cmaras de comercio, listas de votantes, servicios pblicos y

sucursales bancarias. As mismo pueden establecerse correlaciones con otros

parmetros, tales como la poblacin infantil escolarizada o el nmero de abonados

telefnicos.

En general de los mtodos de estimacin de la poblacin futura que van a

describirse, no puede esperarse gran exactitud y debe tenerse en cuenta que

dicha exactitud, disminuye cuando:

El periodo de tiempo de la previsin aumenta.

La poblacin de la zona disminuye

Aumenta la velocidad de variacin de la poblacin.

Mnimos cuadrados ordinarios

En estadstica, los mnimos cuadrados ordinarios (MCO) o mnimos cuadrados

lineales es el nombre de un mtodo para encontrar los parmetros poblacionales

en un modelo de regresin lineal. Este mtodo minimiza la suma de las distancias

verticales entre las respuestas observadas en la muestra y las respuestas del

modelo. El parmetro resultante puede expresarse a travs de una frmula

sencilla, especialmente en el caso de un nico regresionador.

El mtodo MCO, siempre y cuando se cumplan los supuestos clave, ser

consistente cuando los regresionadores sean exgenos y no haya perfecta

multicolinealidad, este ser ptimo en la clase de parmetros lineales cuando los

errores sean homocedsticos y adems no haya autocorrelacin. En estas

condiciones, el mtodo de MCO proporciona un estimador insesgado de varianza

mnima siempre que los errores tengan varianzas finitas. Bajo la suposicin

adicional de que los errores se distribuyen normalmente, el estimador MCO es el

de mxima verosimilitud. Los MCO se utilizan en economa (econometra) y en la

ingeniera elctrica (teora de control y procesamiento de seales), entre muchas

reas de aplicacin.

Modelo Lineal

Supongamos que los datos se componen de n observaciones { y

i, xi }ni=1. Cada observacin incluye una respuesta y

i

escalar y un vector de

regresores o predictores x

i

. En un modelo de regresin lineal la variable de

respuesta es una funcin lineal de p variables explicativas:

donde es un vector de parmetros desconocidos p1 ;

i

es un escalar de

variables no observadas aleatorias (errores) que dan cuenta de la discrepancia

entre la realidad observada y

i

y los "resultados previstos" x

i

, y denota la matriz

transpuesta, de modo que x es el producto escalar entre los vectores x y el .

Este modelo tambin se puede escribir en notacin matricial como

en donde donde y y son vectores n, y X es una matriz de regresores np , a lo

que tambin se le llama la matriz de diseo. Como regla general, el trmino

constante se incluye siempre en el conjunto de regresores X, por ejemplo,

mediante la adopcin dex

i1

= 1 para todo i = 1, , n. El coeficiente

1

correspondiente a este regresor se le llama el intercepto. Puede haber alguna

relacin entre los regresores. Por ejemplo, el regresor tercero puede ser el

cuadrado del segundo regresor. En este caso (suponiendo que el primer regresor

es constante) tenemos un modelo de segundo grado en el regresor segundo. Pero

esto todava se considera un modelo lineal, ya que es lineal en las s.

Supuestos clave

Existen tres supuestos que deben cumplirse para llevar a cabo una regresin

lineal, estos son:

1. La varianza de los errores debe ser homocedastica.

2. Las variables explicativas deben ser ortogonales a los residuos, es decir, no

comparten informacin.

3. Los errores no deben estar correlacionados entre s.

Hay varios diferentes marcos en los que el modelo de regresin lineal pueden ser

tratado con el fin de hacer que la tcnica de MCO sea aplicable. Cada una de

estas configuraciones produce las mismas frmulas y los mismos resultados, la

nica diferencia es la interpretacin y los supuestos que han de imponerse a fin de

que el mtodo pueda dar resultados significativos. La eleccin de la estructura

aplicable depende principalmente de la naturaleza de los datos a la mano, y en la

tarea de inferencia que se tiene que realizar.

Una de las lneas de diferencia en la interpretacin es si tratar los regresores como

variables aleatorias, o como constantes predefinidas. En el primer caso ("diseo

aleatorio) los regresores de x

i

son aleatorios y se toman muestras del conjunto con

los y

i

de alguna poblacin, como en un estudio observacional. Este enfoque

permite un estudio ms natural de las propiedades asintticas de los estimadores.

En la otra interpretacin (diseo fijo), los regresores de X se tratan como

constantes conocidas establecidas por un diseo, y y se muestrea

condicionalmente en los valores de X como en un experimento. A efectos

prcticos, esta distincin a menudo carece de importancia, ya que la estimacin y

la inferencia se lleva a cabo mientras se condiciona en X. Todos los resultados

consignados en este artculo se encuentran dentro del marco de diseo aleatorio.

Modelo clsico de regresin lineal

El modelo clsico se centra en las "muestras finitas" estimacin y la inferencia, lo

que significa que el nmero de observaciones n es fijo. Esto contrasta con otros

enfoques, que estudian el comportamiento asinttico de OLS, y en el que el

nmero de observaciones se hace tender hasta el infinito.

Especificacin Correcta. La forma funcional lineal se ha especificado

correctamente.

Exogeneidad estricta..Los errores en la regresin deben tener media

condicionada cero.

1

La consecuencia inmediata de la hiptesis de exogeneidad es que los

errores han significar cero: E[] = 0, y que los regresores no estn

correlacionadas con los errores: E[X] = 0. El supuesto de exogeneidad es

fundamental para la teora de MCO. Si se mantiene entonces las variables

regresoras se llaman exgeno. Si no es as, entonces los regresores que

estn correlacionadas con el trmino de error se llaman endgenas,

2

y

luego las estimaciones MCO dejan de ser vlidas. En tal caso, el mtodo de

variables instrumentales se pueden utilizar para llevar a cabo la inferencia.

No hay dependencia lineal.. Los regresores en X todos deben ser

linealmente independientes. Matemticamente esto significa que la matriz X

deber tener rango de columna completa prcticamente segura.

Por lo general, se supone tambin que los regresores tienen momentos

finitos de hasta al menos segundo. En tal caso, la matriz Qxx = E [X'X / n]

ser finita y positiva semi-definido. Cuando esta suposicin se viola los

regresores se llama linealmente dependiente o multicollinear

perfectamente. En tal caso, el valor de la coeficiente de regresin no

puede aprenderse, aunque prediccin de los valores de y es posible que los

nuevos valores de las variables independientes que se encuentran en el

mismo subespacio linealmente dependientes.

Errores esfricos

2

donde A es un n n matriz de identidad, y 2 es un parmetro que

determina la varianza de cada observacin. Esta 2 se considera un

parmetro molestia en el modelo, aunque por lo general, se estima. Si esta

suposicin se viola entonces los estimadores MCO siguen siendo vlidos,

pero ya no es eficaz. Es costumbre de dividir esta suposicin en dos partes:

o Homocedasticidad :E [i2 | X] = 2, lo que significa que el trmino

de error tiene la misma varianza 2 en cada observacin. Cuando

este requisito se viola esto se llama heterocedasticidad, en tal caso,

un estimador ms eficiente sera mnimos cuadrados ponderados. Si

los errores tienen varianza infinita entonces las estimaciones MCO

tambin tendr varianza infinita (aunque por la ley de los grandes

nmeros que no obstante se tienden hacia los valores verdaderos,

siempre que los errores tienen media cero). En este caso, tcnicas

robustas de estimacin se recomiendan.

o Autocorrelacin no:los errores no estn correlacionados entre

observaciones: E [ij | X] = 0 para i j. Este supuesto puede ser

violado en el contexto de los datos de series de tiempo, datos de

panel, muestras de racimo, datos jerrquicos, datos de medidas

repetidas, datos longitudinales, y otros datos con dependencias. En

tales casos, mnimos cuadrados generalizados ofrece una mejor

alternativa que el OLS.

o Normality: A veces se supone, adems, que los errores tienen

distribucin normal multivariante distribucin normal condicional en

los regresores:

Este supuesto no es necesario para la validez del mtodo OLS, aunque

ciertos muestra adicionales finita propiedades se pueden establecer en el

caso cuando lo hace (especialmente en el rea de las pruebas de

hiptesis). Tambin cuando los errores son normales, el estimador MCO es

equivalente a MLE de mxima probabilidad, y por lo tanto es

asintticamente eficiente en la clase de todos los estimadores regulares.

Independiente e idnticamente distribuido

En algunas aplicaciones, especialmente con datos de corte transversal, un

supuesto adicional es impuesto - que todas las observaciones son

independientes e

idnticamente distribuidas (iid). Esto significa que todas las observaciones

se toman de una muestra aleatoria que hace que todos los supuestos

mencionados anteriormente sean ms simples y ms fciles de interpretar.

Adems, este marco permite establecer resultados asintticos (como el

tamao de la muestra n ), que se entiende como una posibilidad terica

de ir a tener nuevas observaciones independientes de los datos en un

proceso de generacin de datos. La lista de las hiptesis en este caso es:

o Observaciones iid: (x

i

, y

i

) son independientes entre si, y tiene la

misma distribucin, x

j

, y

j

) para todo i j;

o Hay multicolinealidad perfecta: Q

xx

= E[ x

i

x

i

] es una matriz

indefinida positiva ;

o Endogeneidad: E[

i

| x

i

] = 0;

o Heterocedasticidad: Var[

i

| x

i

]

2

.

Modelo de series de tiempo

o El proceso estocstico {x

i

, y

i

} es estacionario y ergdica ;

o Los regresores estn predeterminados: E[x

i

i

] = 0 for all i = 1, ,

n;

o La pp matriz Q

xx

es de rango completo, y por lo tanto definida

positiva ;

o {x

i

i

} es una secuencia de diferencia martingala , con una matriz finita

de segundos momentos Q

xx

= E[

i

2

x

i

x

i

].

Estimacin

Supongamos que b es un valor de "candidato" para el parmetro . La

cantidad y

i

x

i

b se denomina residual para la i-sima observacin, mide la

distancia vertical entre el punto de datos (x

i

, y

i

) y el hiperplano y = xb, y por

lo tanto se determina el grado de ajuste entre los datos reales y el modelo.

La suma de cuadrados de los residuos (SSR) (tambin llamada la suma de

cuadrados del error (ESS) o suma residual de cuadrados (RSS))

3

es una

medida del ajuste del modelo general:

donde T denota la matriz de transposicin . El valor de b que minimiza esta

suma se llama el estimador MCO de . La funcin S (b) es cuadrtica en b

con definida positiva de Hesse , y por lo tanto esta funcin posee un mnimo

global nico en , Que puede ser dada por la frmula explcita:

4

o de manera equivalente en forma de matriz,

Despus hemos estimado , los valores ajustados (o valores previstos) de

la regresin se

donde P = X (X T X) -1 X T es la matriz de proyeccin en el espacio

generado por las columnas de X. Esta matriz P tambin a veces se llama la

matriz sombrero porque "pone un sombrero" a la variable y. Otra matriz,

estrechamente relacionado con P es el aniquilador matriz M = I n - P, se

trata de una matriz de proyeccin sobre el espacio ortogonal a X. Tanto las

matrices P y M son simtricas y idempotente (lo que significa que P 2 = P),

y se refieren a la matriz de datos X a travs de identidades PX y MX = X =

0. [7] Matriz M crea los residuos de la regresin:

El uso de estos residuos se puede estimar el valor de

2

:

El numerador, np, son los grados de libertad estadsticos . La primera

cantidad, s 2, es la estimacin OLS para 2, mientras que el segundo, \

Scriptstyle \ hat \ sigma ^ 2 , Es la estimacin MLE para 2. Los dos

estimadores son bastante similares en muestras grandes, el primero es

siempre imparcial , mientras que el segundo est sesgado, pero reduce al

mnimo el error cuadrtico medio del estimador. En la prctica s 2 se utiliza

con ms frecuencia, ya que es ms conveniente para la prueba de

hiptesis. La raz cuadrada de 2 s se denomina el error estndar de la

regresin (SER), o el error estndar de la ecuacin (VER).

5

Es comn para evaluar la bondad del ajuste de la regresin por mnimos

cuadrados mediante la comparacin de la cantidad de la variacin inicial en

la muestra se puede reducir mediante la regresin en X. El coeficiente de

determinacin R 2 se define como una proporcin de "explicado" varianza

de la varianza "total" de la variable dependiente y: [8]

donde TSS es la suma total de los cuadrados de la variable dependiente, L

= I n - 11 '/ n, y 1 es una n 1 vector de unos. (L es un "matriz de centrado",

que es equivalente a la regresin en una constante;. Simplemente resta la

media de una variable) A fin de que R2 sea significativo, la matriz X de

datos sobre regresores debe contener un vector columna de unos para

representar la constante cuyo coeficiente es el intercepto de regresin. En

ese caso, R2 siempre ser un nmero entre 0 y 1, con valores cercanos a 1

que indica un buen grado de ajuste.

Modelo de regresin simple

Si la matriz de datos X contiene slo dos variables: una constante, y un

regresor escalar x i, entonces esto se llama el "modelo de regresin

simple". [9] Este caso se considera a menudo en las clases de estadsticas

para principiantes, ya que ofrece mucho ms simple frmulas incluso

adecuados para el clculo manual. Los vectores de parmetros de tal

modelo es de 2 dimensiones, y se denota comnmente como (, ):

Las estimaciones de mnimos cuadrados en este caso vienen dadas por

frmulas simples

SOLUCION DEL PROBLEMA DE LOS MINIMOS CUADRADOS

La aproximacin mnimo cuadrtica consiste en minimizar el error cuadrtico

mencionado ms arriba, y tiene solucin general cuando se trata de un problema

de aproximacin lineal (lineal en sus coeficientes ) cualesquiera que sean las

funciones base: antes mencionadas. Por lineal se entiende que la

aproximacin buscada se expresa como una combinacin lineal de dichas

funciones base. Para hallar esta expresin se puede seguir un camino analtico,

expuesto abajo, mediante el clculo multivariable, consistente en optimizar los

coeficientes ; o bien, alternativamente, seguir un camino geomtrico con el uso

de el lgebra lineal, como se explica ms abajo, en la llamada deduccin

geomtrica. Para los Modelos estticos uniecuacionales, el mtodo de mnimos

cuadrados no ha sido superado, a pesar de diversos intentos para ello, desde

principios del Siglo XIX. Se puede demostrar que, en su gnero, es el que

proporciona la mejor aproximacin.

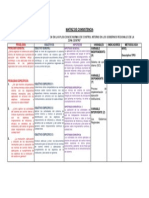

METODO DE LOS MINIMOS CUADRADOS

Estos mtodos s e basan en los mtodos equidistantes en el tiempo a travs de la

metodologa que se presenta a continuacin:

i x Y logY

X

2

XY XlogY

1

2

3

.

.

n

n+1

X

1

X

2

X

3

.

.

X

n

X

n+1

Y

1

Y

2

Y

3

.

.

Y

n

Y

n+1

LogY

1

LogY

2

LogY

3

.

.

LogY

n

(x

1

)

2

(x

2

)

2

(x

3

)

2

.

.

(x

N

)

2

X

1

Y

1

X

2

Y

2

X

1

Y

1

.

.

X

n

Y

n

X

1

LogY

1

X

2

LogY

1

X

3

LogY

1

.

.

X

n

LogY

n

suma X Y logY X

2

XY

XlogY

Prom. X/n Y/N ogY/n X

2

/n XY/N X logY/n

Dnde:

Y

i

=( X

i+1

-X

I

)/X

I

Y

I

=razon de crecimiento X

i

=poblacin

CRECIMIENTO ARITMETICO

Los valores de X

I

E Y

i

;varan linealmente:

El clculo de ay b realiza mediante el siguiente sistema de ecuaciones

(

) (

)

(

) (

) (

)

Y

I

=a+bX

I

Alternativamente en lugar de usar la ecuacin (2) ,se puede usar la siguiente

ecuacin:

(

) (

)

CRECIMIENTO GEOMETRICO

Los valores de X

i

e Y

i

;varan exponencialmente segn:

LogY

I

=loga+(bloga)X

I

Y=A+BX

LA DETERMINACION DE LAS CONSTANTES AY B SE HACE MEDIANTE EL

SIGUIENTE SISTEMA DE ECUACIONES:

(

) (

) (1)

(

) (

) (2)

(

) (

) (

) (3)

Ayb se determinan mediante: a=10^

b=B/loge

Y

I

=ae

bX

I

ANEXOS

También podría gustarte

- Acuerdo de Transporte Aéreo Entre El Gobierno de La Republica Del Peru y El Gobierno de Los Estados Unidos de AméricaDocumento54 páginasAcuerdo de Transporte Aéreo Entre El Gobierno de La Republica Del Peru y El Gobierno de Los Estados Unidos de AméricaDianaAún no hay calificaciones

- Posicionamiento y Ventaja CompetitivaDocumento83 páginasPosicionamiento y Ventaja CompetitivaRicardo BernalAún no hay calificaciones

- Ae - Contabilidad GubernamentalDocumento46 páginasAe - Contabilidad GubernamentalLuis Quintana100% (2)

- Metodologia de La AmaDocumento29 páginasMetodologia de La AmaLuis QuintanaAún no hay calificaciones

- 14 El Delito de Peculado Como Delito de Infraccion de DeberDocumento140 páginas14 El Delito de Peculado Como Delito de Infraccion de DeberJesus EscobarAún no hay calificaciones

- Estructura de FinanciamientoDocumento25 páginasEstructura de FinanciamientoLuis QuintanaAún no hay calificaciones

- Auditoria ForenseDocumento6 páginasAuditoria ForenseLuis QuintanaAún no hay calificaciones

- Archivo Papeles de Trabajo Examen EspecialDocumento10 páginasArchivo Papeles de Trabajo Examen EspecialLuis QuintanaAún no hay calificaciones

- P803Documento100 páginasP803Roger Alexander Chiroque RamirezAún no hay calificaciones

- Metodologia de La AmaDocumento29 páginasMetodologia de La AmaLuis QuintanaAún no hay calificaciones

- Analisis Roa Roe RoiDocumento3 páginasAnalisis Roa Roe RoiLuis Enrique Romani100% (4)

- Matriz de ConsistenciaDocumento1 páginaMatriz de ConsistenciaLuis QuintanaAún no hay calificaciones

- RESOLUCIÓN IN&3 No. 0-08Documento3 páginasRESOLUCIÓN IN&3 No. 0-08Diego Fabricio NarváezAún no hay calificaciones

- Interpretación Del Derecho Del TrabajoDocumento1 páginaInterpretación Del Derecho Del TrabajoKelvin JoseAún no hay calificaciones

- ANGULARDocumento38 páginasANGULARHerz MiñaAún no hay calificaciones

- Trabajo Autonomo #8Documento6 páginasTrabajo Autonomo #8Mikaela JaramilloAún no hay calificaciones

- Proceso de Cianuración Por Percolacion de Minerales AuríferosDocumento69 páginasProceso de Cianuración Por Percolacion de Minerales AuríferosJoseFidel MatosAún no hay calificaciones

- Absolución de Demanda1Documento6 páginasAbsolución de Demanda1PROCURADURIA PUBLICA MUNICIPAL EL COLLAOAún no hay calificaciones

- 7 Plan Analítico-1Documento6 páginas7 Plan Analítico-1KatyAún no hay calificaciones

- Examen de Ingreso Modulo IDocumento6 páginasExamen de Ingreso Modulo IEndrex Cesinarro ChirinosAún no hay calificaciones

- Acta Del Pleno Ordinario Del 27 de Septiembre de 2022Documento21 páginasActa Del Pleno Ordinario Del 27 de Septiembre de 2022Mario CuellarAún no hay calificaciones

- Taller MecanismosDocumento23 páginasTaller MecanismosGiovanny GómezAún no hay calificaciones

- 2007 04T 24Documento127 páginas2007 04T 24LINA MARCELA GONZALEZ TOROAún no hay calificaciones

- Cidio - Manual Examen de Clasificación 2023Documento11 páginasCidio - Manual Examen de Clasificación 2023Keyla Calle montalvanAún no hay calificaciones

- Grupo 3 Metodo de Los Tres PuntosDocumento13 páginasGrupo 3 Metodo de Los Tres PuntosRaymond GSAún no hay calificaciones

- 632547c6b4217Documento8 páginas632547c6b4217jose manuel quinde garciaAún no hay calificaciones

- Tecnicas de Analisis y Caracterizacion de MaterialesDocumento15 páginasTecnicas de Analisis y Caracterizacion de MaterialesGerencia de Operaciones - ServolabAún no hay calificaciones

- Jimmy Avila Semana 2 Programacion SeguraDocumento5 páginasJimmy Avila Semana 2 Programacion SeguraJocelyn Paola Garrido VargasAún no hay calificaciones

- Gulf Eskimo 68 FTDocumento3 páginasGulf Eskimo 68 FTEdgar Leonel CortésAún no hay calificaciones

- Tabla Comparativa Tipos de Contratos de Trabajo LaboralesDocumento34 páginasTabla Comparativa Tipos de Contratos de Trabajo LaboralesElena RaesfeldAún no hay calificaciones

- Engels Friedrich. Las Guerras Campesinas en Alemania.Documento134 páginasEngels Friedrich. Las Guerras Campesinas en Alemania.Katrina Sempiterno100% (1)

- Curriculum Vitae: "Armando Villanueva Del Campo #2022"Documento4 páginasCurriculum Vitae: "Armando Villanueva Del Campo #2022"Erick Rodriguez PlasenciaAún no hay calificaciones

- Reducir, Reutilizar Y Reciclar Desechos Sólidos en La Comunidad de La Aldea El Amatillo, Sanarate El Progreso, para La Mejora Del AmbienteDocumento89 páginasReducir, Reutilizar Y Reciclar Desechos Sólidos en La Comunidad de La Aldea El Amatillo, Sanarate El Progreso, para La Mejora Del AmbienteMarck Antonhy MenaAún no hay calificaciones

- Sara Cultur - El Mercado Del AmorDocumento68 páginasSara Cultur - El Mercado Del AmorYesenia Martínez MaldonadoAún no hay calificaciones

- Precios Constantes, Corrientes e INPCDocumento1 páginaPrecios Constantes, Corrientes e INPCAndre CatalaAún no hay calificaciones

- ChirinoDocumento106 páginasChirinoroger perezAún no hay calificaciones

- Costos de Equipos SubterráneosDocumento14 páginasCostos de Equipos SubterráneosEduardo Vera Sanhueza100% (1)

- Balotario CIPDocumento2 páginasBalotario CIPElizabethAún no hay calificaciones

- Importancia Del EnprendimientoDocumento3 páginasImportancia Del EnprendimientoRodrigo ChapoñanAún no hay calificaciones

- Anexo1 PR2 MPM4 Cobro de Bienestarina V2 PDFDocumento2 páginasAnexo1 PR2 MPM4 Cobro de Bienestarina V2 PDFdsdsdsds eweweweweAún no hay calificaciones