Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Confiabilidad de Sistemas Criticos

Confiabilidad de Sistemas Criticos

Cargado por

berebaggins40170 calificaciones0% encontró este documento útil (0 votos)

1K vistas12 páginasTítulo original

confiabilidad de sistemas criticos

Derechos de autor

© Attribution Non-Commercial (BY-NC)

Formatos disponibles

PPTX, PDF, TXT o lea en línea desde Scribd

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Attribution Non-Commercial (BY-NC)

Formatos disponibles

Descargue como PPTX, PDF, TXT o lea en línea desde Scribd

0 calificaciones0% encontró este documento útil (0 votos)

1K vistas12 páginasConfiabilidad de Sistemas Criticos

Confiabilidad de Sistemas Criticos

Cargado por

berebaggins4017Copyright:

Attribution Non-Commercial (BY-NC)

Formatos disponibles

Descargue como PPTX, PDF, TXT o lea en línea desde Scribd

Está en la página 1de 12

CONFIABILIDAD DE

SISTEMAS CRÍTICOS

Exposición y redacción de temas de

ingeniería.

Grupo 1.

De la luz Morales Berenice.

I. INTRODUCCIÓN

Cuántas veces no ha sucedido que algún sistema no

hace lo que nosotros deseamos, lo cual causa enojo

más no hay un daño grave, hay sistemas que sí fallan

causan enormes pérdidas humanas o económicas.

La confianza de un usuario de un sistema crítico se

mide principalmente por la confiabilidad que éste

tenga en dicho sistema, basado principalmente en la

disponibilidad, fiabilidad, seguridad y protección que

el sistema le proporcione al usuario.

II. SISTEMAS CRÍTICOS

A. Definición de sistemas críticos.

• Sistemas críticos. Son aquellos que tienen impacto

directo en los procesos y/o productos.

• Son sistemas técnicos o socio-técnicos de los cuales

dependen las personas o los negocios, si estos

sistemas no ofrecen sus servicios de la forma

esperada pueden provocar graves problemas y

pérdidas importantes.

B. Tipos principales de sistemas críticos.

• Sistemas de seguridad críticos: sistemas cuyo fallo

puede provocar perjuicio, pérdida de vidas o daños

graves al medio ambiente,

• sistemas de misión críticos: sistemas cuyo fallo de

funcionamiento puede provocar errores en algunas

actividades dirigidas por objetivos,

• sistemas de negocio críticos: sistemas cuyo fallo de

funcionamiento pueden provocar costes muy

elevados para el negocio que utiliza un sistema de

éste tipo.

III. CONFIABILIDAD

La confiabilidad de un sistema informático es una

propiedad del sistema que es igual a su fidelidad.

Confiabilidad = Fidelidad

La fidelidad significa el grado de confianza del

usuario en que el sistema operará tal y como se

espera de él y que no “fallará” al utilizarlo

normalmente.

Existen cuatro dimensiones principales de la

confiabilidad que están interrelacionadas:

Por lo general, niveles altos de confiabilidad

solamente pueden alcanzarse a costa del rendimiento

del sistema.

El incremento de la confiabilidad de un sistema

puede hacer crecer significativamente los costes de

desarrollo.

Esto es relativo ya que es mejor prevenir fallos.

1.- Disponibilidad: es la probabilidad de que el

sistema esté activo y en funcionamiento y sea capaz

de proporcionar servicios útiles en cualquier

momento.

2.- Fiabilidad: la fiabilidad de un sistema es la

probabilidad de que, durante un determinado período

de tiempo, el sistema funcione correctamente tal y

como espera el usuario.

Incluye:

• Corrección: asegurar que los servicios que

proporciona el sistema son los especificados,

• precisión: asegurar que la información se proporciona

al usuario con el nivel de detalle adecuado,

• oportunidad: asegurar que la información que

proporciona el sistema se hace cuando es requerida.

3.- Seguridad: es una valoración de la probabilidad de

que el sistema cause daño a las personas o a su

entorno.

4.- Protección: es una valoración de la probabilidad de

que el sistema pueda resistir intrusiones accidentales

o premeditadas.

Incluye:

• Integridad: asegurar que el programa y los datos del

sistema no resulten dañados,

• confidencialidad: asegurar que sólo las personas

autorizadas puedan acceder a la información.

IV. CONCLUSIÓN.

Para mejorar la confiabilidad, es necesario adoptar una

aproximación a las interacciones entre las tecnologías y las personas

para el diseño del sistema, teniendo en cuenta que las personas

forman parte del sistema así como el hardware y el software.

Es importante desarrollar sistemas con un grado razonable de

confiabilidad pues los usuarios prefieren sistemas fiables,

disponibles y seguros; además una falla en el sistema puede ser

mucho más costosa que el hacer confiable al sistema.

No todas las propiedades de la confiabilidad son aplicables a todos

los sistemas

Es importante decidir qué tan confiable debemos hacer nuestro

sistema, según las necesidades y requerimientos establecidos.

También podría gustarte

- Estrategias Problemas de Aprendizaje Percepcion VisualDocumento4 páginasEstrategias Problemas de Aprendizaje Percepcion VisualNataly Gonzalez QuinteroAún no hay calificaciones

- SG-SST-F-01 Formato Acta Nombramiento Vigia v.0Documento2 páginasSG-SST-F-01 Formato Acta Nombramiento Vigia v.0KATHERIN ALVAREZ100% (1)

- Teoria Del AutomovilDocumento52 páginasTeoria Del AutomovilIvan LeonAún no hay calificaciones

- Dictamen Pericial Documento para DiapositivasDocumento2 páginasDictamen Pericial Documento para DiapositivasMauricio Ordoñez AriasAún no hay calificaciones

- ¿Cuál Es La Diferencia Entre Una Infracción de Tránsito y Una Infracción de Transporte - Secretaria Distrital de MovilidadDocumento2 páginas¿Cuál Es La Diferencia Entre Una Infracción de Tránsito y Una Infracción de Transporte - Secretaria Distrital de MovilidadLuis Albeiro PereiraAún no hay calificaciones

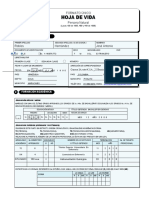

- Hoja de Vida Formato ÚnicoDocumento3 páginasHoja de Vida Formato ÚnicoCristian ArroyaveAún no hay calificaciones

- Taller y Analisis de Caso Compras y SuministrosDocumento4 páginasTaller y Analisis de Caso Compras y SuministrosIngrid RodriguezAún no hay calificaciones

- Villegas Bolívar Jesús Rafael (CURRICULO)Documento3 páginasVillegas Bolívar Jesús Rafael (CURRICULO)Jesus VillegasAún no hay calificaciones

- GUÍA 5 TGPA Yolanda Bustamante 12 de Abril PDFDocumento23 páginasGUÍA 5 TGPA Yolanda Bustamante 12 de Abril PDFCarmen ElisaAún no hay calificaciones

- Varela, Julia (Revista Edu) Aproximaciones Genealogicas A La Moderna Percepcion Social de Los Niños.Documento2 páginasVarela, Julia (Revista Edu) Aproximaciones Genealogicas A La Moderna Percepcion Social de Los Niños.ESTELA MAGAÑAAún no hay calificaciones

- Presentacion TcoDocumento16 páginasPresentacion TcoLivorno ContruccionesAún no hay calificaciones

- Mapa ConceptualDocumento2 páginasMapa ConceptualedwinAún no hay calificaciones

- Malca GJDocumento157 páginasMalca GJToroGym PerfilAún no hay calificaciones

- Preguntas 378 JacobsDocumento4 páginasPreguntas 378 JacobsMariluz Franco GomezAún no hay calificaciones

- F3 Declaración Jurada para La Continuación de EstudiosDocumento1 páginaF3 Declaración Jurada para La Continuación de EstudiosCarlos MezaAún no hay calificaciones

- Asesoria Participante Ciagf2Documento40 páginasAsesoria Participante Ciagf2Luminus Ratio AscelurAún no hay calificaciones

- El Bien PersonalDocumento8 páginasEl Bien PersonalMaría camila Tatis humanezAún no hay calificaciones

- Definición Dedibujo Eléctrico PDFDocumento4 páginasDefinición Dedibujo Eléctrico PDFEndhir GarciaAún no hay calificaciones

- ESCALERA NIVEL I y II - Primaria - 1a5 - Secundaria - 6a9Documento3 páginasESCALERA NIVEL I y II - Primaria - 1a5 - Secundaria - 6a9jency mosqueraAún no hay calificaciones

- Primera Fase de Construcción de PruebasDocumento11 páginasPrimera Fase de Construcción de PruebasRob Palomino UrbanoAún no hay calificaciones

- Cta5 U1-Sesion4Documento2 páginasCta5 U1-Sesion4Ramiro Quintana HerreraAún no hay calificaciones

- Caso de Estudio Capítulo #12 Grupo #4Documento3 páginasCaso de Estudio Capítulo #12 Grupo #4Victor BuesoAún no hay calificaciones

- Acabamos de Observar La Última Campaña de San FernandoDocumento3 páginasAcabamos de Observar La Última Campaña de San FernandoJunior Chafloque PuiconAún no hay calificaciones

- Conducción de Vehículos Motorizados en Estado de EbriedadDocumento9 páginasConducción de Vehículos Motorizados en Estado de EbriedadHemer Saul Blas QuispeAún no hay calificaciones

- Informe Casas Abandonadas y Sitios EriazosDocumento4 páginasInforme Casas Abandonadas y Sitios EriazosCarla Hormaechea MenaAún no hay calificaciones

- Marketing PolíticoDocumento8 páginasMarketing PolíticoMaximo VasquezAún no hay calificaciones

- Reglamento Edificación - RosarioDocumento19 páginasReglamento Edificación - RosarioricardomainAún no hay calificaciones

- Inventario de Intereses de ThurstoneDocumento5 páginasInventario de Intereses de ThurstoneHugo Alfredo JiménezAún no hay calificaciones

- Cuadro Evaluaciones Internas YExternasDocumento3 páginasCuadro Evaluaciones Internas YExternasTigredel78Aún no hay calificaciones

- Diogenes Atencio - Analisis Del VideoDocumento7 páginasDiogenes Atencio - Analisis Del VideoCecilio PerezAún no hay calificaciones