0% encontró este documento útil (0 votos)

41 vistas17 páginasA6 - Bautista - Marvin de Jesus

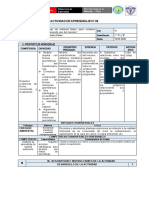

El documento aborda la teoría de distribuciones de probabilidad continuas, enfocándose en la distribución uniforme, exponencial, gamma y normal, y su aplicación en diversas disciplinas. Se explica cómo las variables aleatorias continuas requieren una función de densidad de probabilidad para modelar fenómenos con infinitos valores posibles, y se presentan ejemplos y problemas prácticos relacionados con estas distribuciones. Además, se discuten las propiedades y características clave de las distribuciones continuas en comparación con las discretas.

Cargado por

Secundaria Tecnica TexistepecDerechos de autor

© © All Rights Reserved

Nos tomamos en serio los derechos de los contenidos. Si sospechas que se trata de tu contenido, reclámalo aquí.

Formatos disponibles

Descarga como PDF, TXT o lee en línea desde Scribd

0% encontró este documento útil (0 votos)

41 vistas17 páginasA6 - Bautista - Marvin de Jesus

El documento aborda la teoría de distribuciones de probabilidad continuas, enfocándose en la distribución uniforme, exponencial, gamma y normal, y su aplicación en diversas disciplinas. Se explica cómo las variables aleatorias continuas requieren una función de densidad de probabilidad para modelar fenómenos con infinitos valores posibles, y se presentan ejemplos y problemas prácticos relacionados con estas distribuciones. Además, se discuten las propiedades y características clave de las distribuciones continuas en comparación con las discretas.

Cargado por

Secundaria Tecnica TexistepecDerechos de autor

© © All Rights Reserved

Nos tomamos en serio los derechos de los contenidos. Si sospechas que se trata de tu contenido, reclámalo aquí.

Formatos disponibles

Descarga como PDF, TXT o lee en línea desde Scribd