Documentos de Académico

Documentos de Profesional

Documentos de Cultura

IS.S3.C2.D1-Componentes BI (I) V0.2 PDF

IS.S3.C2.D1-Componentes BI (I) V0.2 PDF

Cargado por

Lester Perez OrtegaTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

IS.S3.C2.D1-Componentes BI (I) V0.2 PDF

IS.S3.C2.D1-Componentes BI (I) V0.2 PDF

Cargado por

Lester Perez OrtegaCopyright:

Formatos disponibles

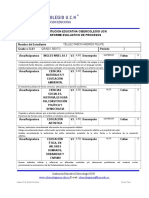

V02

SAPBI Máster en Consultoría Business

Intelligence SAP

IS - Introducción a SAP y Business Intelligence

Sesión 3- Introducción a Business Intelligence

Clase 2- Componentes de BI (I)

(8 Videos)

IS.S3.C2.D1

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 1

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 2

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 3

Business Intelligence SAP Business Intelligence

Vídeo 1. – Esquema de BI

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 4

Business Intelligence SAP Business Intelligence

FINAL VIDEO 1

Esquema de BI

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 5

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 6

Business Intelligence SAP Business Intelligence

Vídeo 2. – Fuentes de datos

Fuentes de datos

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 7

Business Intelligence SAP Business Intelligence

Vídeo 2. – Fuentes de datos

Se considera fuente de datos cualquier sistema o fichero el

cual utilicemos para extraer datos. Las fuentes de datos a las

que podemos acceder pueden ser internas o externas:

• Fuentes internas:

§ Sistemas operacionales o transaccionales,

que incluyen aplicaciones desarrolladas a

medida, ERP, CRM, SCM, etc.

§ Sistemas de información departamentales:

previsiones, presupuestos, hojas de cálculo,

etcétera.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 8

Business Intelligence SAP Business Intelligence

Vídeo 2. – Fuentes de datos

• Fuentes externa, en algunos casos comprada a terceros,

como por ejemplo estudios de mercado (Nielsen en

distribución de gran consumo, IMS de la industria

farmacéutica). Las fuentes de información externas son

fundamentales para enriquecer la información que tenemos

de nuestros clientes. En algunos casos es interesante

incorporar información referente, por ejemplo, a población,

número de habitantes, etc. Podemos acceder a información

de este tipo en la web del Instituto Nacional de Estadística

(www.ine.es). En esta categoría también es importante

destacar el uso cada vez más habitual de la información

presente en internet: redes sociales, blogs, etc.

Toda la información recogida a través de las fuentes de datos, es información propia de cada sistema,

por lo que es necesario procesarla para transformarla en un formato homogéneo que permita la

trazabilidad con los datos de otros sistemas ya sean internos o externos. Para ello se utilizan los

procesos ETL.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 9

Business Intelligence SAP Business Intelligence

FINAL VIDEO 2

Fuentes de datos

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 10

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 11

Business Intelligence SAP Business Intelligence

Vídeo 3. – Procesos ETL

Procesos ETL

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 12

Business Intelligence SAP Business Intelligence

Vídeo 3. – Procesos ETL

Procesos ETL

Un proceso ETL (Extract, Transform and Load), tal y

como sus siglas indican, es el paso encargado de

extraer todos los datos necesarios de cada una de las

fuentes de datos, para tratarlos y conseguir datos

homogéneos de calidad, para finalmente cargarlos en

un sistema de almacenamiento de datos.

EXTRACT TRANSFORM LOAD

Esta parte del sistema de BI es costosa y consume una parte significativa de todo el proceso, ya que

condiciona el éxito posterior de las herramientas de BI, por ello requiere recursos, estrategia,

habilidades especializadas y tecnologías. Es la parte del sistema de BI más crítica ya que si no

se diseña correctamente, el resto de partes trabajaran sobre información errónea o con datos

de baja calidad que provocará sobresfuerzos innecesarios.

El proceso de ETL consume entre el 60% y el 80% del tiempo de un proyecto de Business

Intelligence, por lo que es un proceso clave en la vida de todo proyecto.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 13

Business Intelligence SAP Business Intelligence

Vídeo 3. – Procesos ETL

Procesos ETL

El proceso ETL se divide en 4 subprocesos:

EXTRACT CLEAN TRANSFORM LOAD

1. Extracción: Subproceso encargado de recupere los datos físicamente de las distintas fuentes

de datos. Al final de este subproceso disponemos de los datos en bruto.

2. Limpieza: Se recuperan los datos en bruto y comprueba su calidad, elimina los duplicados y,

cuando es posible, corrige los valores erróneos y completa los valores vacíos, es decir se

transforman los datos para reducir los errores de carga. En este momento disponemos de datos

limpios y de calidad*.

3. Transformación: Recupera los datos limpios y de calidad, y los estructura y consolida en los

distintos modelos de análisis. El resultado de este proceso es la obtención de datos limpios,

consistentes, consolidados y útiles.

4. Carga: Este subproceso valida que los datos que cargamos en el datawarehouse sean

consistentes con las definiciones y formatos del datawarehouse; los integra en los distintos

modelos de las distintas áreas de negocio que hemos definido en el mismo.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 14

Business Intelligence SAP Business Intelligence

FINAL VIDEO 3

Procesos ETL

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 15

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 16

Business Intelligence SAP Business Intelligence

Vídeo 4. – Procesos ETL - Extracción

El principal objetivo de la extracción es extraer tan sólo aquellos datos de los sistemas

transaccionales que son necesarios y prepararlos para el resto de los subprocesos de ETL.

Para ello se deben determinar las mejores fuentes de información, las de mejor calidad. Con tal

finalidad, deberemos analizar las fuentes disponibles y escoger aquellas que sean mejores.

La primera parte del proceso ETL consiste en localizar y extraer los datos, ya que en la mayoría de

proyectos de BI se fusionan datos provenientes de diferentes fuentes de datos. Los formatos de las

fuentes están condicionados al modelado de datos del sistema de información al que pertenecen. La

extracción convierte los datos a un formato homogéneo y consolidado para iniciar el proceso

de transformación.

Una parte intrínseca del proceso de extracción es la de analizar los datos extraídos, de lo que

resulta un chequeo que verifica si los datos cumplen la pauta o estructura que se esperaba. De no

ser así los datos son rechazados. De ahí que sea clave disponer de datos de calidad ya en el origen,

la fuente de datos.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 17

Business Intelligence SAP Business Intelligence

Vídeo 4. – Procesos ETL - Extracción

La extracción de los datos se puede realizar bien de forma manual o bien utilizando herramientas de

ETL:

• Manual: significa programar rutinas utilizando lenguajes de programación que extraigan los

datos de las fuentes de datos origen, aunque en otros casos se opta por las utilidades de replicar

la base de datos que tienen los motores de bases de datos.

• Automatizada: La alternativa más rentable es la que proveen las herramientas

especializadas de ETL, ya que han sido diseñadas para llevar a cabo esta función y nos

permiten visualizar el proceso y detectar los errores durante el proceso o durante la carga.

Los principales problemas que nos podemos encontrar al acceder a los datos para extraerlos:

provienen de distintas fuentes, BBDD, plataformas tecnológicas, protocolos de comunicaciones,

juegos de caracteres, y tipos de datos.

Un requerimiento importante que se debe exigir a la tarea de extracción es que ésta cause un

impacto mínimo en el sistema origen. Si los datos a extraer son muchos, el sistema de origen se

podría ralentizar e incluso colapsar, provocando que éste no pueda utilizarse con normalidad para

su uso cotidiano. Por esta razón, en sistemas grandes las operaciones de extracción suelen

programarse en horarios o días donde este impacto sea nulo o mínimo.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 18

Business Intelligence SAP Business Intelligence

FINAL VIDEO 4

Procesos ETL - Extracción

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 19

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

8. Procesos ETL – Ejemplo con datos >IS.S3.C2.V8<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 20

Business Intelligence SAP Business Intelligence

Vídeo 5. – Procesos ETL - Limpieza

Los sistemas transaccionales contienen datos que no han sido depurados y que deben ser

limpiados.

Las herramientas ETL tienen funcionalidades de limpieza de datos, aunque existen herramientas

especializadas para ello.

Pero ¿cuáles son las causas que provocan que los datos estén “sucios”?, veamos algunos

ejemplos:

ü Valores por defecto.

ü Ausencia de valor. Campos con valores vacíos.

ü Campos que tienen distintas utilidades: Para algunos clientes ponemos una

información y para otros, otra distinta. No homogeneización de los campos de la base

de datos.

ü Valores contradictorios.

ü Uso inapropiado de los campos, por ejemplo en las direcciones de los clientes.

ü Vulneración de las reglas de negocio.

ü Duplicación de claves primarias con valores que se habían utilizado en el pasado.

ü Etc.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 21

Business Intelligence SAP Business Intelligence

Vídeo 5. – Procesos ETL - Limpieza

La limpieza de datos se divide en las siguientes etapas:

§ Depuración: Este proceso localiza e identifica los elementos individuales de información en las

fuentes de datos y los aísla. Por ejemplo: separar el nombre completo en nombre, primer

apellido, segundo apellido, o la dirección en: calle, numero, piso, etc.

§ Corrección: Este proceso corrige los valores individuales de los atributos usando algoritmos de

corrección y fuentes de datos externas. Por ejemplo: comprueba una dirección y el código postal

correspondiente.

§ Estandarización: Este proceso aplica rutinas de conversión para transformar valores en

formatos definidos (y consistentes) aplicando procedimientos de estandarización y definidos por

las reglas del negocio. Por ejemplo: trato de Sr., Sra., etc. o sustituyendo los diminutivos de

nombres por los nombres correspondientes.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 22

Business Intelligence SAP Business Intelligence

Vídeo 5. – Procesos ETL - Limpieza

§ Relación: Este proceso busca y relaciona los valores de los registros, corrigiéndolos y

estandarizándolos, basándose en reglas de negocio para eliminar duplicados. Por ejemplo:

identificando nombres y direcciones similares.

§ Consolidación: Este proceso analiza e identifica relaciones entre registros relacionados y los

junta en una sola representación.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 23

Business Intelligence SAP Business Intelligence

Vídeo 5. – Procesos ETL - Limpieza

Datos de calidad

¿Qué se considera un dato de calidad?

La calidad de datos debe cumplir con los siguientes requisitos:

ü Unicidad: Relacionado con datos duplicados.

ü Uniformidad: Relacionado con irregularidades.

ü Exactitud: Los datos deben cumplir los requisitos de integridad, consistencia y densidad.

ü Consistencia: Alcanzado por la corrección de contradicciones y anomalías sintácticas.

ü Densidad: Conocer el cociente de valores omitidos sobre el número de valores totales.

ü Integridad: Los datos deben cumplir los requisitos de entereza y validez.

ü Entereza: Alcanzado por la corrección de datos que contienen anomalías.

ü Validez: Alcanzado por la cantidad de datos que satisfacen las restricciones.

Los procesos ETL son los encargados de garantizar el cumplimiento de las características

que deben cumplir los datos para ser considerados de calidad.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 24

Business Intelligence SAP Business Intelligence

FINAL VIDEO 5

Procesos ETL - Limpieza

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 25

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 26

Business Intelligence SAP Business Intelligence

Vídeo 6. – Procesos ETL - Transformación

La fase de transformación de un proceso de ETL aplica una serie de reglas de negocio o

funciones sobre los datos extraídos para convertirlos en datos que serán aptos para ser

cargados en un almacén de datos determinado. Algunas fuentes de datos requerirán alguna

pequeña manipulación de los datos previa a la aplicación de las reglas de negocio:

§ Seleccionar sólo ciertas columnas para su carga (por ejemplo, que las columnas con valores

nulos no se carguen).

§ Traducir códigos (por ejemplo, si la fuente almacena una “H” para Hombre y “M” para Mujer pero

el destino tiene que guardar “1″ para Hombre y “2″ para Mujer).

§ Codificar valores libres (por ejemplo, convertir “Hombre” en “H” o “Sr” en “1″).

§ Obtener nuevos valores calculados (por ejemplo, total_venta = cantidad * precio).

§ Unir datos de múltiples fuentes (por ejemplo, búsquedas, combinaciones, etc.).

§ Calcular totales de múltiples filas de datos (por ejemplo, ventas totales de cada región).

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 27

Business Intelligence SAP Business Intelligence

Vídeo 6. – Procesos ETL - Transformación

§ Generación de campos clave en el destino.

§ Transponer o pivotar (girando múltiples columnas en filas o viceversa).

§ Dividir una columna en varias (por ejemplo, columna “Nombre: García, Miguel”; pasar a dos

columnas “Nombre: Miguel” y “Apellido: García”).

§ La aplicación de cualquier forma, simple o compleja, de validación de datos, y la consiguiente

aplicación de la acción que en cada caso se requiera:

§ Datos OK: Entregar datos a la siguiente etapa (Carga).

§ Datos erróneos: Ejecutar políticas de tratamiento de excepciones (por ejemplo, rechazar el

registro completo, dar al campo erróneo un valor nulo o un valor centinela).

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 28

Business Intelligence SAP Business Intelligence

FINAL VIDEO 6

Procesos ETL - Transformación

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 29

Business Intelligence SAP Business Intelligence

CONTENIDO Sesión 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extracción >IS.S3.C2.V4<

5. Procesos ETL – Limpieza >IS.S3.C2.V5<

6. Procesos ETL – Transformación >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 30

Business Intelligence SAP Business Intelligence

Vídeo 7. – Procesos ETL - Carga

La carga es el momento en el que integramos los datos extraídos con los residentes en el

datawarehouse, y debemos comprobar si, por ejemplo, los totales de ventas que hemos cargado

coinciden con la información que residía en nuestro sistema transaccional, así́ como si los valores

que tienen los registros cargados corresponden a los definidos en el datawarehouse. Es

fundamental comprobar que se ha desarrollado correctamente, ya que en caso contrario

pueden llevar a decisiones erróneas a los usuarios.

Dependiendo de los requerimientos de la organización, este proceso puede abarcar una amplia

variedad de acciones diferentes. En casos se sobrescribe la información antigua con nuevos datos,

mientras que en otros la información se complementa.

Existen dos formas básicas de desarrollar el proceso de carga:

§ Acumulación simple: La acumulación simple es la más sencilla y común, y consiste en realizar

un resumen de todas las transacciones comprendidas en el período de tiempo seleccionado y

transportar el resultado como una única transacción hacia el datawarehouse, almacenando un

valor calculado que consistirá típicamente en un sumatorio o un promedio de la magnitud

considerada.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 31

Business Intelligence SAP Business Intelligence

Vídeo 7. – Procesos ETL - Carga

§ Rolling: El proceso de Rolling por su parte, se aplica en los casos en que se opta por mantener

varios niveles de granularidad. Para ello se almacena información resumida a distintos niveles,

correspondientes a distintas agrupaciones de la unidad de tiempo o diferentes niveles

jerárquicos en alguna o varias de las dimensiones de la magnitud almacenada (por ejemplo,

totales diarios, totales semanales, totales mensuales, etc.).

Debido a la criticidad del proceso, las herramientas ETL son claves en los proyectos de BI. Es

indispensable que las herramientas de BI trabajen con datos de calidad. En caso contrario,

puede llevar a una toma de decisiones errónea.

Por este motivo, al realizar la carga se deben definir y aplicar todas las restricciones y triggers

(disparadores) que aseguren la integridad y consistencia de la información. Por ejemplo, valores

únicos, integridad referencial, campos obligatorios, rangos de valores. Estas restricciones y

triggers contribuyen a que se garantice la calidad de los datos en el proceso ETL.

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 32

Business Intelligence SAP Business Intelligence

FINAL VIDEO 7

Procesos ETL - Carga

IS - Introducción a SAP y Business Intelligence

Sesión 03 – Introducción a Business Intelligence

Clase 2 – Componentes de BI (I)

SAPBI Máster en Consultoría IS - Introducción a SAP y

Sesión 3 Clase 1 Pág. 33

Business Intelligence SAP Business Intelligence

También podría gustarte

- Constancia de Bachiller SuneduDocumento1 páginaConstancia de Bachiller SuneduTonyPs100% (2)

- Ejercicio 12 - Manejo de IF-ELSE PDFDocumento11 páginasEjercicio 12 - Manejo de IF-ELSE PDFTonyPsAún no hay calificaciones

- Actividad 4. KholbergDocumento15 páginasActividad 4. KholbergjmmonrealAún no hay calificaciones

- Niveles de Riesgo en Carguío y Acarreo en Mina A Tajo AbiertoDocumento8 páginasNiveles de Riesgo en Carguío y Acarreo en Mina A Tajo AbiertoSandro Velasquez JuarezAún no hay calificaciones

- INTELIGENCIA DE NEGOCIOS EN BIG DATA1 - ReduceDocumento1 páginaINTELIGENCIA DE NEGOCIOS EN BIG DATA1 - ReduceTonyPsAún no hay calificaciones

- Temario AngularDocumento1 páginaTemario AngularTonyPsAún no hay calificaciones

- Dictamen #000252-2021-Upg-Vdip-Fisi-UnmsmDocumento1 páginaDictamen #000252-2021-Upg-Vdip-Fisi-UnmsmTonyPsAún no hay calificaciones

- Administrador de Servidores de Base de DatosDocumento1 páginaAdministrador de Servidores de Base de DatosTonyPsAún no hay calificaciones

- SQL Server CertificadoDocumento1 páginaSQL Server CertificadoTonyPsAún no hay calificaciones

- Auditoria Ambiental 2019 PDFDocumento94 páginasAuditoria Ambiental 2019 PDFTonyPsAún no hay calificaciones

- Document PDFDocumento55 páginasDocument PDFTonyPsAún no hay calificaciones

- DownloadDocumento28 páginasDownloadTonyPsAún no hay calificaciones

- Diapositiva TicsDocumento21 páginasDiapositiva TicsTonyPsAún no hay calificaciones

- Lista de Documentos Montacargas.Documento1 páginaLista de Documentos Montacargas.TonyPsAún no hay calificaciones

- Plantilla Matriz FODA PDFDocumento1 páginaPlantilla Matriz FODA PDFTonyPs100% (1)

- BUENAZADocumento83 páginasBUENAZATonyPsAún no hay calificaciones

- CONTADocumento109 páginasCONTATonyPsAún no hay calificaciones

- Contrato Alquiler UcayaliDocumento3 páginasContrato Alquiler UcayaliTonyPsAún no hay calificaciones

- Calculo de RendimientosDocumento4 páginasCalculo de Rendimientosvlady condoriAún no hay calificaciones

- ACTIVIDAD TRANSFERENCIA CasoDocumento3 páginasACTIVIDAD TRANSFERENCIA Casobryan espinosaAún no hay calificaciones

- 01 Declaracion de Impacto Ambientl PacchaDocumento40 páginas01 Declaracion de Impacto Ambientl PacchaLudwin Figueroa GranadosAún no hay calificaciones

- Glosario de AjedrezDocumento21 páginasGlosario de AjedrezAndré DeFranciaAún no hay calificaciones

- Correlaciones Aceites NegroDocumento257 páginasCorrelaciones Aceites NegroEyker TorresAún no hay calificaciones

- Flujo de Valor, Takt, CapacidadDocumento3 páginasFlujo de Valor, Takt, CapacidadPaul Larry Kong RomeroAún no hay calificaciones

- Consolidado Trabajo Colaborativo f1 - EstadisticaDocumento21 páginasConsolidado Trabajo Colaborativo f1 - EstadisticaCruda LópezAún no hay calificaciones

- Analisis de NieriDocumento1 páginaAnalisis de NieriLizbeth de la CruzAún no hay calificaciones

- Innovacion Social Conceptos Etapas PDFDocumento15 páginasInnovacion Social Conceptos Etapas PDFdavid llanosAún no hay calificaciones

- Nombre Común: Cebada: CaracteristicasDocumento4 páginasNombre Común: Cebada: CaracteristicasHector Nelyo Colque AoizAún no hay calificaciones

- Régimen TransitorioDocumento25 páginasRégimen TransitorioMiguel83% (6)

- Procedimiento Prestación Del ServicioDocumento4 páginasProcedimiento Prestación Del ServicioPaola PalacioAún no hay calificaciones

- Espanol 1°Documento103 páginasEspanol 1°Maria Victoria Cano MayAún no hay calificaciones

- El Maestro Del Mal - Jim HouganDocumento337 páginasEl Maestro Del Mal - Jim HouganEruaro Guerra Carvajal100% (1)

- Taller NewtonDocumento2 páginasTaller NewtonCarlos Menchaca100% (1)

- Actividad 3 Sistemas OperativosDocumento13 páginasActividad 3 Sistemas OperativosJele ToAún no hay calificaciones

- Agua AguaDocumento18 páginasAgua AguaNicole SuarezAún no hay calificaciones

- Diseño ConceptualDocumento21 páginasDiseño ConceptualBianca RoblesAún no hay calificaciones

- Valuación de Empresas Por Métodos MixtosDocumento8 páginasValuación de Empresas Por Métodos MixtosMery Silva RuizAún no hay calificaciones

- Ficha de Informe Final PRS Distancia PCIS - Sede CundinamarcaDocumento4 páginasFicha de Informe Final PRS Distancia PCIS - Sede Cundinamarcanayibe caceresAún no hay calificaciones

- Electrovalvula ProfibusDocumento188 páginasElectrovalvula ProfibusEdison RamosAún no hay calificaciones

- Hermanos Tellez Pabon Segundo PeriodoDocumento4 páginasHermanos Tellez Pabon Segundo Periodobubulbee primeAún no hay calificaciones

- HT Gallinatox 3 Rev 00 PDFDocumento4 páginasHT Gallinatox 3 Rev 00 PDFCharod DelgadoAún no hay calificaciones

- PrescripcionDocumento4 páginasPrescripcionVICTOR JULIO TAUTIVA ROMEROAún no hay calificaciones

- Confrontando La Mosca de La GUAYABA (Ultima Revisión2) PDFDocumento18 páginasConfrontando La Mosca de La GUAYABA (Ultima Revisión2) PDFYim F. TineoAún no hay calificaciones

- IV° Medio - Filosofía Fecha - / - /2022 I° Trimestre NOMBRE: - Unidad 4 Objetivo/S de AprendizajeDocumento4 páginasIV° Medio - Filosofía Fecha - / - /2022 I° Trimestre NOMBRE: - Unidad 4 Objetivo/S de AprendizajeLilian GallardoAún no hay calificaciones

- Análisis de Elementos de Mecanismos y Fundamentos de Diseño - Segunda Práctica Calificada Tipo BDocumento2 páginasAnálisis de Elementos de Mecanismos y Fundamentos de Diseño - Segunda Práctica Calificada Tipo BAugusto MantillaAún no hay calificaciones

- 2.6. - Definición de Determinante de Una Matriz - Sistemas Algebra LinealDocumento2 páginas2.6. - Definición de Determinante de Una Matriz - Sistemas Algebra LinealReinaldo594Aún no hay calificaciones