Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Resumen Del Articulo UCEVA

Cargado por

Orlando Steven Ordoñez Castro0 calificaciones0% encontró este documento útil (0 votos)

5 vistas2 páginasxD jajaja

Derechos de autor

© © All Rights Reserved

Formatos disponibles

DOCX, PDF, TXT o lea en línea desde Scribd

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoxD jajaja

Copyright:

© All Rights Reserved

Formatos disponibles

Descargue como DOCX, PDF, TXT o lea en línea desde Scribd

0 calificaciones0% encontró este documento útil (0 votos)

5 vistas2 páginasResumen Del Articulo UCEVA

Cargado por

Orlando Steven Ordoñez CastroxD jajaja

Copyright:

© All Rights Reserved

Formatos disponibles

Descargue como DOCX, PDF, TXT o lea en línea desde Scribd

Está en la página 1de 2

Resumen del articulo “The 50th anniversary of

information theory”.

Autor: Orlando Steven Ordoñez Castro

La biografía de Shannon está llena de los frutos de su ingenio, con numerosas

aplicaciones en el campo de las máquinas automáticas, desde un ratón electrónico

hasta un WC automático, pasando por diversos juego electrónicos de ajedrez,

calculadoras, instrumentos musicales, juguetes mecánicos, relojes, etc.

El artículo empieza primeramente mencionando a Claude Shannon, y sus

contribuciones al campo de las ciencias de la computación, resaltando la

publicación de su ensayo titulado “A mathematical theory of communication”, que

en español traduce a “Una teoría matemática de la comunicación”. En este

ensayo, Shannon intentó mostrar que la información puede ser medida

independientemente de su aspecto semántico y que toda fuente de datos podría

ser descrita de forma única con respecto al contenido de la información. Además,

aseguró que una transmisión de datos libre de errores debería ser posible si la

tasa de información es más pequeña que la llamada capacidad del canal.

El nombre de Shannon está relacionado con dos teoremas, los cuales han tenido

un gran impacto en las comunicaciones digitales. El primero hace referencia al

número de bits necesarios para describir de forma única una fuente de información

que puede alcanzar el contenido de la información correspondiente tan

cercanamente como sea deseado. El segundo hace referencia a la tasa de errores

de datos transmitidos sobre un canal ruidoso con banda limitada que puede ser

reducido a una cantidad arbitrariamente pequeña si la tasa de información es más

baja que la capacidad del canal. Las consecuencias que tuvieron las

consideraciones de Shannon aparecieron con el teorema de la codificación para

canales con ruido, el cual fue aceptado inmediatamente, aunque en un principio,

no lo fue, en parte por ejemplo porque introdujo la noción de “capacidad de canal”,

donde el ancho de banda junto con la relación señal ruido determina la calidad del

canal de transmisión, una relación que no había sido vista desde hacía mucho

tiempo.

Una mirada a la historia de los esquemas de corrección de errores hacia adelante

permite ver lo importante que fueron para el desempeño de las

telecomunicaciones por módem. Desde los años 60, la tasa de transferencia de

datos ha incrementado sustancialmente. Esto fue principalmente logrado gracias a

la implementación de esquemas de modulación de ancho de banda eficientes.

Análisis del articulo “The 50th anniversary of

information theory”.

Estudia el flujo de las ondas electromagnéticas a través de un circuito. Distingue

claramente entre mensaje y el medio por el que éste se transmite. Al tiempo,

analiza cómo medir la eficacia de un canal de comunicación a través del concepto

de entropía, tomado de la segunda ley de la termodinámica. La entropía mide las

pérdidas derivadas de los ‘ruidos’ en la transmisión de información de un mensaje,

y, al tiempo, la posibilidad de eliminar las mermas, la incertidumbre, mediante la

redundancia y la codificación numérica en el origen del proceso de comunicación y

su descodificación en la fase de recepción.

En el artículo se explica que los descubrimientos de Shannon han permitido el

desarrollo de distintas tecnologías usadas para la elaboración de códigos de

corrección de errores y los códigos de bloque. Shannon abrió el camino para

muchas investigaciones que llevarían a cabo otros académicos, desarrollando

distintas implementaciones de los teoremas de Shannon. Básicamente, en el

análisis del texto, se dice que antes de las contribuciones de Shannon, términos

como “entropía” o “capacidad de canal” no habían sido desarrollados. El criterio

para desarrollar esquemas de diseño de transmisiones análogas era la relación

señal ruido y el ancho de banda. El primer artículo tomado en cuenta por Shannon

en sus investigaciones fue el ensayo de Nyquist de 1924, donde se prueba que

una señal de banda limitada y continua puede ser descrita de forma única de

forma discreta si la frecuencia que se muestra es al menos el doble del ancho de

banda. El otro artículo es el de Hartley, donde se muestra que la información debe

ser definida como el logaritmo de la probabilidad del correspondiente mensaje.

Shannon se dio cuenta que este argumento es sólo verdadero si los mensajes

tienen igual probabilidad y si están idénticamente distribuidos. Fue Shannon quien

se dio cuenta instantáneamente que el logaritmo dual jugaría un importante rol en

este contexto. Él designó el contenido de la información de una fuente de datos

como “entropía”, y bautizó la unidad de información como “digito binario” ó

simplemente “bit”.

También podría gustarte

- Expo Isabella OrdonezDocumento9 páginasExpo Isabella OrdonezOrlando Steven Ordoñez CastroAún no hay calificaciones

- Taller Técnicas Caja NegraDocumento6 páginasTaller Técnicas Caja NegraOrlando Steven Ordoñez CastroAún no hay calificaciones

- Factura UniversidadDocumento2 páginasFactura UniversidadOrlando Steven Ordoñez CastroAún no hay calificaciones

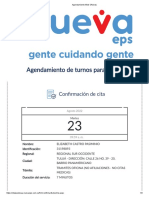

- Cita MamaDocumento3 páginasCita MamaOrlando Steven Ordoñez CastroAún no hay calificaciones

- Comprobante de Pago en LineaDocumento1 páginaComprobante de Pago en LineaOrlando Steven Ordoñez CastroAún no hay calificaciones

- Nueva EPSDocumento1 páginaNueva EPSOrlando Steven Ordoñez CastroAún no hay calificaciones

- Nueva EPSDocumento1 páginaNueva EPSOrlando Steven Ordoñez CastroAún no hay calificaciones

- Dueñas - Eric - Sistema de Ecuaciones LinealesDocumento4 páginasDueñas - Eric - Sistema de Ecuaciones LinealesEric Dueñas TrujilloAún no hay calificaciones

- B4xIDE V1.0 ES enDocumento92 páginasB4xIDE V1.0 ES enAnonymous hhJo7zMfGEAún no hay calificaciones

- Silabo Ofimatica II - 520 VP-2013Documento9 páginasSilabo Ofimatica II - 520 VP-2013Fran JimenezAún no hay calificaciones

- DSPicsDocumento25 páginasDSPicsAdrian CalderonAún no hay calificaciones

- Fórmulas ExcelDocumento11 páginasFórmulas ExcelWilbert Gordillo Liceras100% (3)

- S4-C1 Estrategias Discursivas PárrafoDocumento10 páginasS4-C1 Estrategias Discursivas PárrafoPaola Medina GarnicaAún no hay calificaciones

- 2do Taller ProbabilidadesDocumento1 página2do Taller ProbabilidadesAnghelita CaldheronAún no hay calificaciones

- Roba Esta Presentacion PDFDocumento71 páginasRoba Esta Presentacion PDFAntonio Eduardo PalaciosAún no hay calificaciones

- Lab 03 PDFDocumento10 páginasLab 03 PDFzerefdragnellAún no hay calificaciones

- Formato de Solicitud de Actualizaciones y Novedades - para V3Documento1 páginaFormato de Solicitud de Actualizaciones y Novedades - para V3Anonymous s7OBO550% (2)

- VBScript Parte1Documento35 páginasVBScript Parte1Rafael CordanoAún no hay calificaciones

- CPUCPQ2660Documento2 páginasCPUCPQ2660njca.scribdAún no hay calificaciones

- Grupo # 4 Trabajo Final Informatica 1Documento10 páginasGrupo # 4 Trabajo Final Informatica 1Jean Carlos EncarnaciónAún no hay calificaciones

- Dirección de Proyectos - RubricaDocumento1 páginaDirección de Proyectos - RubricaLuis Antonio Bravo SaucedoAún no hay calificaciones

- Tipos de EstructurasDocumento4 páginasTipos de EstructurasEmmanuel Pimentel ReyesAún no hay calificaciones

- PerlDocumento15 páginasPerlJairo Causil SuarezAún no hay calificaciones

- Sintesis. Taller de Computo CCH 12 13Documento3 páginasSintesis. Taller de Computo CCH 12 13Luis AlvaradoAún no hay calificaciones

- Objetivos de Seguridad Basada en El Comportamiento Agnew SnyderDocumento13 páginasObjetivos de Seguridad Basada en El Comportamiento Agnew SnyderEnrique Roldan MontesAún no hay calificaciones

- Cv1 Introducción - Circuitos CombinacionalesDocumento22 páginasCv1 Introducción - Circuitos CombinacionalesMarcelo Ramos TrcoAún no hay calificaciones

- Capitulo 5Documento26 páginasCapitulo 5gatuzoAún no hay calificaciones

- Trabajo Práctico TelegrafíaDocumento3 páginasTrabajo Práctico TelegrafíaOrnella MicciulloAún no hay calificaciones

- ARIEL-Colecciones Autores Titulos 1-60 LowDocumento60 páginasARIEL-Colecciones Autores Titulos 1-60 LowRebe MatamorosAún no hay calificaciones

- Manufactura Inteligente Utilizando Vision para RobotsDocumento6 páginasManufactura Inteligente Utilizando Vision para RobotsjavierchachacoAún no hay calificaciones

- Práctica 2 Arboles Semiarboles TransmisiónDocumento4 páginasPráctica 2 Arboles Semiarboles TransmisiónLuis Alberto Martin Escobar0% (1)

- Etiquetas JSFDocumento2 páginasEtiquetas JSFRicardo Granados100% (1)

- Ejercicios de FactorizaciónDocumento8 páginasEjercicios de Factorizaciónkatherinz9100% (1)

- Matriz de Rastreabilidad de Requisitos Del 81 Al 86Documento8 páginasMatriz de Rastreabilidad de Requisitos Del 81 Al 86alexAún no hay calificaciones

- EjemploDocumento17 páginasEjemploYordan AlexisAún no hay calificaciones

- Cuestionario Ctos. Electroneumáticos 01Documento16 páginasCuestionario Ctos. Electroneumáticos 01andres gomez50% (2)