Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Resumen Deep Feature Selection

Resumen Deep Feature Selection

Cargado por

Jose Luis llumiquingaDerechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

Resumen Deep Feature Selection

Resumen Deep Feature Selection

Cargado por

Jose Luis llumiquingaCopyright:

Formatos disponibles

Deep-FS: A feature selection algorithm for Deep Boltzmann Machines

1. Introducción

El Deep learning ha tenido grandes impactos en áreas como el reconocimiento

de imágenes, reconocimiento de voz, bioinformática y muchas otras aplicaciones

donde se tienen grandes volúmenes de datos. Existen otros métodos más

comunes de aprendizaje automático pero que tienen muchas limitaciones. Por

ejemplo, el Deep learning a diferencia de los métodos comunes de aprendizaje

es que este integra la extracción de características y el proceso de aprendizaje.

La extracción de características tiene la tarea de eliminar características que

aportan con información redundante o poco significativa, al hacer esto se puede

reducir la cantidad de datos y por ende mejorar la velocidad de procesamiento de

los datos. Existen otras maneras de aprendizaje automático como las redes

neuronales profundas, estas DNN cuando poseen una gran cantidad de

características irrelevantes son modeladas pero este modelado actúa como ruido

que afecta al conocimiento que adquiere la red sobre la distribución de datos y el

tiempo de cálculo.

Existen las Deep Belief Networks (DBN) propuestas por Hinton y

Salakhutdinov, y las Deep Boltzmann Machines (DBMs) presentadas por

Srivastava y Salakhutdinov et al. Que son DNN, estas usan máquinas de

Boltzmann restringidas densamente conectadas (RBM), que son modelos de

redes neuronales profundas formadas por múltiples capas de líneas de red. En

estas DBN la gran cantidad de datos por procesar y conexiones que aumentan el

costo computacional y el tiempo de capacitación de las RBM, pero cuando se

reducen las características de entrada se reduce el costo computacional de

ejecutar métodos de aprendizaje profundo. Debido a esto se propone un nuevo

algoritmo llamado Deep-Feature Selection (Deep-FS), que integra las

capacidades de selección DBM para que las características irrelevantes se

eliminen de los datos en bruto de esta manera se reducen el número de entradas

que se modelan durante el proceso de aprendizaje.

2. Propósito

En este artículo se muestra una novedosa técnica de selección de características

para ello se describen las máquinas de Boltzmann, las propiedades matemáticas

de las máquinas de Boltzmann restringidas, que es el Deep Learning, la

selección de características. Se detalla en si cuales son los pasos de este

algoritmo llamado Deep-Feature Selection y finalmente se muestran los

resultados experimentales al usar este algoritmo de selección.

3. Objetivo

Deep-FS utiliza Deep Boltzmann Machines, este algoritmo utiliza el

conocimiento que se adquiere durante el entrenamiento de DBM para eliminar

características al inicio del proceso de aprendizaje, hay que recalcar que es

importante eliminar las características irrelevantes porque de esta manera se

impide que la red aprenda sobre estas características que no aportan nada y así se

evita impactos negativos en el conocimiento adquirido en la red. Existen dos

versiones para el método de selección de características propuesto, en la primera

versión del algoritmo el RBM no está capacitado durante la selección de

características. Pero, en la segunda versión, el RBM se entrena durante el

procedimiento de selección de características.

La versión de Deep-Feature Selection escogida es aquella en la que el RBM no

se entrena durante la selección de características.

Train RBM on the training data.

Calculate the initial reconstruction error ei by the trained RBM

using (17) for all i.

Nv = ‘number of visible features’

i = 1

While i < Nv:

Select Ne features for evaluation.

Ns = Ne

Set vk = 0 for k ∈ {Ne selected features} (elimination of the

Ne features).

Calculate the reconstruction error ek’ for each eliminated

feature using (17).

for k ∈ {Ne eliminated features}:

if ek’<ek then:

Remove the kth visible unit.

Nv = Nv – 1

Ns = Ns – 1

else:

Reset vk from 0 to its original value, and add it

to selected features.

i = i + Ns

Tabla1. Seudocódigo Deep-FS

2 2

𝑒𝑖 ∝ ([𝑣̃𝑖 ℎ𝑗 ] − [𝑣𝑖 ℎ𝑗 ]) = ((𝑣̃𝑖 − 𝑣𝑖 )ℎ𝑗 )

𝑒𝑖 = 𝐸𝑚𝑜𝑑𝑒𝑙 [(𝑣̃𝑖 − 𝑣𝑖 )2 ] (17)

Entrada: Serie de características para evaluarse.

Salida: Serie de características relevantes con reconstrucción de características

eliminadas.

Descripción:

El algoritmo Deep-FS adopta la propiedad generativa de RBM para definir un método

para la selección de características. Esta propiedad genera la probabilidad del valor de

una unidad visible dados los estados de unidades ocultas. El algoritmo Deep-FS

encuentra características con información útil y para esto utiliza la propiedad de RBM

para eliminar la información inútil. La información seleccionada al final tendrá menos

características que reducirá la complejidad de la red. El algoritmo se puede expresar en

tres pasos.

a. Entrenamiento inicial: Los datos de entrenamiento ingresan en una RMB y los

pesos de RBM se ajustan calculando la diferencia 𝐸𝑑𝑎𝑡𝑎 [𝑣𝑖 ℎ𝑗 ] − 𝐸𝑚𝑜𝑑𝑒𝑙 [𝑣̃𝑖 ℎ𝑗 ]

b. Eliminación de características: Se eliminan las características innecesarias. El

algoritmo propuesto puede eliminar una característica única o si se desea un

grupo de características en cada evaluación. El algoritmo comienza con un

conjunto de características de entrada y las evalúa con la RMB entrenada. El

RMB minimiza el error de red. Durante este proceso se reduce el valor absoluto

del error y el proceso de aprendizaje se detiene cuando el error llega a cero o

cuando se alcance un numero predefinido.

c. Capacitación Principal: se capacita la DBM con la RBM previamente entrenada

en los datos de capacitación que son las características seleccionadas

4. Referencias

Taherkhani, A., Cosma, G. and McGinnity, T. (2018). Deep-FS: A

feature selection algorithm for Deep Boltzmann Machines. Neurocomputing, 322,

pp.22-37.

También podría gustarte

- Medios de Comunicación Antiguos y ModernosDocumento2 páginasMedios de Comunicación Antiguos y ModernosEdinHub100% (1)

- Informatica JuridicaDocumento145 páginasInformatica JuridicaFRANK CARLOS BARRIONUEVO TERAN100% (1)

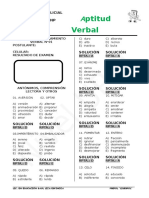

- Material RV Resuelto 1Documento14 páginasMaterial RV Resuelto 1Aguafresh AguafreshAún no hay calificaciones

- SILABO Habilidades ComunicativasDocumento4 páginasSILABO Habilidades Comunicativasmela diaz zuñigaAún no hay calificaciones

- Sesión de Aprendizaje Com 1 - IVDocumento4 páginasSesión de Aprendizaje Com 1 - IVOdilia Fuentes Rivera50% (2)

- Informe Trabajo SocialDocumento22 páginasInforme Trabajo Socialjuan daniel pinillos granadosAún no hay calificaciones

- 2 Lenguaje de Manipulación de DatosDocumento65 páginas2 Lenguaje de Manipulación de DatosPatrick zaidAún no hay calificaciones

- PreguntasDocumento8 páginasPreguntasBartomeuAún no hay calificaciones

- Diagrama de Bloques de Un Sistema de Control de La Expresión Facial Del Robot DiseñadoDocumento4 páginasDiagrama de Bloques de Un Sistema de Control de La Expresión Facial Del Robot DiseñadoemersonAún no hay calificaciones

- Unidad - 1 PROCESO ADMINISTRATIVO PDFDocumento53 páginasUnidad - 1 PROCESO ADMINISTRATIVO PDFJesus Muñoz BalamAún no hay calificaciones

- Tipos de CódigosDocumento2 páginasTipos de CódigosLuisMoralesAún no hay calificaciones

- Teoría de La Resonancia AdaptativaDocumento6 páginasTeoría de La Resonancia AdaptativaErb WHAún no hay calificaciones

- Curso Básico de Manejo de Datos en Laravel Con Eloquent ORMDocumento6 páginasCurso Básico de Manejo de Datos en Laravel Con Eloquent ORMArturo ZvechiskavaAún no hay calificaciones

- Toma de Decisiones Unidad IIDocumento20 páginasToma de Decisiones Unidad IIEzequiel LópezAún no hay calificaciones

- Sesion 2 ComunicaciónDocumento33 páginasSesion 2 ComunicaciónAnalucia Córdova SuárezAún no hay calificaciones

- Botella, Luis Vilaregut, Anna - La Perspectiva Sistémica en Terapia Familiar: Conceptos Básicos, Investigación y EvoluciónDocumento16 páginasBotella, Luis Vilaregut, Anna - La Perspectiva Sistémica en Terapia Familiar: Conceptos Básicos, Investigación y EvoluciónJessica MézquitaAún no hay calificaciones

- ML Tipos de Aprendizaje TINKADocumento28 páginasML Tipos de Aprendizaje TINKANick DavilaAún no hay calificaciones

- Unidad I. Introducción A La Inteligencia ArtificialDocumento18 páginasUnidad I. Introducción A La Inteligencia ArtificialRoberto FlamesAún no hay calificaciones

- 1°guia SHNDocumento10 páginas1°guia SHNRicardo Martinez0% (1)

- Tecnicas de NLPDocumento8 páginasTecnicas de NLPEmma RBAún no hay calificaciones

- Capitulo I Enfoque de Los SistemasDocumento34 páginasCapitulo I Enfoque de Los SistemasJohn WallaceAún no hay calificaciones

- Lab07 Control PIDDocumento6 páginasLab07 Control PIDAndersonAún no hay calificaciones

- PerceptronDocumento29 páginasPerceptronjohntuxAún no hay calificaciones

- Silabo Lenguaje IDocumento10 páginasSilabo Lenguaje Imayra ortiz herrera100% (1)

- Teorías Lingüísticas - WikipediaDocumento5 páginasTeorías Lingüísticas - WikipediaBruno AllariaAún no hay calificaciones

- Mapa Competencia KinesicaDocumento1 páginaMapa Competencia KinesicamonicaAún no hay calificaciones

- TAREA 3 - Comunicación No VerbalDocumento11 páginasTAREA 3 - Comunicación No VerbalMarisol Chavarria0% (1)

- IA - Tema 2A - Agentes Inteligentes v1.2 PDFDocumento54 páginasIA - Tema 2A - Agentes Inteligentes v1.2 PDFPilloman3Aún no hay calificaciones

- Ejercicio 7 - TerminadoDocumento7 páginasEjercicio 7 - TerminadoRafael Moncayo PérezAún no hay calificaciones

- Redes NeuronalesDocumento21 páginasRedes NeuronalesZuajna Von ZweiAún no hay calificaciones