Documentos de Académico

Documentos de Profesional

Documentos de Cultura

2c ALUMNOS Probabilidad Equilibrio Entropia PDF

2c ALUMNOS Probabilidad Equilibrio Entropia PDF

Cargado por

Kevin SantosTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

2c ALUMNOS Probabilidad Equilibrio Entropia PDF

2c ALUMNOS Probabilidad Equilibrio Entropia PDF

Cargado por

Kevin SantosCopyright:

Formatos disponibles

1 CONCEPTOS BSICOS.

PROBABILIDAD, EQUILIBRIO Y ENTROPA

8 PESO ESTADSTICO. ENTROPA.

PESO ESTADSTICO

Considere un sistema aislado. Lo dividimos en dos subsistemas A y B que pueden intercambiar energa

entre s. Voy a buscar todos los estados accesibles del sistema total cuando tiene una energa ET. Para ello

busco todos los posibles microestados de cada subsistema con energas EA y EB, tal que EA+EB=ET. Voy a

hacerlo con un ejemplo sencillo: un sistema de 4 osciladores cunticos. No es un sistema macroscpico

pero es suficiente para introducir el comportamiento de esos sistemas. Normalmente no ocurre as con

sistemas de pocas partculas. El sistema de los cuatro osciladores se divide en dos subsistemas iguales de

dos osciladores cada uno.

El problema de N osciladores ya lo vimos en los problemas. Cada oscilador tiene una energa

(n)=(+n)=(+n)0, con n=0,1,2,3,... Para N osciladores la energa es E = (n1)+(n2)+... =

(+n1)0 + (+n2)0 +...= N0/2+M0, donde M=n1+n2+... Como cada ni=0,1,2,3,... M podr valer

0,1,2,3,... Observe que para cada energa E hay un valor de M y viceversa. En el caso de N=2 osciladores

(que corresponde a cada uno de los dos subsistemas A y B) E=1+M0. Para cada energa habamos visto

que haba un nmero de estados igual a (E,N) = (M+N-1)!/M!(N-1)!. Para N=2, nuestro caso (E,N=2)

= (M+1)!/M!=M+1, es decir para las sucesivas energas (o valores de M) el nmero de estados es 1,2,3,..

En la figura se muestran los estados de las energas ms bajas para uno de los dos subsistemas, por

ejemplo el A. He llamado a los sucesivos estados a,b,c,d,..... El subsistema B es idntico. Llamar a los

correspondientes estados de B: a,b,c,d,... Observar que la energa total de los sistemas A, B y total, as

como el nmero de osciladores de cada uno de estos sistemas, estn jugando el papel de variables

MACROSCPICAS aunque difcilmente podran ser consideradas como tales.

EA/0

5

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

Pongamos los dos sistemas en contacto: pueden intercambiar energa. Este intercambio de energa

seguir una dinmica que no nos importa.

A

B

Lo que he hecho para 2 osciladores se puede repetir para 4, es decir buscar los posibles valores para la

energa ET de los estados MACROSCOPICS y contar cuantos estados microscpicos le corresponden. ET

es la suma de las energas de 4 osciladores: ET = (n1) + (n2) + (n3) + (n4) = (2+n1+n2+n3+n4)0

= (2+M)0 con M=n1+n2+n3+n4=0,1,2,3 ..., T(E,N=4) = .... = (M+3)!/M!3! = 1,2,3,4,... para

M=0,1,2,3,...., etc. etc. El resultado se muestra en el diagrama siguiente

E/0

ka'

-dd'

-ak'

--

la'

-de' df'

-- -al' am'

-- --

ma'

na'

a'

---ed' ee' ef'

fd' fe' ff'

-- -- --- -- -an' a'

bg' bh' bi' bj'

-- --- -- -- --

ga'

-ag'

--

ha'

-ah'

--

ja'

-aj' bd' be' bf' cd' ce' cf' db' dc' eb' ec' fb' fc'

-- -- -- -- -- -- -- -- -- -- -- -- --

ia'

-ai'

--

ad' ae' af' bb' bc' cb' cc' da' ea' fa'

-- -- -- -- -- -- -- -- -- --

ab' ac' ba' ca'

-- -- -- --

aa'

--

gb'

-cg'

--

gc'

hb' hc'

--- -ch' ci' cj'

-- -- --

ib' ic'

-- --

jb' jc'

-- --

que como se ve cada microestado es una combinacin de un microestado de cada subsistema.

Supongamos que tenemos el sistema de 4 osciladores aislado y con una energa total ET=60. Sea la

energa que sea de A y de B y sea el que sea el microestado en el que estn A y B se deba cumplir en

todo momento que ET = 60 = EA + EB.

El nmero de microestados con ET = 60 son 35 que se obtienen de hacer las combinaciones de estados de

A con los de B: T(E,N=4)= 1 x 5 + 2 x 4 + 3 x 3 + 4 x 2 + 5 x 1 = 5 + 8 + 9 + 8 + 5 = 35

= A(EA ) B(EB) = A(EA ) B(ET-EA)

EA

EA

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

Observe que cada microestado del sistema total se construye con estado del sistema A de energa EA y

con un estado del sistema B con la energa complementaria EB=ET-EA:

EA/0

60

EB/0

k

-

l

-

m

-

n

-

g

-

h

-

i

-

j

-

d

-

e

-

f

-

b

-

c

-

a

-

ka'

-dd'

-ak'

--

la'

-de' df'

-- -al' am'

-- --

k' l' m' n' '

- - - - -

g' h' i' j'

- - - -

d' e' f'

- - -

b' c'

- -

a'

-

ma'

na'

a'

---ed' ee' ef'

fd' fe' ff'

-- -- --- -- -an' a'

bg' bh' bi' bj'

-- --- -- -- --

gb'

-cg'

--

gc'

hb' hc'

--- -ch' ci' cj'

-- -- --

ib' ic'

-- --

jb' jc'

-- --

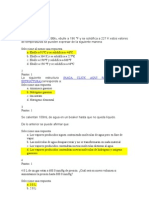

Ahora voy a clasificar los 35 microestados basndome en como se obtienen de la combinacin de los

microestados de los subsistemas A y B:

PA(EA)

PB(EB)

A(EA)x B(EB) = A(EA)xB(ET-EA)

pA(Ei=EA)

5 35=

A(EA)x B(EB) = B

A(EA)

B(EB) = B(ET-EA)

5

4

pB(Ei=EB)

3

2

1

EB

G. NAVASCUS

EA

0

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

En equilibrio todos los microestados del sistema total, los 35, tienen la misma probabilidad de ser

ocupados (2 postulado: la probabilidad slo depende de la energa). Por lo tanto del ejemplo y en

general se llega inmediatamente a las siguientes conclusiones:

p(Ei=EA) = probabilidad de encontrar el sistema A en uno de los microestados de energa EA

es directamente proporcional al nmero de microestados de B con la energa

complementaria EB= ET EA para que el total sea el adecuado, es decir B(ET EA)

Por ejemplo el micro b aparece 4 veces porque se combina con los 4 micros del sistema B para dar la

energa total 60, el micro h slo aparece 2 veces ya que slo se puede combinar con 2 microestados de

B, es decir su probabilidad es la mitad de la de b.Esta probabilidad normalizada es por tanto: p(Ei=EA) =

B(ET EA) / T(ET) = B(ET EA) / 35. As que p(b)=4/35 y p(h)=2/35.

P(EA) = probabilidad de encontrar el sistema A con energa EA pero no importa en cual =

= probabilidad de encontrar A en cualquiera de ellos, p(Ei=EA) (todos son igualmente probables)

por el nmero de ellos: =A(EA ) B(ET EA)/ T(ET)

Como EA es una propiedad global del sistema A, la probabilidad P(EA) es en realidad (si el sistema fuese

macroscpico) la probabilidad de que el sistema tenga la energa EA. Observe que la expresin obtenida

ya est normalizada a la unidad. En el ejemplo: p(EA=20) = 2x4/35 = 8/35 y p(EA=40) = 4x2/35 =

8/35.

Las conclusiones pueden rescribirse as:

La probabilidad de que un sistema est en un preciso microestado de

energa E es proporcional RU(ET E), donde ET es la energa total del

universo, y RU el nmero de estados del resto del universo:

p(E) RU(ET E)

y la ms til como veremos:

La probabilidad de que un sistema est en un macroestado de energa E

(o lo que es lo mismo en cualquiera de los microestados de energa E) es

proporcional al producto (E)RU(ET E), donde ET es la energa total del

universo, y y RU son el nmero de estados del sistema y del resto del

universo respectivamente:

P(E) (E)RU(ET E)

Haciendo nmeros en el ejemplo de los 4 osciladores se tienen los resultados (ver recuadro adjunto) para

las distintas probabilidades de los subsistemas A y B y el sistema total. Es un ejercicio elemental pero

compruebe que lo entiende. Es fundamental entenderlo!

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

Para que la energa total sea 6 (en unidades de =0) las posibles combinaciones energticas de los

subsistemas, del ejemplo de los 4 osciladores, deben ser:

EA

EB=ET-EA

EA+EB

1

5

6

2

4

6

3

3

6

4

2

6

5

1

6

Y las correspondientes combinaciones de microestados:

EA

A(EA)

B(ET-EA)

AxB

1

1

5

5

2

2

4

8

3

3

3

9

4

4

2

8

5

5

1

5

Por lo que el nmero total de estados del sistema total (con ET=6) es

T(ET=6) = A(EA)xB(EB)= = 1x5 + 2x4 + 3x3 + 4x2 +5x1 = 5 + 8 + 9 +8 +5 = 35

como debe ser.

Los 35 estados son igualmente probables, todos tienen la misma energa total ET=60. La probabilidad de

que el sistema est en cualquiera de esos 35 estados debe ser 1/35, o, en media, cada 35 unidades de

tiempo el sistema cambiar de estado. Pero no todos los estados son iguales, en algunos la energa de A

es pequea y la de B es grande y viceversa. Del sistema total ya est dicho todo en este ejemplo.

La probabilidad pA(Ei = EA) de que el subsistema A est en UN preciso microestado de entre los que tienen

energa EA, pudiendo ser EA=1,2,3,4 o 5. Naturalmente para que A est en ese estado y por tanto tenga

esa energa, el subsistema B tiene que tener la energa complementaria EB=ET EA, es decir puede estar

en CUALQUIERA de los microestados de energa de energa EB=ET EA. Est claro que, cuantos ms

microestados tenga B con esa energa complementaria, ms posibilidades tendr A de estar en el

microestado propuesto, es decir que como se ha dicho antes pA(Ei = EA) es proporcional a B(ET EA). Si

se incluye una constante de normalizacin: pA(Ei =EA) =B(ET EA)/ T(ET). La constante de

normalizacin ahora es 1/T(ET)=1/35. Por lo tanto:

Estado i

Energa Ei

B(ETEi)

pA(Ei)

a

1

5

5/35

b

2

4

4/35

c

2

4

4/35

d

3

3

3/35

e

3

3

3/35

f

3

3

3/35

g

4

2

2/35

h

4

2

2/35

i

4

2

2/35

j

4

2

2/35

k

5

1

1/35

l

5

1

1/35

m

n

5

5

1

1

1/35 1/35

5

1

1/35

De manera anloga se obtendran las probabilidades pB.

Ahora podramos preguntarnos por la probabilidad PA(EA) de que el subsistema A est en CUALQUIER

estado de energa EA, sin importar en que preciso microestado con tal que tenga la energa EA.

Naturalmente para que A tenga esa energa el otro subsistema, otra vez, tiene que tener la energa

complementaria EB=ET EA. E igual que antes, cuantos ms estados tenga B con la energa

complementaria, ms posibilidades tendr A de tener la energa EA, es decir PA(EA) ~ B(ET EA).

TAMBIN, esto es nuevo, cuantos ms estados tenga A con esa energa tambin aumentar la esta

probabilidad, as que como tambin se ha dicho antes: PA(EA) ~ A(EA) B(ET EA). Si se normaliza esta

probabilidad se llega a PA(EA)=A(EA) B(ET EA)/ T(ET)

EA

P(EA)

1

5x1/35=1/7

2

2x4/38=4/19

3

3x3/35=9/35

4

4x2/35=4/19

5

5x1/35=1/7

De manera anloga se obtendran las probabilidades de PB

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

Podramos representar los microestados del sistema total de esta forma:

4. EA

EB =ET-EA

9

8

6

5

EB

3

2

4

5

3

4

2

3

1

2

EA

ET=6

Nos fijamos ahora en esta probabilidad: la de encontrar un subsistema con una energa, sin importarnos

en qu preciso microestado de esa energa est. Observamos que PA(E) es producto (salvo la constante de

normalizacin) de dos funciones nmero de estado, A(E) y B(E), y por tanto, en el caso usual,

crecientes con la energa. Sin embargo el argumento de una de ellas es la energa complementaria as que

finalmente P es el producto de dos funciones una creciente A(E) y la otra decreciente. A(ET-E).

En la figura se muestran estas dos funciones y se ve claramente como una crece y la otra decrece con la

energa del subsistema elegido, el A (y viceversa si hubiramos elegido el subsistema B). Las lneas

verticales rojas es el producto de ambas funciones en cada energa de A y por tanto es la funcin de

probabilidad PA (salvo el factor trivial de normalizacin).

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

PA(EA ) ~A(EA) B(ETEA)

B(EB=ETEi) ~ pA(Ei)

A(EA) ~ pB(Ei=ET-EA)

B

EA

EB=ET-EA

Con las ideas expuestas voy a definir el Peso Estadstico y ver que significa en el ejemplo de los 4

osciladores. Luego expondr cmo va perfilndose su significado conforme el sistema contiene ms y ms

partculas. Finalmente para mayor claridad describir un sistema de 5000 osciladores que aun no siendo

realmente macroscpico ilustra a la perfeccin el efecto de aumentar el nmero de partculas (osciladores

en nuestro caso) del sistema.

Por definicin:

PESO ESTADSTICO: conjunto de estados con probabilidad significativa de

ser ocupados

Si uno se fija en los valores (ver recuadro anterior) de las probabilidades de ocupacin de los distintos

microestados del sistema A, del ejemplo de los 4 osciladores, se observa que las esas decrecen

montonamente con la energa (comportamiento general como demostraremos ms adelante). En el caso

de menor probabilidad p=1/35, es decir para la mxima energa EA=5 que puede tener el sistema A en las

condiciones dadas, no se puede considerar que sea despreciable (claro que esto siempre es relativo) pero

es del orden de la probabilidad, 5/35, del microestado ms probable. Como consecuencia, todos los

estados tienen, desde el a hasta el , una probabilidad significativa de ser ocupados por el sistema A.

Entonces el Peso Estadstico debe ser 15. Como el sistema B es idntico al A, tambin tiene un Peso

Estadstico de 15. En sistema total todos los estados tienen la misma probabilidad as que el Peso

Estadstico debe es 35, el nmero total de estados que tienen el sistema total en las presentes

circunstancias. La conclusin en el ejemplo es que el Peso Estadstico coincide con los estados accesibles

de cada sistema en las condiciones dadas. Si esto fuese as siempre no tendra el menor inters. Pero

veamos como se discriminan los microestados del Peso Estadstico de entre todos los accesibles si el

nmero de partcula aumenta hasta hacerse macroscpico.

A las siguientes figuras hay que aadir la discusin hecha en clase.

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

El rango de energas del Peso Estadstico del sistema A est marcado en rojo. Conforme se aumenta el

tamao (el nmero de partculas) del sistema para hacerse normal (macroscpico) lo que pasa es:

PA(EA ) ~A(EA) B(ETEA)

B(EB=ETEi) ~ pA(Ei)

A(EA) ~ pB(Ei=ET-EA)

EA

EB=ET-EA

PESO

ESTADSTICO

RANGO DE

ENERGAS DEL

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

Para tamaos tpicamente macroscpicos:

Una delta de Dirac!

PA(EA ) ~A(EA) B(ETEA)

B(EB=ETEi) ~ pA(Ei)

A(EA) ~ pB(Ei=ET-EA)

EA

EB=ET-EA

Las energas de los estados del Peso Estadstico se restringen a un intervalo infinitesimal.

Las energas correspondientes del sistema TOTAL tienen prcticamente la totalidad de los

estados.

Si llamamos <EA> a la energa media de los estados del Peso Estadstico y EA al intervalo de la energa

del Peso Estadstico, nos damos cuenta de que esta energa es el valor medio de la energa del sistema A

y por tanto PESO ESTADSTICO DE A = A(<EA>)EA; en general se podr escribir:

PESO ESTADSTICO = (<E>)E

Lo que indica que el Peso Estadstico crece asombrosamente tambin con la energa.

G. NAVASCUS

23/10/2004

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

-----------------------------------Notas:

No olvide que

0 ( E , N , V )

, es decir que de forma ms explcita es A=A(<EA>,N,V). Usualmente

E

se escribe A=A(EA,N,V), se sobreentiende que se trata de la energa media. As que el Peso Estadstico

en una funcin de E, N y V.

Observe que existe cierta ambigedad en la determinacin del intervalo de energas ya que depende de

un criterio aparentemente vago, el de que los estados sean visitados de manera significativa por el

sistema A. Significativa? Sin embargo esto no ser ningn problema como veremos ms adelante.

--------------------------------Simultneamente por simetra: PESO ESTADSTICO DE B = B(EB)EB= B(ET -EA)EB. Como EA = EB

y que Peso Estadstico del sistema total debe obtenerse de la combinacin del nmero de estados con

mayor peso probabilstico de los dos subsistemas, es decir del producto de los pesos estadsticos:

PESO ESTADSTICO DEL SISTEMA TOTAL =

=

PESO ESTADSTICO DE A

=

x PESO ESTADSTICO DE B =

A(EA)EA x B(EB)EB = A(EA)EA x B(ET -EA)EB

Observe que el Peso Estadstico del sistema total (que est aislado) es prcticamente el nmero total de

de microestados accesibles, mientras que no es ni mucho menos lo que pasa con los subsistemas, es ms

hay rangos de energa de los subsistemas ( correspondientes a mayores energa que la media) con

muchos (muchsimos) ms microestados.

Fjese que el Peso Estadstico del sistema total como producto de pesos estadsticos de los dos

subsistemas no se cumple en el ejemplo de los 4 osciladores. Este producto slo tiene sentido en el caso

de sistemas macroscpicos. En cualquier caso el Peso Estadstico del sistema total es prcticamente igual

a su nmero de microestados como hemos visto antes y este nmero si que es el del caso de los 4

osciladores. Este ejemplo fue elegido para ilustrar las ideas pero no es posible hacerlo con todas ellas ya

que son propias de sistemas macroscpicos.

Para acabar la presente discusin note que se puede generalizar la expresin del Peso Estadstico (PE)

como producto de pesos estadsticos si el sistema es dividido en dos o ms subsistemas.

PE del sistema TOTAL = PE de A x PE de B x PE de C x PE de D x .... =

= A(<EA>)EA x B(<EB>)EB x C(<EC>)EC x D(<ED>)ED x ....

A(<EA>)EA X B(<EB>)EB X C(<EC>)EC X D(<ED>)ED X ....

G. NAVASCUS

23/10/2004

10

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

Vamos ahora con un ejemplo del libro de Waldram (ver bibliografa; este libro es recomendado

especialmente): considere 10.000 osciladores cunticos como sistema aislado. Cada subsistema tiene

5000. Fjese que aun as estos nmeros de osciladores son ridculos en comparacin con lo que sera un

sistema macroscpico (N del orden de 1024) pero al menos no nos desbordaran. Ante la imposibilidad de

representar directamente cada posible estado me limitar a representar por pequeas lneas, sobre los

ejes de las energas de los subsistemas A y B las respectivas densidades de estados y por puntos, sobre el

primer cuadrante, la densidad de estados del sistema total. A mayor concentracin de pequeas lneas, o

puntos, mayor densidad de estados. Todos los puntos que estn en una misma recta EB=-EA+ET, de

pendiente 1, corresponden a estados del sistema total con la misma energa. Y naturalmente los puntos

entre las rectas EA+EB=ET y EA+EB=ET +dET corresponden al sistema total con energa entre ET y ET+dET.

Para una energa total dada, donde est la zona de mayor acumulacin de puntos ser del Peso

Estadstico. Fjese que en el caso del intervalo de energas ahora el sistema no est estrictamente aislado

pero eso es lo de menos.

La mayora de los

estados del sistema

total estn en esta

zona (Peso Estadstico

del sistema total)

EB|(EB)

dET

EB|(EB)

Los estados del sistema A con probabilidad de estar

ocupados (Peso Estadstico del sistema A) estn en

esta zona de energas que debe corresponder a <EA>

G. NAVASCUS

23/10/2004

11

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

En el siguiente diagrama se describe otro aspecto del Peso Estadstico. En este caso son 15000

osciladores y los subsistemas no son iguales, pero esto es lo de menos. Se supone ahora que la

interaccin entre los subsistemas es menor que la interna en cada subsistema, de tal forma que el

intercambio de energa es menos efectivo entre subsistemas que entre osciladores dentro de un mismo

subsistema. Ahora en los ejes se representan las energas y el nmero de estados de los dos subsistemas,

(una representacin similar al diagrama anterior). Para una energa de 15000 unidades (15000

excitaciones repartidas entre todos los osciladores) se representan los posibles estados del sistema total

distribuidos conforme a como se reparten las 1500 unidades de energa entre los dos subsistemas (otra

vez similar representacin del diagrama anterior). Se ve que cuando el reparto de la energa total se hace

dando al subsistema B unas 10000 unidades y al A unas 5000 unidades se obtiene el mayor nmero de

microestados del sistema total (109031, Peso Estadstico=A(5000)EA x B(10000)EB); ms an, para

cualquier otro reparto el nmero de microestados del sistema total, a pesar de ser enorme, es totalmente

despreciable frente al mximo. Fjese como cambian los nmeros al pasar de 4 a 15000 osciladores, y

este cambio es nada comparado con lo que saldra si tuviramos 1023 osciladores!!!!

La delta en rojo y las flechas que le acompaan estn relacionadas con la evolucin temporal del

sistema (ver discusin en el libro de Walfram, o los apuntes de clase)

EB

Microestados de B en

funcin de la energa

!!!

15000

A

5000

Osciladores

cunticos

B

10000

Osciladores

cunticos

ET=1500 (en unidades de )

109000

10000

10

109030.9

6000

109000

105000

5000

Microestados de A en

funcin de la energa

104000

10

108000

3000

102000

101000

107000

102000

103000

104000

5000

G. NAVASCUS

10000

23/10/2004

EA

15000

12

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

ENTROPA

Ahora estamos en condiciones de definir la entropa como:

S = k Ln (Peso Estadstico)

Donde k es la constante de Boltzmann e igual a 1.38x10-16 erg/K.

De momento es una definicin pero veremos que coincide con la entropa termodinmica y por tanto esta

expresin es de extraordinario inters ya que establece un vnculo entre el mundo macroscpico (la

entropa termodinmica) y el microscpico (el Peso Estadstico).

La entropa es, por definicin, una medida del nmero de estados que el sistema visita con probabilidad

significativa.

La constante k es simplemente un factor para que la Entropa aqu definida, coincida numricamente y

con las unidades correspondientes con la entropa termodinmica.

El logaritmo juega un papel importante en esta identificacin. De momento lo que hace es planchar

literalmente el extraordinario crecimiento del Peso Estadstico con E. S como funcin de E puede dibujarse

sin problemas. Pero an ms importante, la propiedad de factorizacin del Peso Estadstico se convierte

en SUMA con el logaritmo:

S(ET) = SA(<EA>)+ SB(<EB>)+SC(<EC>)+ SD(<ED>)+.

Es decir la entropa es una magnitud EXTENSIVA; la entropa de un sistema es la suma de las entropas

de sus partes, como lo son las variables macroscpicas V o N.

Como el peso estadstico es una funcin de E y de posibles parmetros externos como N y V, la entropa

tambin lo es S=S(E,N,V,...)

A pesar de las diferencias (E) < 0(E) y (en los sistemas estadsticamente normales) (E)E < 0(E), la

entropa, S=k Ln [(E)E], se puede evaluar tambin como S = k Ln[0(E)] o como S = k Ln[(E)]. Esto

es debido a que las diferencias mencionadas acaban siendo totalmente despreciables al tomar el

logaritmo. Veremos este comportamiento en distintos problemas con un nmero macroscpico de

partculas.

El mnimo valor posible del Peso Estadstico es 1, por tanto PE1, y como consecuencia S 0. La

entropa no puede ser negativa

La entropa es una funcin cncava con respecto a la energa (y con respecto a N y V). Para llegar a esta

conclusin se puede utilizar el mismo argumento de equilibrio que en Termodinmica.

(E), 0(E), (E)

G. NAVASCUS

S=kLn((E)E =k Ln[0(E)]= k Ln[(E)]

23/10/2004

13

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

La posibilidad de identificar la entropa con kLn[(E)] me permite "redibujar" las grficas, que he utilizado

para introducir el peso Estadstico, con la entropa en vez de con el nmero de estados. En la figura

adjunta hago esto y se observan comportamientos muy interesantes: los cambios de curvatura como

debe ser, la posibilidad de dibujar el comportamiento de la entropa con la energa para los distintos

sistemas, A, B y total, todo ello a la misma escala y lo ms importante: en equilibrio la entropa del

sistema total es mxima. Este punto lo voy a discutir con ms extensin a continuacin.

PA(EA ) ~A(EA) B(ETEA)

B(EB=ETEi) ~ pA(Ei)

A(EA) ~ pB(Ei=ET-EA)

S=SA+SB=k LnT

SB = kLn[B(EB)]

SA = kLn[A(EA)]

EA

EB=ET-EA

E A(1)

G. NAVASCUS

E A(1)

E B(1)

E A( 2) =< E A >

E B( 2) =< E B >

E B(1)

E A( 2 ) =< E A >

23/10/2004

EB(2) =< EB >

14

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

9 LEY DE CRECIMIENTO DE LA ENTROPA. 2 LEY DE LA TERMODINMICA. PROCESOS

REVERSIBLES E IRREVERSIBLES

Considere dos sistemas macroscpicos, A y B, separados entre s pero en equilibrio consigo mismo cada

uno de ellos. Sus energas respectivas son EA(1) y EB(1). Los dos sistemas se ponen en contacto de

manera que pueden intercambiar energa manteniendo, naturalmente, la energa total: ET=EA(1)+EB(1).

Inicialmente los dos sistemas, ahora subsistemas del total, no tienen porque estar en equilibrio y por

tanto su configuracin inicial puede corresponder a la sealada en la grfica anterior. Una vez en

contacto, sabemos que lo ms probable es que los dos sistemas evolucionen hacia configuraciones de

mayor probabilidad y, evidentemente, es menos probable que ocurra lo contrario. En cualquier caso, en

su evolucin, un sistema gana energa a costa del otro (veremos, en el siguiente captulo, que lo ms

probable es que el que tiene mayor pendiente en el nmero de estados, o entropa, cede energa al otro,

esta pendiente es bsicamente la temperatura). El peso estadstico es tan determinante que en la prctica

la evolucin es unidireccional, el sistema tiene una probabilidad casi igual a 1 de tender hacia los estados

del peso estadstico, y la situacin final ser que el sistema este evolucionando entre los estados que

determinan el Peso Estadstico. Eventualmente, de vez en cuando, puede ocurrir que el sistema

evolucione hacia estados menos probables pero tarde o temprano vuelve hacia los ms probables

Cuando el sistema llega a los microestados del Peso Estadstico cada uno de los subsistemas tiene una

energa que flucta alrededor de los valores medios <EA> y <EB>. Las fluctuaciones son prcticamente

despreciables y las variables toman valores medios que, lo ms probable, es que no cambien. No est

excluido que las fluctuaciones puedan ser suficientemente grandes como para que los valores medios

cambien significativamente pero es tan improbable esta situacin que se ignora y decimos que el sistema

est en equilibrio. En Termodinmica la evolucin hacia el equilibrio es inapelable y este aserto constituye

la Segunda Ley de la Termodinmica. Una vez en equilibrio el sistema permanece en l para siempre. El

proceso se llama por eso IRREVERSIBLE; lo que la Mecnica Estadstica propone es que en su evolucin

temporal, lo ms probable es que el sistema tienda al equilibrio, una vez en equilibrio lo ms probable es

que permanezca en l, el proceso sigue siendo irreversible pero su significado no es tan absoluto.

En trminos de Entropa la discusin es la siguiente: inicialmente la entropa de los dos sistemas es:

S = SA(EA(1)) + SB(EB(1))

Y la final de equilibrio S = SA(<EA>) + SB(<EB>) que necesariamente es mayor (ver grfica).

Formalmente podemos escribir que la evolucin del sistema total es en cualquier caso a un reparto de

energas entre los dos sistemas a la que la corresponden los microestados dados por la expresin

A(EA)EA x B(EB)EB

donde EA y EB es el reparto de la energa total entre los dos sistemas en esas configuraciones. Usando la

definicin de entropa podemos escribir:

A(EA)EA x B(EB)EB = exp {SA(EA)/k} x exp {SB(EB)/k} = exp {[SA(EA) +SB(EB)]/k} =

= exp {[ST(EA,EB)/k}

donde ST(EA,EB) es la entropa del sistema si la energa total se reparte en los dos subsistemas dando a

cada uno de ellos las energas EA y EB. La distribucin inicial de estados del sistema, cuando los dos

subsistemas estn separados es tal que:

A(EA(1))EA x B(EB(1))EB = exp {[ST(EA(1),EB(1))/k}

mientras que la final es:

A(EA(2))EA x B(EB(2))EB = exp {[ST(EA(2),EB(2))/k}

o lo que es lo mismo

A(<EA>)EA x B(<EB>)EB = exp {[ST(<EA>,<EB>)/k}

Es decir el reparto de energa en los dos subsistemas corresponde a la mxima entropa

G. NAVASCUS

23/10/2004

15

1 CONCEPTOS BSICOS. PROBABILIDAD, EQUILIBRIO Y ENTROPA

La generalizacin a un sistema compuesto de varios subsistemas es obvia:

( Ei )Ei = exp{S T ( E1 , E 2 , E3 ,...) / k}

Todas estas consideraciones nos llevan establecer:

LEY DE CRECIMIENTO DE LA ENTROPA:

EN UN SISTEMA AISLADO QUE NO EST EN EQUILIBRIO LO MS PROBABLE ES QUE LA

ENTROPA AUMENTE

Lo que quiere decir que puede haber fluctuaciones que nos alejen temporalmente del equilibrio o de la

evolucin hacia el equilibrio. S puede decrecer. En termodinmica no, es ms estricta en este respecto.

Que S tenga una mayor probabilidad de crecer no quiere decir que la entropa crezca en todas las partes

del sistema: lo usual es que crezca en unas partes y decrezca en otras, aunque crece ms en aquellas que

decrece en estas.

El proceso macroscpico que nos lleva al equilibrio (aunque no de forma inexorable), es decir el proceso

ms probable es lo que lamamos proceso IRREVERSIBLE. Si la entropa se mantiene en su mximo el

proceso es llamado REVERSIBLE.

Ms consideraciones sobre la ENTROPA:

En un sistema clsico podemos expresarla como S=k Ln[(E)/h2fN]

As la defini Gibbs pensando determinar h (una constante que nada tena que ver con la de Planck por

entonces) mediante medidas experimentales. Sin embargo las medidas experimentales siempre estn en

relacin con cambios de entropa S= S2-S1 = k Ln[2(E)/h2fN] - k Ln[1(E)/h2fN] = k Ln[2(E)/ 1(E)] que

ya no depende de h.

La entropa puede definirse como k<Ln[p(E)]>. En efecto en un sistema aislado p(E)=1/(E) con lo que

<Ln[p(E)]> = <Ln[1/(E)]> = 1/(E) Ln[1/(E)] = - Ln[1/]/ = -Ln[] 1/ = - Ln[]

y por tanto -k <Ln[p(E)]> = k Ln[]

c. q. d.

(Veremos que esta definicin de entropa puede aplicarse a sistemas no aislados, es decir a otro conjuntos

estadsticos que no sean el microcannico)

Si dividimos el sistema en partes macroscpicas con tiempos de relajacin de equilibrio, i, ms pequeos

que el del sistema total, , cada subsistema puede llagar al equilibrio interno, antes que el sistema total,

es decir antes que el equilibrio entre subsistemas. Cualquier medida que use un tiempo t tal que >t>i

an podremos hablar de la entropa de cada subsistema. Si volvemos a dividir el sistema en un nmero

mayor de subsistemas podremos seguir hablando de la entropa de los subsistemas si an se cumple que

>t>i . Este proceso lo podemos seguir haciendo con cada vez con subsistemas ms pequeos

correspondindoles tiempos de relajacin ms pequeos, pero no podemos llevar este proceso al lmite ya

que dejaran de ser subsistemas macroscpicos. La entropa est ligada, por tanto, a un tiempo finito tal

como ocurre con otras variables macroscpicas como la presin.

Observe que la entropa aqu definida tiene todas las propiedades de la entropa termodinmica, salvo el

carcter determinista. En el siguiente tema veremos que se relaciona con otras variables termodinmicas

en la misma forma as que podemos no solo identificar ambas entropas sino que la Mecnica Estadstica

justifica la Termodinmica y da explicacin al misterioso comportamiento de la entropa termodinmica.

G. NAVASCUS

23/10/2004

16

También podría gustarte

- Laboratorio 4 Circuito en SerieDocumento10 páginasLaboratorio 4 Circuito en SerieramsesAún no hay calificaciones

- Cuestionario 100 PreguntasDocumento8 páginasCuestionario 100 Preguntasian XDAún no hay calificaciones

- Analisis de CalcioDocumento6 páginasAnalisis de CalcioGeovi Condori CortezAún no hay calificaciones

- Act 5 Quiz 1Documento5 páginasAct 5 Quiz 1zeusam100% (1)

- Procedimiento Con Ejercicio de Vigas Pretensadas, en Un PuntoDocumento3 páginasProcedimiento Con Ejercicio de Vigas Pretensadas, en Un Puntogerardo navaAún no hay calificaciones

- Apuntes de InorganicaDocumento10 páginasApuntes de Inorganica0itziar0Aún no hay calificaciones

- Electroforesis CapilarDocumento21 páginasElectroforesis CapilarLiz Huaman ValdezAún no hay calificaciones

- Geometría ElípticaDocumento3 páginasGeometría ElípticaJose Luis CondoriAún no hay calificaciones

- Informe de Practicas de Fundamentos de BiologiaDocumento68 páginasInforme de Practicas de Fundamentos de BiologiafrankAún no hay calificaciones

- Características de Funcionamiento de Las Turbinas HidráulicasDocumento9 páginasCaracterísticas de Funcionamiento de Las Turbinas HidráulicasJaime Fernando Dávalos CastellónAún no hay calificaciones

- Recibo CfeDocumento2 páginasRecibo CfeIvan GarciaAún no hay calificaciones

- Ejercicios Sobre Celdas GalvanicasDocumento2 páginasEjercicios Sobre Celdas GalvanicasRaquel TenorioAún no hay calificaciones

- Láser - Tipos de LáserDocumento2 páginasLáser - Tipos de LáserChristian Granados AgudeloAún no hay calificaciones

- Hoja de CuadrilaterosDocumento3 páginasHoja de CuadrilaterosKarina PichardoAún no hay calificaciones

- LaserDocumento183 páginasLaserOSCAR ARIASAún no hay calificaciones

- Informe 5 Destilacion SimpleDocumento9 páginasInforme 5 Destilacion SimpleKenny CarreñoAún no hay calificaciones

- Pérdida de CargaDocumento14 páginasPérdida de CargaSilvana DuránAún no hay calificaciones

- Caracterización Petrofisica de Yacimientos Naturalmente FracturadosDocumento18 páginasCaracterización Petrofisica de Yacimientos Naturalmente FracturadosKarla Paola RincónAún no hay calificaciones

- Circunferencia y Parábola para Cuarto Grado de SecundariaDocumento4 páginasCircunferencia y Parábola para Cuarto Grado de SecundariaLuis Alonso Herrera CandelarioAún no hay calificaciones

- Conductividad en Resinas de Intercambio IonicoDocumento4 páginasConductividad en Resinas de Intercambio IonicoJorge Luis CampoverdeAún no hay calificaciones

- Problemas de Diseño de Procesos Ii.u-2.Documento3 páginasProblemas de Diseño de Procesos Ii.u-2.Daniel XD HerreraAún no hay calificaciones

- Espejos y Lentes EcuacionDocumento2 páginasEspejos y Lentes Ecuacionjuanmro100% (1)

- La Forma Espiral en El Aikido 1Documento14 páginasLa Forma Espiral en El Aikido 1Antonio Padilla CarranzaAún no hay calificaciones

- Memo Calc Can Chat Ipo 1Documento329 páginasMemo Calc Can Chat Ipo 1Mario Fernando Monsalve BonillaAún no hay calificaciones

- Motores Polos Sombreados y RepulsiónDocumento22 páginasMotores Polos Sombreados y RepulsiónEsmeralda YaravidAún no hay calificaciones

- Preguntas Tomadas en Examenes de Admisión UnsaDocumento2 páginasPreguntas Tomadas en Examenes de Admisión UnsaJosé Choque100% (1)

- Monografia de SifonamientoDocumento20 páginasMonografia de Sifonamientojose luisAún no hay calificaciones

- Qué Es Un ArcoirisDocumento3 páginasQué Es Un ArcoirisManuel Antonio Morales AlcocerAún no hay calificaciones

- Guía Inicial 10° 2020Documento12 páginasGuía Inicial 10° 2020Mario J Giraldo100% (1)

- Procedimiento BSWDocumento6 páginasProcedimiento BSWivan_pardo9313Aún no hay calificaciones