Documentos de Académico

Documentos de Profesional

Documentos de Cultura

Arquitectura Computadoras ISC

Cargado por

Esteban Robledo SalasTítulo original

Derechos de autor

Formatos disponibles

Compartir este documento

Compartir o incrustar documentos

¿Le pareció útil este documento?

¿Este contenido es inapropiado?

Denunciar este documentoCopyright:

Formatos disponibles

Arquitectura Computadoras ISC

Cargado por

Esteban Robledo SalasCopyright:

Formatos disponibles

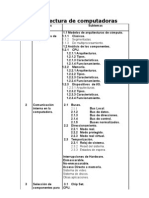

Arquitectura de computadoras

Unida

d

Temas Subtemas

1 Modelo de

arquitecturas de

cmputo.

1.1 Modelos de arquitecturas de cmputo.

1.1.1 Clsicas.

1.1.2 Segmentadas.

1.1.3 De multiprocesamiento.

1.2 Anlisis de los componentes.

1.2.1 CPU.

1.2.1.1 Arquitecturas.

1.2.1.2 Tipos.

1.2.1.3 Caractersticas.

1.2.1. !uncionamiento.

1.2.2 Memoria.

1.2.2.1 Arquitecturas.

1.2.2.2 Tipos.

1.2.2.3 Caractersticas.

1.2.2. !uncionamiento.

1.2.3 "ispositi#os de $%&.

1.2.3.1 Arquitecturas.

1.2.3.2 Tipos.

1.2.3.3 Caractersticas.

1.2.3. !uncionamiento.

2 Comunicacin

interna en la

computadora.

2.1 'uses.

2.1.1 'us (ocal.

2.1.2 'us de datos.

2.1.3 'us de direcciones.

2.1. 'us de control.

2.1.) 'uses normali*ados.

2.2 "ireccionamiento.

2.2.1 Modo real.

2.2.2 Modo prote+ido.

2.2.3 Modo real #irtual.

2.3 Tempori*acin.

2.3.1 ,elo- de sistema.

2.3.2 Reset del sistema.

2.3.3 Estados de espera.

2. $nterrupciones de .ard/are.

2..1 0nmascarable.

2..2 1o2enmascarable.

2.) Acceso "irecto a memoria.

2.5.1 Sistema de video.

2.5.2 Sistema de discos.

2.5.3 Otras aplicaciones.

3 Seleccin de

componentes para

3.1 C3ip Set.

3.1.1 CPU.

ensamble de

equipos de

cmputo.

3.1.2 Controlador del 'us.

3.1.3 Puertos de 0%S.

3.1. Controlador de $nterrupciones.

3.1.) Controlador de "MA.

3.1.4 Circuitos de tempori*acin 5

control.

3.1.6 Controladores de #ideo.

3.2 Aplicaciones.

3.2.1 Entrada/ Salida.

3.2.2 Almacenamiento.

3.2.3 !uente de alimentacin.

3.3 Ambientes de servicios.

3.3.1 egocios.

3.3.2 !ndustria.

3.3.3 Comercio electrnico.

Microcontroladores

.

.1 Arquitectura.

".1.1 #erminales.

.1.2 CPU.

.1.3 0spacio de Memoria.

.1. 0ntrada% Salida.

.1.) Caractersticas especiales.

.2 Pro+ramacin.

.2.1 Modelo de pro+ramacin.

.2.2 Con-unto de instrucciones.

.2.3 Modos de direccionamiento.

.2. (en+ua-e ensamblador.

".3 Aplicaciones.

".3.1 $omo sistema independiente.

".3.2 $omo subsistema de una

computadora.

Unidad 1. Modelo de arquitecturas de

cmputo.

1.1 Modelos de arquitecturas de cmputo.

2

3 Tecnologas RISC y CISC:

RISC: %Reduced !nstruction Set $omputer& computadora de con'unto de

instrucciones reducido

Arquitectura de computadoras que e'ecuta un n(mero limitado de

instrucciones. El concepto es que la ma)or*a de los programas usan

generalmente unas pocas instrucciones+ ) si se acelera la e'ecuci,n de

esas instrucciones b-sicas+ se me'ora el rendimiento.

.a arquitectura R!S$ elimina una capa de carga operativa llamada

/microc,digo/+ que se emplea normalmente para 0acilitar la agregaci,n

de nuevas ) comple'as instrucciones a una computadora. .as

computadoras R!S$ poseen un peque1o n(mero de instrucciones

montadas en los circuitos de nivel in0erior+ que traba'an a m-2ima

velocidad.

Aunque las m-quinas R!S$ son s,lo de un 153 a un 543 m-s veloces

que sus contrapartidas $!S$

CISC: %$omple2 !nstruction Set $omputer& $omputadora de con'unto de

instrucciones comple'o $omputadoras que poseen un con'unto de

instrucciones mu) e2tenso. .as m-quinas $!S$ tienen de doscientas a

trescientas instrucciones+ que est-n grabadas en microc,digo.

3ttp7%%///.mono+ra8ias.com%traba-os%re8ercomp%re8ercomp.s3tml

3.1.1 Clsicas.

El Concepto de von Neumann.

.os primeros computadores se programaban en realidad recable-ndolos. Esto

pr-cticamente equival*a a reconstruir todo el computador cuando se requer*a

de un nuevo programa. .a tarea era simpli0icada gracias a un panel de

contactos %mu) similar al de los primeros conmutadores tele0,nicos que eran

atendidos por operadoras+ ) que 5o) en d*a s,lo llegamos a ver en via'es

pel*culas en blanco ) negro. 6er 0ig. 1& con el que era posible enla7ar circuitos

para crear secciones dedicadas a una actividad espec*0icas. .a programaci,n

del computador se llevaba a cabo+ literalmente+ reconstru)8ndolo.

9ig 1.: E!A$+ primer computador electr,nico ) su panel de cone2iones

;ientras que el recablear al computador establec*a una clara distinci,n entre

los datos %representados por los estados o se1ales el8ctricas que ser*n

mantenidas por los relevadores o a trav8s de los bulbos que con0ormaban al

computador& ) el programa %las cone2iones que ser*an establecidas entre estos

componentes del 5ard<are& la labor de /programaci,n/ requer*a sino del propio

creador del computador si a un verdadero e2perto ) conocedor de electr,nica+

principios de l,gica digital ) del problema mismo. Esto vino a cambiar con el

concepto del pro+rama almacenado+ un concepto te,rico mu) importante que

0ue establecido por el matem-tico =o5n von eumann el 34 de 'unio de 1>"5 en

un borrador sobre el dise1o de la ED6A$. A di0erencia de los primeros

computadores+ von eumann propon*a que tanto el programa como sus datos

0ueran almacenados en la memoria del computador. Esto no solo simpli0icaba

la labor de programaci,n al no tener que llevar a cabo el recableado del

computador sino que adem-s libraba ) generali7aba el dise1o del 5ard<are

para 5acerlo independientede cualquier problema ) en0ocado al control )

e'ecuci,n del programa. Este concepto 0ue tan importante ) decisivo que dio

lugar al concepto de la arquitectura de #on 1eumann+ a(n presente en

nuestros d*as.

.a arquitectura de von eumann se compone de tres elementos?

1. .a Unidad Central de Procesamiento %$@A+ por sus siglas en ingl8s&+ que es

considerada como el cerebro ) cora7,n del computador. !nternamente consiste de una

Anidad Aritm8tico:.,gica %A.A&+ un con'unto de registros ) una Anidad de $ontrol

%$A&. .a A.A es donde se reali7an todas las operaciones que involucran un

procesamiento matem-tico %particularmente aritm8tico& o l,gico %operaciones

booleanas&. .os registros permiten el almacenammiento de datos para estas

operaciones ) sus resultados. En la $A es donde se e'ecutan todo el resto de las

operaciones %decisi,n+ control+ movimiento de datos&. Ana $@A con todos estos

elementos implementada en un solo c5ip recibe el nombre de microprocesador.

2. .a memoria+ que es donde datos ) programa es almacenado. .a memoria puede ser

visto como un arreglo unidimensional 0inito en la que cada localidad es identi0icada por

un valor asociado a su posici,n ) que es comunmente llamado direccin. E2isten

diversos tipos de memoria+ identi0icados por el tipo de tecnolog*a usada+ aunque para

un computador son generalmente clasi0icadas en dos grandes grupos por tipo de uso al

que de destina. .a memoria RAM %Random Access ;emor)+ ;emoria de Acceso

Aleatorio& ) que es aquella destinada al almacenamiento de datos ) programas

%inclu)endo al sistema operativo&+ es considerada temporal o de tipo vol-til )a que

pierde si contenido cuendo el computador es apagadoo reiniciali7ado. .a memoria

ROM es aquella de tipo permanente+ aun cuando el computador sea desenergi7ado

mantendr- su contenido. Es usada principalmente para el almacenamiento de

peque1os programas destinados a la adminsitraci,n b-sica de recursos+ especialmente

de entrada ) salida.

3. .as interfaces de entrada y salida (I/O). destinadas a liberar de traba'o a la $@A en la

comunidaci,n con dispositivos de entrada %teclados+ ratones&+ salida %impresoras& )

entrada:salidas %discos+ cintas&.

Estos tres elementos est-n interconectados a trav8s de un con'unto de l*neas

que llevan instrucciones %control bus&+ datos %data bus& ) que permiten dar los

valores de direcciones de memoria ) dispositivos %memor) bus&.

9ig 2.: Esquema de la arquitectura de von eumann.

5ttp?//5omepage.mac.com/eravila/computer!!.5tml

La arquitectura von Neumann se refiere a las arquitecturas de computadoras que

utilizan el mismo dispositivo de almacenamiento tanto para las intrucciones como para

los datos (a diferencia de la arquitectura Harvard). El trmino se acu en el documento

First Draft of a Report on the EDVAC (194)! escrito por el conocido matem"tico #o$n

von %eumann! que propuso el concepto de pro&rama almacenado. 'ic$o documento fue

redactado en vistas a la construccin del sucesor de la computadora E%()*! + su

contenido fue desarrollado por ,resper Ec-ert! #o$n .auc$l+! )rt$ur /ur-s! + otros

durante varios meses antes de que 0on %eumann redactara el 1orrador del informe.

Los ordenadores con arquitectura 0on %eumann constan de cinco partes2 La unidad

aritmtico3l&ica o )L4! la unidad de control! la memoria! un dispositivo de

entrada5salida + el 1us de datos que proporciona un medio de transporte de los datos

entre las distintas partes.

4n ordenador con arquitectura von %eumann realiza o emula los si&uientes pasos

secuencialmente2

1. 61tiene la si&uiente instruccin desde la memoria en la direccin indicada por el

contador de pro&rama + la &uarda en el re&istro de instruccin.

7. )umenta el contador de pro&rama en la lon&itud de la instruccin para apuntar a

la si&uiente.

8. 'escodifica la instruccin mediante la unidad de control. 9sta se encar&a de

coordinar el resto de componentes del ordenador para realizar una funcin

determinada.

4. :e e;ecuta la instruccin. 9sta puede cam1iar el valor del contador del pro&rama!

permitiendo as< operaciones repetitivas. El contador puede cam1iar tam1in

cuando se cumpla una cierta condicin aritmtica! $aciendo que el ordenador

pueda =tomar decisiones=! que pueden alcanzar cualquier &rado de comple;idad!

mediante la aritmtica + l&ica anteriores.

. 0uelve al paso 1.

Ho+ en d<a! la ma+or<a de ordenadores est"n 1asados en esta arquitectura! aunque

pueden incluir otros dispositivos adicionales! (por e;emplo! para &estionar las

interrupciones de dispositivos e>ternos como ratn! teclado! etc).

5ttp?//<<<.programacion.com/blogs/""BdiarioBdeBunBpro0esorBdeBin0ormtica/a

rc5ive/"4>BqueBesBlaBarquitecturaBin0ormtica.5tml

)rquitectura Harvard

El trmino Arquitectura Harvard ori&inalmente se refer<a a las arquitecturas de

computadoras que utiliza1an dispositivos de almacenamiento f<sicamente separados

para las instrucciones + para los datos (en oposicin a la )rquitectura von %eumann). El

trmino proviene de la computadora Harvard .ar- (! que almacena1a las instrucciones

en cintas perforadas + los datos en interruptores.

?odas las computadoras constan principalmente de dos partes! la *,4 que procesa los

datos! + la memoria que &uarda los datos. *uando $a1lamos de memoria mane;amos

dos par"metros! los datos en s<! + el lu&ar donde se encuentran almacenados (o

direccin). Los dos son importantes para la *,4! pues muc$as instrucciones frecuentes

se traducen a al&o as< como @co&e los datos de sta direccin + a"delos a los datos de

sta otra direccin@ ! sin sa1er en realidad qu es lo que contienen los datos.

En los Altimos aos la velocidad de las *,4s $a aumentado muc$o en comparacin a la

de las memorias con las que tra1a;a! as< que se de1e poner muc$a atencin en reducir el

nAmero de veces que se accede a ella para mantener el rendimiento. :i! por e;emplo!

cada instruccin e;ecutada en la *,4 requiere un acceso a la memoria! no se &ana nada

incrementando la velocidad de la *,4 3 este pro1lema es conocido como =limitacin de

memoria=.

:e puede fa1ricar memoria muc$o m"s r"pida! pero a costa de un precio mu+ alto. La

solucin! por tanto! es proporcionar una pequea cantidad de memoria mu+ r"pida

conocida con el nom1re de cac$. .ientras los datos que necesita el procesador estn en

la cac$! el rendimiento ser" muc$o ma+or que si la cac$ tiene que o1tener primero los

datos de la memoria principal. La optimizacin de la cac$ es un tema mu+ importante

de cara al diseo de computadoras.

La arquitectura Harvard ofrece una solucin particular a este pro1lema. Las

instrucciones + los datos se almacenan en cac$s separadas para me;orar el rendimiento.

,or otro lado! tiene el inconveniente de tener que dividir la cantidad de cac$ entre los

dos! por lo que funciona me;or slo cuando la frecuencia de lectura de instrucciones +

de datos es apro>imadamente la misma. Esta arquitectura suele utilizarse en ':,s! o

procesador de seal di&ital! usados $a1itualmente en productos para procesamiento de

audio + video.

@$ttp255es.Bi-ipedia.or&5Bi-i5)rquitecturaCHarvard@

Arquitectura Carvard

El procesador de los modernos microcontroladores responde a la arquitectura R!S$

%$omputadores de =uego de !nstrucciones Reducido&+ que se identi0ica por poseer un repertorio

de instrucciones m-quina peque1o ) simple+ de 0orma que la ma)or parte de las instrucciones

se e'ecutan en un ciclo de instrucci,n.

Otra aportaci,n 0recuente que aumenta el rendimiento del computador es el 0omento del

paralelismo impl*cito+ que consiste en la segmentaci,n del procesador %pipe:line&+

descomponi8ndolo en etapas para poder procesar una instrucci,n di0erente en cada una de

ellas ) traba'ar con varias a la ve7.

$ttp255BBB.unicrom.com5?utC,(*s1.asp

.a arquitectura Carvard dispone de dos memorias independientes una+ que

contiene s,lo instrucciones ) otra+ s,lo datos. Ambas disponen de sus

respectivos sistemas de buses de acceso ) es posible reali7ar operaciones de

acceso %lectura o escritura& simult-neamente en ambas memorias. 9igura 1.3.

9igura 1.3. .a arquitectura Carvard dispone de dos memorias independientes

para datos ) para instrucciones+ permitiendo accesos simult-neos.

$ttp255BBB.mono&rafias.com5tra1a;os175microco5microco.s$tml

ARQUITECTURA AR!AR"

Arquitectura .ar#ard9 que utili*a antememorias de instrucciones 5 datos separadas. 0sta t:cnica9 denominada

Arquitectura .ar#ard9 en cierto modo contrapuesta a la idea de ;on 1e/mann9 5a que utili*a memorias cac3:

separadas para cdi+o 5 datos. 0sto tiene al+unas #enta-as .

ARQUITECTURA !ECT#RIA$

0l encadenamiento aumenta la #elocidad de proceso9 pero a<n se puede me-orar a=adiendo t:cnicas como el

supersescalado. 0sta t:cnica permite 3acer paralelas las mismas etapas sobre instrucciones di8erentes. Un

procesador superescalar puede e-ecutar ms de una instruccin a la #e*. Para :sto es necesario que e>istan

#arias unidades aritm:tico2l+icas9 de punto 8lotante 5 de control. 0l proceso que si+ue el micro es

transparente al pro+rama9 aunque el compilador puede a5udar anali*ando el cdi+o 5 +enerando un 8lu-o de

instrucciones optimi*ado. ;eamos cmo se e-ecutaran las instrucciones en un procesador superescalar de

que tiene duplicadas las subunidades que lo componen7

Aunque esto me-ora la #elocidad +lobal del sistema9 los con8lictos de datos crecen. Si antes las instrucciones

se encontraban mu5 pr>imas9 a3ora se e-ecutan simultaneamente. 0sto 3ace necesario un c3equeo dinmico

para detectar 5 resol#er los posibles con8lictos.

ARQUITECTURA %I%E&$INE

Paralelismo Temporal7 Pipe2(ine ?(ineal@

(a arquitectura pipe2line se aplica en dos lu+ares de la maquina9 en la CPU 5 en la UA(.

;eamos en que consiste el pipe2line 5 tratemos de entender porque el pipe2line me-ora el rendimiento de todo

el sistema.

;eamos una CPU no or+ani*ada en pipe2line7

Si se trata de una instruccin a ser e-ecutada por la A(U podemos decir que la CPU reali*a a lo lar+o del ciclo

de maquina estas ) tareas.

Una #e* que termina de e-ecutar una instruccin #a a buscar otra 5 tarda en e-ecutarla un tiempo T9 es decir

cada T se+undos e-ecuta una instruccin.

ABu: sucede si di#idimos en ) unidades se+<n las ) cosas que reali*a la CPUC

Supon+amos la CPU di#idida en ) unidades9 de tal 8orma que c%u tarde lo mismo en reali*ar su partecita. 0s

decir c%u tardar T%).

Para que una instruccin se e-ecute se necesita T se+undos entonces para que usar pipe2line.

Si ocurre esto en una CPU normal a una con pipe2line9 la cantidad de instrucciones que se 3acen por se+undo

aumenta9 es decir aumenta el 8lu-o de instrucciones que se e-ecutan por se+undo.

5ttp?//5tml.rincondelvago.com/computadoresBarquitectura:5arvard:pipeline:

vectorial.5tml

Arquitectura PIPE-LINE.

Ya hemos mencionado que una de las formas de lograr operaciones concurrentes en un

procesador se utilizan dos tcnicas bsicas: paralelismo y pipelining.

El paralelismo consegua la concurrencia multiplicando la estructura del hardware tantas veces

como sea posible, de modo que las diferentes etapas del proceso se ejecuten

simultneamente.

Pipelining consiste en desdoblar la funcin a realizarse en varias partes, asignndole al

hardware correspondiente a cada una de las partes tambin llamadas etapas. As como el agua

fluye a travs de una tubera (pipeline) las instrucciones o datos fluyen a travs de las etapas

de un computador digital pipeline a una velocidad que es independiente de la longitud de la

tubera (numero de etapas del pipeline) y depende solamente de la velocidad a la cual los datos

e instrucciones pueden ingresar al pipeline.

Esta velocidad a su vez depende del tiempo que tarde el dato en atravesar una etapa. Este

tiempo puede ser significativo ya que el computador no solo desplaza los datos o instrucciones

de etapa en etapa sino que en cada una de ellas se realiza alguna operacin sobre los mismos.

Como ejemplo en el caso de las instrucciones tendremos operaciones de bsqueda,

decodificacin y ejecucin.

Pipeline Fsico:

Pipeline digital.

Mientras un tem en particular fluye a travs del pipeline, ste ocupa slo una etapa por vez. A

medida que transcurre el tiempo la etapa que quedo vacante por un tem, ser ocupada por el

siguiente.

Este uso concurrente de diferentes etapas por diferentes tems se lo conoce por solapamiento.

El resultado neto es que la mxima velocidad a la cual los nuevos tems pueden ingresar al

pipeline depende exclusivamente del tiempo mximo requerido para atravesar una etapa y no

del nmero de stas.

La utilizacin del pipeline se traduce en una mejora del comportamiento o performance del

procesador. Si una funcin se lleva a cabo en T segundos en un procesador de diseo

convencional, al utilizar un procesador pipeline de N etapas esa misma funcin podr realizarse

en T/N segundos. Esto a nivel terico, ya que la mejora de performance depender de la

cantidad de operaciones que puedan estructurarse en pipeline y tambin de calidad de la

particin o subdivisin de cada una de esas operaciones. La estructuracin en pipeline de un

procesador se realiza en diferentes niveles como aritmtica de punto flotante, ciclo de

instruccin, procesador de entrada/salida, etc.

Esta divisin o particin de una funcin en varias subfunciones se podr realizar si se dan las

siguientes condiciones:

1. La evaluacin de la funcin bsica es equivalente a la evaluacin secuencial de las

subfunciones que la constituyen.

2. Las entradas a una subfuncin provienen nicamente de las salidas de subfunciones previas

en la secuencia de evaluacin.

3. Excepto el intercambio de entradas y salidas no existe otra vinculacin entre las

subfunciones.

4. Debe disponerse del hardware necesario para la evaluacin de dichas subfunciones.

5. El tiempo requerido por estas unidades de hardware para evaluar las subfunciones es

aproximadamente el mismo.

Este hardware mencionado en el punto 4 es el correspondiente o asociado con las distintas

etapas del pipeline.

A diferencia del pipeline fsico (tubera), el digital no maneja los datos en forma continua. Este

maneja los datos en forma interrumpida y los va desplazando de etapa en etapa sincronizando

con un reloj.

Dado que la lgica que realiza el procesamiento en cada etapa generalmente carece de

memoria y dado el carcter discontinuo de la aparicin de los datos en las etapas se impone la

utilizacin de un elemento de memoria en la entrada y salida de cada etapa. De esta manera,

bajo el control del reloj asociado a cada elemento de memoria, evitamos que los datos ingresen

a una etapa antes que haya finalizado el proceso anterior.

Pipeline vs. Solapamiento.

Los conceptos de pipelining y solapamiento tienen significados parecidos pero no son

equivalentes, pese a que en algunos casos se los utiliza indistintamente. Ambos se basan en la

idea de particin o subdivisin de una funcin, pero se aplican en distintos entornos.

Se dice que podr existir pipeline cuando se den las siguientes condiciones:

1. Cada evaluacin de la funcin bsica es independiente de las anteriores.

2. Cada evaluacin requieren aproximadamente la misma secuencia de subfunciones.

3. Cada subfuncin se encadena perfectamente con las anterior.

4. Los tiempos utilizados para evaluar las distintas subfunciones son aproximadamente iguales.

Solapamiento se podr utilizar cuando se den las siguientes condiciones:

1. Existe dependencia entre las distintas evaluaciones.

2. Cada evaluacin puede requerir una secuencia diferente de subfunciones.

3. Cada subfuncin tiene un propsito distinto.

4. El tiempo por etapa no es necesariamente constante, sino que depende de la etapa y de los

datos que la atraviesan.

En muchos casos el pipeline propiamente dicho y que detallamos en primer lugar se lo suele

llamar sincrnico o esttico, por otra parte el solapamiento se lo suele llamar pipeline

asincronico o dinmico.

Un ejemplo de pipeline esttico es el de una unidad destinada a realizar sumas en punto

flotante sobre datos provenientes de otra unidad. Aqu la funcin bsica, suma en punto

flotante es relativamente simple, el resultado de una sumo depende del anterior, prximo o de

cualquier otro. Adems una vez que se realiz la particin, todas las sumas siguen la misma

secuencia.

El ejemplo ms simple de solapamiento o pipeline dinmico se da en un procesador donde la

entrada/salida es manejada por un procesador, los cmputos por otro y la comunicacin se

realiza a travs de un modulo de memoria comn.

La realizacin de una funcin en este procesador alternara entre el procesador de computo y el

de entrada/salida.

En otros casos la evaluacin de una funcin slo requerira de un procesador. En este caso

vemos

que las distintas operaciones estn menos sincronizadas que en el caso del sumador en punto

flotante. La

participacin de la funcin bsica vara dinmicamente y an el tiempo empleado en cada

etapa es difcil de

predecir.

Otro ejemplo de operacin por solapamiento es el de ejecucin de instrucciones de CPU's de

alta

velocidad. En este caso el hardware podr estar dividido en un nmero fijo de etapas como en

el caso del

sumador de punto flotante, pero de acuerdo con las diferencias de formato de las instrucciones

cada una

puede desarrollar un camino diferente a travs del pipeline.

Pipeline en maquinas SISD.

Dependencia entre instrucciones y riesgos.

En una maquina secuencial clsica todas las operaciones que involucran la ejecucin de una

instruccin se completan antes que comience la prxima. En el caso de las maquinas SISD

podemos intentar realizar pipeline a nivel de ejecucin de instrucciones.

Esto consistir en solapar la ejecucin de las mismas de manera que algunas de las

operaciones necesarias para las instrucciones i+1, i+2, .... puedan realizarse antes que finalice

la ejecucin de la instruccin i. Puede ocurrir que las operaciones realizadas por i+1, i+2,

dependan de los resultados de i que an no fue completada. Esta dependencia entre

instrucciones crea riesgos que deben evitarse y resolverse.

Se reconocen tres clases de riesgos, read-after-write, write-after-read y write-after-write.

Veamos las diferencias considerando este segmento de cdigo de programa:

Almacenar en x

Sumar x

Almacenar en x

Almacenar en x

El riesgo read-after-write entre dos instrucciones i y j (siendo j posterior a i) se presentara

cuando j trata de leer un operando que es modificado por i. Si la operacin en i que modifica el

operando no se completa antes que j lo acceda, entonces j leer el valor errneo. En el ejemplo

el riesgo existir entre el primer almacenar en x y el sumar x, si el sumar x extrae el operando

antes que haya sido actualizado por almacenar.

El write-after-read ocurre cuando la instruccin j desea modificar un operando que es ledo por

i. Si j modifica el operando antes que i lo haya ledo, este dato as ledo ser errneo. Este

riesgo puede existir entre el sumar y el segundo almacenar en x.

Finalmente el write-after-write existe cuando i y j tratan de actualizar el mismo operando, en el

caso que j lo haga en primer lugar. En nuestro ejemplo se el segundo almacenar se realiza

despus del tercero, obviamente el valor en x no es el que el programa espera.

3.1.2 Se+mentadas.

3.1.3 "e multiprocesamiento.

3.2 Anlisis de los componentes.

3.2.1 CPU.

Anidad central de proceso o A$@ %conocida por sus siglas en ingl8s+ $@A&+

circuito microsc,pico que interpreta ) e'ecuta instrucciones. .a $@A se ocupa

del control ) el proceso de datos en las computadoras. Deneralmente+ la $@A

es un microprocesador 0abricado en un c5ip+ un (nico tro7o de silicio que

contiene millones de componentes electr,nicos. El microprocesador de la $@A

est- 0ormado por una unidad aritm8tico:l,gica que reali7a c-lculos )

comparaciones+ ) toma decisiones l,gicas %determina si una a0irmaci,n es

cierta o 0alsa mediante las reglas del -lgebra de Eoole&F por una serie de

registros donde se almacena in0ormaci,n temporalmente+ ) por una unidad de

control que interpreta ) e'ecuta las instrucciones. @ara aceptar ,rdenes del

usuario+ acceder a los datos ) presentar los resultados+ la $@A se comunica a

trav8s de un con'unto de circuitos o cone2iones llamado bus. El bus conecta la

$@A a los dispositivos de almacenamiento %por e'emplo+ un disco duro&+ los

dispositivos de entrada %por e'emplo+ un teclado o un mouse& ) los dispositivos

de salida %por e'emplo+ un monitor o una impresora&.

.os 0actores relevantes de los c5ips de A$@ son?

$ompatibilidad? o todo el so0t es compatible con todas las A$@. En algunos

casos se pueden resolver los problemas de compatibilidad usando so0t<are

especial.

6elocidad? .a velocidad de una computadora est- determinada por la velocidad

de su relo' interno+ el dispositivo cronom8trico que produce pulsos el8ctricos

para sincroni7ar las operaciones de la computadora. .as computadoras se

describen en 0unci,n de su velocidad de relo'+ que se mide en mega 5ert7. .a

velocidad tambi8n est- determinada por la arquitectura del procesador+ es decir

el dise1o que establece de qu8 manera est-n colocados en el c5ip los

componentes individuales de la $@A. Desde la perspectiva del usuario+ el

punto crucial es que /m-s r-pido/ casi siempre signi0ica /me'or/.

El @rocesador? El c5ip m-s importante de cualquier placa madre es el

procesador. Sin el la computadora no podr*a 0uncionar. A menudo este

componente se determina $@A+ que describe a la per0ecci,n su papel dentro

del sistema. El procesador es realmente el elemento central del proceso de

procesamiento de datos.

.os procesadores se describen en t8rminos de su tama1o de palabra+ su

velocidad ) la capacidad de su RA; asociada.

#ama1o de la palabra? Es el n(mero de bits que se mane'a como una unidad

en un sistema de computaci,n en particular.

6elocidad del procesador? Se mide en di0erentes unidades seg(n el tipo de

computador?

;C7 %;ega5ert7&? para microcomputadoras. An oscilador de cristal controla la

e'ecuci,n de instrucciones dentro del procesador. .a velocidad del procesador

de una micro se mide por su 0recuencia de oscilaci,n o por el n(mero de ciclos

de relo' por segundo. El tiempo transcurrido para un ciclo de relo' es

1/0recuencia.

;!@S %;illones de instrucciones por segundo&? @ara estaciones de traba'o+

minis ) macrocomputadoras. @or e'emplo una computadora de 144 ;!@S

puede e'ecutar 144 millones de instrucciones por segundo.

9.O@S %0loating point operations per second+ operaciones de punto 0lotante por

segundo&? @ara las supercomputadoras. .as operaciones de punto 0lotante

inclu)en ci0ras mu) peque1as o mu) altas. Ca) supercomputadoras para las

cuales se puede 5ablar de D9.O@S %Diga0lops+ es decir 1.444 millones de

9.O@S&.

$apacidad de la RA;? Se mide en t8rminos del n(mero de b)tes que puede

almacenar. Cabitualmente se mide en GE ) ;E+ aunque )a 5a) computadoras

en las que se debe 5ablar de DE.

3ttp7%%///.mono+ra8ias.com%traba-os12%comptcn%comptcn.s3tmlDUCP

3.2.1.1 Arquitecturas.

Arquitectura interna del CPU

.a $@A contiene un con'unto de localidades de almacenamiento temporal de datos de alta

velocidad llamada registro. Algunos de los registros est-n dedicados al control+ ) solo la unidad

de control tiene acceso a ellos. .os registros restantes son los registros de uso general ) el

programador es el usuario que tiene acceso a ellos.

Dentro del con'unto b-sico de registros de control se deben incluir a los siguientes?

H $ontador de programa %@$&.

H Registro de direcciones de la memoria %;AR&.

H Registro de datos %RD&.

H Registro de instrucciones %ER&.

H @alabra de estado de programa %@SI&.

H EPCF7 .a 0unci,n del @$ consiste en seguir la pista de la instrucci,n por buscar %capturar& en

el siguiente ciclo de maquina+ por lo tanto contiene la direcci,n de la siguiente instrucci,n por

e'ecutar. El @$ es modi0icado dentro del ciclo de b(squeda de la instrucci,n actual mediante la

suma de una constante. El numero que se agrega al @$ es la longitud de una instrucci,n en

palabras.

@or lo tanto+ si una instrucci,n tiene una palabra de longitud se agrega 1 al @$+ si una

instrucci,n tiene dos palabras de largo se agrega 2+ ) as* sucesivamente.

H ,e+istro de direcciones de la memoria EMA,F7 0unciona como registro de enlace entre la

$@A ) el canal de direcciones. $uando se logra el acceso a la memoria la direcci,n es

colocada en el ;AR por la unidad de control ) a5* permanece 5asta que se completa la

transacci,n. El numero de bit que 5a) en el ;AR es igual al del canal de direcciones.

.a di0erencia que e2iste entre el @$ ) el ;AR es que durante el ciclo de e'ecuci,n de una

instrucci,n+ el @$ ) el ;AR sirven al mismo 0in. Sin embargo+ muc5as de las instrucciones de la

maquina 5acen re0erencia a la memoria ) operan con los datos que est-n en ella. $omo la

direcci,n de los datos suele ser di0erente de la instrucci,n siguiente se necesita el ;AR.

H ,e+istro de datos7 la 0unci,n del RD consiste en proporcionar un -rea de almacenamiento

temporal %memoria intermedia+ acumulada o bu00er& de datos que se intercambian entre la @$A

) la memoria. .os datos pueden ser instrucciones %obtenidos en el ciclo de e'ecuci,n& o datos

del operando %obtenidos en el ciclo de e'ecuci,n&. Debido a su cone2i,n directa con el canal de

datos el RD contiene el mismo numero de bit que dic5o canal.

H ,e+istro de instrucciones E0,F7 es un registro que conserva el c,digo de operaci,n de la

instrucci,n en todo el ciclo de la maquina. El c,digo es empleado por la unidad de control de la

$@A para generar las se1ales apropiadas que controla le e'ecuci,n de la instrucci,n. .a

longitud del ER es la longitud en bit del c,digo de operaci,n.

H Palabra de estado de pro+rama EPSGF7 la palabra de estado o condici,n de programa

almacena in0ormaci,n pertinente sobre el programa que este e'ecut-ndose. @or e'emplo al

completarse una 0unci,n de la unidad aritm8tica l,gica se modi0ica un con'unto de bit llamados

c,digos %o se1ales de condici,n&. Estos bit especi0ican si el resultado de una operaci,n

aritm8tica 0ue 4 o negativo o si el resultado se desbord,.

El programa puede veri0icar estos bit en las instrucciones siguientes cambiar en 0orma

condicional su 0lu'o de control seg(n su valor.

Adem-s el @SI contiene bit que 5acen posible que la computadora responda a solicitudes de

servicio asincr,nicas generadas por dispositivos de Entrada:Salida+ o condiciones de error

interno. Estas se1ales se denominan interrupciones.

.os registros restantes que se pueden encontrar en un microprocesador son de uso general.

Estos se utili7an para almacenar in0ormaci,n en 0orma temporal. #ambi8n retienen operandos

que participan en operaciones de la A.A.

Algunas veces el con'unto de instrucciones de la computadora ) el esquema de

direccionamiento de la arquitectura restringe el uso de alguno de estos registros.

Si bien en todas las maquinas la in0ormaci,n contenida en el registro puede manipularse como

datos ordinarios durante la e'ecuci,n de algunas instrucciones los datos se utili7an en 0orma

e2pl*cita para decidir una direcci,n de la memoria. .a venta'a de usar registros para retener

datos de operaciones es la velocidad.

5ttp?//5tml.rincondelvago.com/arquitectura:interna:de:la:cpu.5tml

Elementos 'ue la componen

1. Unidad de control2 controla el funcionamiento de la *,4 + por tanto de el

computador.

7. Unidad aritmtico-lgica (ALU)2 encar&ada de llevar a ca1o las funciones de

procesamiento de datos del computador.

8. Registros proporcionan almacenamiento interno a la *,4.

4. !ntercone"iones C#U :on mecanismos que proporcionan comunicacin entre la

unidad de control! la )L4 + los re&istros.

Unidad de Control.

La 4nidad de *ontrol (4*) coordina la actividad de todos los elementos que de1en

intervenir en un proceso concreto. 'iri&e todas las seales elctricas del ordenador! es

decir! es responsa1le del correcto funcionamiento de todos los componentes de la *,4.

'e esta forma! de1e &o1ernar el funcionamiento de los perifricos de entrada! salida +

almacenamiento! al mismo tiempo que el acceso a la memoria principal + la )L4. ,or

esta razn la 4* es la encar&ada de interpretar el pro&rama! del que reci1e las

instrucciones codificadas convenientemente! as< como de enviar las rdenes oportunas a

las unidades perifricas implicadas.

La 4* utiliza una seal &enerada por un relo; interno con o1;eto de sincronizar el

funcionamiento operativo de cada elemento. Esta tarea es fundamental! +a que! en caso

contrario! no podr<a esta1lecerse un ritmo de operacin adecuado que controle la

velocidad de tra1a;o de cada componente. :e comprende f"cilmente que la ma+or o

menor frecuencia del relo; interno! determinar" la capacidad de $acer un nAmero ma+or

o menor de instrucciones por se&undo. Esta velocidad se suele medir actualmente en

&i&a$ertzios (DHz). %o todas las instrucciones que ten&a que e;ecutar la 4* consumen

el mismo nAmero de seales &eneradas por el relo;! sino que las instrucciones comple;as

necesitar"n m"s ciclos que las instrucciones simples.

En cualquier caso! la 4* se encar&ar" de las si&uientes funciones2

'eterminar si el ordenador est" en fase de introduccin o en fase de e;ecucin de

pro&rama. En el primer caso! la 4* activa la unidad de entrada de datos +

controla que las sucesivas instrucciones que componen el pro&rama va+an

siendo almacenadas en posiciones conti&uas de memoria. En la fase de e;ecucin

del pro&rama! la 4* decodifica la primera instruccin del pro&rama + se&An el

tipo de instruccin pide su e;ecucin al dispositivo adecuado2 las entradas +

salidas a los perifricos + las operaciones aritmticas + l&icas a la )L4.

'ecodificar la instruccin en curso +! se&An su cdi&o de operacin! mandar una

seal para que actAe la 4nidad )ritmtico3L&ica o una 4nidad de entrada o de

salida.

0erificar la transferencia de informacin entre los re&istros + la memoria

principal + viceversa.

*ontrolar qu instruccin se est" e;ecutando en cada momento + qu instruccin

de1er" se&uirle a continuacin.

Unidad Aritmtico-Logica.

La 4nidad )ritmtico3L&ica ()L4! Arithmetic-Logical Unit) es la encar&ada de

e;ecutar las operaciones aritmticas 1"sicas (suma! resta! multiplicacin + divisin) +

l&icas ()%'! 6E! %6?). :lo con estas operaciones 1"sicas es procesada toda la

informacin + se o1tienen los resultados. Los datos so1re los que opera esta unidad

provienen de la memoria principal + pueden estar almacenados temporalmente en

al&unos re&istros internos de la propia unidad.

La 4* se encar&a de enviarle los datos correspondientes e indicarle qu operacin tiene

que realizar.

3.2.1.2 Tipos.

T(pos

/"sicamente nos encontramos con dos tipos de diseo de los microprocesadores2 E(:*

(Eeduced3(nstruction3:et *omputin&) + *(:* (comple>3instruction3set computin&). Los

microprocesadores RISC se 1asan en la idea de que la ma+or<a de las instrucciones para

realizar procesos en el computador son relativamente simples por lo que se minimiza el

nAmero de instrucciones + su comple;idad a la $ora de disear la *,4. )l&unos e;emplos de

arquitectura E(:* son el :,)E* de :un .icros+stemFs! el microprocesador )lp$a diseado

por la anti&ua 'i&ital! $o+ a1sor1ida por *ompaq + los .otorola GGHHH + ,oBer,*. Estos

procesadores se suelen emplear en aplicaciones industriales + profesionales por su &ran

rendimiento + fia1ilidad.

Los microprocesadores CISC! al contrario! tienen una &ran cantidad de instrucciones + por

tanto son mu+ r"pidos procesando cdi&o comple;o. Las *,4Is *(:* m"s e>tendidas son las

de la familia GH>GJ de (ntel cu+o Altimo micro es el ,entium ((. Kltimamente $an aparecido

otras compa<as como *iri> + ).' que fa1rican procesadores con el ;ue&o de instrucciones

GH>GJ + a un precio sensi1lemente inferior al de los microprocesadores de (ntel. )dem"s!

tanto (ntel con ..L como ).' con su especificacin 8'3%oBM est"n apostando por

e>tender el con;unto de instrucciones de la *,4 para que tra1a;e m"s eficientemente con

tratamiento de im"&enes + aplicaciones en 8 dimensiones.

3.2.1.3 Caractersticas.

La *,4 $a de cumplir dos caracter<sticas 1ien definidas2

1. :er capaz de reconocer + e;ecutar una serie de instrucciones elementales

(pro&rama) en 1ase a las cuales se puede realizar cualquier proceso de datos

deseado! por comple;o que sea.

7. ?ener separados dos estados diferentes. En una primera fase $a de poder reci1ir

+ memorizar las instrucciones que confi&uran el proceso pedido (introduccin

del pro&rama) + en se&unda fase de1e e;ecutar en secuencia las instrucciones

reci1idas (e;ecucin del pro&rama). )l realizar esta e;ecucin se leer"n los datos

que se necesiten a travs de un dispositivo de entrada de datos en el momento en

que sean requeridos! realizando las operaciones que forman el proceso $asta la

o1tencin de los resultados! los cuales ser"n enviados al usuario a travs de un

dispositivo de salida.

3.2.1. !uncionamiento.

)unc(ones 'ue *eal(+a

La 4nidad central de proceso o *,4! se puede definir como un circuito microscpico

que interpreta + e;ecuta instrucciones. La *,4 se ocupa del control + el proceso de

datos en los ordenadores. Ha1itualmente! la *,4 es un microprocesador fa1ricado en un

c$ip! un Anico trozo de silicio que contiene millones de componentes electrnicos. El

microprocesador de la *,4 est" formado por una unidad aritmtico3l&ica que realiza

c"lculos + comparaciones! + toma decisiones l&icas (determina si una afirmacin es

cierta o falsa mediante las re&las del "l&e1ra de /oole)N por una serie de re&istros donde

se almacena informacin temporalmente! + por una unidad de control que interpreta +

e;ecuta las instrucciones. ,ara aceptar rdenes del usuario! acceder a los datos +

presentar los resultados! la *,4 se comunica a travs de un con;unto de circuitos o

cone>iones llamado 1us. El 1us conecta la *,4 a los dispositivos de almacenamiento

(por e;emplo! un disco duro)! los dispositivos de entrada (por e;emplo! un teclado o un

mouse) + los dispositivos de salida (por e;emplo! un monitor o una impresora).

3.2.2 Memoria.

Se denomina memoria a los circuitos que permiten almacenar ) recuperar la in0ormaci,n. En

un sentido m-s amplio+ puede re0erirse tambi8n a sistemas e2ternos de almacenamiento+ como

las unidades de disco o de cinta. Memoria de acceso aleatorio o ,AM %Random Access

;emor)& es la memoria basada en semiconductores que puede ser le*da ) escrita por el

microprocesador u otros dispositivos de 5ard<are. El acceso a las posiciones de

almacenamiento se puede reali7ar en cualquier orden.

.os c5ips de memoria son peque1os rect-ngulos negros que suelen ir soldados en grupos a

unas plaquitas con /pines/ o contactos. .a di0erencia entre la RA; ) otros tipos de memoria de

almacenamiento+ como los disquetes o los discos duros+ es que la RA; es muc5*simo m-s

r-pida+ ) que se borra al apagar el ordenador+ no como 8stos.

El interior de cada c$ip se puede ima&inar como una matriz o ta1la! en la cual cada

celda es capaz de almacenar un 1it. ,or tanto! un 1it se puede localizar directamente

proporcionando una fila + una columna de la ta1la. En realidad! la *,4 identifica cada

celda mediante un nAmero ! denominado direccin de memoria. ) partir de una

direccin! se calcula cu"l es la fila + columna correspondiente! con lo que +a se puede

acceder a la celda deseada. El acceso se realiza en dos pasos2 primero se comunica la

fila + lue&o la columna! empleando los mismos terminales de cone>in. 61viamente!

esta tcnica (denominada multiple>ado) permite emplear menos terminales de cone>in

para acceder a la E).! lo que optimiza la relacin entre el tamao del c$ip + la

capacidad de almacenamiento.

Eealmente! la *,4 no suele tra1a;ar con 1its independientes! sino m"s 1ien con

a&rupaciones de los mismos en forma de pala1ras 1inarias. Esto $ace que la E). no se

presente en un solo c$ip! sino m"s 1ien en a&rupaciones de los mismos.

Cemos de tener mu) en cuenta que esta memoria es la que mantiene los programas

0uncionando ) abiertos+ por lo que al ser Iindo<s >5/>J un sistema operativo multitarea+

estaremos a merced de la cantidad de memoria RA; que tengamos dispuesta en el ordenador.

En la actualidad 5emos de disponer de la ma)or cantidad posible de 8sta+ )a que estamos

supeditados al 0uncionamiento m-s r-pido o m-s lento de nuestras aplicaciones diarias. .a

memoria RA; 5ace unos a1os era mu) cara+ pero 5o) en d*a su precio 5a ba'ado

considerablemente.

$uando alguien se pregunta cu-nta memoria RA; necesitar- debe sopesar con qu8

programas va a traba'ar normalmente. Si (nicamente vamos a traba'ar con aplicaciones de

te2to+ 5o'as de c-lculo ) similares nos bastar- con unos 32 ;b de 8sta %aunque esta ci0ra se 5a

quedado bastante corta&+ pero si traba'amos con multimedia+ 0otogra0*a+ v*deo o $AD+ por poner

un e'emplo+ 5emos de contar con la m-2ima cantidad de memoria RA; en nuestro equipo

%unos 12J ;b o m-s& para que su 0uncionamiento sea ,ptimo+ )a que estos programas son

aut8nticos devoradores de memoria. Co) en d*a no es recomendable tener menos de K" ;b+

para el buen 0uncionamiento tanto de Iindo<s como de las aplicaciones normales+ )a que

notaremos considerablemente su rapide7 ) rendimiento+ pues generalmente los equipos

actuales )a traen 12J ;b de RA;.

3.2.2.1 Arquitecturas.

Elementos que la componen

4na memoria vista desde el e>terior! tiene la estructura mostrada en la fi&ura 831. ,ara

efectuar una lectura se deposita en el 1us de direcciones la direccin de la pala1ra de

memoria que se desea leer + entonces se activa la seal de lectura (E)N despus de cierto

tiempo (tiempo de latencia de la memoria)! en el 1us de datos aparecer" el contenido de

la direccin 1uscada. ,or otra parte! para realizar una escritura se deposita en el 1us de

datos la informacin que se desea escri1ir + en el 1us de direcciones la direccin donde

deseamos escri1irla! entonces se activa la seal de escritura (O)! pasado el tiempo de

latencia! la memoria escri1ir" la informacin en la direccin deseada. (nternamente la

memoria tiene un re&istro de direccin (.)E! memor+ address re&ister)! un re&istro

1uffer de memoria o re&istro de datos (./! memor+ 1uffer! o .'E! memor+ data

re&ister) +! un decodificador como se ve en la fi&ura 837. Esta forma de estructurar la

memoria se llama or&anizacin lineal o de una dimensin. En la fi&ura cada l<nea de

pala1ra activa todas las clulas de memoria que corresponden a la misma pala1ra.

,or otra parte! en una memoria E6. pro&rama1le por el usuario con or&anizacin

lineal! las uniones de los diodos correspondientes a lu&ares donde de1a $a1er un @H@

de1en destruirse. ?am1in se pueden sustituir los diodos por transistores + entonces la

clula de memoria tiene el esquema de la fi&ura 838 en este caso la unin que de1e

destruirse para &ra1ar un @H@ es la del emisor.

En el caso de una memoria E). est"tica con or&anizacin lineal cada clula de

memoria toma la forma mostrada en la fi&ura 834. En este esquema las primeras puertas

)%' slo son necesarias en el una de las clulas de cada pala1ra. :e de1e comentar la

necesidad de la puerta de tres estados a la salida del 1iesta1le2 esta puerta se pone para

evitar que se unan las salidas de los circuitos de las clulas de diferentes pala1ras a

travs del $ilo de 1it. :i esa puerta no se pusiera (o $u1iera otro tipo de puerta en su

lu&ar! como una puerta )%') la informacin correspondiente a la pala1ra activa

entrar<a por los circuitos de salida de las dem"s clulas! lo que los daar<a.

6r&anizar 1a memoria de esta forma! tiene el inconveniente de que la comple;idad del

decodificador crece e>ponencialmente con el nAmero de entradas +! en una memoria de

muc$a capacidad! la comple;idad del decodificador la $ace invia1le. Esto $ace necesaria

una alternativa que simplifique los decodificadores. Esta alternativa la constitu+e la

or&anizacin en dos dimensiones en que los 1its del re&istro de direccin se dividen en

dos partes + cada una de ellas va a un decodificador diferente. En este caso! las l<neas

procedentes de am1os decodificadores (L e P) se cruzan formando un sistema de

coordenadas en que cada punto de cruce corresponde a una pala1ra de memoria. 'ado

que en cada decodificador slo se activa una l<nea! slo se activar" la pala1ra

correspondiente al punto de cruce de las dos l<neas activadas. Q"cilmente se puede

comprender que los decodificadores se simplifican muc$o +a que cada uno tiene la

mitad de entradas que en el caso anterior. Ha+ que decir! sin em1ar&o! que la clula de

memoria se complica un poco porque $a+ que aadir una puerta )%' en cada pala1ra

para determinar si coinciden las l<neas L e P.

La or&anizacin de la memoria en dos dimensiones tam1in es Atil para las memorias

din"micas +a que el refresco de estas memorias se realiza por 1loques + stos pueden

coincidir con una de las dimensiones (la que corresponda a los 1its de direccin de

ma+or peso).

En la pr"ctica! las memorias din"micas son m"s lentas que las est"ticas + adem"s son de

lectura destructiva! pero resultan m"s 1aratas! aunque necesiten circuitos de refresco! si

la memoria no es de muc$a capacidad.

3.2.2.2 Tipos.

Tipos y Funcionamiento

Todas hacen la misma funcin, pero entre ellas las diferenciamos por el tiempo de acceso y la

capacidad, o por el modo como trabajan:

Registros del microprocesador: Interaccionan continuamente con la CPU, puesto que forman

parte de ella, su tiempo de acceso es muy pequeo y una capacidad mnima, normalmente iual a

la !palabra! del microprocesador "de # a $ bytes%&

Registros intermedios: '(sicamente es un paso intermedio entre dos memorias, un buffer& Tiene

capacidad muy pequea y un tiempo de acceso tambi)n muy pequeo&

Memoria cach: *s la m(s utili+ada por la CPU, y la m(s importante entre la principal y el

microprocesador& ,unque sean de pequea capacidad, normalmente una fraccin de la memoria

principal m(-ima posible, est( continuamente intercambiando informacin tanto con el procesador

como con la memoria principal, aunque normalmente se utili+a para uardar la direccin de la

memoria principal, en .e+ de almacenar el archi.o entero, as tarda menos a pasar la informacin

hacia la CPU, que si lo hiciera mediante la cach)&

/ es por esta ra+n, que a menudo "e-cepto modelos especiales como Celeron y 0uron%, hay

dos de memorias cach), dos ni.eles: Uno en el interior del microprocesador "1#%, y el otro entre la

principal y la CPU "12%, al e-terior del !micro! de m(s capacidad que la de dentro&

Memoria central o principal: 0onde se almacenan proramas y datos& 1a CPU lee y escribe en ella

aunque en menos cantidades que en las anteriores& Tiempo de acceso relati.amente r(pido y ran

capacidad&

Memorias de masas o auxiliares: 3on dispositi.os e-teriores al ordenador o conectados a la placa

base por un controlador de bus "disco duro, disquetes, etc&%& 0nde se almacenen todos los

proramas y archi.os para un uso posterior& *n caso de que la memoria principal sea insuficiente,

se hacen ser.ir como apoyo para )sta, denominada !memoria .irtual!&

Como he mencionado anteriormente, las memorias adem(s de clasificarse por su tiempo de

acceso y capacidad, tambi)n se pueden clasificar por la forma en que se modifican los datos y la

tecnoloa empleada& ,s, encontramos que hay dos randes rupos:

1. Memorias RAM (Random Acces Memory): 3on memorias en las que se puede leer y escribir& 3e

componen electrnicamente por chips, dnde se pueden subdi.idir en:

SRAM (Static RAM): 3u c)lula est( basada en un biestable&

DRAM (Dinamic RAM): 3u c)lula est( basada en un pequeo condensador, cara del cual

representa la informacin almacenada& *stas necesitan circuitos adicionales de refresco, puesto

que como los condensadores son de baja capacidad, a tra.)s de la s fuas, la informacin se podra

perder4 son de lectura destructi.a&

2. Memorias ROM (Read Only Memory): 3on memorias en las que slo se puede leer& 5ay de .arios

tipos:

ROM: proramadas por m(scara, la informacin es rabada enla f(brica y no tiene posible

modificacin&

PROM, o ROM: proramable una sola .e+&

EPROM (Erasale PROM) o RPROM (Reprogramale ROM): su contenido puede ser borrado

mediante rayos ultra.ioletas, para acto seuido rerabarlas&

EAROM (Electrically Alterale ROM) o EEROM (Electrically Erasale ROM), son la frontera entre

las 6,7 y las 687, su contenido puede ser rerabado el)ctricamente, se diferencian de las 6,7 en

que no son .ol(tiles&

Memoria FLASH, denominada as por la .elocidad en la que se puede reproramar "en tan solo

seundos%, usan el borrado el)ctrico&

'(sicamente las 687 se basan en una matri+ de diodos unidos, esta unin puede ser destruida

por una sobretensin& 0e esta forma, salen de la f(brica con las uniones juntas y para rabarlas se

rompen dnde se quieran poner ceros&

,parte de los mdulos de memoria aqu mencionados tambi)n e-isten, aunque ya en desuso, de

otros como los SIMM !Single "n<-#ine Memory Module) y los SIP !Single In$#ine Pac%ages), los

cuales no son nada m(s que chips de memoria soldados entre ellos para formar un 9nico conjunto&

Tambi)n hay modelos m(s nue.os como el DDR !DoleData Rate) que se usa b(sicamente en

equipos basados en microprocesadores ,70, ahora implementados tambi)n en equipos Intel,

aunque principalmente se usan en las tarjetas r(ficas, aunque Intel ya posee la del tipo RAMBUS&

1a 006 es el mismo que la 306 pero en doble sentido, de ida y de .uelta, mientras que la

seunda"306% solamente puede hacer ser.ir un sentido ida o .uelta&

5ttp?//<<<.5ard<are12v.com/conocimientospc/5.p5p

#ipos de ;emoria RA;

DRA; %D)namic Random Access ;emor)&? Es la memoria de traba'o+ tambi8n llamada

RA;+ esta organi7ada en direcciones que son reempla7adas muc5as veces por segundo. Esta

memoria lleg, a alcan7ar velocidades de J4 ) L4 nanosegundos %ns&+ esto es el tiempo que

tarda en vaciar una direcci,n para poder dar entrada a la siguiente+ entre menor sea el n(mero+

ma)or la velocidad+ ) 0u8 utili7ada 5asta la 8poca de los equipos 3JK.

9@; %9ast @age ;ode&? El nombre de esta memoria procede del modo en el que 5ace

la trans0erencia de datos+ que tambi8n es llamado paginamiento r-pido. Casta 5ace

apro2imadamente un a1o 8sta memoria era la m-s popular+ era el tipo de memoria normal para

las computadores 3JK+ "JK ) los primeros @entiumM+ lleg, a 0abricarse en velocidades de K4ns

) la 0orma que presentaban era en m,dulos S!;; de 34 pines+ para los equipos 3JK ) "JK )

para los equipos @entiumM era en S!;; de L2 pines.

EDO %E2tended Data Output&? Esta memoria 0ue una innovaci,n en cuesti,n de transmisi,n de

datos pudiendo alcan7ar velocidades de 5asta "5ns+ de'ando satis0ec5os a los usuarios. .a

transmisi,n se e0ectuaba por bloques de memoria ) no por instrucci,n como lo ven*a 5aciendo

las memorias 9@;. Se utili7a en equipos con procesadores @entiumM+ @entium @roM ) los

primeros @entium !!M+ adem-s de su alta compatibilidad+ tienen un precio ba'o ) es una opci,n

viable para estos equipos. Su presentaci,n puede ser en S!;; , D!;;.

SDRA; %S)nc5ronous DRA;&? Esta memoria 0unciona como su nombre lo indica+ se

sincroni7a con el relo' del procesador obteniendo in0ormaci,n en cada ciclo de relo'+ sin tener

que esperar como en los casos anteriores. .a memoria SDRA; puede aceptar velocidades de

EAS de 5asta 144;57+ lo que nos re0le'a una mu) buena estabilidad ) alcan7ar velocidades de

14ns. Se presentan en m,dulos D!;;+ ) debido a su trans0erencia de K" bits+ no es nesesario

instalarlo en pares.

RDRA; %Rambus DRA;&? Esta memoria tiene una trans0erencia de datos de K" bits

que se pueden producir en r-0agas de 2ns+ adem-s puede alcan7ar ta7a de tran0erencia de 533

;57 con picos de 1.KDb/s. ;u) pronto alcan7ar- dominio en el mercado+ )a que se estar-

utili7ando en equipos con el nuevo procesador @entium "M. Es ideal )a que evita los cuellos de

botella entre la tar'eta gr-0ica AD@ ) la memoria del sistema+ 5o) en d*a se pueden encontrar

8ste tipo de memorias en las consolas !#EDO K"M. Ser- lan7ada al mercado por

SA;SADM e C!#A$C!M.

#ipos de ;emoria RO;

E@RO; %Erasable @rogrammable Read:Onl) ;emor)&? Se utili7a para corregir errores

de (ltima 5ora en la RO;+ el usuario no la puede modi0icar ) puede ser borrada e2poniendo la

RO; a una lu7 ultravioleta.

EE@RO; %Electricall) Erasable @rogrammable Read:Onl) ;emor)&? Esta memoria puede ser

borrada ) volver a ser programada por medio de una carga el8ctrica+ pero s,lo se puede

cambiar un b)te de in0ormaci,n a la ve7.

;E;OR!A 9.ASC? Es un tipo de memoria EE@RO; que es reprogramable+ su

utili7aci,n por lo regular es en E!OS de a5* su nombre.

Otros tipos de memoria RA;

EEDO %Eurst E2tended Data Output&? 9ue dise1ada para alcan7ar ma)ores velocidades

de EAS. #raba'a de igual 0orma que la SDRA;+ , sea+ la trans0erencia de datos se 5ace en

cada ciclo de relo'+ pero esta memoria lo 5ace en r-0agas %burst&+ 5aciendo que los tiempos de

entrega desapare7can casi totalmente.

DDR SDRA; %Double Data Rate SDRA; , SDRA;:!!&? Esta memoria tendr- el mismo

aspecto que un D!;;+ pero la di0erencia estar- en que tendr- m-s pines+ pasando de 1KJ

pines del actual D!;; a 1J" pines+ adem-s de tener s,lo una muesca en la tableta. 6iendo un

poco de volta'e+ la DDR traba'ar- con tan s,lo 2.56+ siendo 8sta una reducci,n del 343

respecto a los actuales 3.36 de la SDRA;. #raba'ar- a velocidades de 244;57.

6RA;? Es como la memoria RA; normal+ pero la di0erencia redit(a en que podr- ser

accedida al mismo tiempo por el monitor ) el procesador de la tar'eta de video+ se podr- leer )

escribir en ella al mismo tiempo.

SDRA; %S)nc5ronous Drap5ic RA;&? O0rece las mismas capacidades de la memoria

SDRA; pero para las tar'etas gr-0icas+ se utili7a en las nuevas tar'etas gr-0icas aceleradoras

3D.

5ttp?//<<<.monogra0ias.com/traba'os1"/dispositivos/dispositivos.s5tmlN

=erarqu*a de memoria

En un ordenador $a+ una ;erarqu<a de memorias atendiendo al tiempo de acceso + a la

capacidad que. normalmente son factores contrapuestos por razones econmicas + en

muc$os casos tam1in f<sicas. *omenzando desde el procesador al e>terior! es decir en

orden creciente de tiempo de acceso + capacidad! se puede esta1lecer la si&uiente

;erarqu<a2

Registros de procesador Estos re&istros interaccionan continuamente con la *,4

(porque forman parte de ella). Los re&istros tienen un tiempo de acceso mu+ pequeo +

una capacidad m<nima! normalmente i&ual a la pala1ra del procesador (1 a G 1+tes).

Registros intermedios *onstitu+en un paso intermedio entre el procesador + la

memoria! tienen un tiempo de acceso mu+ 1reve + mu+ poca capacidad.

!emorias cac" :on memorias de pequea capacidad. %ormalmente una pequea

fraccin de la memoria principal. + pequeo tiempo de acceso. Este nivel de memoria se

coloca entre la *,4 + la memoria central. Hace al&unos aos este nivel era e>clusivo de

los ordenadores &randes pero actualmente todos los ordenadores lo incorporan. 'entro

de la memoria cac$ puede $a1er! a su vez! dos niveles denominados cach on chip$

memoria cac$ dentro del circuito inte&rado! + cac$ on %oard$ memoria cac$ en la

placa de circuito impreso pero fuera del circuito inte&rado! evidentemente! por razones

f<sicas! la primera es muc$o m"s r"pida que la se&unda. E>iste tam1in una tcnica!

denominada )rquitectura Harvard! en cierto modo contrapuesta a la idea de 0on

%eBmann! que utiliza memorias cac$ separadas para cdi&o + datos. Esto tiene

al&unas venta;as como se ver" en este cap<tulo.

!emoria central o principal En este nivel residen los pro&ramas + los datos. La *,4

lee + escri1e datos en l aunque con menos frecuencia que en los niveles anteriores.

?iene un tiempo de acceso relativamente r"pido + &ran capacidad.

E#tensiones de memoria central :on memorias de la misma naturaleza que la

memoria central que ampl<an su capacidad de forma modular. El tiempo de similar! a lo

sumo un poco ma+or! al de la memoria central + su capacidad puede ser al&unas veces

ma+or.

!emorias de masas o au#iliares :on memorias que residen en dispositivos e>ternos

al ordenador! en ellas se arc$ivan pro&ramas + datos para su uso posterior. ?am1in se

usan estas memorias para apo+o de la memoria central en caso de que sta sea

insuficiente (memoria virtual). Estas memorias suelen tener &ran capacidad pero pueden

lle&ar a tener un tiempo de acceso mu+ lento. 'entro de ellas tam1in se pueden

esta1lecer varios niveles de ;erarqu<a.

Clasi$icaci%n de memorias semiconductoras de acceso aleatorio

Las memorias se clasifican! por la tecnolo&<a empleada +! adem"s se&An la forma en que

se puede modificar su contenido! ) este respecto! las memorias se clasifican en dos

&randes &rupos2

1) .emorias E).2 :on memorias en las que se puede leer + escri1ir! si 1ien su nom1re

(Eandom access memor+) no representa correctamente este $ec$o. ,or su tecnolo&<a

pueden ser de ferritas (+a en desuso) o electrnicas! 'entro de stas Altimas $a+

memorias est"ticas (:E).! static E).)! cu+a clula de memoria est" 1asada en un

1iesta1le! + memorias din"micas ('E).! dinamic E).! en las que la clula de

memoria es un pequeo condensador cu+a car&a representa la informacin almacenada.

Las memorias din"micas necesitan circuitos adicionales de refresco +a que los

condensadores tienen mu+ poca capacidad +! a travs de las fu&as! la informacin puede

perderse! por otra parte! son de lectura destructiva.

7) .emorias E6. (Eead Hnl+ .emor+)2 :on memorias en las que slo se puede leer.

,ueden ser2

. a E6. pro&ramadas por m"scara! cu+a informacin se &ra1a en f"1rica

+ no se puede modificar.

. b ,E6.! o E6. pro&rama1le una sola vez.

. c E,E6. (erasa1le ,E6.) o E,E6. (repro&rama1le E6.)! cu+o

contenido puede 1orrarse mediante ra+os ultravioletas para re&ra1arlas.

. d E)E6. (electricall+ altera1le E6.) o EEE6. (electricall+ erasa1le

E6.)! que son memorias que est" en la frontera entre las E). + las

E6. +a que su contenido puede re&ra1arse por medios elctricos!

estas se diferencian de las E). en que no son vol"tiles. En ocasiones

a este tipo de memorias tam1in se las denomina %PE). (no vol"til

E).).

. e .emoria QL):H! denominada as< por la velocidad con la que puede

repro&ramarse! utilizan tecnolo&<a de 1orrado elctrico al i&ual que las

EE,E6.. Las memorias flas$ pueden 1orrarse enteras en unos

cuantos se&undos! muc$o m"s r"pido que las E,E6..

/"sicamente las memorias E6. se 1asan en una matriz de diodos cu+a unin se puede

destruir aplicando so1re ella una so1retensin (usualmente comprendida ente 317. +

34H v.). 'e f"1rica la memoria sale con 1=s en todas sus posiciones! para &ra1arla se

rompen las uniones en que se quieran poner H=s. Esta forma de realizar la &ra1acin se

denomina tcnica de los fusi1les.

.os tipos m-s usados de memoria RA; son los siguientes?

",AM %DinamicRAM)! .a primera memoria 5asta la aparici,n de los 3JK+ era algo

lenta %L4 , J4 ns&. En 0ormato D!;; o S!;; de 34 contactos.

!ast Pa+e E!PM o ",AMF7 Algo m-s r-pida que la anterior %L4 , K4 ns&. Se presenta

en 0ormato S!;; de 34 , L2 contactos.

0"&2,AM %"#tended Data OutputRAM)! @ermite empe7ar a introducir nuevos datos

mientras los anteriores est-n saliendo %L4+ K4 , 54 ns&+ lo que la 5ace algo m-s r-pida

%un 53 m-s que la 9@;&. 6ienen en S!;;s de L2 contactos+ aunque tambi8n los 5a)

en D!;; de 1KJ.

S",AM %$incronicRAM&? 9unciona sincroni7adamente con la velocidad de la placa %de

54 a KK ;C7&+ para lo que debe ser rapid*sima %de 25 a 14 ns& ) se presenta en 0orma

de D!;;s de 1KJ contactos.

PC1HH %$DRAM de %&& M'()! ;emoria SDRA; que 0unciona a 144 ;C7+ que utili7an

los micros m-s modernos.

Seg(n los tipos de conectores que lleve la memoria+ al con'unto de 8stos se les denominan

m,dulos+ ) 8stos a su ve7 se dividen en?

S$MM %$in)le Inline Memory Module)! @eque1a placa de circuito impreso con varios

c5ips de memoria integrados. Se 0abrican con di0erentes velocidades de acceso

capacidades %"+ J+ 1K+ 32+ K" ;b& ) son de 34 , L2 contactos. Se montan por pares

generalmente.

"$MM7 Son m-s alargados+ cuentan con 1KJ contactos ) llevan dos muescas para

0acilitar su correcta colocaci,n. @ueden montarse de 1 en 1.

&ipos de memoria RA!.

La memoria E). del ordenador suele ser la m"s a1undante del sistema! +a que permite

la &ra1acin + posterior recuperacin de la informacin contenida en la misma.

,odemos dividir la memoria E). en funcin del modo en el que tra1a;a2 memoria

E). est"tica (:E).2 &tatic E).) + memoria E). din"mica ('E).2 D'namic

E).). )m1os tipos de memoria almacenan los datos utilizando car&as elctricas. :e

diferencian en que utilizan mtodos distintos para almacenarlos.

La memoria :E). suele estar 1asada en transistores de tecnolo&<a .6:

(:emiconductor de 6>ido3.etal)! que permiten el almacenamiento de una alta densidad

de informacin. En este tipo de memoria la informacin se almacena en una red de

osciladores 1iesta1les! es decir! osciladores que slo permiten dos estados2 cero o uno.

La principal caracter<stica de las memorias E). est"ticas radica en que una vez

introducida la informacin! sta se mantiene dentro de la memoria $asta que se

desconecte la fuente de alimentacin.

Las memorias 'E).! por el contrario! almacenan la informacin en forma de una

car&a elctrica en un condensador! el cual slo puede almacenar una pequea cantidad

de car&a que! unido a las inevita1les fu&as! provoca que la informacin se pierda a los

pocos milise&undos. ,ara evitar el citado inconveniente! este tipo de memorias! que por

otro lado son las m"s e>tendidas por ser las m"s econmicas + por ser las que ma+or

densidad de informacin permiten! necesitan que se les refresque la informacin cada

cierto tiempo.

Ha+ que destacar que mientras la :E). necesita un m<nimo de siete transistores por

cada 1it de informacin! la memoria 'E). solamente necesita un transistor .6:QE?

+ un condensador para la celda. El pequeo condensador! que se de1e recar&ar o

refrescar miles de veces por se&undo! necesita de una circuiter<a adicional 1astante

comple;a para sostener la informacin. ,ero esta comple;idad se ve compensada por lo

reducido del tamao + del coste de cada celda de memoria.

En &eneral! se emplea la 'E). como el sistema principal de almacenamiento de

cdi&o + de datos! +a que es la m"s 1arata de fa1ricar. La :E). se utiliza cuando slo

se necesitan pequeas cantidades de memoria! tal como en el caso de las memorias

cac$s.

La memoria cac$ es un tipo de memoria de acceso aleatorio especialmente r"pida que

suele estar localizada! incluso! dentro del propio microprocesador. :uele ser de pequeo

tamao + almacena la informacin mane;ada con ma+or frecuencia por la *,4. Los

nuevos procesadores ,entium cuentan con dos memorias cac$s independientes! una

para datos + otra para cdi&os.

) continuacin se descri1en 1revemente las tecnolo&<as de 'E). e>istentes en la

actualidad2

E'6 (E"tended Data ()tp)t). (ncorpora varias innovaciones que permiten

acelerar $asta un 1R la velocidad de acceso a memoria.

:'E). ('E). :<ncrona). Emplea una seal de relo;! sincronizada con la

seal de relo; de la *,4! para coordinar las transferencias. *onsi&ue superar la

velocidad de la memoria E'6 en un 7R.

''E (Do)%le Data Rate) o :'E). ((. :e&unda &eneracin de las memorias

:'E).. )provec$a tanto el estado alto como el 1a;o de la seal de relo; para

sincronizar las transferencias. *onsi&ue duplicar la velocidad de transferencia

sin modificar la frecuencia del relo; (es decir! con la misma *,4).

E'E). (Ram%)s 'E).). Esta tecnolo&<a consi&ue multiplicar por 1H la

velocidad de transferencia de una 'E). est"ndar! &racias a una tecnolo&<a

e>clusiva denominada E:L (Eam1us :i&nalin& Lo&ic).

:L'E). (s'nclin*). ?ecnolo&<a desarrollada por un consorcio de doce

compa<as. Es una e>tensin de la :'E).! que permite ampliar el nAmero de

1ancos de 4 a 1J.

,or supuesto! para aprovec$ar una de estas tecnolo&<as! el ,* de1e estar preparado para

ello. 0al&an como e;emplo los procesadores ,entium 4! que por medio de un acuerdo

entre Eam1us e (ntel! vienen preparados para emplear E'E)..

$ttp255ai1.um$.es51C(n?roduccionC(nformatica5tema75El,*pordentro.$tm

3.2.2.3 Caractersticas.

Caracter*sticas de la Memoria!

El tiempo de almacenamiento? %vol-til o no&.

6elocidad de acceso en operaciones de lectura / escritura.

$apacidad de almacenamiento.

Sin embargo? A mas +elocidad mayor costeSO.A$!OUtili(ar distintos tipos de memoria

or)ani(ada de forma ,er-r.uica.

/ipos!

;emorias de solo lectura RO;? @RO; ) E@RO;

;emorias de lectura / escritura RA;? SDRA; ) DRA;

;emorias ;agn8ticas / ,pticas? Discos duros+ $DRO;+ D6D

0erar.u*a de memoria1 2i+eles!

!6E. 4 $ac5e P6E.O$!DAD

!6E. 1 Ram/Rom QQ..QQQQQQ.

!6E. 2 ;agn8tico / ,ptico P$A@A$!DAD

un sistema de memoria se puede clasificar en funcin de mu+ diversas caracter<sticas.

Entre ellas se pueden destacar las si&uientes2 localizacin de la memoria! capacidad!

mtodo de acceso + velocidad de acceso. En el caso de la memoria E).! tam1in

denominada memoria principal o primaria! los valores de estas caracter<sticas son2

Localizacin2 interna! se encuentra en la placa 1ase.

*apacidad2 $o+ en d<a no es raro encontrar ,* equipados con 17G o 7J ./ de

memoria E)..

.todo de acceso2 memoria de acceso aleatorio. )dem"s! permite el acceso para

lectura + escritura de informacin.

0elocidad de acceso2 actualmente se pueden encontrar sistemas de memoria

E). capaces de realizar transferencias a frecuencias del orden de los D1ps

(&i&a1its por se&undo).

?am1in es importante anotar que la E). es una memoria vol"til + por tanto requiere

de alimentacin elctrica para mantener la informacin.

Ca*acte*st(cas

#ienen matri7? .ugar 0*sico en el que se almacena in0ormaci,n. An punto es el

lugar 0*sico donde se almacena un bit. J puntos es una celda E)te.

$ada celda tiene asociada una direcci,n+ que indica la ubicaci,n 0*sica de la

celda.

$apacidad? n(mero de b)tes que puede almacenar.

#iempo de acceso? El tiempo que transcurre desde que el @ solicita un dato )

la memoria se lo entrega %en ns&.

CA,ACT0,$ST$CAS "0 (A M0M&,$A

CAPAC$"A"

$antidad de in0ormaci,n que puede almacenar en una memoria en concreto. Ca) dos tipos?

RAtil? .A que puede almacenar el usuario.

REruta? (mero total de unidades de in0ormaci,n %bits , b)tes& que pueden ser

almacenadas en un dispositivo.

;0(&C$"A"

!ndica el tiempo desde que se solicita un dato 5asta que se recibe. Dos grupos?

R De acceso aleatorio? Si se tarde lo mismo independientemente de la situaci,n del dato.

De acceso no aleatorio? !n0lu)e el tiempo de b(squeda ) el de latencia.

"U,AC$&1 "0 (A $1!&,MAC$&1

$apacidad de retener la in0ormaci,n a lo largo del tiempo. #iene que ver con la permanencia ,

no del suministro de energ*a el8ctrica.

R6ol-tiles? @ierden su contenido sin electricidad. Est-n basadas en semiconductores.

Ro vol-tiles? @ermanentes.

C&ST0S

Se divide en precio/unidad de in0ormaci,n ) depende 0uertemente de 0orma antag,nica con la

velocidad de acceso.

@recio #.acceso $oste

Registros 24444 pts/;E 14 ns

RA; 5444 pts/;E L4 ns

Disco duro 144 pts/;E 14 ms

Disquetes 54 pts/;E 2 s

$intas Streamer 14 pts/;E 24 s

@apel digital 4+41 pts/;E 2 min. #iempo

M&"& "0 ACC0S&

Se re0iere a como se indica la direcci,n de la posici,n de memoria a la que se quiere acceder )

como se organi7a la in0ormaci,n en el interior de la memoria.

I0,A,BU$AS "0 M0M&,$A

.o que interesa es utili7ar memorias r-pidas+ pero son mu) costosas+ por lo que se utili7an

dispositivos caros%r-pidos& para los que operan en la $@A ) dispositivos baratos%lentos& pero

con ma)or capacidad de almacenar in0ormaci,n que no se procesa en ese momento

determinado.

ns RED!S#RO En la $@A

decenas de ns ;E;OR!A $A$CE

;E;OR!A @R!$!@A. @laca base

de ms a seg. ;E;OR!A SE$ADAR!A 9uera del ordenador

3.2.2. !uncionamiento.

Funci&n

:ormada por condensadores, que continuamente se est(n carando y descarando, hacen

posible almacenar los ceros y unos "ausencia y presencia de corriente respecti.amente%, el

tiempo que tarden a .ol.erse a carar una .e+ se descaran recibe el nombre de tiempo de

refresco4 tambi)n hay otro tiempo establecido, es el tiempo de acceso&

1a memoria de trabajo "normalmente compuesta de chips 6,7%, hace de cajn o caja al

microprocesador dnde uarda los datos que necesita para operar con ellos, as s la CPU

necesita al9n dato, el disco duro la busca, y este lo en.a a la memoria de trabajo, y )ste .a

a la CPU cuando se la pide& ,s pues .emos que es una memoria temporal, puesto que

adem(s, al apaar el PC se pierde toda la informacin que hay&

,ttp:--....,a*d.a*e/2v.com-conoc(m(entospc-0.p,p

)unc(ones 'ue *eal(+a

La memoria de un computador se puede definir como los circuitos que permiten

almacenar + recuperar la informacin. En un sentido m"s amplio! puede referirse

tam1in a sistemas e>ternos de almacenamiento! como las unidades de disco o de cinta.

Ho+ en d<a se requiere cada vez m"s memoria para poder utilizar comple;os pro&ramas

+ para &estionar comple;as redes de computadores.

3.2.3 "ispositi#os de $%&.

.as unidades de E/S constan de dos elementos?

M0CJ1$C&7 denominado SD!S@OS!#!6O DE E/ST.

0(0CT,K1$C&7 denominado S$O#RO.ADOREST.

.os dispositivos de E/S que se conectan al ordenador se clasi0ican en?

'(&BU07 .a in0ormaci,n se almacena en bloques+ esos bloques son de

tama1o 0i'o. Donde cada bloque tiene una direcci,n que lo identi0ica. Se

puede leer o escribir en un bloque independiente de los dem-s.

Por e,emplo? disquete+ $D+ D6D+ disco duro.

CA,JCT0,7 .a in0ormaci,n que se generan o reciben son 0lu'os de

caracteres %no bloques&. Accede a los datos en secuencia? o sea+ para

acceder a determinados datos+ la lectura ) escritura se debe 5acer

seguido de los datos anteriores.

Por e,emplo? teclado+ pantalla+ cinta+ ratones+ inter0a7 de

comunicaci,n.

.a l*nea de separaci,n no es r*gida+ 5a) dispositivos que pueden ser

del tipo bloque %cintas ;agn8ticas& aunque son considerados del tipo car-cter.

$on esta clasi0icaci,n+ un dispositivo que est- 0uera de ellas+ el

SRE.O=T+ no es orientado ni a bloque ni de car-cter. Si es un dispositivo

especial+ )a que lo (nico que 5ace es generar interrupciones.

Otros aspectos importantes que 5acen la di0erencia entre dispositivos

son?

Comportamiento7 entrada+ salida+ almacenamiento.

Tasa de trans8erencia7 tasa de peaU de trans0erencia entre

dispositivos ) memoria.

El siguiente cuadro 5ace re0erencia+ a las grandes di0erencias entre las

clases de dispositivos?

"$SP&S$T$;& C&MP&,TAM$01T& C(AS$!$CAC$&1 TASA L'%S0M.

T0C(A"& Entrada $ar-cter 4+41

M&US0 / / 4+42

SCA110, / / "44

;&S ESalidaF Salida / 4+K

$MP,0S&,A

E(neaF

/ / 1+4

$MP,0S&,A

E(serF

/ / 244

M&"0M Entrada / salida / 2+4:J+4

,0" (A1 / / 544:K444

!(&PPN Almacenamiento Eloque 144

C" / / 1444

C$1TA

MAM10T$CA

/ / 2444

"$SC&

MAM10T$C&

/ / 2444:14444

E2isten otros 0actores que 5acen a su distinci,n?

A!DADES DE $O#RO.

RE@RESE#A$!O DE DA#OS

$OD!$!O DE ERROR

5ttp?//e2a.unne.edu.ar/depar/areas/in0ormatica/SistemasOperativos/;onogSO/

DES#ES42.5tm

'rincipios del So$t(are de E ) S

La idea 1"sica es or&anizar el softBare como una serie de capas donde S78!

?anen1aumT2

Las capas inferiores se encar&uen de ocultar las peculiaridades del $ardBare a

las capas superiores.

Las capas s)periores de1en presentar una interfaz a&rada1le! limpia + re&ular a

los usuarios.

*+,etivos del So$t(are de E ) S

4n concepto clave es la independencia del dispositi+o

'e1e ser posi1le escri1ir pro&ramas que se puedan utilizar con archi+os en

distintos dispositi+os! sin tener que modificar los pro&ramas para cada tipo de

dispositivo.

El pro1lema de1e ser resuelto por el :. 6.

El o1;etivo de lo&rar nom%res )niformes est" mu+ relacionado con el de independencia

del dispositivo.

?odos los arc$ivos + dispositivos adquieren direcciones de la misma forma! es decir

mediante el nom%re de s) r)ta de acceso,

6tro aspecto importante del softBare es el mane-o de errores de e . s

Deneralmente los errores de%en mane-arse lo m/s cerca posi%le del hard0are,

:olo si los niveles inferiores no pueden resolver el pro1lema! se informa a los

niveles superiores.

Deneralmente la recuperacin se puede $acer en un nivel inferior + de forma

transparente.

6tro aspecto clave son las transferencias s1ncronas (por 1loques) o as1ncronas

(controlada por interruptores)2

La ma+or<a de la e 5 s es as1ncrona la cpu inicia la transferencia + realiza otras

tareas $asta una interrupcin.

La pro&ramacin es m"s f"cil si la e 5 s es s1ncrona (por 1loques)2 el pro&rama se

suspende autom"ticamente $asta que los datos estn disponi1les en el 1uffer.